BiC : Large Scale Incremental Learning

새로운 클래스를 점진적으로 학습할때, catastropic forgetting문제를 다루면서 이 논문에서는 데이터 불균형 문제와 시각적으로 유사한 클래스가 증가할때 발생하는 어려움을 지적하면서 편향 보정 방법인 BiC를 제안 합니다.

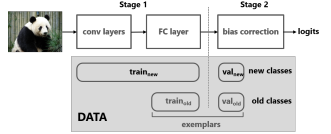

이러한 BiC의 방법은 2단계로 나눠지는데 1단계는 저자들의 제안 방법은 아니고 기존 방법을 의미합니다. 1단계 학습은 LwF와 다르지않게 old + new class로 이루어진 전체 클래스에 대해 classification loss를 적용합니다.그리고 old class에 대해 distillation loss를 적용합니다.

학습2단계에서는 먼저 전체 데이터를 old/new 모두 train/val로 나눠 총 4 등분합니다. 그림에서 볼 수 있듯이 1단계에서는 train의 old,new를 학습하고 2단계에서는 val (new + old) 데이터로 bias correction 수행합니다.new class는 상대적으로 많은 데이터를 학습하기 때문에 new class에 대해서 bias가 치우쳐져 있으므로 new class에 대해서만 correction 작업을 수행합니다.

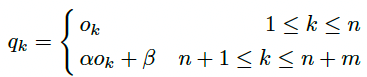

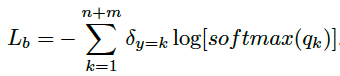

(New Class Output에 대해서는 𝛼,𝛽를 추가하여 Linear Correction을 적용한 모습을 볼 수 있습니다. 이제 여기에 Classification Loss를 적용하면 수식은 다음과 같습니다.)

BiC: Large Scale Incremental Learning에서 시각적으로 유사한 클래스가 증가할 때 발생하는 어려움은 모델이 비슷하게 보이는 클래스들 간의 구분을 어려워하는 문제를 의미합니다. 점진적 학습 중에 시각적으로 유사한 클래스가 더 많이 추가될수록, 모델은 이들 간의 명확한 결정 경계를 유지하는 데 어려움을 겪게 되어 오분류의 가능성이 높아집니다. 이러한 문제는 특히 새로운 클래스가 추가될 때 더욱 심화되며, 이는 catastrophic forgetting 문제를 악화시킵니다.

시각적으로 유사한 클래스가 증가하면 데이터 불균형 문제도 더욱 심해지는데, 이로 인해 모델이 새로 학습한 클래스에 편향되는 경향이 강해지며, 기존 지식을 유지하면서 미세한 시각적 차이를 구분하는 능력이 더 어려워집니다.

출처) https://ffighting.net/deep-learning-paper-review/incremental-learning/bic/

https://cho-akashic-records.tistory.com/109