Chapter 3 텐서플로우

-

머신러닝을 위한 오픈소스 플랫폼: 딥러닝 프레임워크

-

구글이 주도적으로 개발하여 구글 코랩에는 기본적으로 장착 됨

-

Tensor: 벡터나 행렬

-

Graph: 텐서가 흐르는 경로

-

Tensor Flow: 텐서가 Graph를 통해 흐름

Keras

-

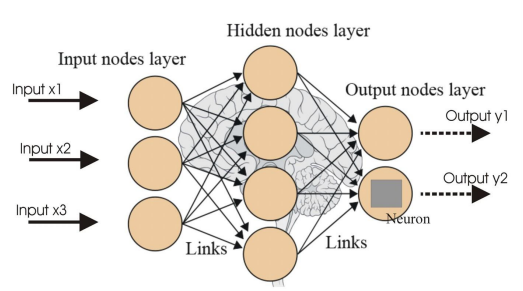

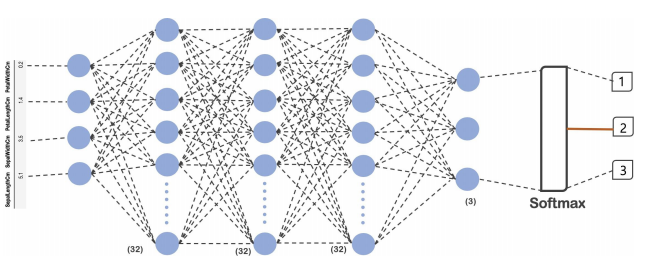

신경망에서 아이디어를 얻어서 시작된 Neural Net

-

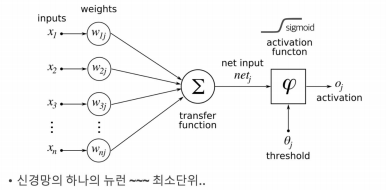

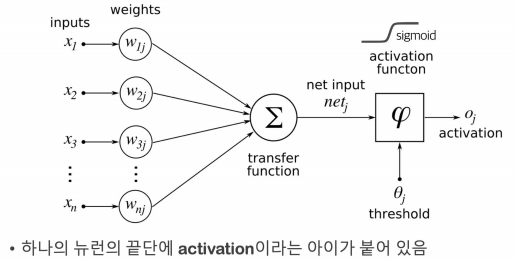

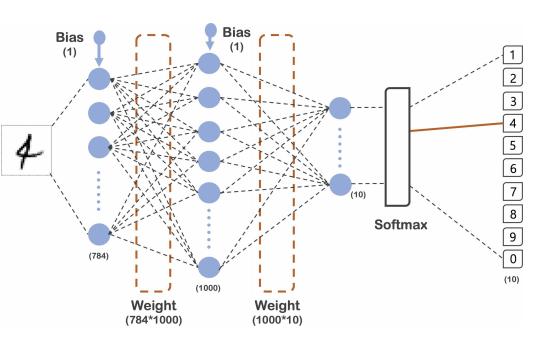

뉴런

-> 입력, 가중치, 활성화함수, 출력으로 구성

-> 뉴런에서 학습할 때 변하는 것은 가중치, 처음에는 초기화를 통해 랜덤값을 넣고, 학습과정에서 일정한 값으로 수렴

-

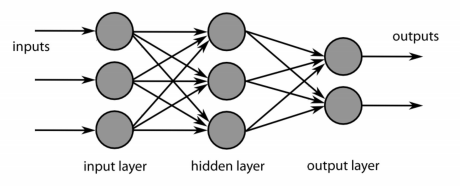

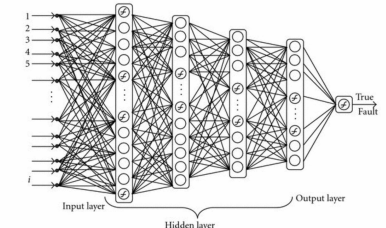

레이어와 망(net): 뉴런이 모여서 layer를 구성하고, 망이 됨

-

딥러닝: 신경망이 깊어지면 깊은 신경망 Leep Learning이 됨

-

loss

-> 정답까지 얼마나 멀리 있는지를 측정하는 함수

-> 학습을 위해서는 loss(cost)함수를 정해주어야 함 -

optimizer

-> loss 함수를 최소화하는 가중치를 찾아가는 과정에 대한 알고리즘

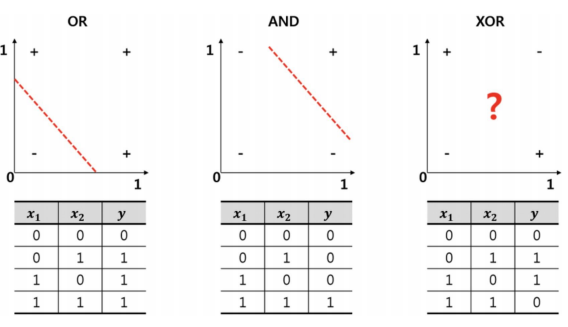

XOR 문제

- 선형 모델로는 XOR을 풀 수 없음

분류 문제

-

activation

-

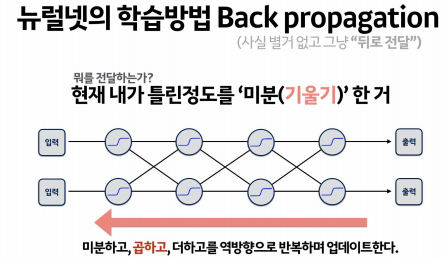

역전파 back-propagation

-

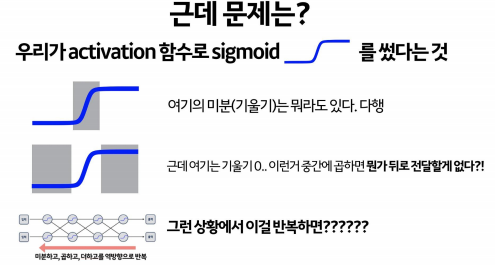

역전파에는 sigmoid 문제가 있음

-

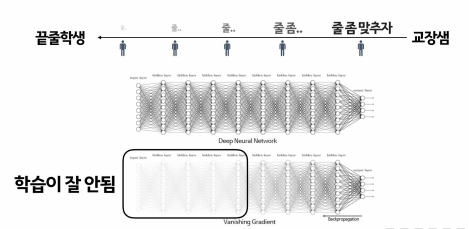

gradient vanishing: 레이어가 깊을수록 업데이트가 사라져가서 fitting이 잘 안됨(underfitting)

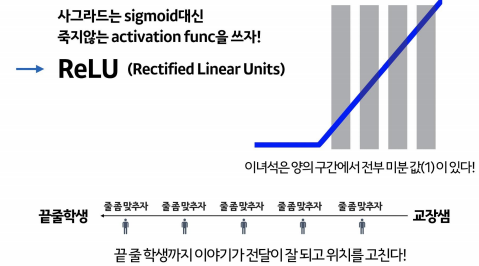

-ReLU

-

softmax: 뉴럿넷에게 다을 회신받는 방법 중 category와 연관된 것

-

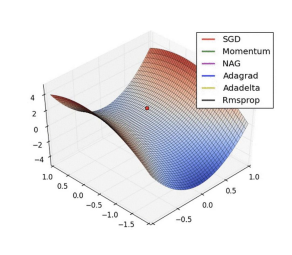

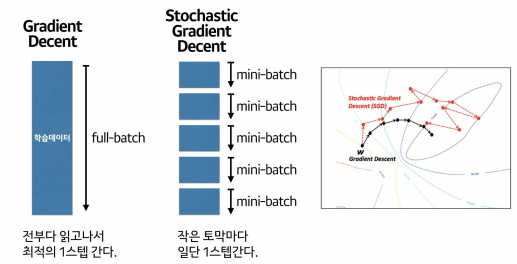

gradient decent: 기존 뉴럴넷이 가중치 parameter들을 최적화하는 방법

-> loss funcion의 현 가중치에서의 기울기를 구해서 loss를 줄이는 방향으로 업데이트 -

SGD

-

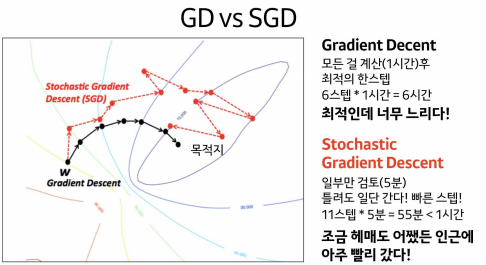

GD vs SGD

-

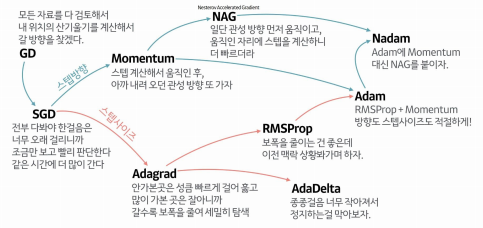

옵티마이저 발달 계보

-> 데이터가 복잡할 때는 Adam 활용 할 것

Chapter 4 딥러닝을 이용한 MNIST

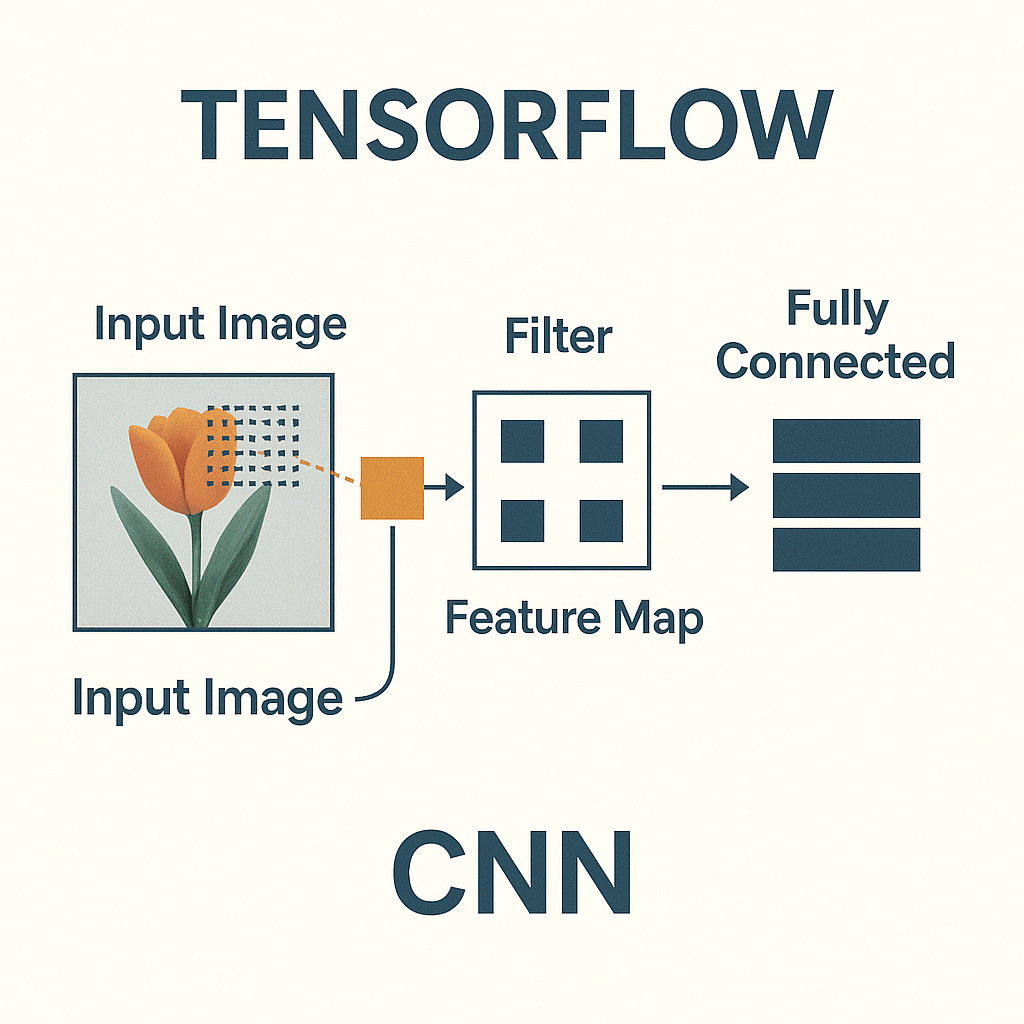

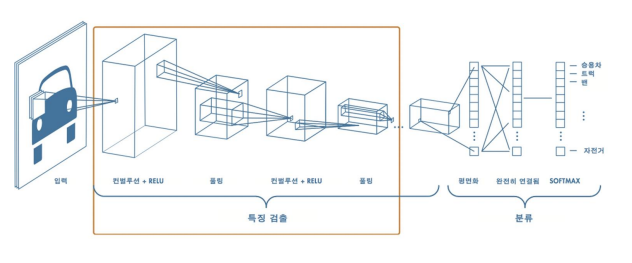

Chapter 5 CNN

-

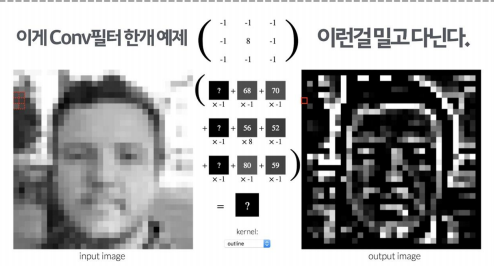

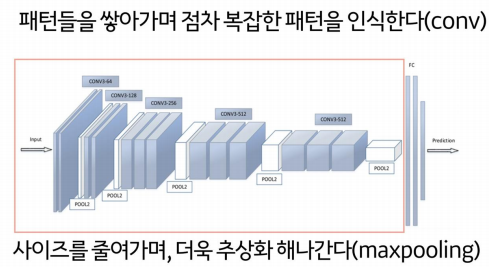

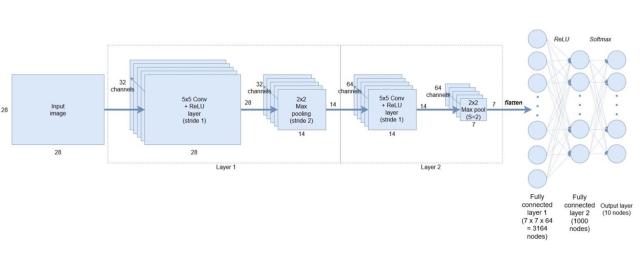

convolutional 필터 결과

-

convolution: 특정 패턴이 있는지 박스로 훓으며 마킹

-> convolution 박스로 밀고나면, 숫자가 나옴, 그 숫자를 Activaiton에 넣어 나온 값으로 이미지 지도를 새로 그림 -

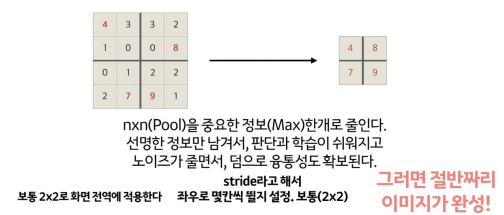

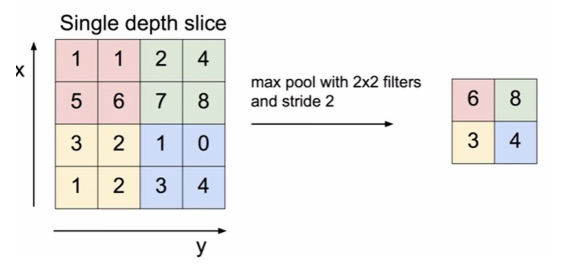

풀링: 점점 더 멀리서 보는 법

-> 그림을 줄여도 됨 -

MaxPooling: 사이즈를 점진적으로 줄이는 법

-

Conv Layer의 의미

-

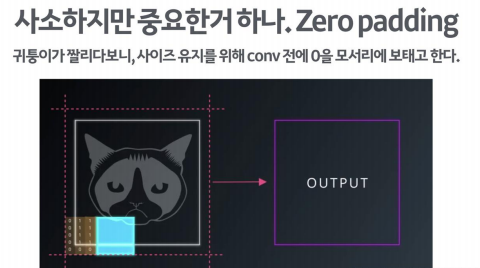

Zero padding

-

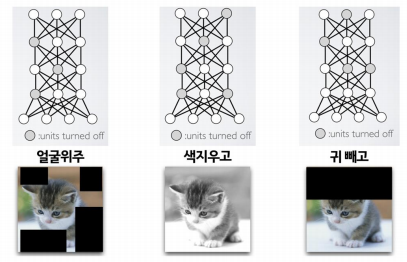

Dropout: 학습 시킬 때, 일부러 정보를 누락시키거나 중간 노드를 꺼서 융통성을 기르는 방법

이 글은 제로베이스 강의 자료 일부를 발췌하여 작성되었습니다