“프롬프트 중심 사고에서 오케스트레이션 중심 사고로.”

이제 LLM을 단순히 ‘질문-답변’ 도구가 아니라 하나의 시스템으로 설계하자.

💡 1. LangChain이란 무엇인가?

LangChain은 LLM 기반 애플리케이션을 쉽게 구성하기 위한 오케스트레이션 프레임워크입니다.

GPT 같은 모델을 단순 호출하는 것이 아니라, 프롬프트·메모리·툴·체인·에이전트 등을 조합해 복잡한 AI 워크플로우(Workflow)를 만들 수 있게 해줍니다.

🔍 핵심 요약

| 항목 | 설명 |

|---|---|

| 정의 | LLM 호출을 체계적으로 구성하고 관리하는 Python/JS 기반 프레임워크 |

| 핵심 철학 | “LLM을 직접 부르지 말고, 조립 가능한 컴포넌트로 설계하라” |

| 핵심 구성요소 | Prompt, LLM, Chain, Tool, Memory, Agent |

| 활용 예시 | 질의응답 시스템, 대화형 봇, 문서 검색+요약 시스템 |

| 공식 문서 | https://python.langchain.com |

⚙️ 2. LangChain의 핵심 구성요소

LangChain의 모든 기능은 아래 여섯 가지 구성요소로 환원됩니다 👇

| 구성요소 | 설명 | 예시 |

|---|---|---|

| PromptTemplate | 모델 입력을 동적으로 구성 | "Answer the question: {question}" |

| LLM | 실제 모델 호출 객체 | ChatOpenAI(model="gpt-4o-mini") |

| Chain | 여러 단계를 연결한 파이프라인 | LLMChain, SequentialChain |

| Tool | LLM이 직접 호출할 수 있는 함수 | 검색 API, 계산기 등 |

| Memory | 대화 맥락 유지 | ConversationBufferMemory |

| Agent | Tool을 스스로 선택·활용하는 LLM | initialize_agent() |

이 여섯 가지를 조합하면, 단순한 Q&A부터 자율적 에이전트 시스템까지 설계할 수 있습니다.

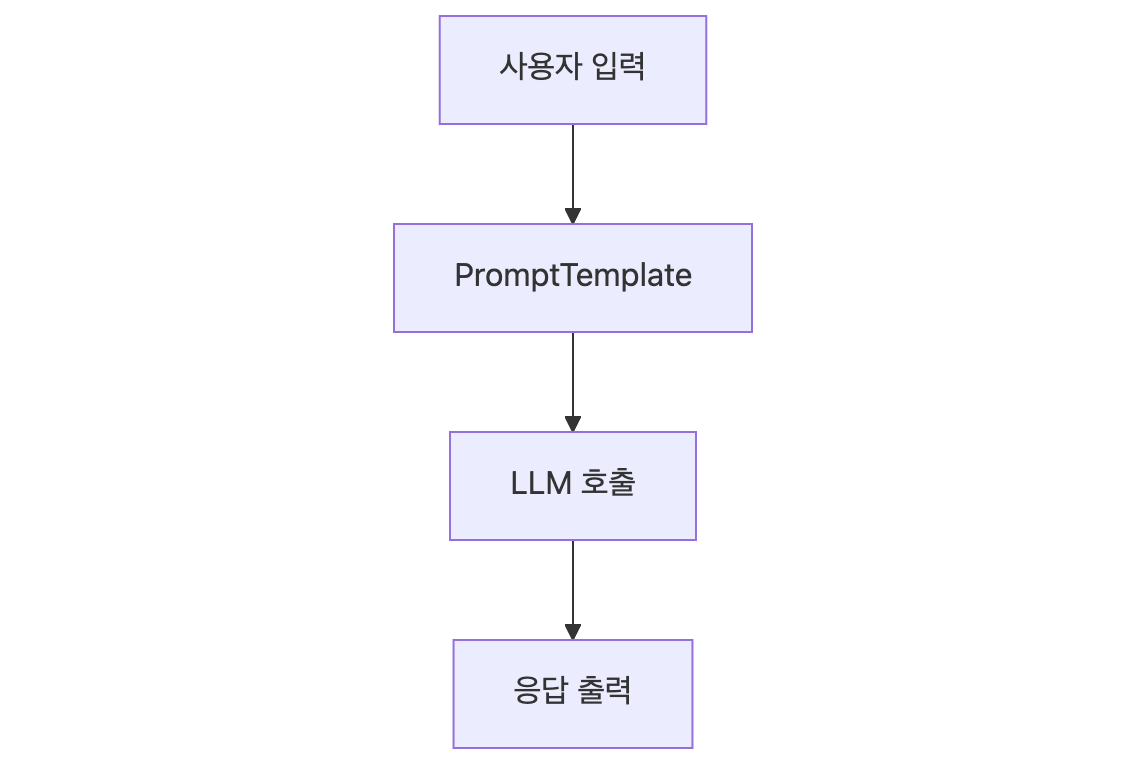

🧠 3. LangChain의 기본 흐름

LangChain의 가장 단순한 실행 형태는 “프롬프트 → LLM → 출력”의 단일 체인입니다.

from langchain.prompts import PromptTemplate

from langchain.chains import LLMChain

from langchain_openai import ChatOpenAI

# 1️⃣ 프롬프트 템플릿 정의

prompt = PromptTemplate.from_template("Q: {question}\nA:")

# 2️⃣ LLMChain 생성

chain = LLMChain(

llm=ChatOpenAI(model="gpt-4o-mini"),

prompt=prompt

)

# 3️⃣ 실행

result = chain.invoke({"question": "LangChain이란 무엇인가?"})

print(result)📘 출력 예시

LangChain은 LLM을 중심으로 프롬프트, 메모리, 툴 등을 체계적으로 연결하여

AI 워크플로우를 쉽게 설계할 수 있는 프레임워크입니다.

📈 4. 구조를 시각화해보기

이 간단한 선형 구조가 이후 LangChain에서 Chain + Memory + Tool + Agent로 확장되며 복잡한 대화형 시스템의 기반이 됩니다.

🧩 5. LangChain의 철학: “LLM은 컴포넌트다”

LangChain은 단순히 라이브러리가 아니라, 사고방식을 바꾸는 프레임워크입니다.

| 전통적 접근 | LangChain적 접근 |

|---|---|

| “GPT에 프롬프트를 넣는다.” | “GPT 호출 자체를 하나의 노드로 조합한다.” |

| Prompt → Response | Prompt → LLM → Tool → Memory → Output |

| 하드코딩된 흐름 | 조립 가능한 체인 구조 |

| 단순 질문 응답 | 자율적 추론·검색·계산 등 복합 행동 |

즉, LangChain은 LLM을 하나의 “생각하는 함수(Thinking Function)”로 다루는 패러다임을 제공합니다.

🔧 6. 실전 예시 — 간단한 Q&A 앱 만들기

아래는 LangChain을 이용한 “질문 → 답변” 체인의 최소 형태입니다.

from langchain.chains import SimpleSequentialChain

from langchain.prompts import PromptTemplate

from langchain_openai import ChatOpenAI

# 요약 체인

summary_prompt = PromptTemplate.from_template("다음 문장을 한 줄로 요약해줘: {text}")

summary_chain = LLMChain(llm=ChatOpenAI(model="gpt-4o-mini"), prompt=summary_prompt)

# 번역 체인

translate_prompt = PromptTemplate.from_template("Translate this to English: {summary}")

translate_chain = LLMChain(llm=ChatOpenAI(model="gpt-4o-mini"), prompt=translate_prompt)

# 두 체인을 연결

overall_chain = SimpleSequentialChain(chains=[summary_chain, translate_chain])

result = overall_chain.invoke({"text": "LangChain은 대형언어모델 기반의 파이프라인 프레임워크입니다."})

print(result)📘 출력 예시

“LangChain is a pipeline framework based on large language models.”

🎯 7. LangChain을 배우면 얻는 것

- ✅ LLM 오케스트레이션 능력 — LLM 호출을 함수처럼 다루기

- ✅ Prompt 설계 구조화 — 다양한 입력을 체계적으로 처리

- ✅ Tool 및 외부 API 통합 기반 — Agent 단계로 발전 가능

- ✅ LangGraph의 사전 이해 기반 확보 — 그래프 사고의 밑바탕 형성

🎓 8. 더 깊이 배우기 위한 고급 확장 가이드

| 주제 | 학습 이유 | 학습 방향 |

|---|---|---|

| LCEL (LangChain Expression Language) | LangChain 내부 실행 엔진 이해 | 공식 문서 + LCEL 예제 코드 실습 |

| PromptTemplate 고급 문법 | 다양한 입력 변수·조건 처리 | f-string, Jinja2 문법 학습 |

| Callback / Tracing | LLM 호출 로그 추적 및 시각화 | LangSmith 사용 |

| LangChainHub | 오픈 체인/Tool 공유 플랫폼 활용 | Hub에 직접 등록 실습 |

| LangServe | Chain/Agent를 REST API로 배포 | LangGraph 학습 전 실습 기반 |

📚 9. 마무리 요약

| 항목 | 요약 |

|---|---|

| 핵심 개념 | LangChain은 “LLM 워크플로우를 체계화”하는 오케스트레이션 프레임워크 |

| 핵심 코드 | PromptTemplate → LLMChain → invoke() |

| 비전 | 단순 호출이 아닌 “LLM 시스템 설계”로의 전환 |

| 다음 편 예고 | 🔜 LangChain ② — Chain, Memory, Agent 실전 구조 |

🧭 한 줄 요약

LangChain은 “LLM을 직접 부르는” 것이 아니라,

“LLM이 작동하는 흐름 자체를 코드로 설계하는” 프레임워크다.