경사하강법, 신경네트워크가 학습하는 방법 | Chapter 2, 딥러닝에 관하여 [3Blue1Brown]

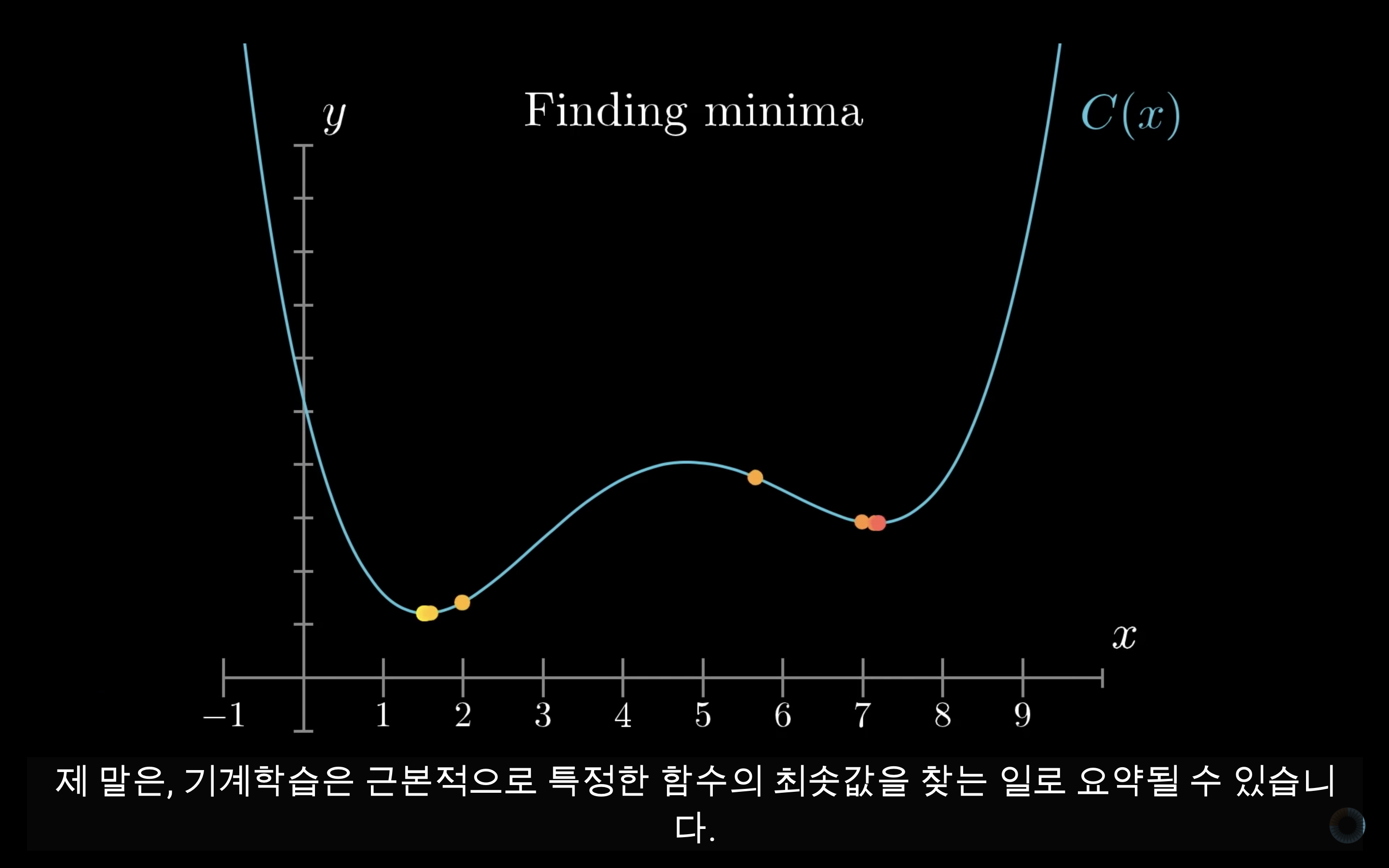

"기계학습은 근본적으로 특정한 함수의 최솟값을 찾는 일로 요약될 수 있습니다."

그 특정한 함수가 무엇인가?

"기계학습은 근본적으로 특정한 함수의 최솟값을 찾는 일로 요약될 수 있습니다."

네 그 특정한 함수가 바로 Cost Function 입니다.

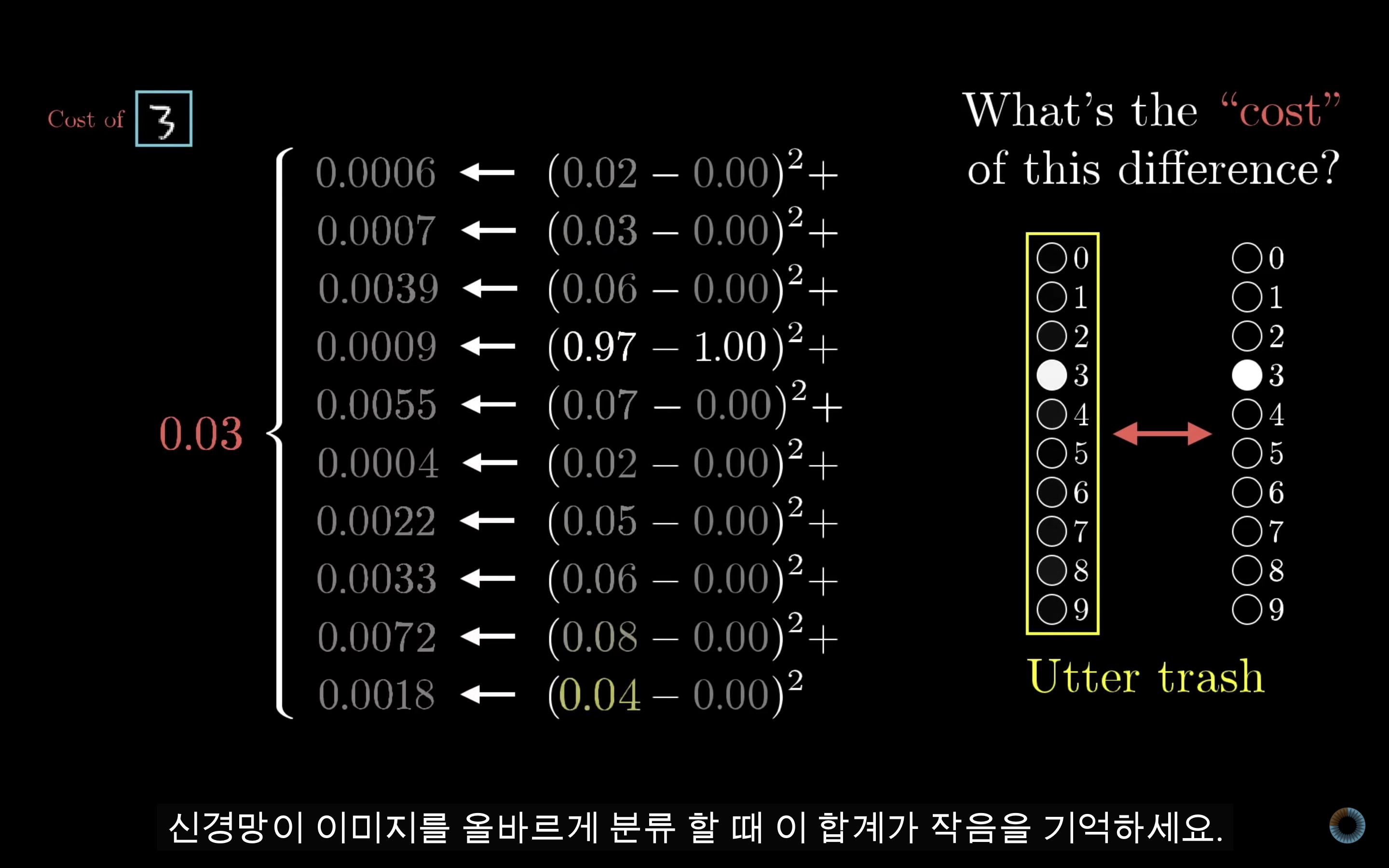

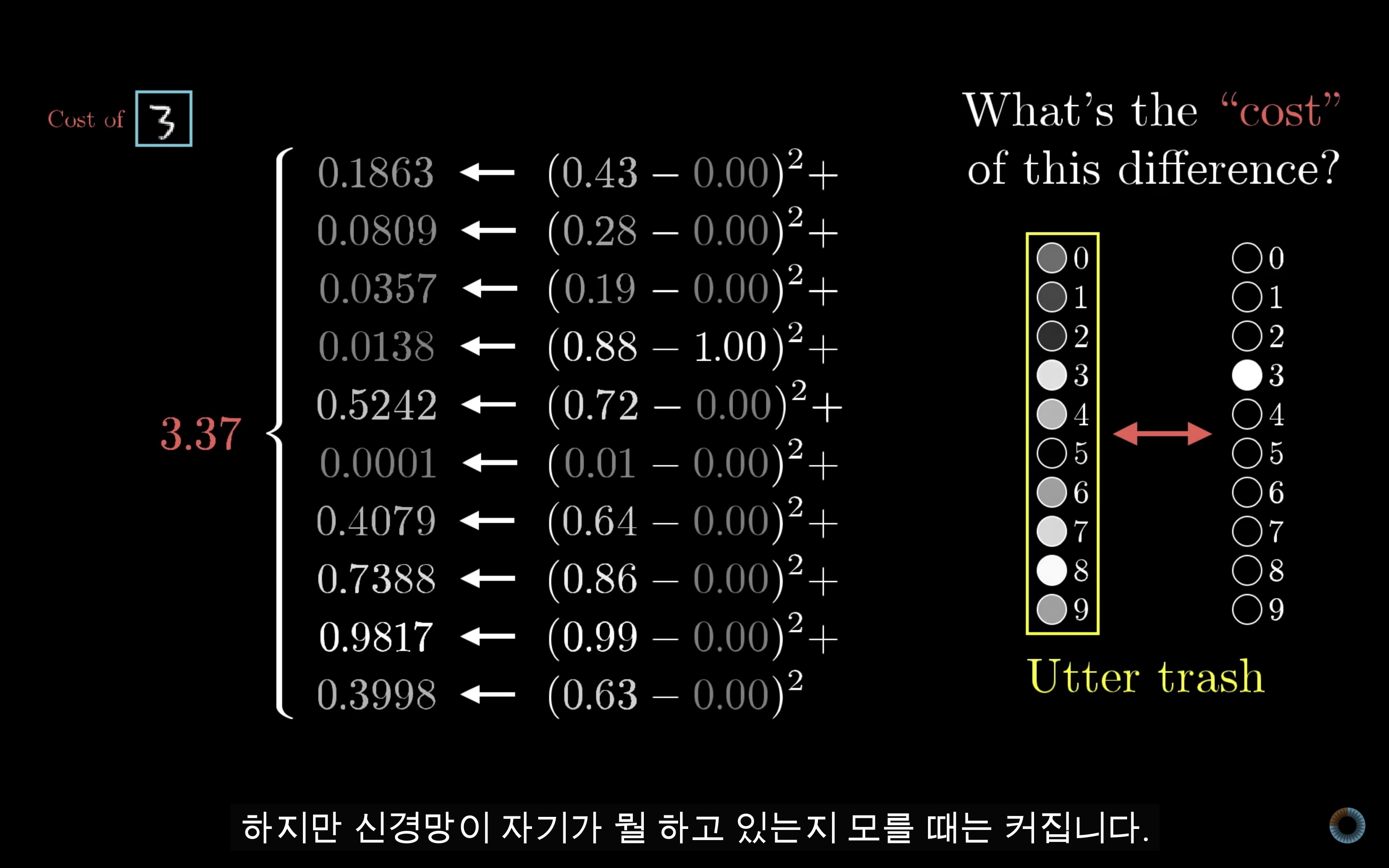

Cost는 정답과 예측, 즉 과의 Difference를 제곱한 것들의 합입니다.

위 그림에서 볼 수 있다시피, 신경망이 올바르게 분류할 때,

즉 예측과 정답이 크게 다르지 않을 때 Cost 값은 매우 작아지고

신경망이 자기가 뭘 하고 있는지 모를 때,

즉 예측과 정답이 크게 다를 경우 Cost 값은 매우 커집니다.

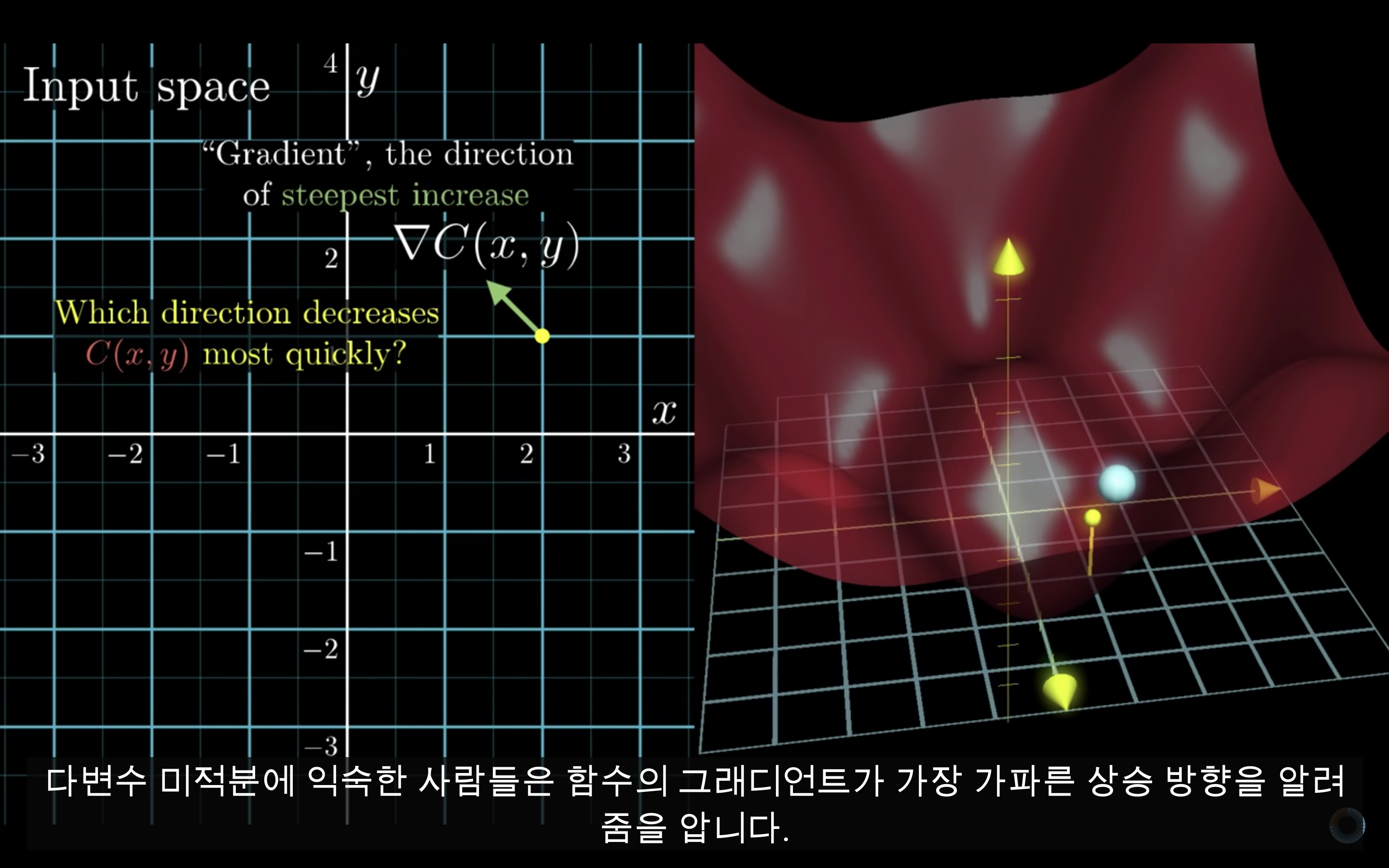

호오 Function의 Gradient가 가장 가파른 상승 방향을 알려주는구나...

다변수 미적분에 안익숙하네

[?] 각 변수에 대해서 Partial Derivative한게 Gradient이면?

Check Point - 벡터의 길이, 그리고 방향

Gradient에서 저렇게 상수가 나오는건가?