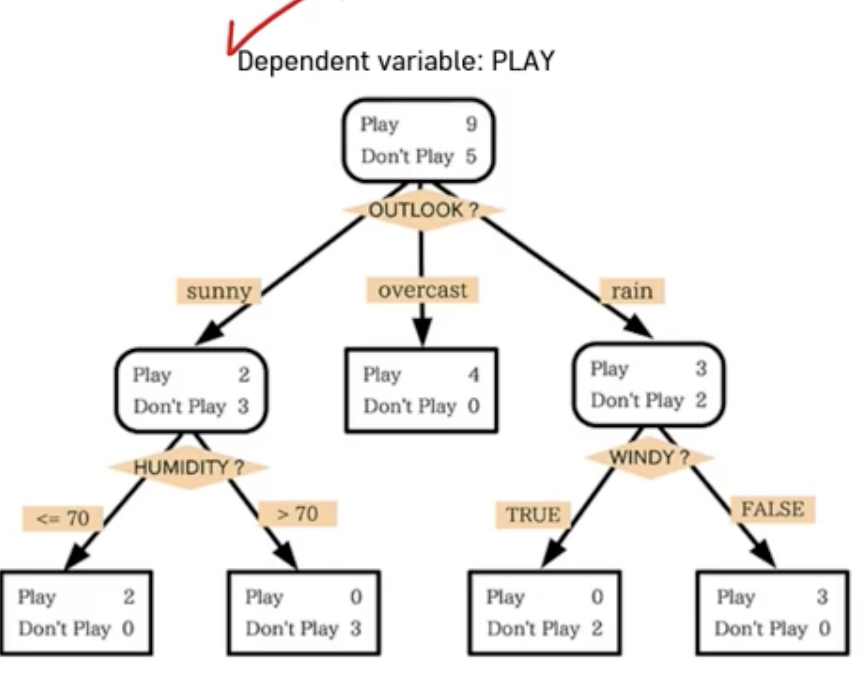

Decision Tree

- 분류와 회귀 작업 및 다중출력 작업도 가능한 다재다능한 머신러닝 방법론

- IF-THEN 룰에 기반한 해석이 용이함

- 일반적으로 예측 성능이 우수한 랜덤 포레스트 방법론의 기본 구조

- CART 훈련 알고리즘을 이용해 모델을 학습

IF-THEN 규칙

: 데이터 공간 상에서는 각 변수를 수직 분할한 것과 동일

-

데이터 공간의 순도가 증가 되게끔 영역을 구분하는 방법

-

If-Then 규칙을 이용해서 데이터 공간을 분할해서 분류나 예측을 하기 때문에 높은 해석력을 가짐

하지만 데이터의 작은 변화에 민감한 한계점 (Ensemble을 이용해 극복)

불순도

: 한 노드에 속하는 샘플들의 클래스 비율을 이용해서 특정 노드가 얼마나 잘 구분 되었는지 측정

- gini = 불순도

CART 알고리즘

: Classification and Regression Tree

- 불순도를 최소화하도록 최종 노드를 계속 이진 분할하는 방법론

Decision Tree 학습

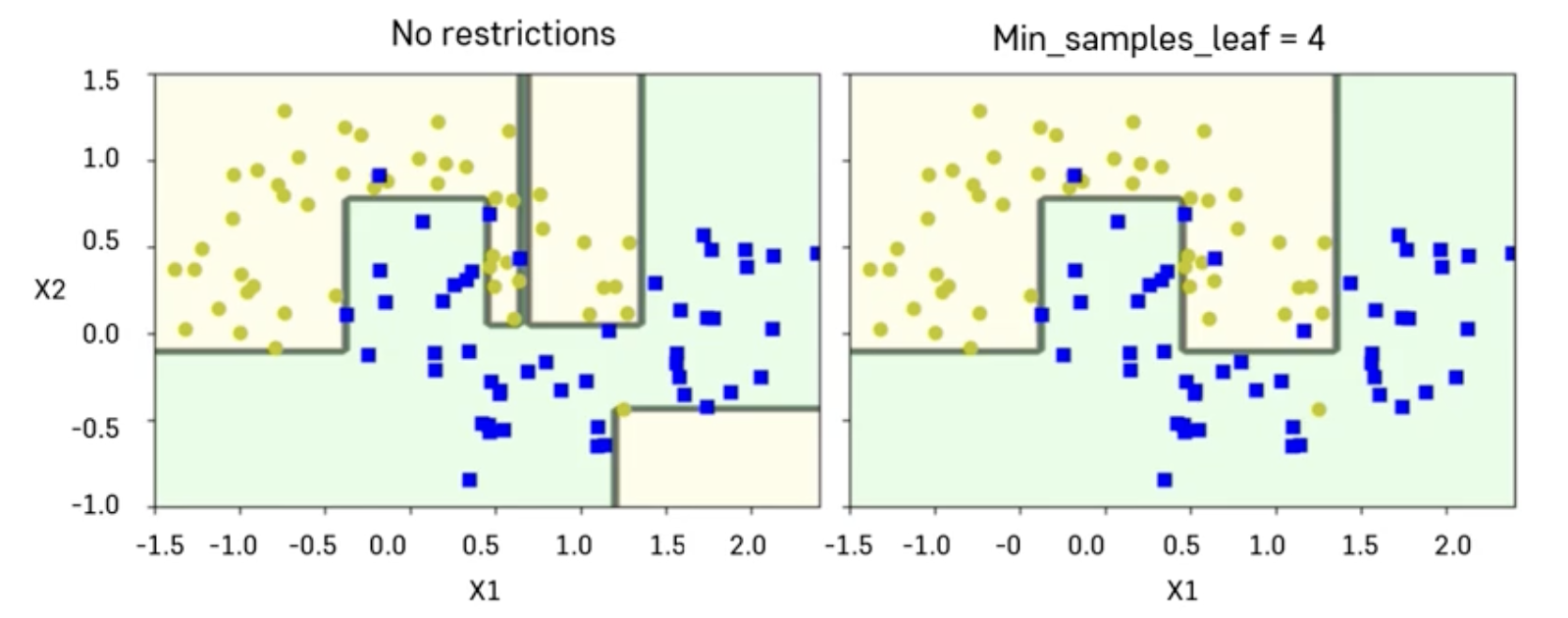

- 훈련 데이터에 대한 제약 사항이 없기 때문에 과대적합의 문제가 일어나기 쉽다

- 훈련에 제약을 두는 방법 (Regularization)으로 과대적합의 문제를 해결할 수 있음

- max_depth : 트리의 최대 깊이 제어

- min_samples_split : 분할되기 위해 노드가 가져야 하는 최소 샘플 수

- min_samples_leaf : 리프 토드가 가지고 있어야 할 최소 샘플 수

- max_leaf_nodes : 리프 노드의 최대 수

Regularization 적용 전 후

- overfitting ➡️ regularization

Decision Tree Regression

- 각각의 노드에 속한 관측치들의 평균 타겟값(y)으로 예측

Regularization 적용 전 후

reference : K-MOOC 실습으로 배우는 머신러닝