카메라 기반 물체 검출 기술

카메라 영상에서 단일, 혹은 다중의 물체의 종류와 위치를 추정하는 기술

물체의 위치는 물체를 포함하는 2차원 바운딩 박스로 표현

Convolutional Neural Network(CNN) 사용 카메라 영상으로부터 추상적인 특징 지도 추출

CNN을 백본 네트워크(물체 검출을 위한 추상적인 특징을 네트워크로 사용)로 사용

|

추상화된 특징 지도 추출

|

각 원소마다 앵커 박스(각 원소마다의 기준 박스) 이용

|

상대 변위 추정, 물제 분류 수행

카메라 기반 물체 검출 기술

- 1차 검출기

입력 데이터(RGB) -> 특징맵 추출 CNN -> 검출 레이어(Detection Head) -> 물체 검출 결과

ex) YOLO, SSD, RetinaNet

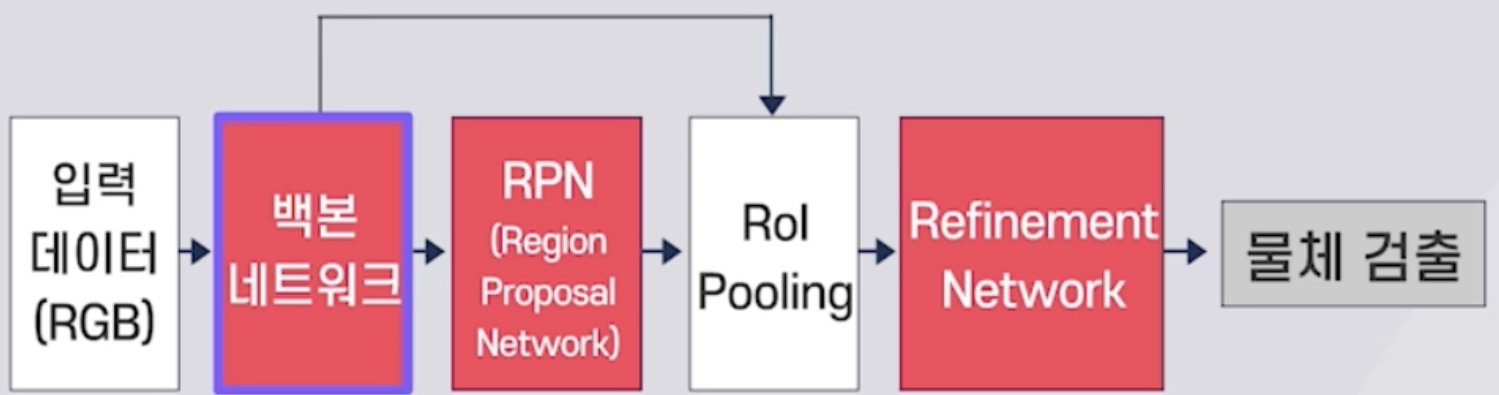

- 2차 검출기

입력 데이터(RGB) -> 특징맵 추출 CNN -> RPN(Region Proposal Network) -> RoI Pooling -> 검출레이어 (Detection Head) -> 물체 검출 결과

RPN에서 물체의 존재 유무를 먼저 판별

RoI Pooling에서 물체가 존재한다고 생각되는 영역의 특징값 추출

2번에 걸쳐 검출

ex) Faster RCNN, Mask R-CNN, Cascade R-CNN

-

백본 네트워크

카메라 영상에서 원하는 특징값 추출

VGGNet, ResNet 등의 CNN 모델 사용

ImageNet 데이터셋으로 미리 훈련된 가중치를 초기값으로 사용 -

RPN

백본 네트워크를 통해 나온 특징맵을 이용해 물체의 존재 유무와 위치 검출

앵커박스를 기준으로 하여 상대 변위 추정 -

RoI Pooling

RPN에서 추출된 박스를 이용하여 백본 네트워크에서 얻은 특징 지도로부터 해당 영역의 특징값 추출 -

Refinement Network

RoI Pooling을 통해 얻은 특징값을 이용해 물체의 정확한 종류 판별 및 위치 추정값 개선

물체 검출 딥러닝 모델의 트레이닝

물체의 바운딩 박스 라벨링이 되어 있는 트레이닝 데이터 이용

손실함수를 최소가 되도록 종단간(end-to-end) 학습 수행

손실함수의 지역적 최소값을 찾아가야 함 Back Propogation 이용

-

Data Augmentation

학습해야 하는 파라미터 수에 비해 데이터의 갯수가 모자랄 때 트레이닝 데이터를 인공적으로 가공해 추가적인 데이터셋 생성

좌우대칭 / 확대 및 축소 / 밝기 조절 / 회전 / 노이즈 추가 -

성능 평가

장답 박스와 출력 박스 사이에 겹치는 면적(IoU: intersection over union)을 기반으로 판별

물체 검출기의 성능을 Mean Average Precision(mAP)를 기준으로 판별

Precision : 물체라고 한 것 중에서 몇 개나 맞았는가?

Recall : 실제로 물체인 것 중에 몇 개나 맞았는가?

Precision - Recall 커브를 적분한 값이 mAP 값이 됨

물체 추적 기술

각 프레임에서 얻은 검출 결과 연결

연결된 검출 결과의 필터링 및 예측

연결된 검출 결과

|

트랙 : 검출 결과를 유지하고 있는 물체의 시간적인 집합

|

필터링 (ex. 칼만필터)

|

다음 프레임 물체 위치 예측

|

다음 프레임 검출 결과 연결

|

시간에 따라 순환

(기존) 딥러닝 기술을 물체 검출에 이용, 칼만 필터 이용

(최근) 딥러닝 기술을 물체 추적에까지 사용해 발전된 연구 성과, 칼만 필터 대신 딥러닝 모델 이용(ex. RNN 시간적 데이터)

검출 결과 연결을 위한 딥러닝 이용

과거 검출 결과와 현재 검출 결과 사이의 유사성 측정

딥뉴럴 네트워크를 통해 유사성의 정도를 판단함

검출결과의 특징값이나 박스좌표를 이용함

T-1 프레임 박스좌표 대비 T 프레임의 상대적 변위 예측

-CNN 특징 지도 사용

-T프레임의 영상을 CNN 통과

-T-1 프레임의 박스 좌표를 기반으로 해당 영역의 특징값 추출

-박스 좌표의 변화 추정

검출 결과 연결(Association)

유사성 판단 CNN 사용

Siamese network

- 두 개의 비슷한 네트워크를 사용해 검출 쌍에 대한 특징값 추출

- 특징값 사이의 유사도, 거리 출력

- 두 개의 유사도를 0과 1사이의 값으로 출력

- 모든 쌍의 유사도를 테이블로 표현

- 헝가리안 알고리즘 적용해 최종적 연결 결과