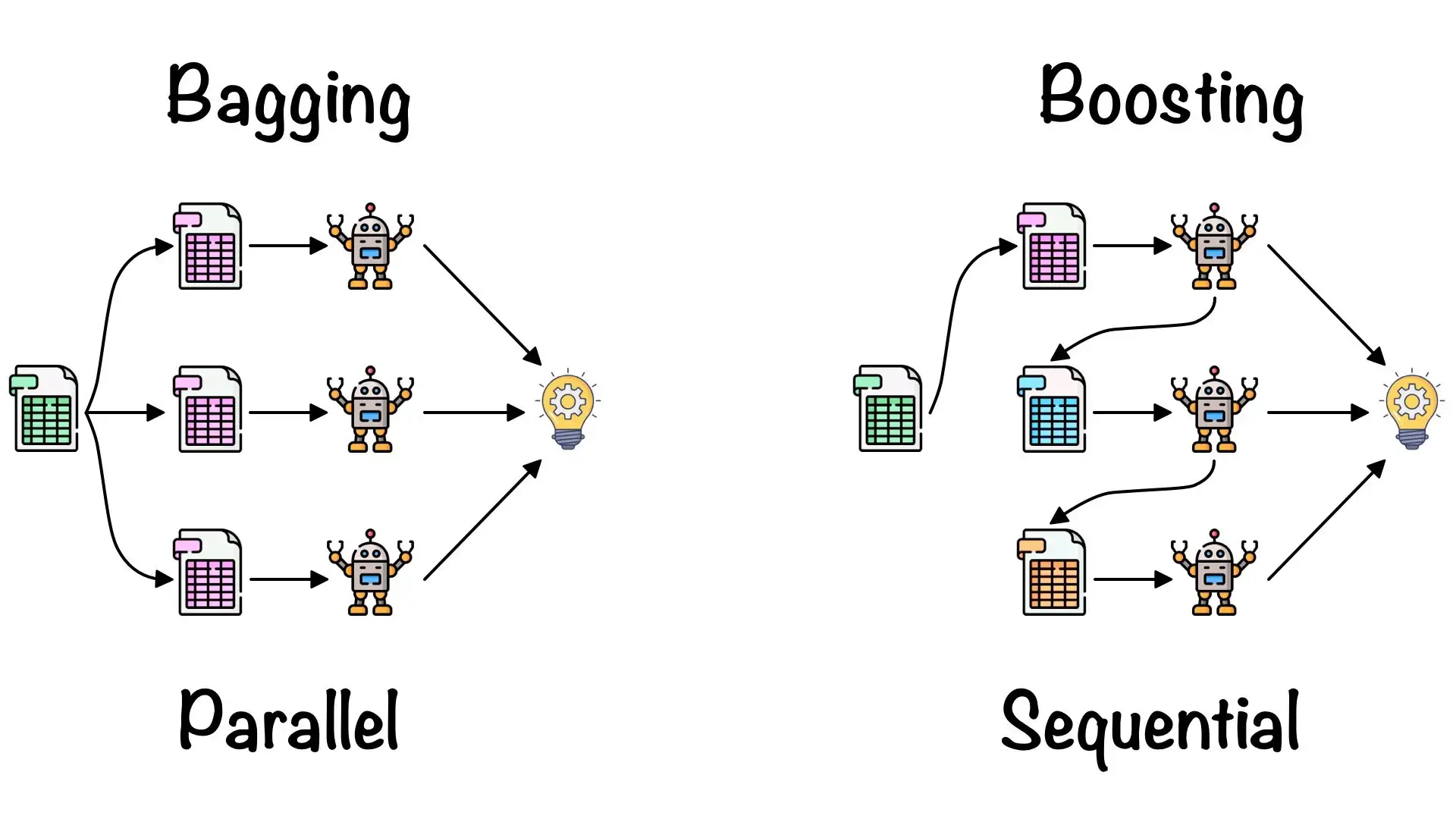

기계 학습 실무자가 편향과 분산 트레이드 오프를 해결하기 위해 활용할 수 있는 앙상블 학습 기반 기술이 몇 가지 있습니다.기술은 배깅 및 부스팅입니다.

배깅(bagging)이란?

배깅(Bagging)은 일련의 동종 기계 학습 알고리즘을 구현하여 오류 학습을 줄이는 것을 목표로 하는 앙상블 학습 기술입니다.

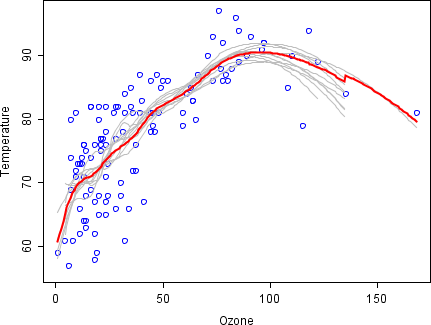

배깅의 핵심 아이디어는 투표 또는 평균화 접근 방식을 통해 보다 안정적이고 정확한 모델을 생성하는 훈련 세트의 무작위 샘플로 개별적으로 훈련되는 여러 기본 학습자를 사용하는 것입니다.

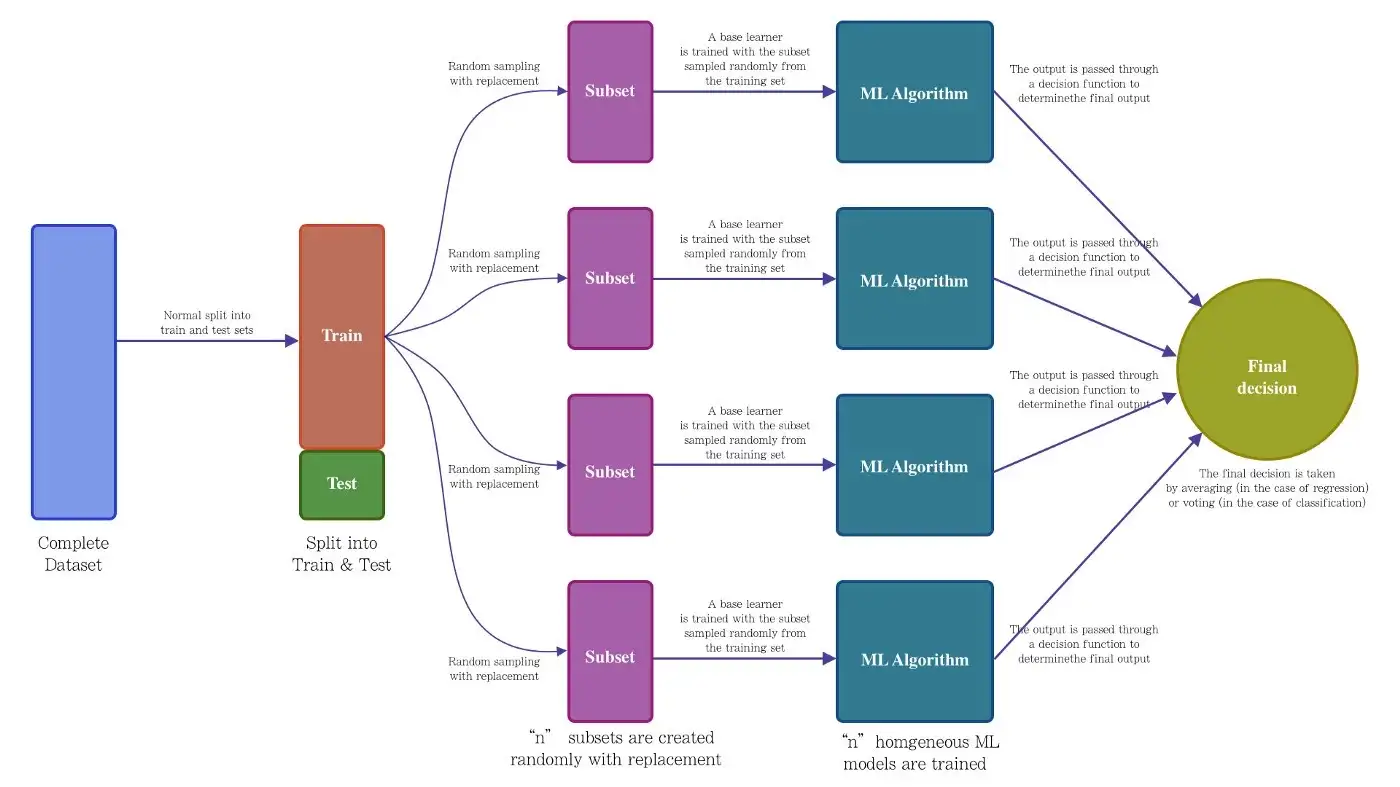

배깅 기술의 주요 두 가지 구성 요소는 교체를 통한 무작위 샘플링(부트스트래핑)과 동종 기계 학습 알고리즘 세트(앙상블 학습)입니다.

배깅 프로세스는 이해하기 매우 쉽습니다.

먼저 훈련 세트에서 "n"개의 하위 집합을 추출한 다음 이러한 하위 집합을 사용하여 동일한 유형의 "n" 기본 학습자를 훈련시킵니다. 예측을 위해 "n"명의 학습자 각각에게 테스트 샘플을 제공하고 각 학습자의 출력을 평균(회귀의 경우)하거나 투표(분류의 경우)합니다.

하위 집합의 수와 하위 집합 당 항목의 수는 사용할 ML 알고리즘 유형과 마찬가지로 ML 문제의 특성에 따라 결정된다는 점에 유의해야 합니다. 배깅을 구현하기 위해 scikit-learn은 이를 쉽게 수행할 수 있는 기능을 제공합니다. 기본 실행의 경우 기본 학습자, 추정기 수 및 하위 집합당 최대 샘플 수와 같은 일부 매개 변수만 제공하면 됩니다.

배깅(Bagging)은 부트스트랩(bootstrap)을 집계(Aggregating)하여 학습 데이터가 충분하지 않더라도 충분한 학습효과를 주어 높은 bias의 underfitting 문제나, 높은 variance로 인한 overfitting 문제를 해결하는데 도움을 줍니다.