MLP

Multi-Layer Percenptron의 약자로 다층 퍼셉트론이라고도 불린다.

지도학습에 사용되는 인공신경망의 한 형태이며, 비선형 은닉계층을 포함하고 있다.

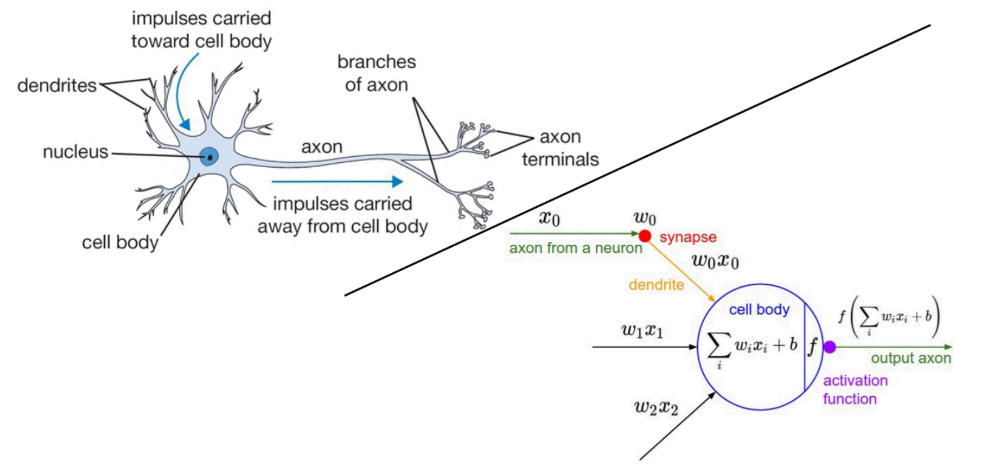

ANN ( 인공 신경망 ) 인간의 뇌에 상호 연결된 뉴런 네트워크 구조와 기능을 모방한 머신러닝 모델이다.

MLP의 특징

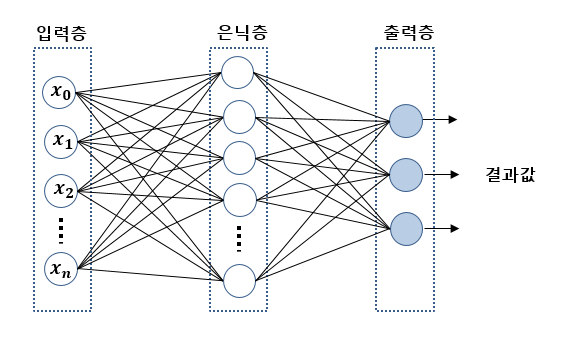

- 다층 구조 - 단순한 입출력만 있는 것이 아닌, 하나 이상의 은닉층을 포함하고 있다.

- 완전연결(Fully connected) - 계층의 모든 노드가 연결되어 있는 구조를 가지고 있다.

- 비선형 활성화 함수 - ReLU나 Sigmoid 같은 함수를 사용하여 복잡한 데이터를 분류, 예측할 수 있게 해준다.

MLP의 구성 요소

입력층

초기 입력 데이터를 받는 뉴런으로 구성. 각각의 뉴런은 입력 데이터의 특징이나 차원을 나타낸다. 입력층의 뉴럭 수는 입력 데이터의 차원성에 의해 결정된다.

은닉층

입력층과 출력 층 사이에는 하나이상의 뉴런 층이 존재할 수 있으며, 은닉층의 각 뉴런은 이전 층에서의 뉴런으로 부터 입력을 받고 출력을 생성한다.

출력 계층

최종 출력을 생성하는 뉴런들로 구성된다. 출력 계층의 뉴런 수는 작업의 목적에 따라 달라진다.

가중치 (weight) / 편향 (bias)

- 가중치 (weight) - 노드에 대한 중요도를 표현하는 것. 입력 데이터 별 비중을 크거나 작게 하여 곱해지는 값을 다르게 한다.

- 편향 (bias) - 노드의 민감도를 조정, 활성화 하는 역할을 한다. 가중치 만으로 세밀한 조정이 되지 않는 경우가 잇다.

Activation Function

입력변수에 가중치와 편향을 고려한 모든 값을 더한 선형결합 값을 비선형으로 변환하는 함수.

Acivation Function은 왜 사용할까?

각각의 계층에서의 출력값과 가중치, 편향의 연산을 통한 선형적인 계산은 복잡한 데이터 사이의 관계를 학습하기에 부족하다. 그래서 비선형적인 형태로 변환하고자 한다.

활성화 함수의 종류

- Sigmoid - 출력을 0과 1사이로 제한한다.

- ReLU - 0보다 작으면 0으로, 0보다 큰 값은 그대로 출력한다.

- Softmax - 출력 값들의 합이 1.00이 되도록 만든다.

Dropout

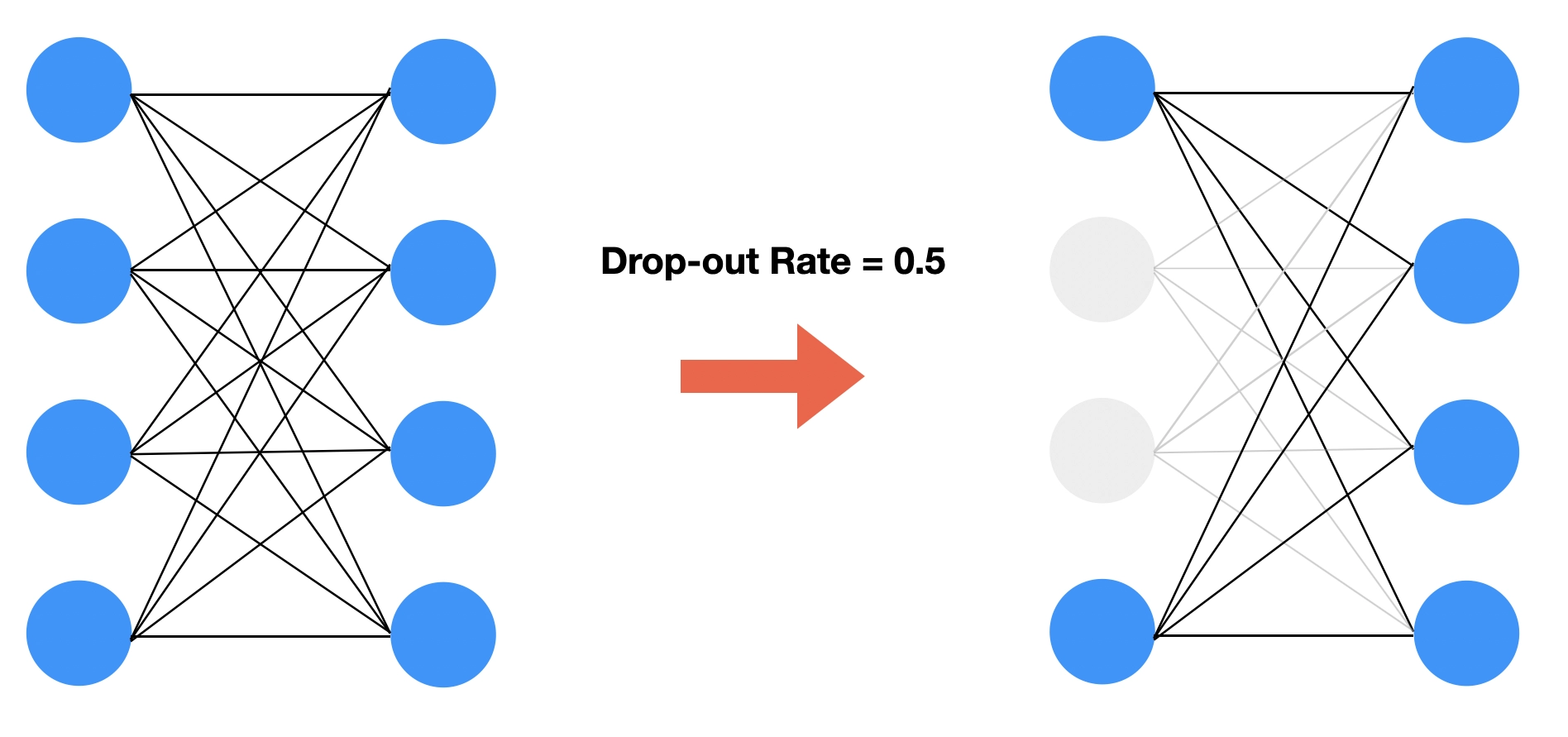

신경망을 훈련시킬 때, 일부 뉴런을 고의적으로 활설화 시키지 않는 방법이다.

위에 그림처럼 Drop-out Rate가 0.5 라면 50%의 뉴런이 활성화 되지 않는다. 4개의 뉴런중 2개의 뉴런이 활성화 되지 않는 모습이다. 이때 활성화 되지않는 뉴런은 랜덤하게 결정된다.

Dropout의 사용목적

결론적으로 Overfitting을 막기 위함이다. 훈련데이터셋에서는 모델의 목적에 맞게 출력값을 제공하지만 훈련데이터셋에만 너무 훈련되어있어 다른 데이터에서는 올바른 출력을 제공하지 못하는 경우이다.

DropOut를 통해 모델의 뉴런이 특정패턴에만 의존하지 못하게 한다.