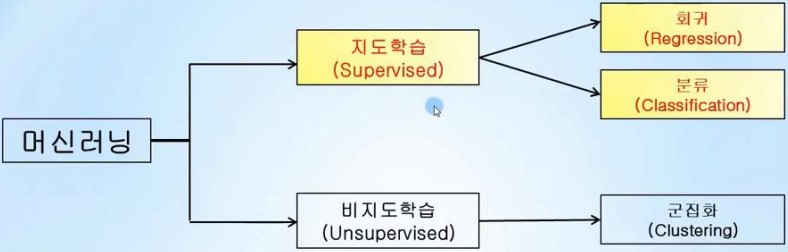

머신러닝 지도 학습

1. Machin Learning Type

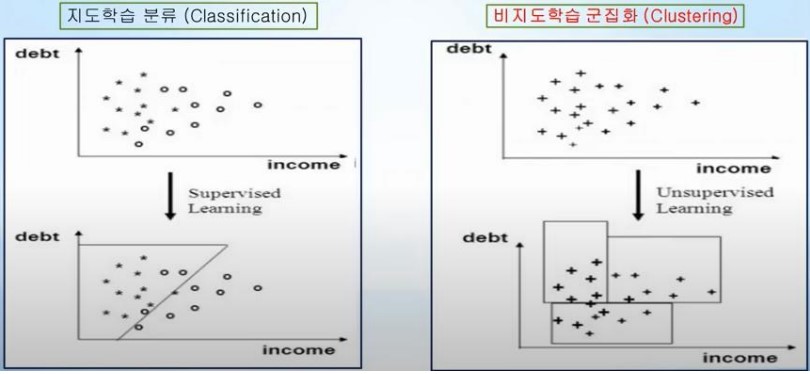

지도학습(Supervised Learning)

비지도학습(Unsupervised Leanrning)

2. Supervised Learning

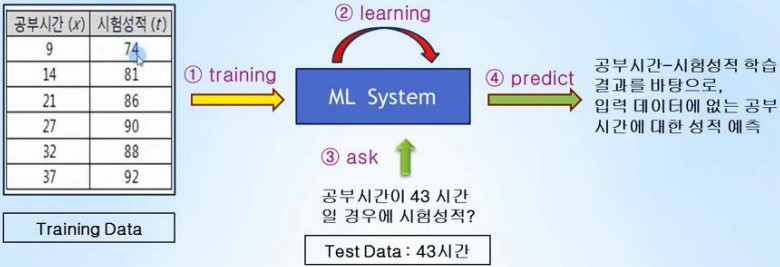

지도학습

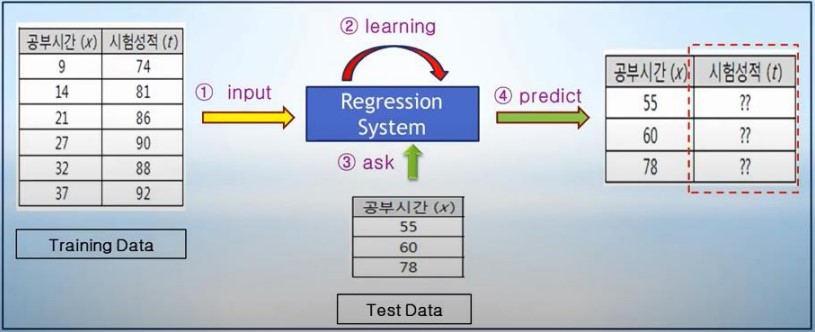

- 입력 값(x)과 정답(t, label)을 포함하는 Training Data를 이용하여 학습을 하고, 그 학습된 결과를 바탕으로 미지의 데이터(Test Data)에 대해 미래 값을 예측 (predict) 하는 방법

-> 대부분의 머신러닝 문제는 지도학습에 해당됨 - 예1 : 시험공부 시간(입력)과 Pass/Fail(정답)을 이용하여 당락 여부를 예측

- 예2 : 집 평수(입력)와 가격 데이터(정답)을 이용하여 임의의 평수 가격 예측

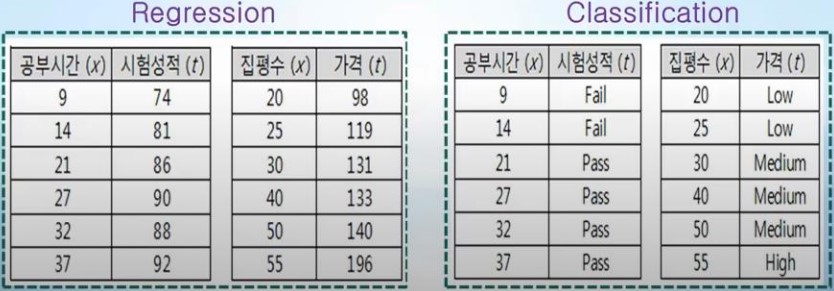

Regression, Classification

회귀(Regression)

- Training Data를 이용하여 연속적인(숫자) 값을 예측하는 것을 의미, 집 평수와 가격 관계, 공부 시간과 시험 성적 등의 관계

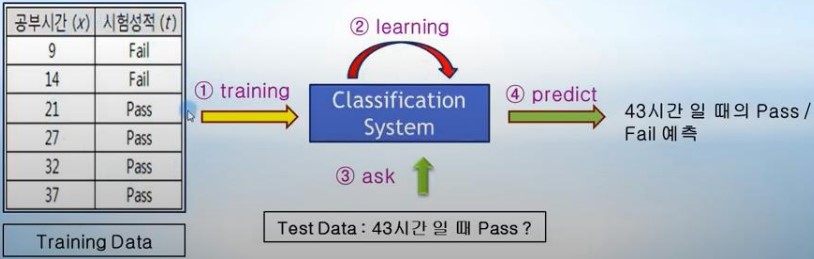

분류(Classification)

- Training Data를 이용하여 주어진 입력 값이 어떤 종류 값인지 구별하는 것

3. Unsupervised Learning

비지도 학습

- 트레이닝 데이터에 정답은 없고 입력 데이터만 있기 때문에, 입력에 대한 정답을 찾는 것이 아닌 입력데이터의 패턴, 특성 등을 학습을 통해 발견하는 방법

- 예 : 군집화(Clustering) 알고리즘을 이용한 뉴스 그룹핑, 백화점의 상품 추천 시스템 등

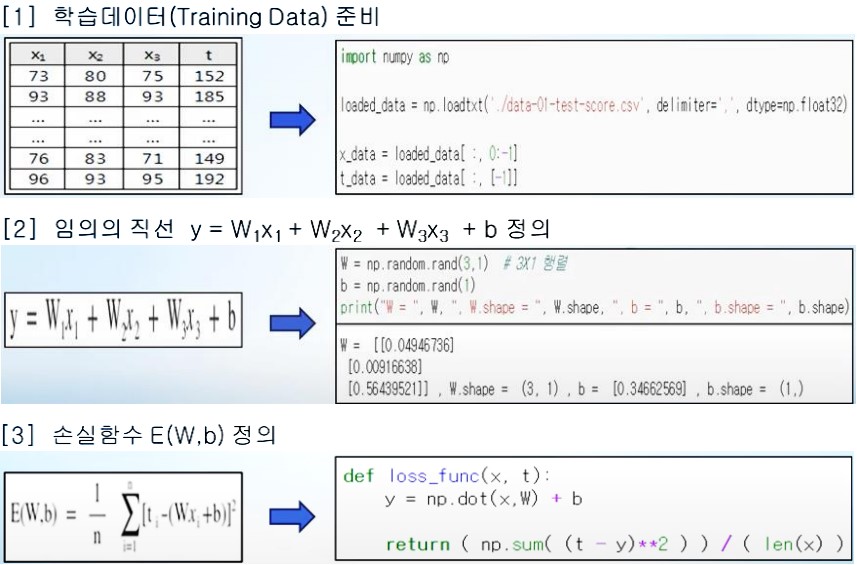

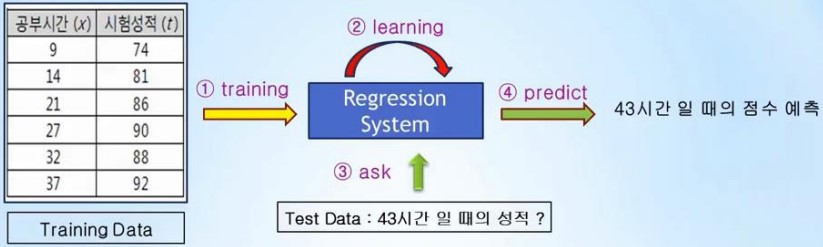

4. Linear Regression

회귀(Regression)

- Training Data를 이용하여 데이터의 특성과 상관관계 등을 파악하고, 그 결과를 바탕으로 Training Data에 없는 미지의 데이터가 주어졌을 경우에, 그 결과를 연속적인 (숫자) 값으로 예측하는 것

- 예: 공부 시간과 시험성적 관계, 집 평수와 집 가격 관계 등

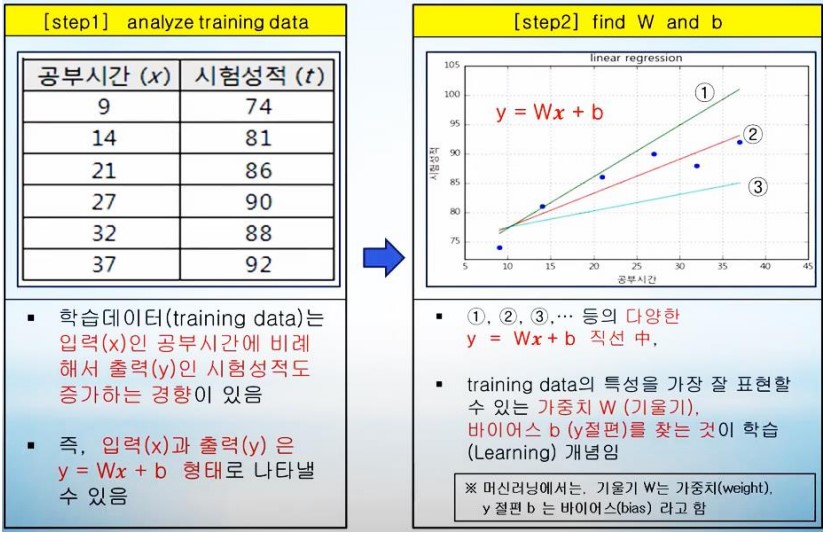

Regression - 학습(learning) 개념

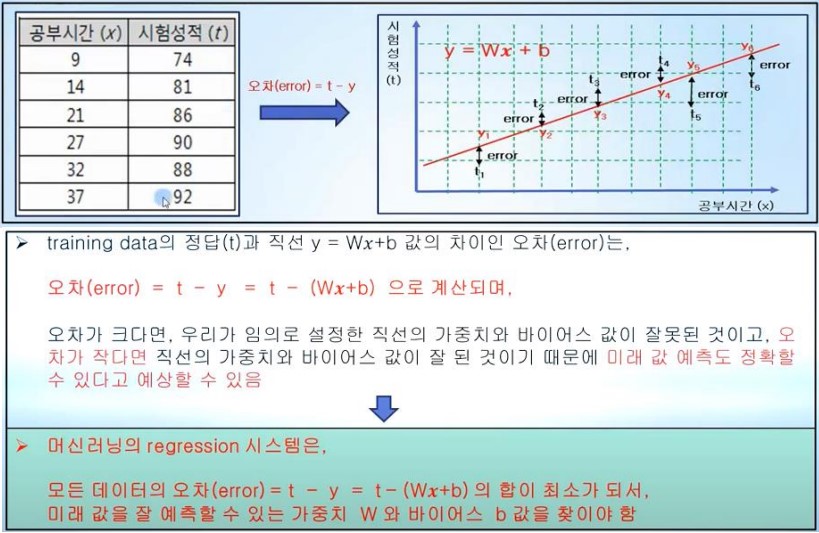

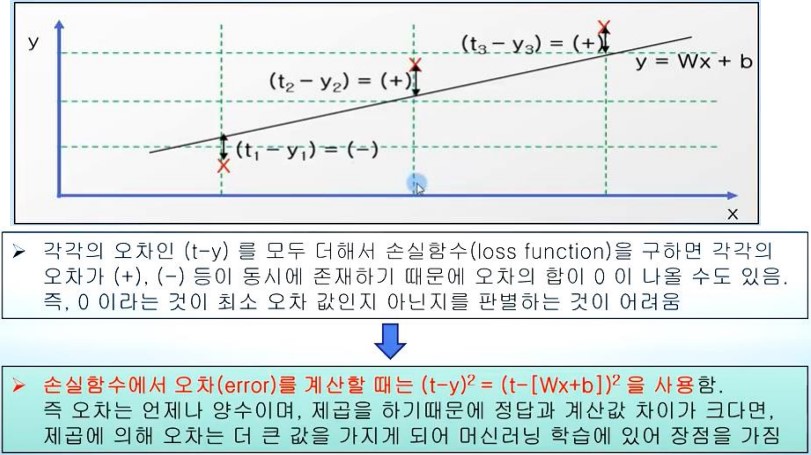

Regression – 오차(error), 가중치(weight)W, 바이어스(bias) b

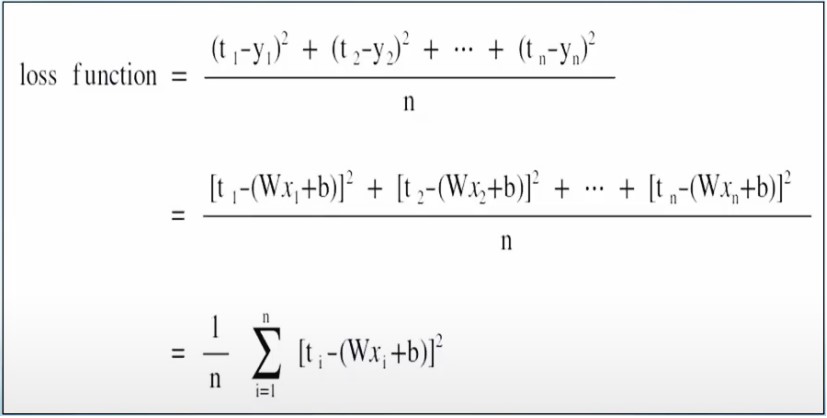

손실함수(loss function, cost function)

- Training data의 정답(t)과 입력(x)에 대한 계산 값 y의 차이를 모두 더해 수식으로 나타낸 것

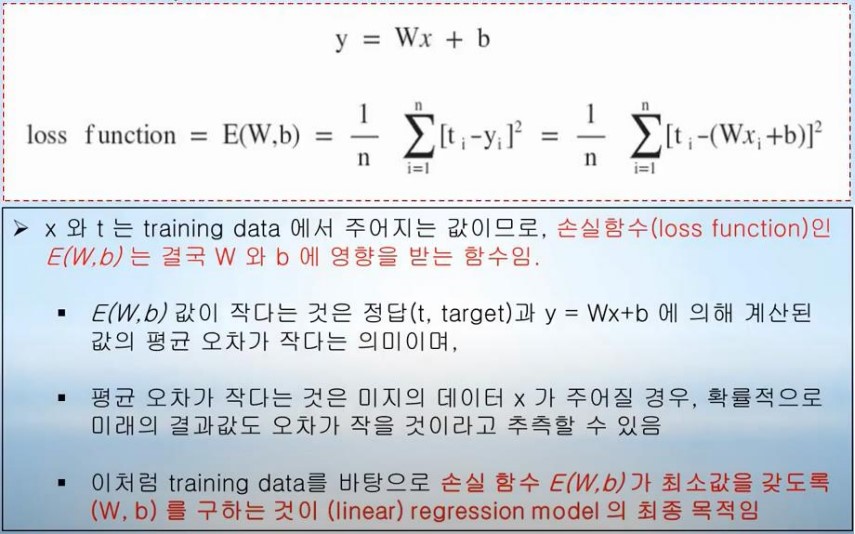

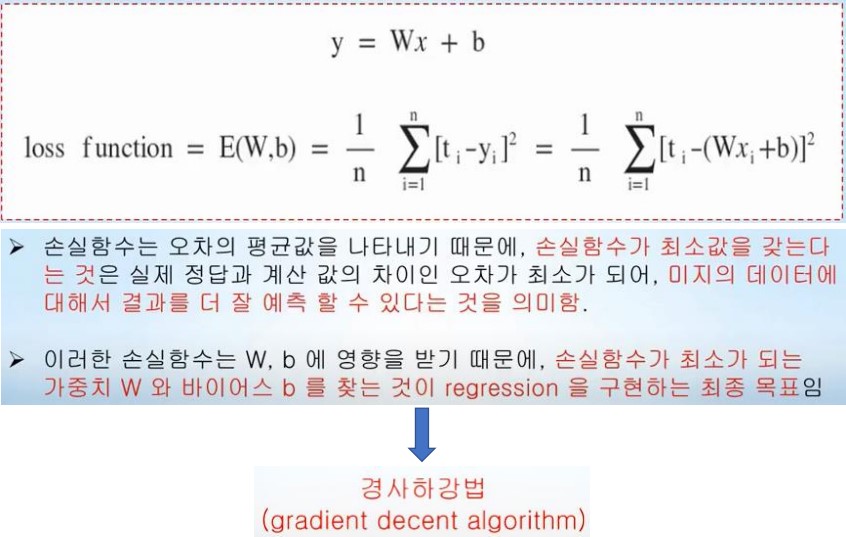

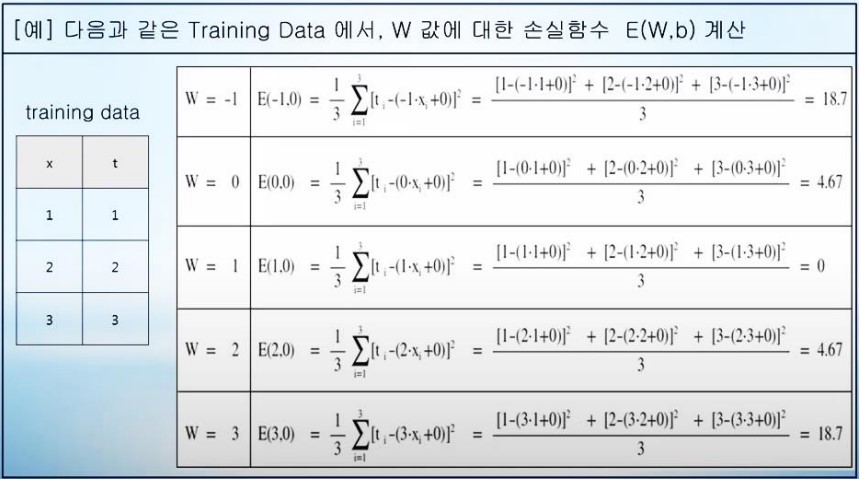

gradient decent algorithm - review loss function E(W,b)

gradient decent algorithm - 손실함수(loss function) 계산

- 계산을 쉽게 하고 손실함수의 모양 파악을 위해 E(W,b)에서 b=0으로 가정

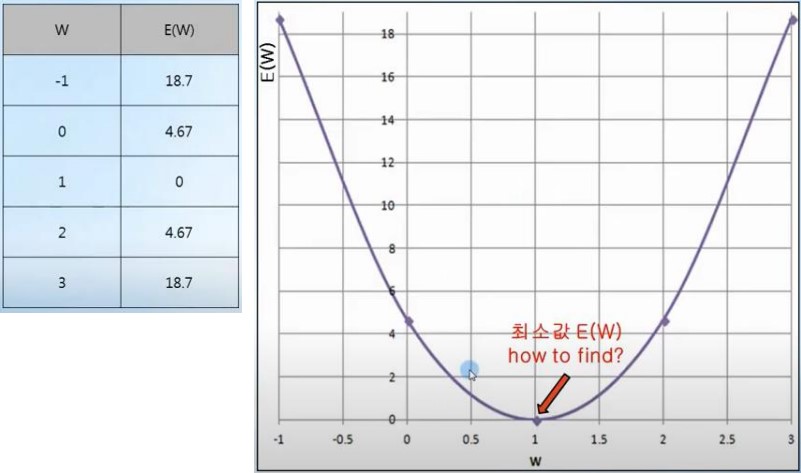

gradient decent algorithm - 손실함수(loss function) 형태

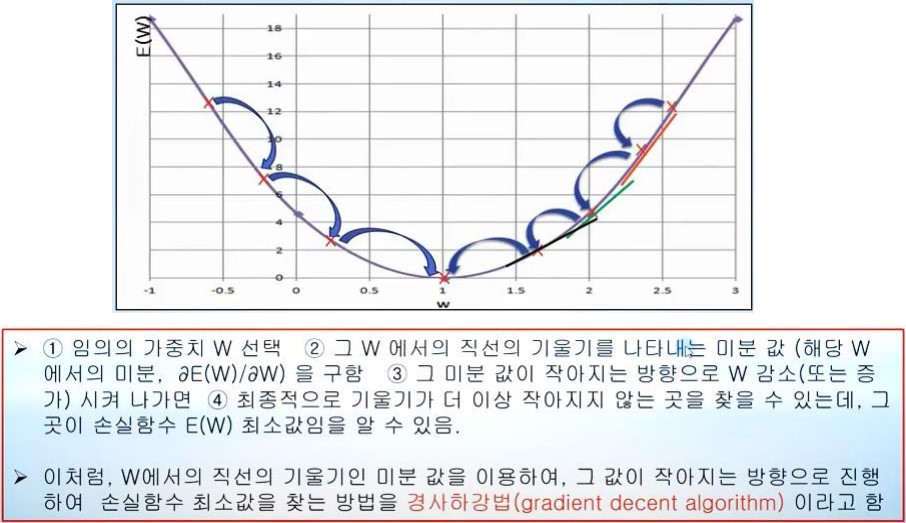

gradient decent algorithm - 경사하강법 원리

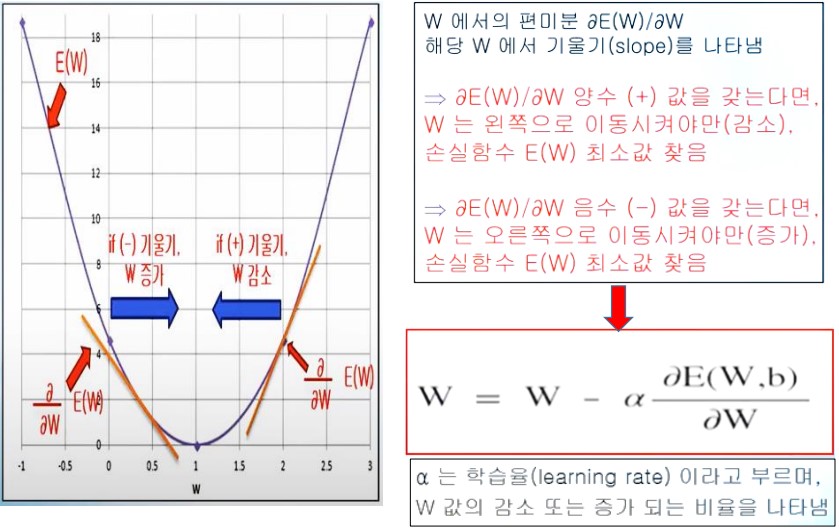

gradient decent algorithm - W 값 구하기

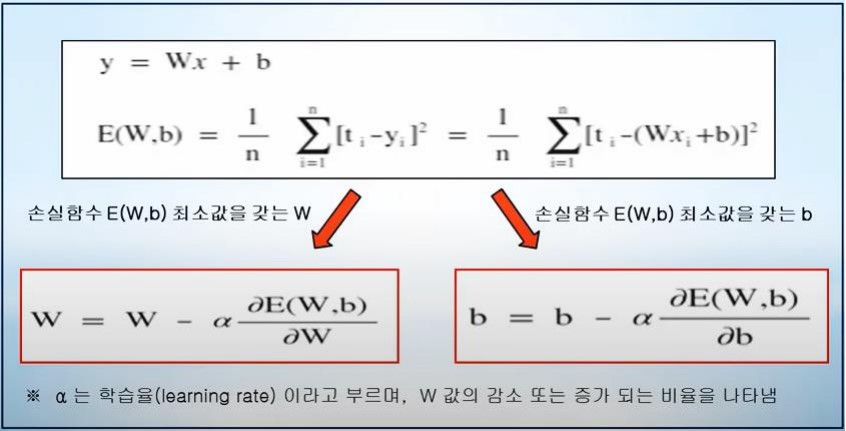

gradient decent algorithm - 손실함수 E(W,b) 최소 값이 되는 W,b

- Linear regression 목표 : Training data 특성/분포를 가장 잘 나타내는 임의의 직선

y = Wx + b에서의 [W, b] 를 구하는 것

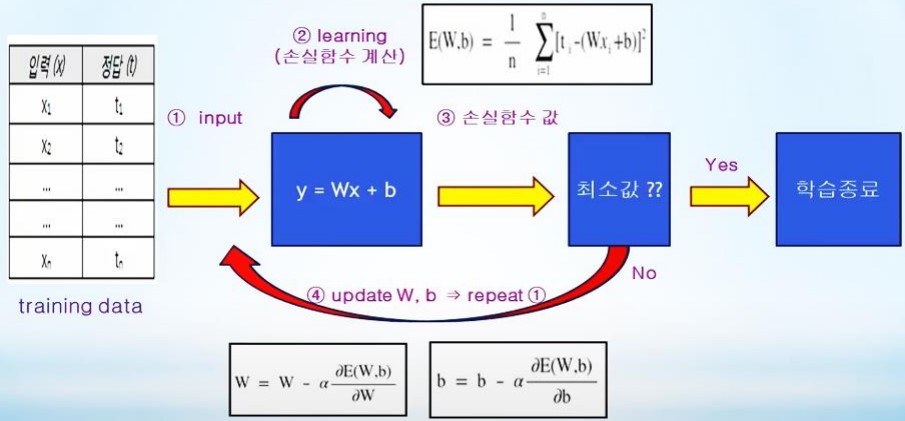

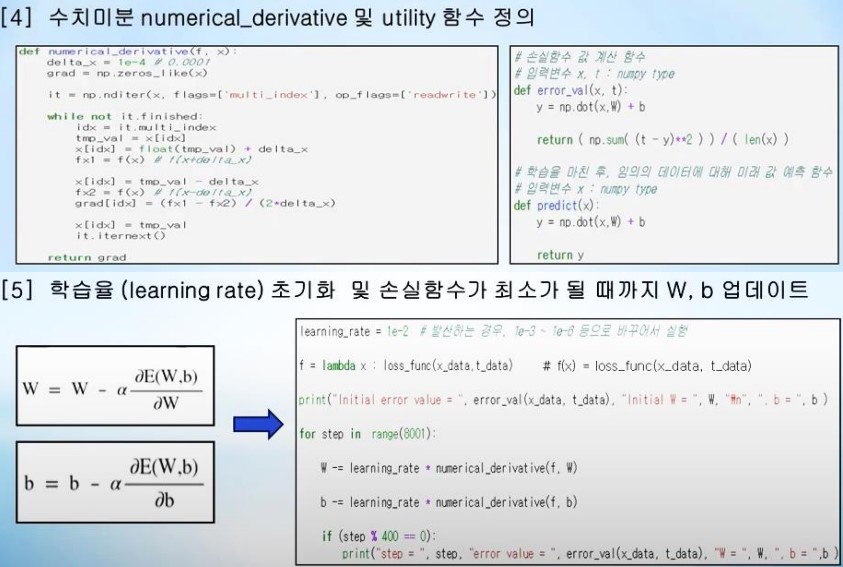

gradient decent algorithm - 최적의 [W, b] 계산 프로세스

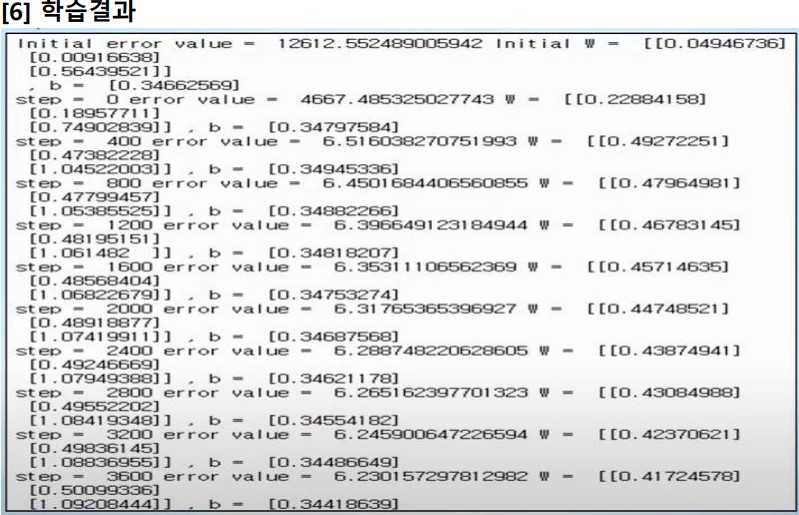

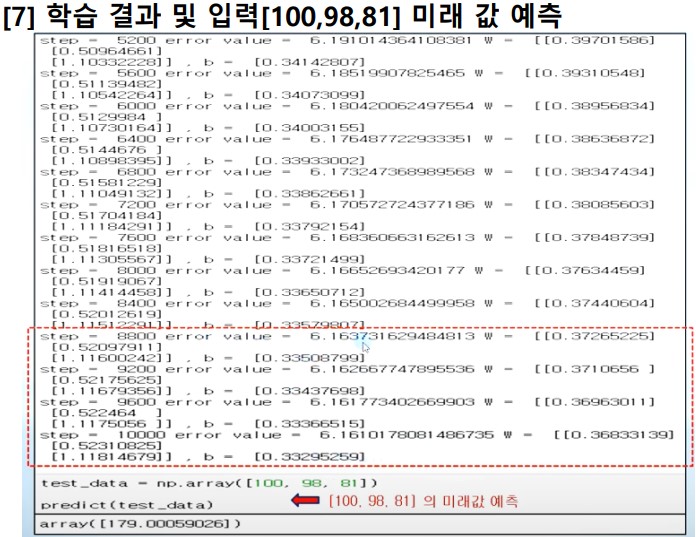

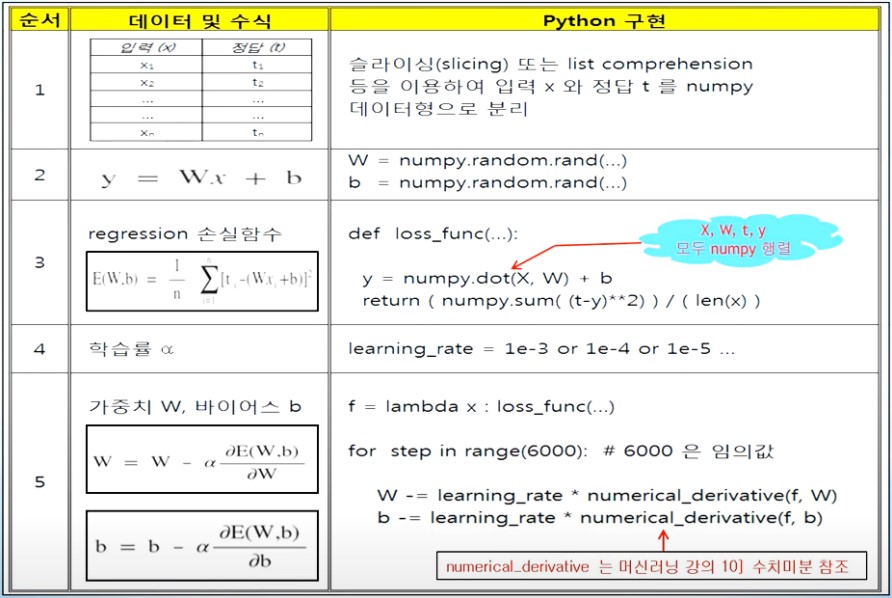

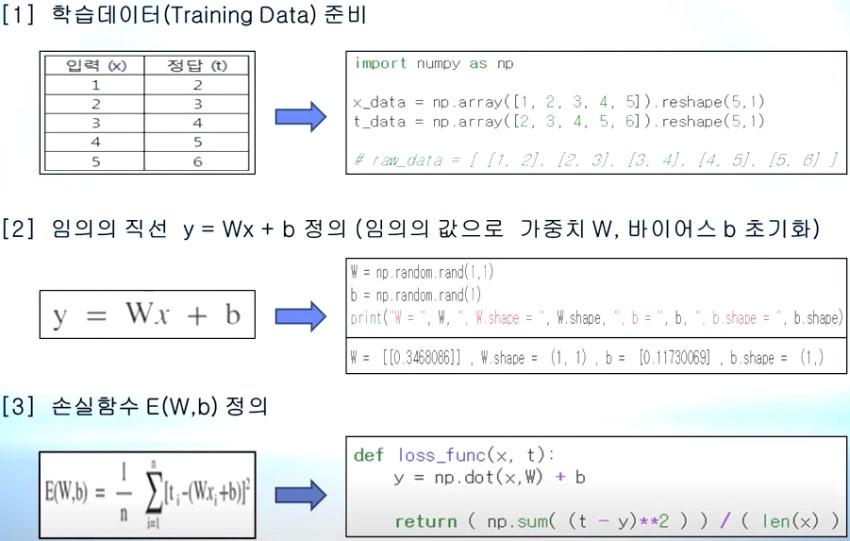

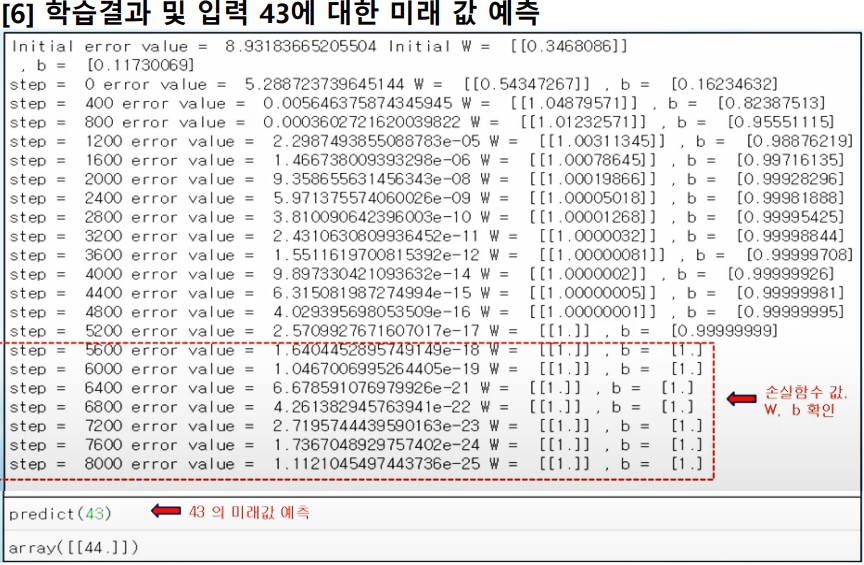

Linear regression implementation using python

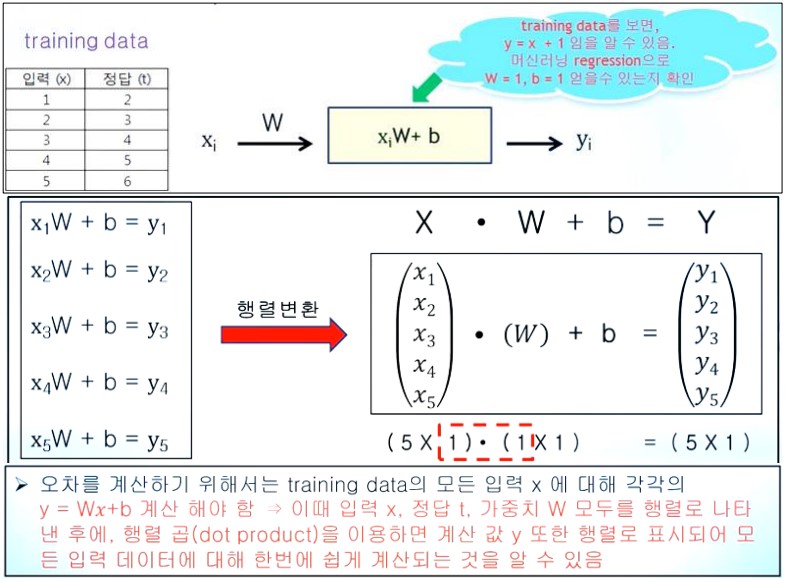

Simple regression - concept

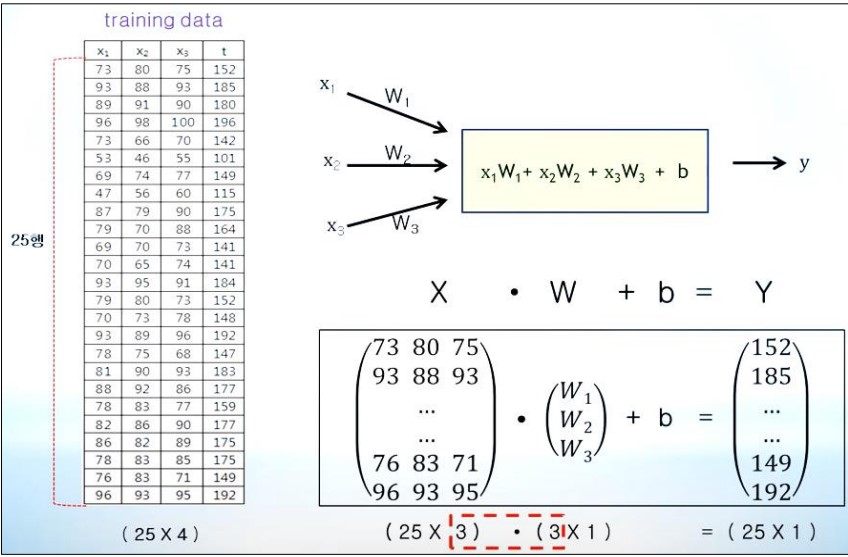

Multi-variable regression - concept

Multi-variable regression - example