PAPER REVEIW : Structural and Statistical Texture Knowledge Distillation for Semantic Segmentation

Introduction

본 논문은 Semantic Segmentation 분야의 Knowledge Distillation의 새로운 방법론을 소개한 논문이다. Semantic Segmentation 분야에서의 제안되었던 KD 방법론들은 대부분 high level에 있는 contextual knowledge에 초점을 맞춰서 지식 전이를 진행했다면 이 논문은 low level에 있는 texture knowledge에 집중하여 지식 전이를 한 논문이다. low level texture knowledge 또한 local structural의 특징을 알아내는데 중요한 요소로 작용한다. 경계선, 스무딩, 색조 대비 등과 같은 요소들은 high level에서 다룰 수 없는 요소들이다.

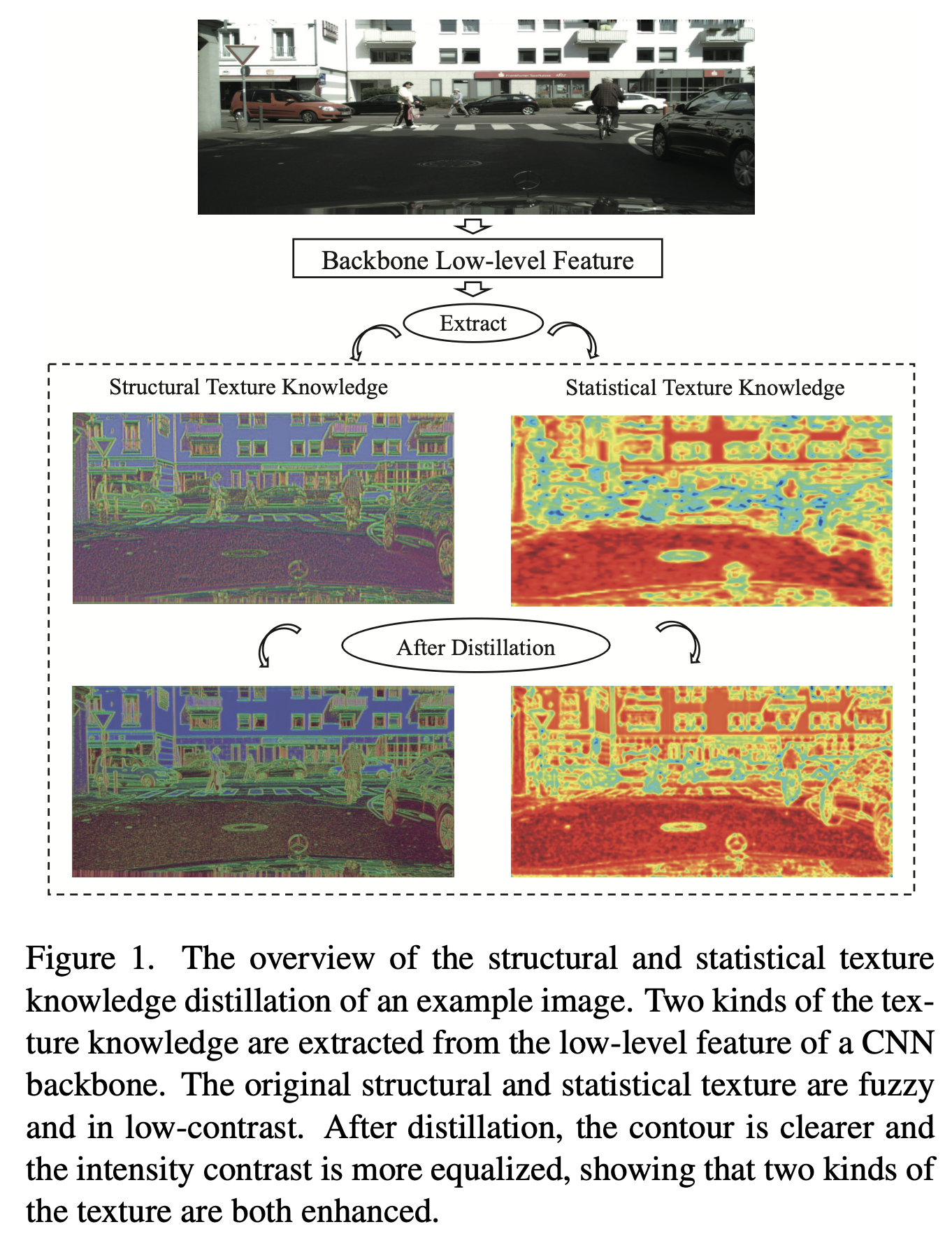

본 논문에서 Structural and Statistical Texture Knowledge Distllation (SSTKD) 라는 프레임워크를 제안한다. Structural Texture Knowledge와 Statistical Texture Knowledge 두 종류의 knowledge를 추출하여 distillation 한다. Structural Texture Knowledge란 low level에서 얻을 수 있는 knowledge로 local feature라고 생각하면 쉽다. 엣지, 스무딩과 같은 요소들이 속할 수 있다. Statistical Texture Knowledge는 feature intensity가 이에 속하는데 이는 네트워크가 어느 곳에 보다 attention하고 있는지를 담고 있는 정보라고 생각하면 좋을 것 같다.

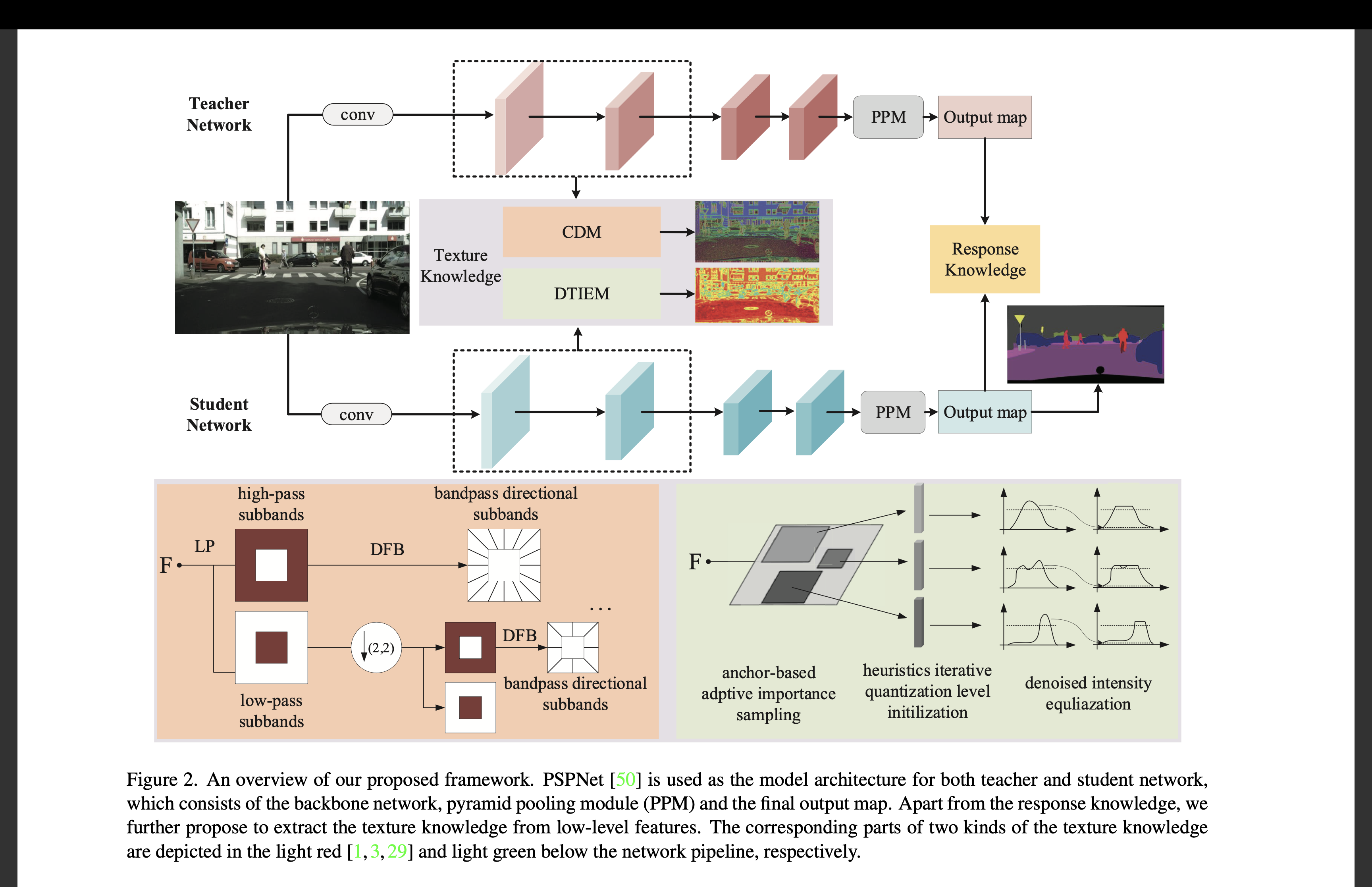

Structural Texture Knowledge를 위해서 Contourlet Decomposition Module (CDM)을 도입하였으며 Statistical Texture Knowledge를 위해서 Denoised Texture Intensity Equalization Module (DTIEM)를 도입하였다. CDM은 Laplacian Pyramid와 Directional Filter Bank를 이용하여 low-level feature를 분해해 structural knowledge를 추출한다. DTIEM은 Anchor-Based Adaptive Importance Sampler를 이용하여 feature intensity의 불균형을 해결하는 방향으로 statistical knowledge를 추출한다.

위의 Figure 1과 같이 input image가 들어오면 low-level feature를 추출하여 Structural Texture Knowledge와 Statistical Texture Knowledge를 뽑아내 Distillation을 진행한다.

Method

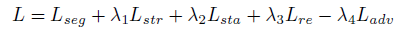

Figure 2는 전반적인 SSTKD의 프레임워크를 보여준다. input image가 교사와 학생 네트워크에 들어가 convolution layer에서의 feature를 뽑아낸다. 그 feature map을 CDM과 DTIEM을 통과시켜 structural과 statistical texture knowledge를 추출하여 학생 네트워크가 교사 네트워크를 닮아가도록 한다. Output이 나오기전 Pyramid Pooling Moudle (PPM)을 통과하게 되는데 이 과정은 다양한 Pooling layer를 이용하여 다양한 scale에 대한 정보를 얻게된다. 그 후 교사 네트워크와 학생 네트워크의 output간 KL Divergence를 이용해 기본적인 Knowledge Distillation 방법론을 적용한다. 마지막으로는 Adversarial Learning을 이용하여 holistic distillation 문제를 해결한다. 최종적으로 나타나게 되는 loss는 다음과 같다.

Experiments

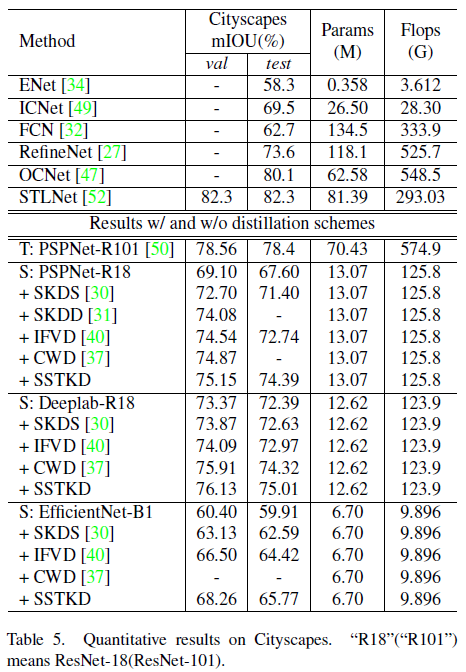

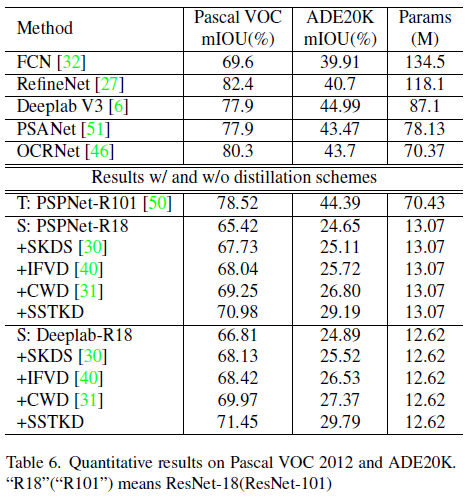

본 논문에서는 교사 네트워크로 ResNet101을 백본으로 하는 PSPNet을 이용하였고 학생 네트워크로는 ResNet18, EfficientNet-B1을 백본으로 하는 PSPNet을 이용하였다. 학습에 이용한 데이터셋으로는 Cityscapes, ADE20K, Pascal VOC를 이용하였다.

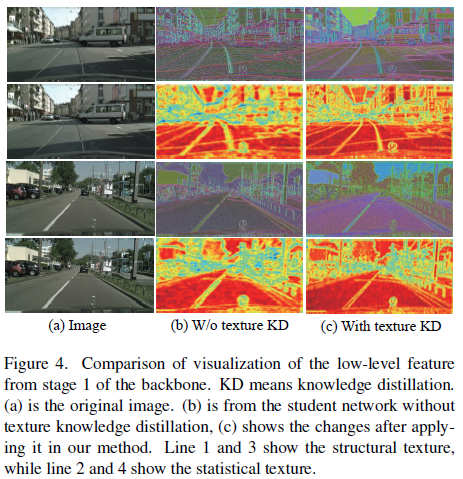

Figure 4에서 확인할 수 있듯 네트워크가 학습을 진행할 때 교사 네트워크로부터 Texture information을 받아오는지에 대한 효과가 극명하게 나타나는 것을 확인할 수 있다. Texture Knowledge Distillation을 진행함으로써 명확하게 물체들의 edge들을 명확하게 표현하여 전반적인 디테일이 살아나는 것을 확인할 수 있다.

위의 두개의 표를 통해 SSTKD 방식이 여러가지 데이터셋에서 효과적인 결과를 도출해냈음을 확인할 수 있다.

Conclusion

본 논문은 low-level의 structural, statistical한 정보들을 Knowledge Distillation에 이용하였다. 또한 Contourlet Decomposition Moudle을 도입하여 structural texture knowledge를 보다 효과적으로 뽑아낼 수 있었다.