Supervised Learning(지도학습) 유형중에 Regression(회귀 분석)에 대해 알아보자

Regression(회귀)

❔ Regression(회귀)

회귀 분석은 어떠한 변수에 영향을 받는 결과가

연속적인 경우에 사용한다. 어떤 데이터들이 크거나 작더라도, 새로운 표본을 뽑았을 때평균으로 돌아가려는 특징이 있기 때문에 붙은 이름이다. 회귀(回歸 돌 회, 돌아갈 귀)

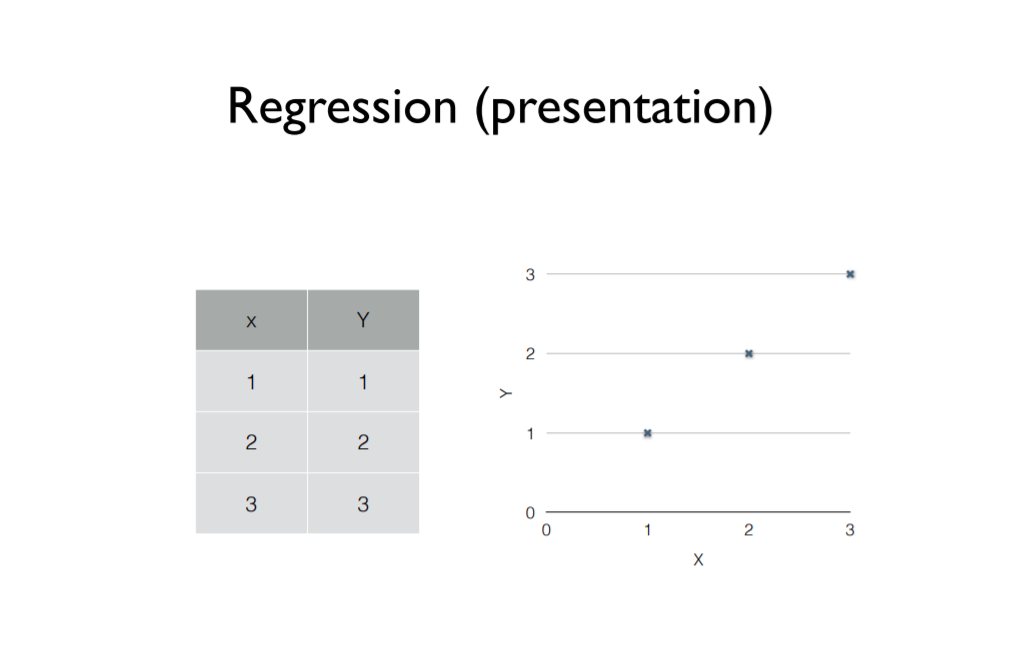

다음은 시험 공부에 투자한 시간과 실제 획득한 성적을 담고 있는 training set(트레이닝 세트)이다.

이 traing set으로 학습한 회귀 분석을 사용했다면 시험공부에 7시간 투자한(x=7) 학생은 시험 성적을 대략 65점(y=65)으로 예측할 수 있다.

Linear Regression(선형 회귀)

❔ Linear Regression(선형 회귀)

데이터들을 1차원 직선 방정식을 통해 표현되지 않은 데이터를 예측하기 위한 모델로, xy축 좌표계에 직선으로 정리한것으로 보면 된다.

Hypothesis(가설)

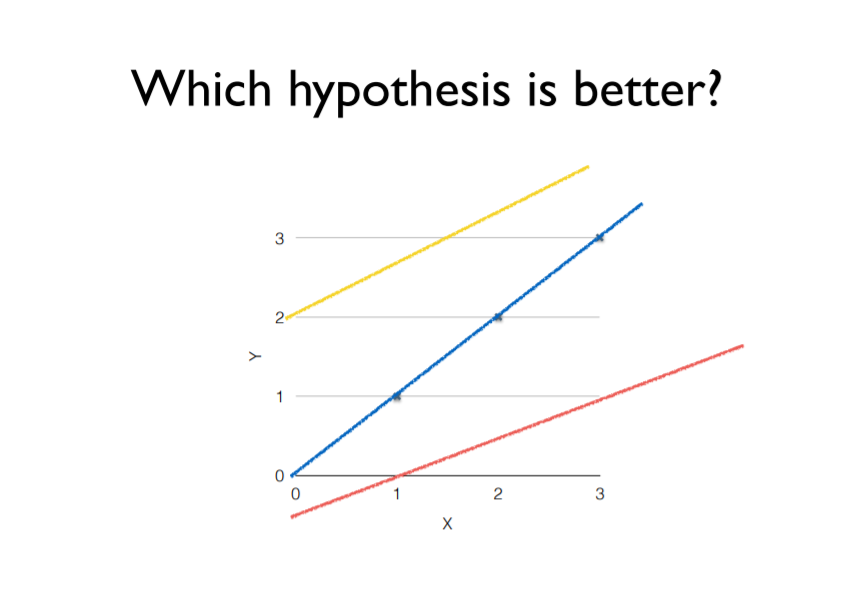

Rrgression모델을 학습하기 위해서는 (데이터는 잘 모르겠지만 이정도로는 맞을것이다 하는) 하나의 가설을 세울 필요가 있다.

Linear하다는 것은 선형을 의미하므로 어떤 선형을 가지는지를 찾는 것을 말한다.

① 대략 H(x)=Wx+b와 같은 일차 방정식으로 나올것이라고 가설을 한다. (파란선)

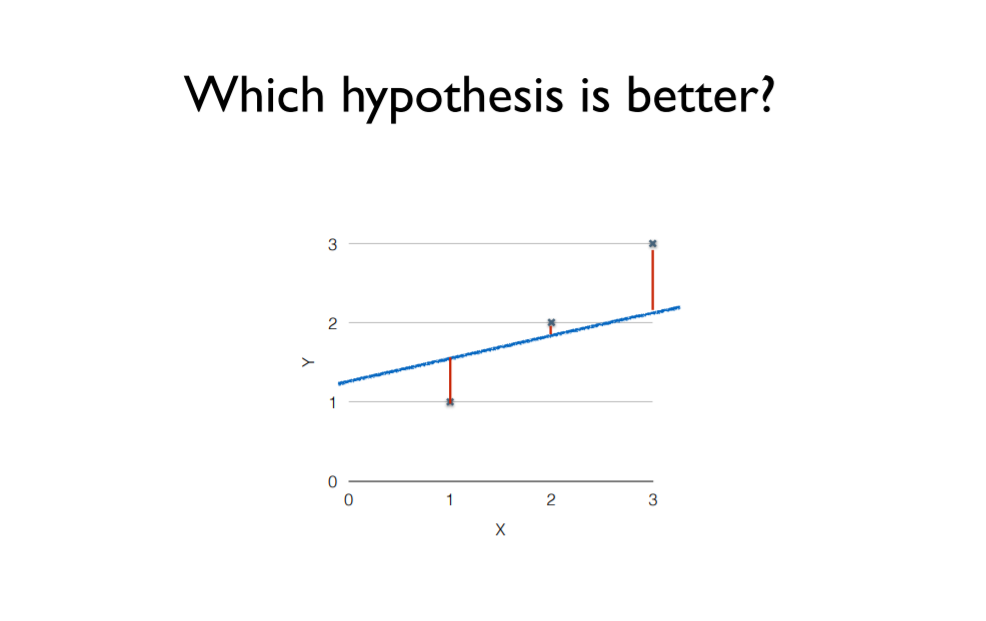

② 나타난 선들 중에서 어떤 선이 가지고 있는 데이터와 가장 잘 맞는 선일지, 어떤 것이 가장 적합한 가설인지를 알 수 있어야 한다.

빨간색 선은 데이터와 가설함수의 차이를 나타낸다.

파란선을 기준으로 거리가 멀수록 안좋은 가설이고 가까울수록 졸은 가설이다.

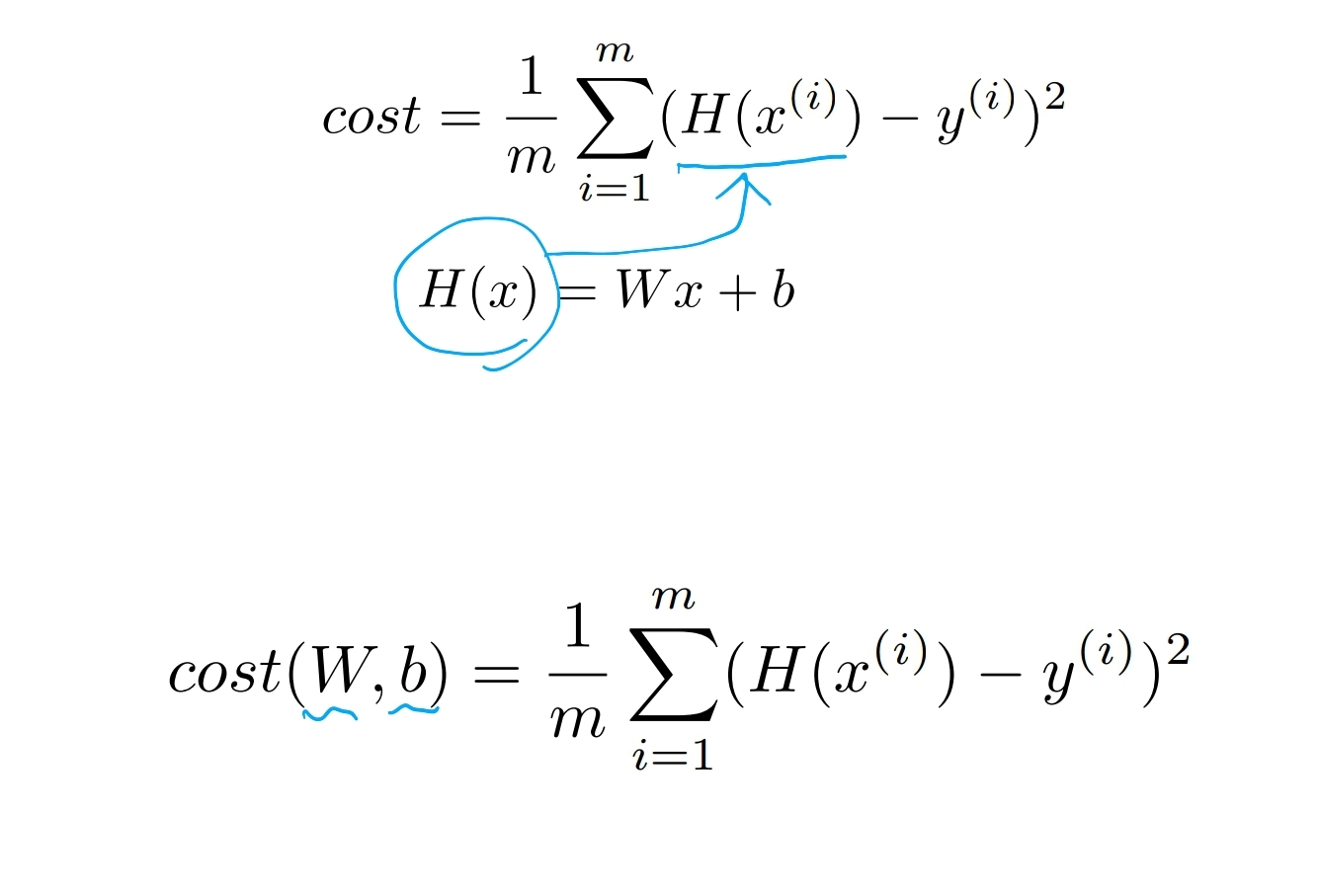

Cost Function(비용 함수)

❔Cost Function(비용 함수)

Loss Function(손실 함수)이라고도 한다.

우리가 세운가설과 실제 데이터가 얼마나 다른가를 나타내는 것이다.

Hypothesis방정식에 대한 비용으로 방정식의 결과가 크게 나오면 좋이 않다고 얘기할 수 있다.

Cost Function 수식

가장 작은 값을 가지는 W와 b를 구하는 것이 바로 Linear Regulatation의 학습이다.