Logistic Regression(로지스틱 회귀)

❔ Logistic Regression(로지스틱 회귀)

회귀를 사용해 데이터가 어떤 범주에 속할 확률을 0에서 1사이의 값으로 예측하고,

그 확률에 따라 가능성이 더 높은 범주에 속하는 것으로 분류해주는 지도 학습 알고리즘이다.

둘 중 하나를 결정하는 문제를 이진분류(Binary Classsification)이라고 한다.

이런 문제를 풀기 위한 대표적인 알고리즘으로 로지스틱 회귀(Logistic Regression)가 있다.

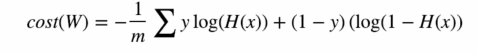

Cost function(비용 함수)

❔ Cost function(비용 함수)

예측하는 값과 실제 결과값의 차이를 나타내는 함수이다.

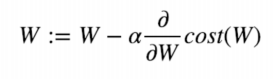

✔ 로지스틱 회귀(Logistic Regression)또한 경사 하강법을 사용하여 가중치W를 찾아내지만, 비용 함수(Cost function)로는 평균 제곱 오차를 사용하지 않는다.

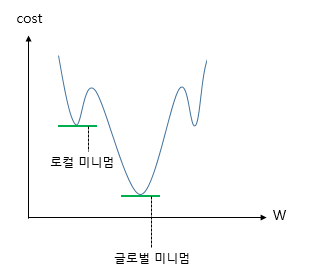

그 이유는 시그모이드 함수에 비용함수를 평균 제곱 오차로 하여 그래프를 그리면 다음과 비슷한 형태가 된다.

로지스틱 회귀에서 평균 제곱 오차를 비용 함수로 사용하면, 경사 하강법을 사용하였을때 자칫 잘못하면 찾고자 하는 최소값이 아닌 잘못된 최소값에 빠진다. 이를 전체 함수에 걸쳐 최소값인 글로벌 미니멈(Global Minimum)이 아닌 특정 구역에서의 최소값인 로컬 미니멈(Local Minimum)에 도달했다고 한다. 이는 cost가 최소가 되는 가중치 W를 찾는다는 비용 함수의 목적에 맞지 않다.

✔ 제일 적절한 예측을 하는 가설은 바로 cost function이 최소가 되는 가설일 것이다.

수식