Multivariate Linear Regression(다중 선형 회귀)

❔Multivariate Linear Regression(다중 선형 회귀)

x가 1개인 선형 회귀를단순 선형 회귀(Simple Linear Regression)이라고 하고,

다수의 x로 부터 y를 예측하는 것을다중 선형 회귀(Multivariable Linear Regression)라도 한다.

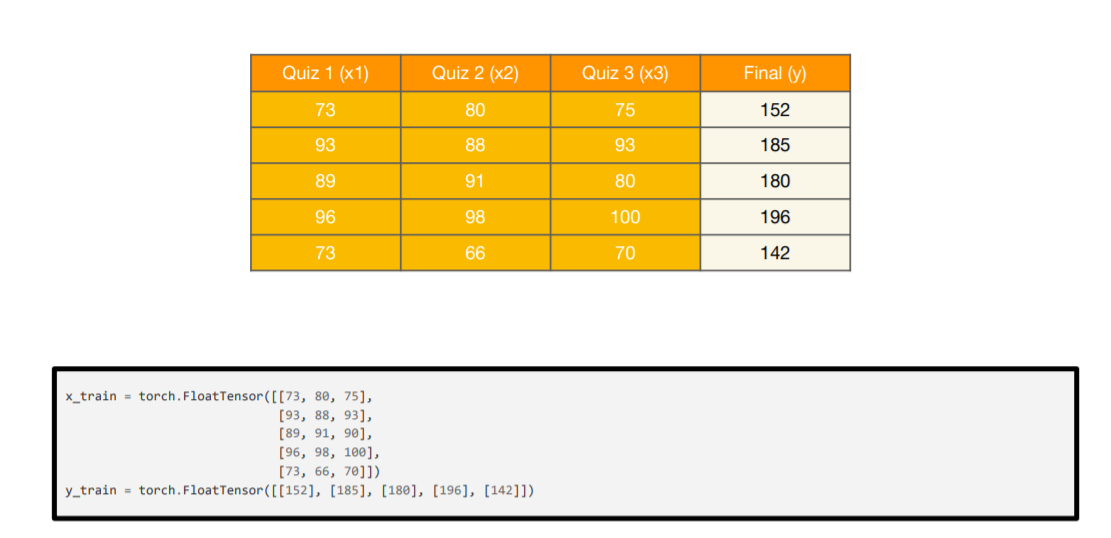

Data

x=3

3개의 퀴즈 점수로 부터 최종 점수를 예측하는 모델을 만들어보자

표로 나타내면 아래와 같다

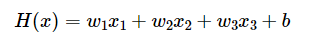

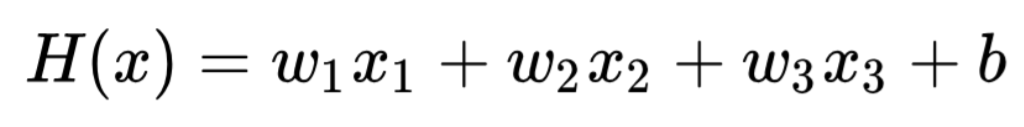

이를 수식으로 나타내면

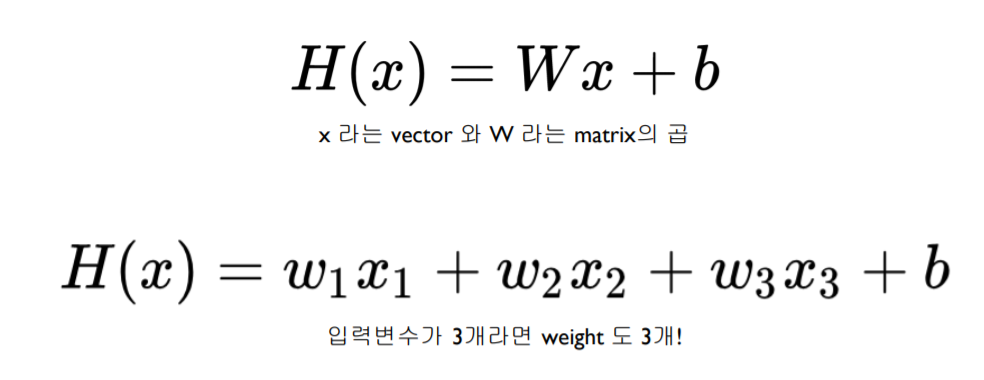

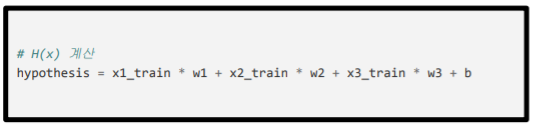

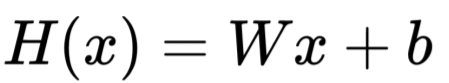

Hypothesis Function(가설 함수)

1.x가 길이 1000의 vector이라면?

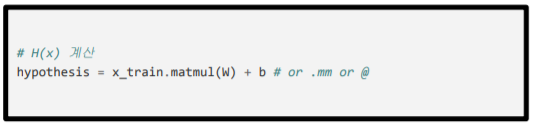

2. matmul()로 한번에 계산

1) 더 간결하고,

2) x의 길이라 바뀌어도 코드를 바꿀 필요가 없고

3) 속도도 더 빠르다

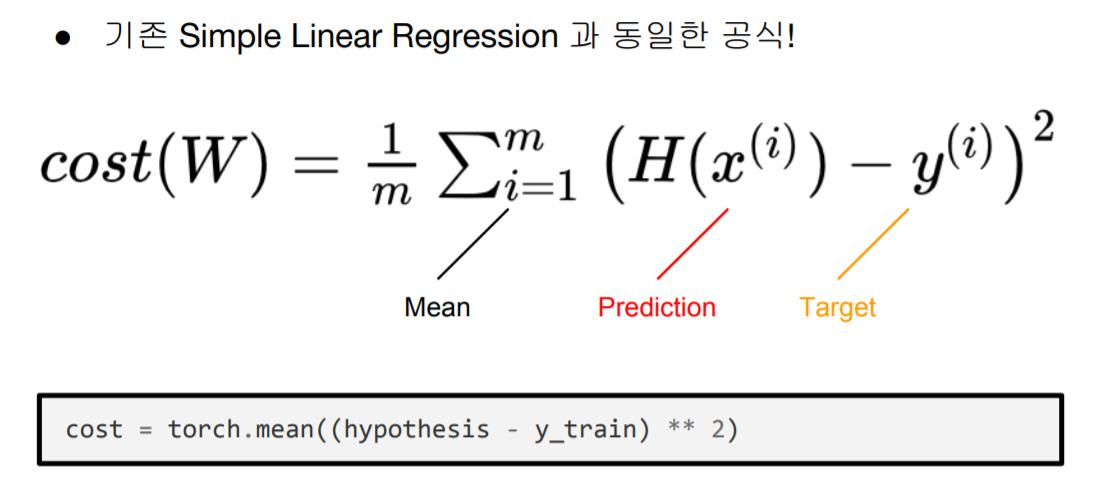

Cost Function:MSE

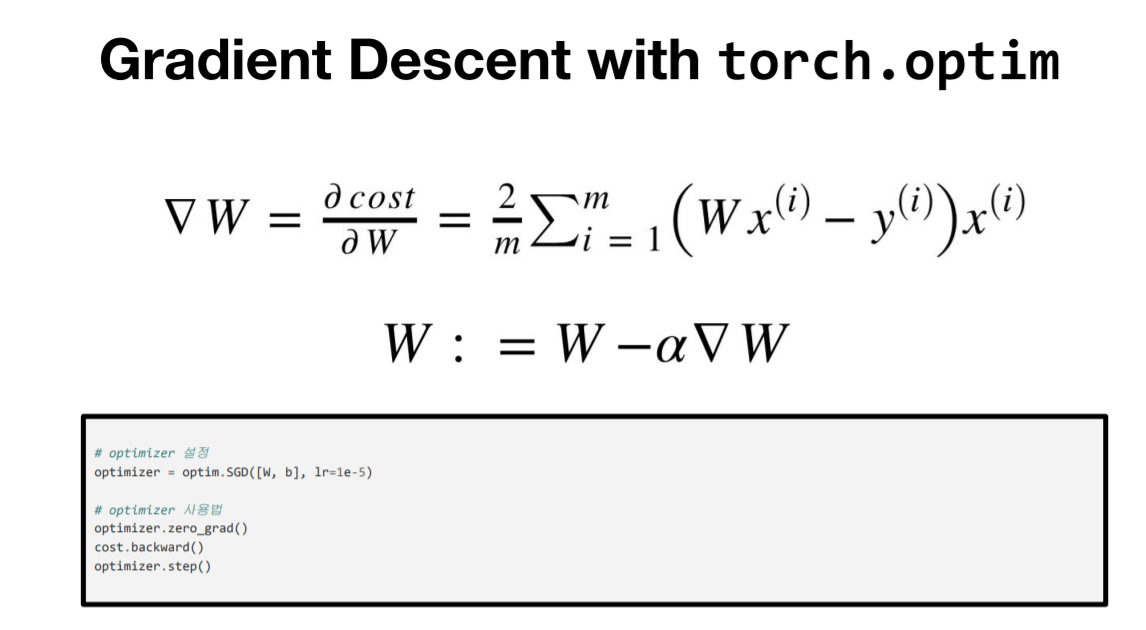

Gradient Descent(경사 하강법)

❔Gradient Descent(경사 하강법)

기울기를 이용해 함수의 최솟값(또는 가능한 한 작은 값)을 찾으려는 방법이다.

최솟값을 찾는것을경사 하강법(Gradient Descent Method)이라고 하고,최댓값을 찾는것을경사 상승법(Gradient Ascent Method)이라고 한다.

특히 신경망 학습에 경사법을 많이 사용한다.

✔경사법은 기울기가 0인 장소를 찾지만 그것이 반드시 최솟값이라고는 할 수 없다.(극솟값이나 안장점(saddle point)일 다능성이 있다.)

경사 하강법 수식