일반 신경망(fully connected neural network)

일반 신경망이 있고 모든 노드가 서로 연결돼있다.

예를 들어 입력이미지가 28x28 일 경우,

단일 은닉 계층에서도 연결 수가 엄청나게 많을 수 있다.

이러한 구조는 하나의 은닉 계층만으로도 수천만 개의 파라미터를 가질 수 있음을 의미

합성곱 신경망(CNN)의 파라미터 수

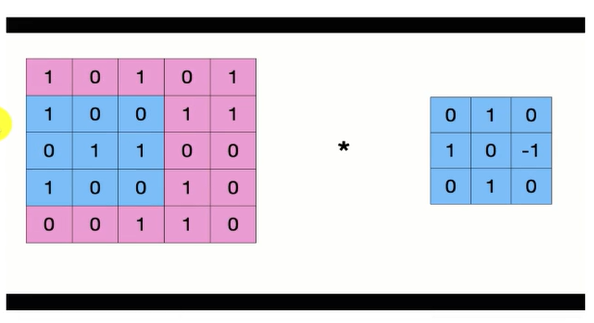

CNN은 필터(또는 커널)를 사용하여 입력 이미지의 특징을 추출

필터들은 이미지 전체에 걸쳐 반복적으로 적용, 즉 여러 위치에서 재사용된다는 것인데,

이 점이 파라미터 수를 현저히 줄이는데 기여한다.

22개의 필터를 사용하여 26x26 크기의 특징 맵을 생성하는 경우 전체 파라미터 수는 약 18,312개로 일반 신경망보다 파라미터의 수가 훨씬 적다.

일반 신경망은 적합하지 않다

일반 신경망을 적용해서 사용하는 사례는 적지않지만,

일반 신경망의 특성상 대규모 데이터 입력에 대해 확장이 거의 불가능하고

한마디로 불가능한것이 아닌, 이미지 분류에 사용하기에 일반 신경망은 적합하지 않다.

연비가 안좋은 차로 전국을 돌아다니는 느낌으로 생각했다.

CNN의 장점

- 매개변수 공유(파라미터)

단일 필터를 이미지의 모든 부분에 사용할 수 있는 매개 변수를 공유한다.

- 연결의 희소성

우리가 본것처럼, 일반적인 신경망에서는 완전히 연결된 계층은 많은 수의 매개 변수를 가진 가중치의 행렬을 생성한다.

- 불변성

Max Pool 예제를 생각해보면 알 수 있다.

CNN의 기본 가정

"기본 가정을 설명한다." 말은 합성곱 신경망(CNN)이

어떻게 작동하는지 이해하기 위해 이 모델이 전제하고 있는

몇 가지 중요한 원칙이나 조건들을 명시하는 것을 의미하며

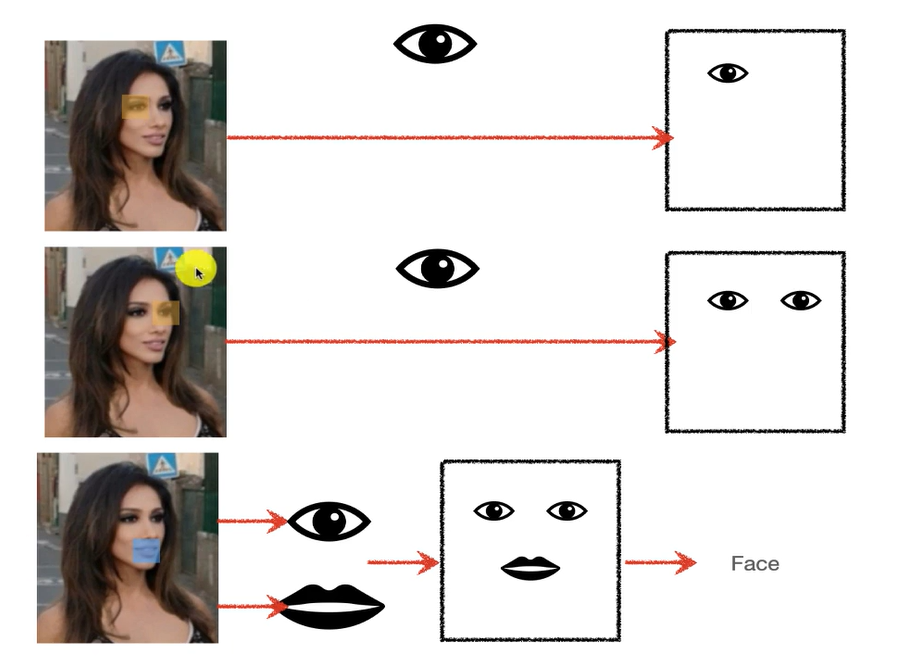

총 3가지가 있다. 아래 이미지를 갖고 이해 해보자.

-

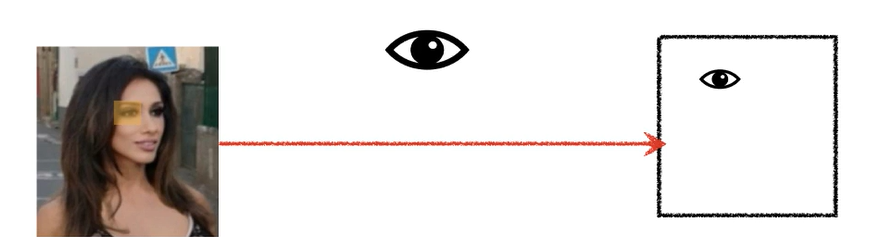

저수준 특징은 지역적(Local)

이 가정은 이미지의 작은 지역적인 부분이 전체 이미지를 이해하는 데 중요한 정보를 담고 있다는 것을 의미 한다.

그냥 이미지의 작은 부분에 집중하여 저수준 특징(예: 모서리, 색상 블록)을 추출하는 것으로

위의 사진 처럼 눈 주위를 강조하여 보여준다.

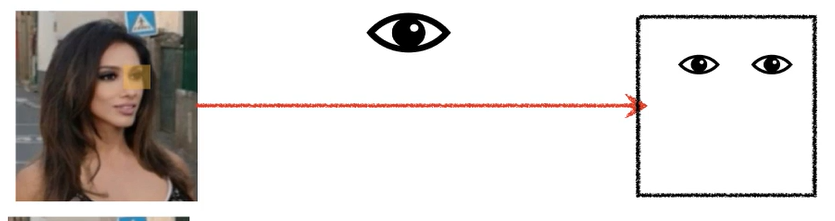

- 특징은 이동 불변성(Translationally Invariant)을 가짐

CNN은 이미지 내에서 특징의 위치가 변하더라도 그 특징을 인식할 수 있는 능력을 가진다.

즉, 객체가 이미지 안에서 이동했을 때 그 객체의 특징을 여전히 인식할 수 있다.

사진에서는 이미 하나의 눈을 찾았지만 다른 위치에 있는 눈의 위치를 동일한 객채로 인식하고 찾았다.

- 고수준 특징은 저수준 특징으로 구성됨

저 수준의 눈 두개와, 입 하나의 조합을 보고,

'얼굴' 이라는 고수준 특징을 인식하는 과정을 보여준다.

안녕하세요 포스팅 잘 봤습니다!

혹시 공부하시면서 참고하신 CNN 도서나 논문이 무엇인지 알 수 있을까요?