Continual Learning

1.Learning to Prompt for Continual Learning

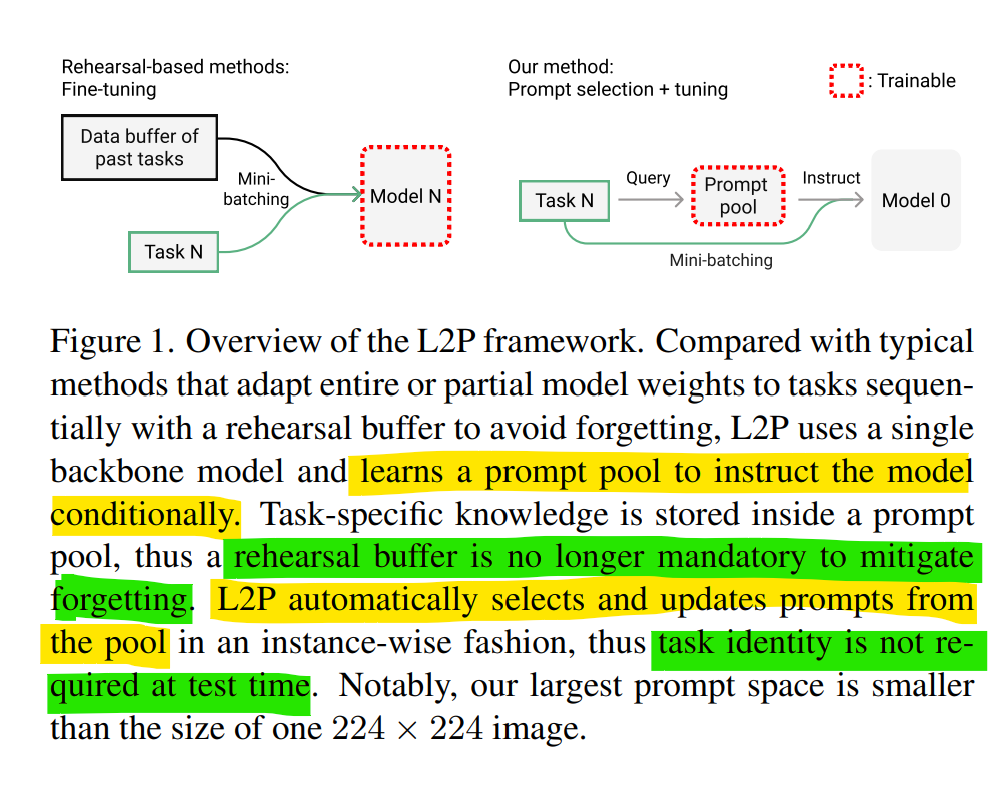

task-id를 알고있거나, 리허설 버퍼를 통해 과거 테스크 데이터 샘플을 사용하는 일반적인 방법이 아닌 NLP의 prompt-based learning + prompt tuning를 착안하여 최초로 continual learning에 적용한 case,여느 SOTA들

2023년 4월 9일

2.DualPrompt: Complementary Prompting for Rehearsal-free Continual Learning

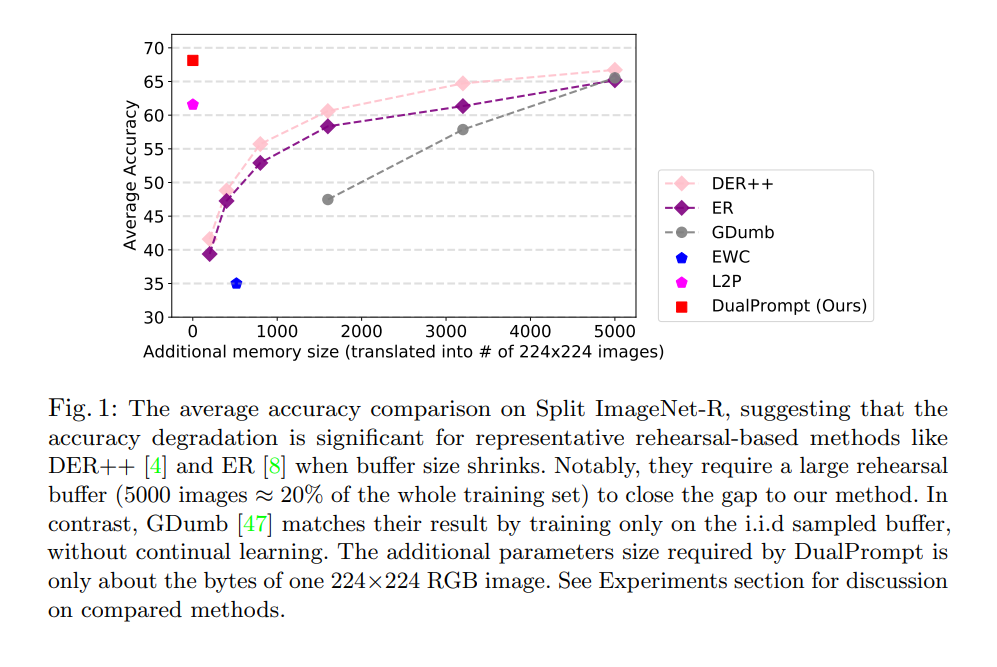

L2P의 1저자 Zifeng Wang의 prompt-based continual learning 후속 논문으로 general-prompt와 expert-prompt를 명시적으로 학습하는데 사용하며, task invariantDualPrompt: Complementary

2023년 4월 9일