Meaning of Learning

Pavlov's Dog 실험

이것은 고전적 조건화 (Classical Conditioning)을 신경망과 연결해서 설명한 것이다.

실험 (1)

- 강아지는 음식을 보면 침을 흘린다.

- 생물학적으로 음식 자극이 salivation neuron(침 흘리는 신경)을 자극해서 반응이 일어나는 구조이다.

실험 (2)

- 종소리만 들으면 아무 반응이 없다.

- 종소리 자극은 아직 salivation neuron과 연결이 약하거나 없는 상태 (inactive synapse)

실험 (3)

- 종소리 + 음식을 반복적으로 함께 주면,

- 종소리와 침 흘리는 신경 사이의 연결이 점점 강해짐

- 즉, 시냅스가 활성화(activated) 된다.

실험 (4)

- 이제는 종소리만 들어도 강아지가 침을 흘린다.

- 학습이 일어난 상태

즉, 학습은 시냅스(연결)의 강도를 조정하는 것이다.

종소리 신호가 salivation neuron에 영향을 줄 수 있게 연결을 강화한 것이 바로 학습이다.

그리고 이게 바로 딥러닝에서는가중치(weight)조정이다.

인공 신경망과 학습

실제 딥러닝에서는 개나 고양이 사진을 넣으면 → 여러 층의 뉴런(신경망)을 거치며 → 각 뉴런 사이의 가중치(weight)가 조절되면서 → 최종적으로 '개' 라고 분류할 수 있게 된다.

Learning Methods

기계학습에는 총 3가지 방법이 있다.

1. Supervised Learning (지도학습)

- 설명

- 입력이 들어오면, 그에 대한 정답도 함께 있다.

- 예를 들어, 강아지 사진을 보여주고, "이건 강아지야 !" 하고 알려주는 것이다.

- 학습 방법

- AI는 정답을 보면서, '아~ 이게 강아지구나' 하면서 배운다.

- 만약 잘못 예측하면 → 정답을 보고 → 다시 고친다.

2. Unsupervised Learning (비지도학습)

스스로 패턴을 찾는 방식 !

-

설명

- 입력만 있고, 정답(라벨)은 없다.

- AI가 '비슷한 애들끼리 묶어보자' 하면서 스스로 분류한다.

-

학습 방법

- 예를 들어, 색깔 구슬을 보고 파란색/빨간색 을 스스로 그룹으로 나눈다.

3. Reinforcement Learning (강화학습)

스스로 행동하면서 보상을 통해 배우는 방식

- 설명

- AI는 어떤 환경 속에서 행동을 선택하고, 그 행동이 좋으면 보상을 받는다.

- 마치 강아지가 잘하면 간식을 받는 것 처럼 !

- 학습 방법

- AI는 '어떤 행동을 해야 보상을 많이 받을까?' 를 배운다.

- 예시

- 바둑 AI '알파고' 가 이세돌 선수와 대국하면서 스스로 전략을 익힌 것

Implementation Methods

인공지능은 여러 방식으로 구현이 가능하고, 그 중 딥러닝은 머신러닝의 한 갈래이다.

3가지 접근 방식 비교

Rule-Based

- 사람이 규칙 직접 코딩

- if문, 수동 설계 ('이럴 때 이렇게')

- AI가 스스로 배우지 않음, 오로지 정해진 규칙만 수행

Classical ML

- 사람이 특징(feature) 추출 + 기계가 학습

- 특징을 사람이 설계하고 기계가 분류

- 예 : 숫자 이미지를 보고 '흰색 픽셀 수', '구멍 수' 같은 걸 사람이 먼저 뽑아줌

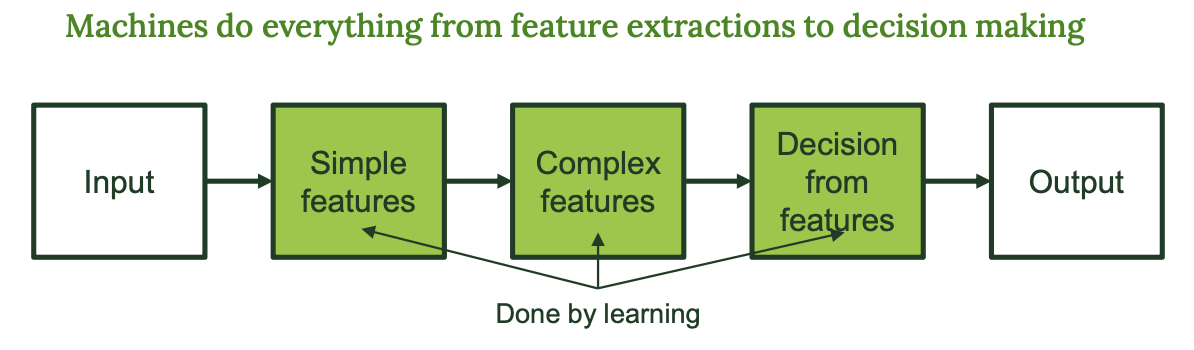

Deep Learning

- 기계가 특징 추출부터 판단까지 전부 학습

- 자동으로 특징까지 학습, end-to-end

- 사진만 줘도 '고양이' 라고 스스로 판단

딥러닝은 왜 특별한가 ?

구조

- 입력을 넣으면 기계가 알아서

간단한 특징 → 복잡한 특징 → 결과 판단까지 스스로 함 - 사람이 따로 특징을 설계하지 않아도 됨

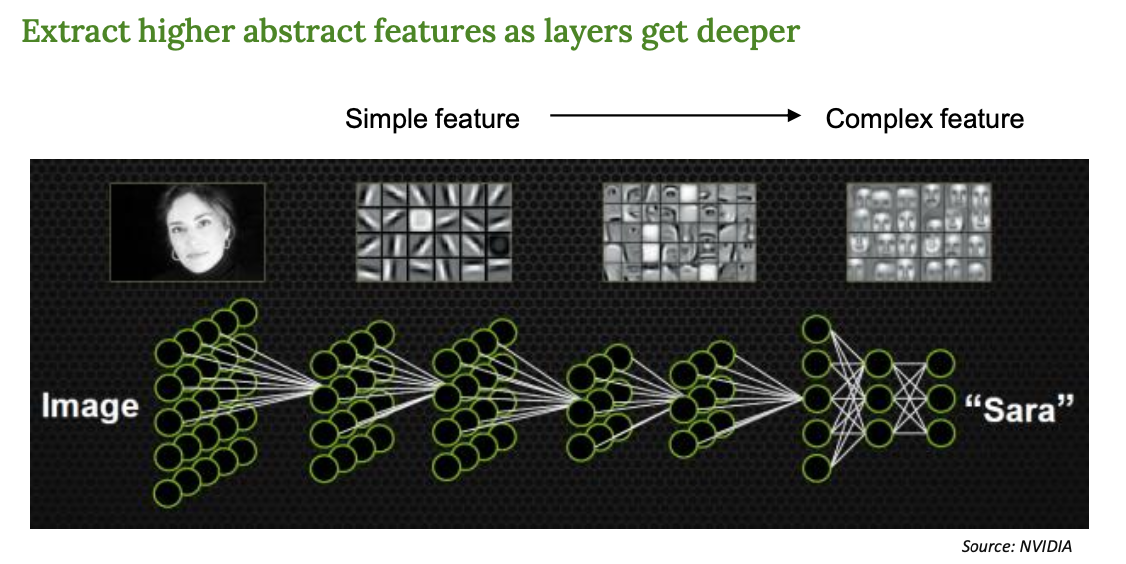

내부 예시

예시) 얼굴 이미지를 넣으면

- 초기 레이어 : 선, 점, 테두리 추출

- 중간 레이어 : 눈, 코, 입

- 깊은 레이어 : 얼굴 전체 인식

- 마지막 출력 : 'Sara'

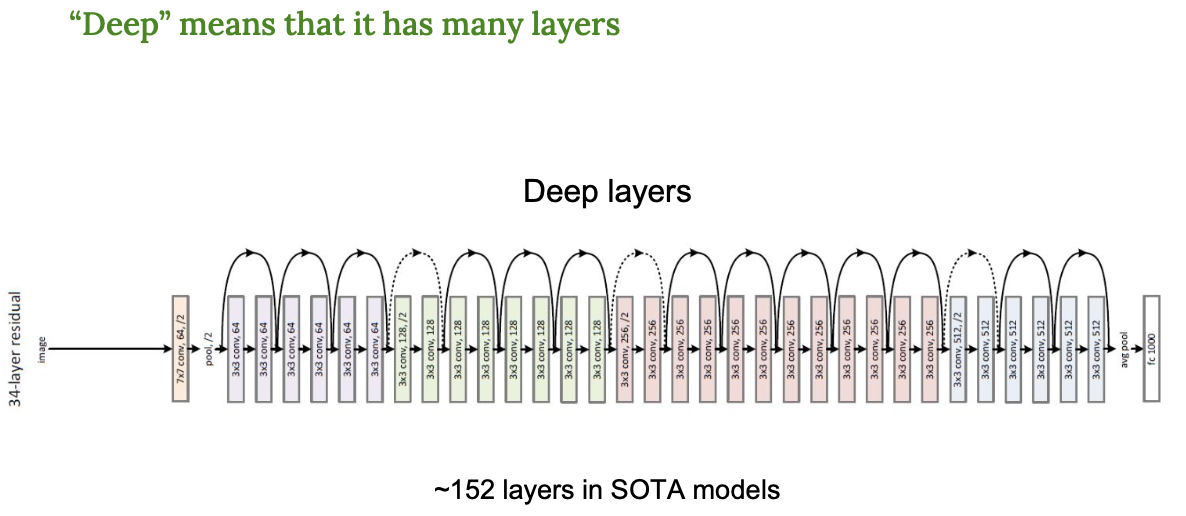

왜 Deep 한가 ?

신경망 층이 매우 깊다.

층이 많을수록 복잡한 개념도 학습 가능하다.

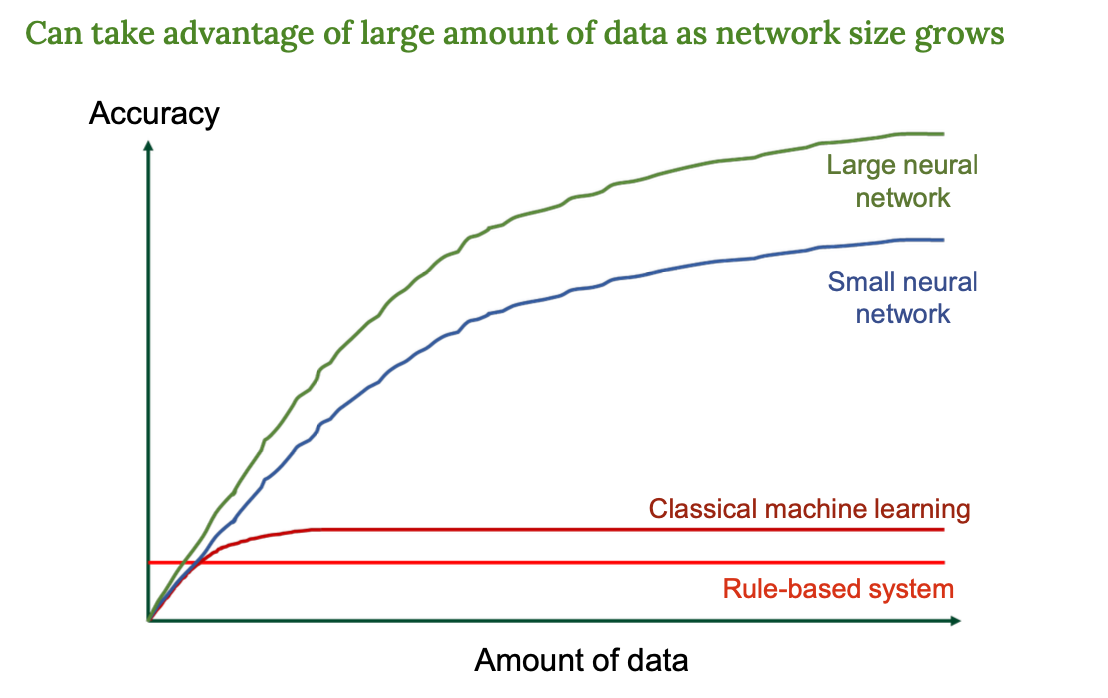

딥러닝 vs 전통 ML

데이터가 많아질 수록

- Rule-based : 성능 고정됨 (빨간선)

- 전통 ML : 약간 향상됨

- 딥러닝 : 성능 계속 향상됨 (그래서 빅 데이터와 찰떡궁합!)

다양한 딥러닝 모델 종류

- CNN : 이미지 처리

- RNN, LSTM : 순차 데이터 (예 : 문자, 음성)

- Transformer : 최근 가장 강력한 모델

- MLP(multi-layer perceptron), FCN(fully-connected network): 기본 신경망 구조