XAI : 설명가능한 AI(eXplainable AI) - (2)

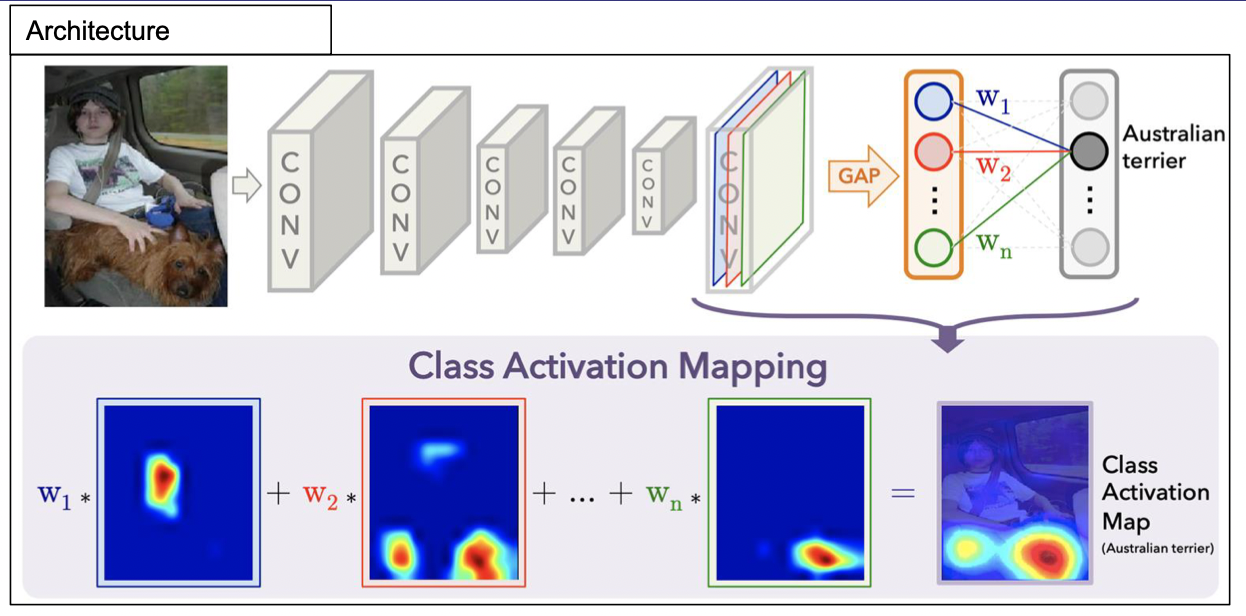

CAM (Class Activation Map)

- Global average pooling 활용

- GAP layer

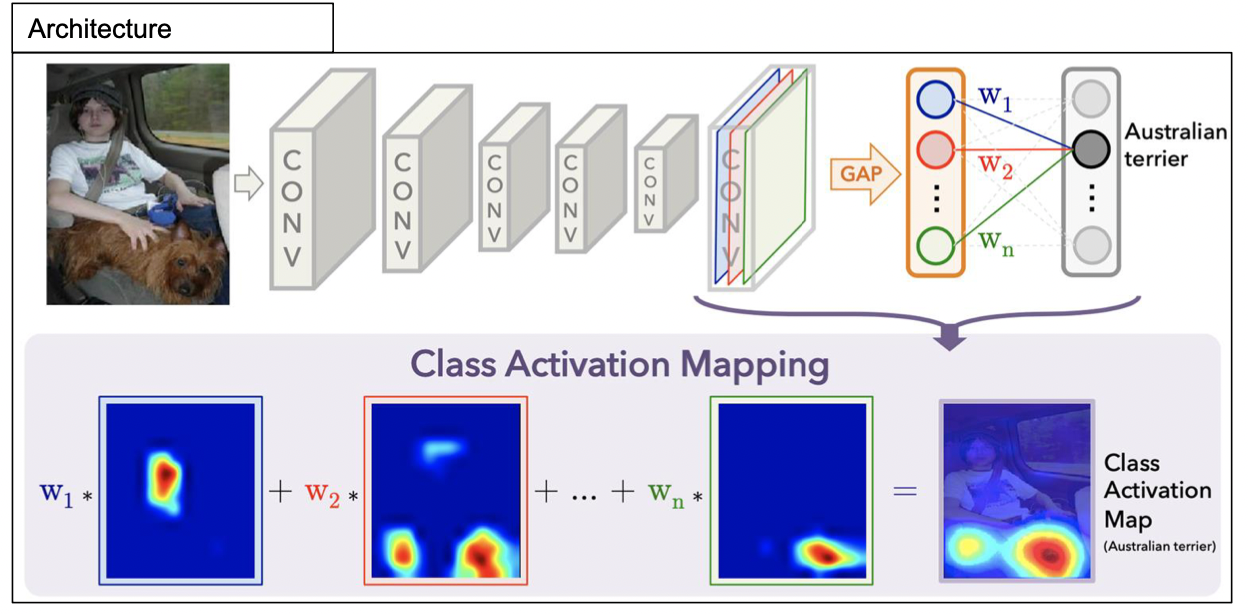

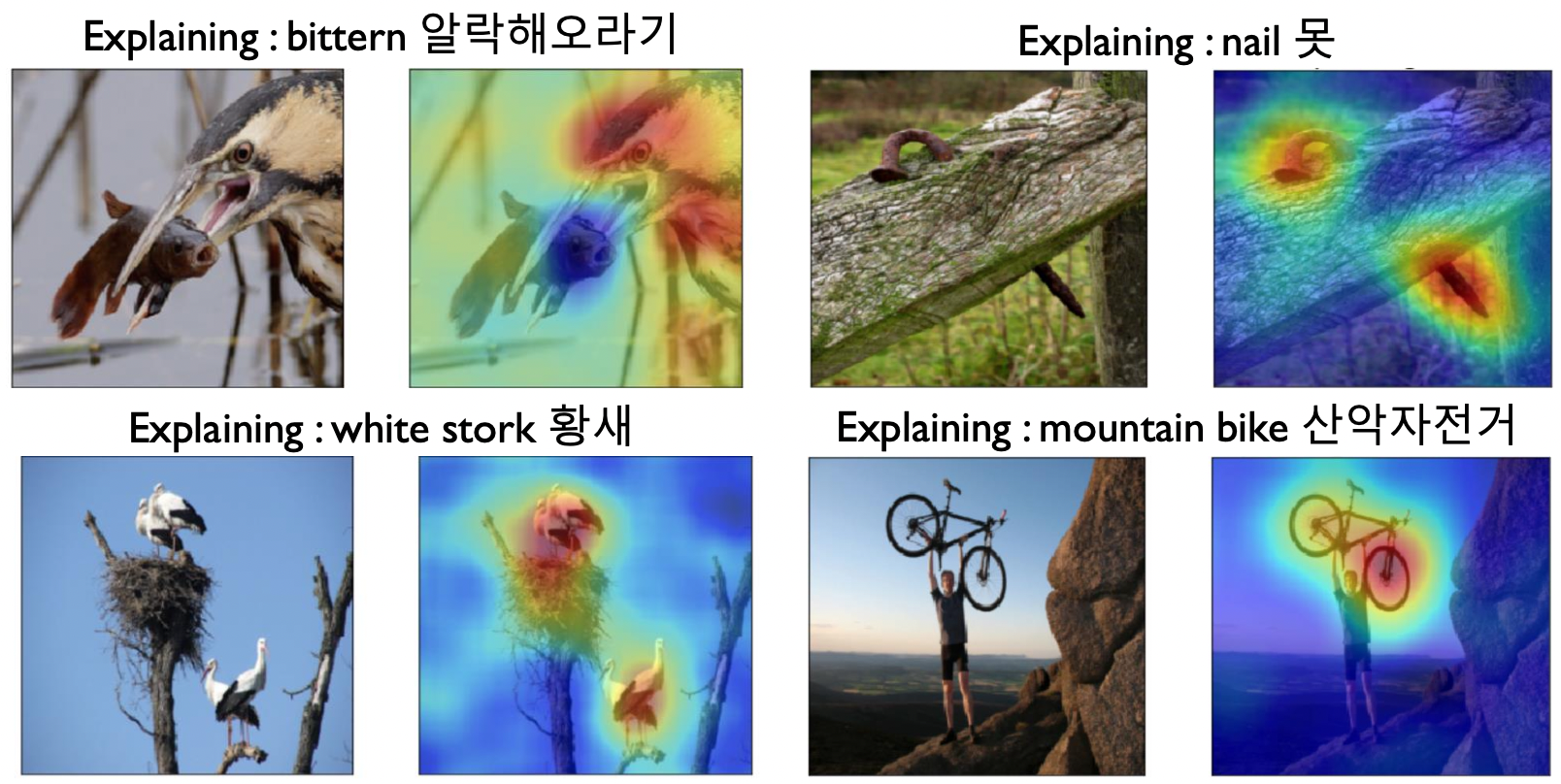

이미지 내에서 정답인 동물을 하이라이트하는 모습

주어진 맵과 관련이 많다는 모습? Activation

CAM 값들의 평균: 특정 클래스에 대한 분류 정도

CAM으로 구한 예시

다른 모습의 같은 클래스 사물들을 모두 정확히 검출 및 하이라이트한 모습을 볼 수 있음

CAM: object detection, segmentation 등의 분야에 접목하여 활용 가능

=> 이미지 마다 단순한 classification label만 주어져있을 때도 object detection, segmentation(픽셀 단위의 분할)가 이루어지도록 적용 가능

=> = weakly supervised learning

CAM의 장단점

- 장점: 모델이 중요하게 보는 픽셀을 정확히 보여줌

- 단점: model specific. global average pool layer model(?)에만 적용 가능. visualization 해상도가 떨어짐. 대략적으로 객체만 집어내며, 객체의 boundary를 잡기는 어려움.

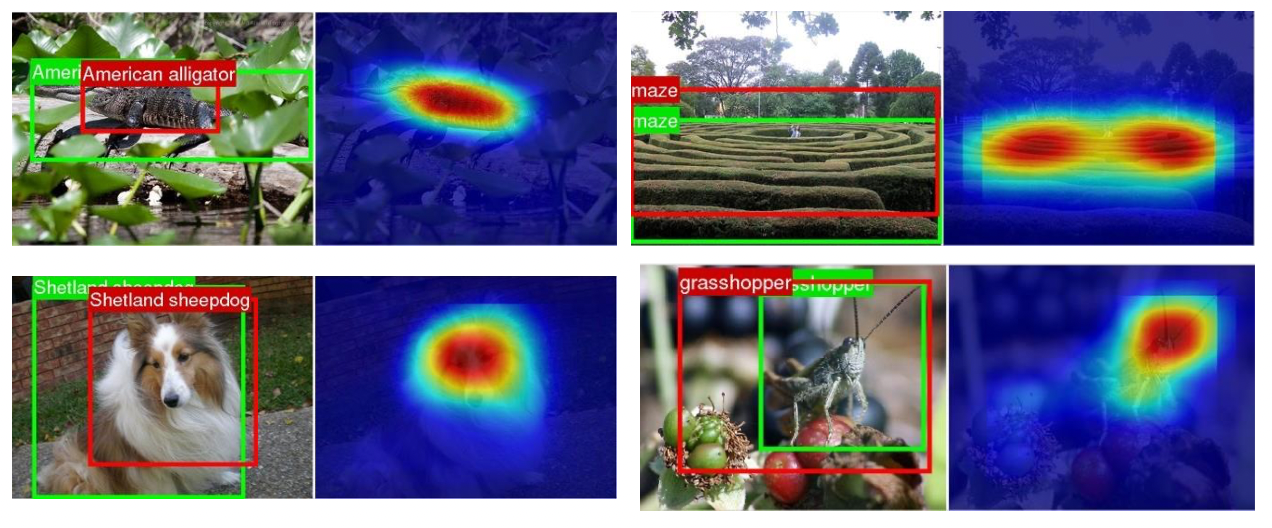

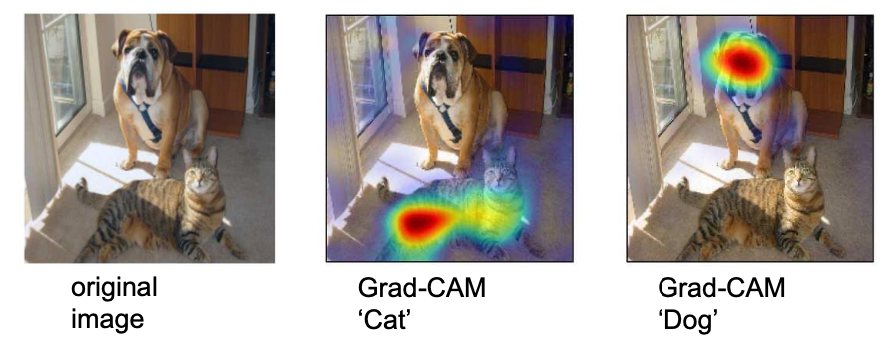

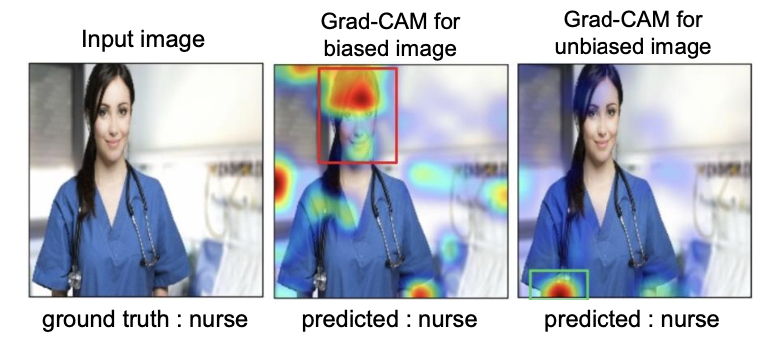

Grad CAM : CAM을 gradient 정보를 활용해서 확장한 방법. CAM을 발전시켜 만든 모델

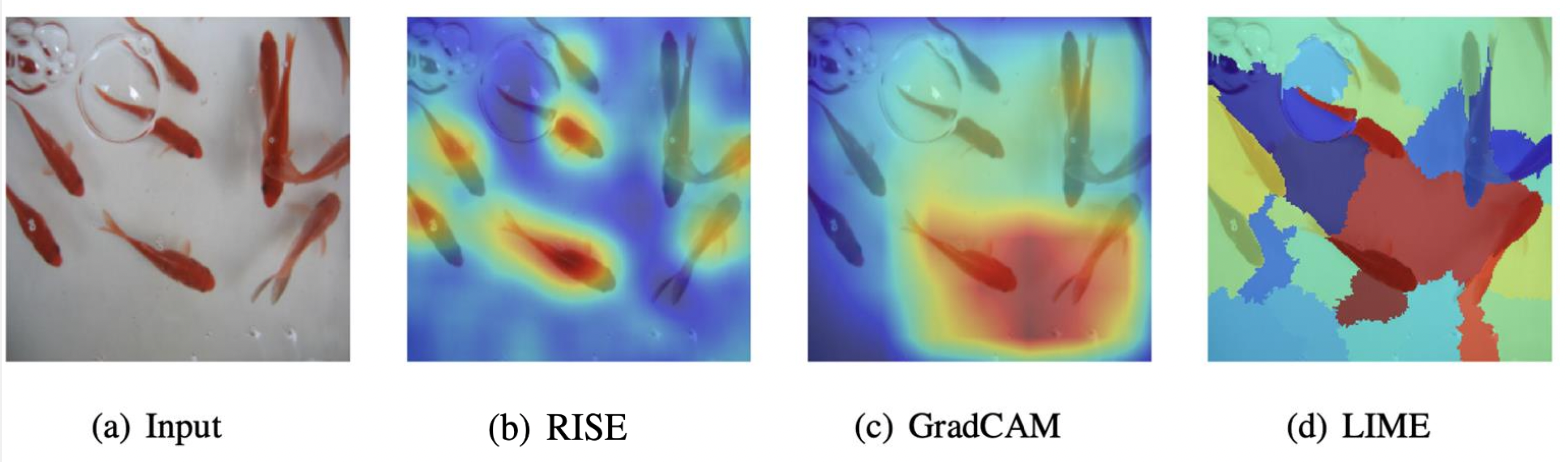

결과

모델 예측의 편향성 존재 여부를 알아낼 수 있음

가운데 결과가 나타나면 편향성이 큰 모델이라고 판단 가능, 가장 오른쪽 결과가 나타나면(의료기기에 초점)

- 장점: model agnostic함. 모델이 어떤 출력 구조를 가지더라도 상관 없이 활용 가능

VQA, Image Captioning, Classification 하는 모델 등 모든 모델에서 활용 가능 - 단점: activation을 결합하는 w 값으로 평균 gradient를 사용하는데, 이 값이 정확하지 않는 경우도 많음. 중요도를 정확하게 반영하지 않는 경우도 있음

모델의 입출력 정보만 가지는 경우의 모델

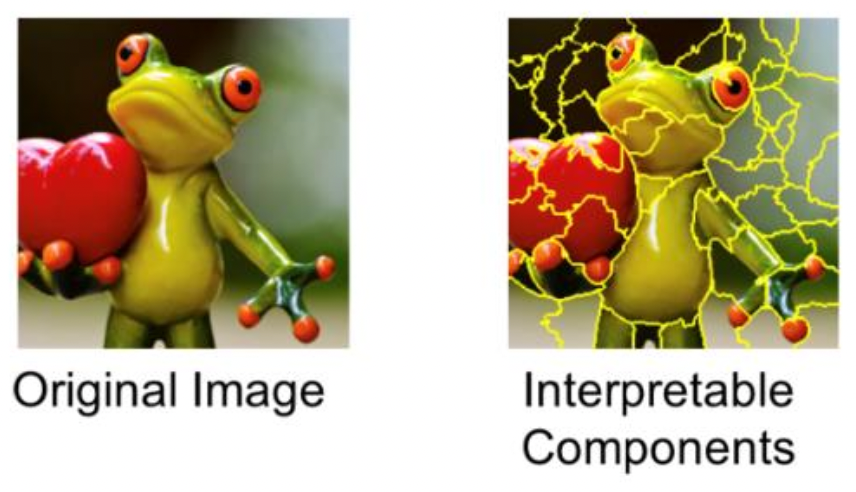

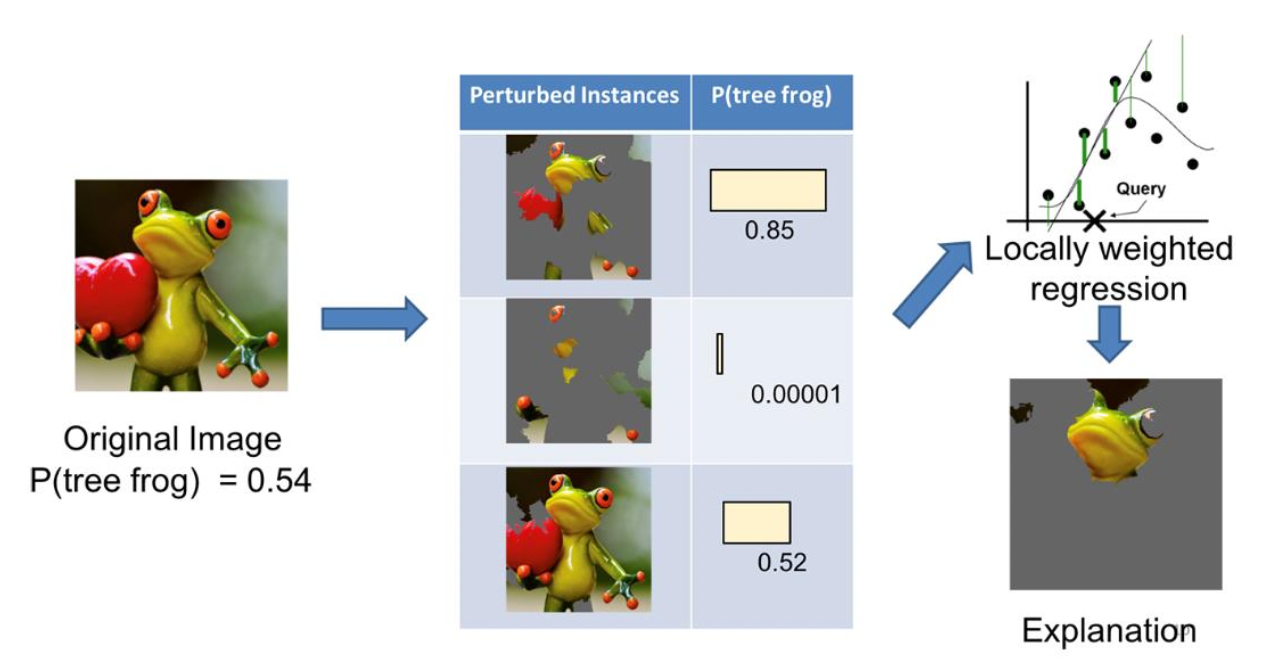

1. LIME (Local Uterpretable Model-agnostic Explanations

선형적인 모델로 근사화가 가능하다는 관점에서 출발

선형 모델로 근사화하여 설명하겠다

=> super pixel을 활용

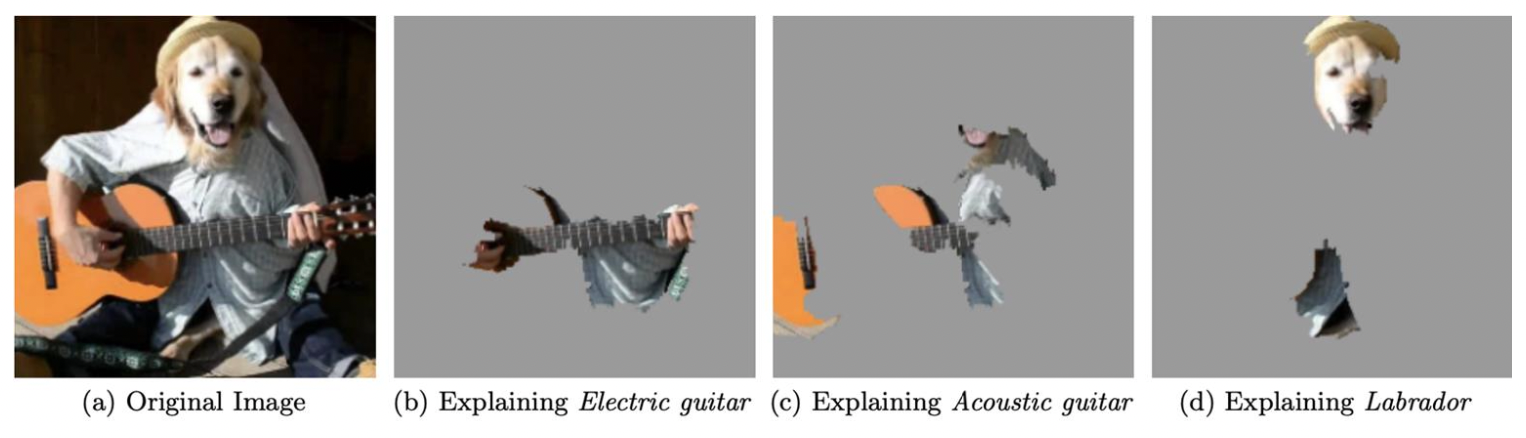

첫 번째 모델: 개구리로 예측할 확률이 높음

두 번째 모델: 낮음

개구리 머리에 해당하는 super pixel들을 잘 찾아냄

LIME 방법

- 장점: Black Box 설명 방법. 주어진 입력에 대한 출력만 얻을 수 있다면 활용 가능

- 단점: 계산 복잡도 상승(black box 모델의 한계), 비선형이 ㄴ경우 선형 함수로 근사화되지 않아 설명이 제대로 이루어지지 않음, 이미지 분류에 활용하기 어려움

- RISE (Randomized Input Sampling for Explanation)

결과

- white box 방법 보다 좋은 결과를 내는 경우 있음, LIME보다 성능 향상

- 계산 복잡도 향상, random mask를 앞선 LIME 방법보다 훨씬 많이 만들어야 함

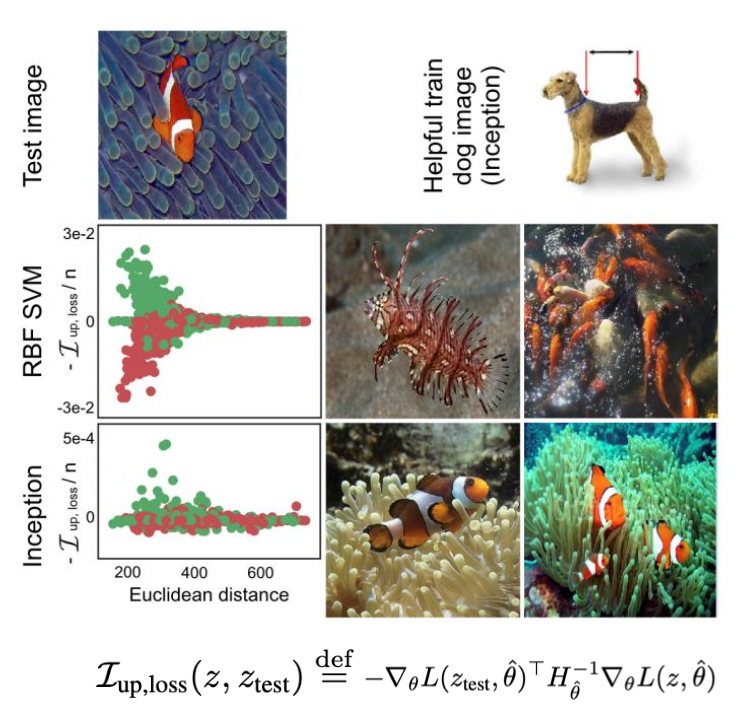

Influence function 기반

Training 이미지 없이 test를 진행했을 때, 나타나는 정확도 차이를 보고 가장 많이 값의 변화에 기여하는 (=test 성능 향상에 가장 많이 기여하는) 이미지를 설명으로 제공함

=> Inception 모델이 더 제대로된 특징을 추출하여 학습하고 있음을 보여줌