그룹 간 평균값에 **표준편차 2배(±2SD) 이상의 차이**가 생긴 경우,

한쪽 그룹의 데이터가 존재하는 범위에 다른 그룹의 데이터가 존재하는 것은

'당연한 것이 아니다'📘유의차와 검정에 대한 기본개념

[ 유의차와 검정 ]

- 유의한 차이 (유의차) : 우연한 불규칙성 때문에 생겼다고는 생각하기 어려운 차이

- 검정 (통계적 가설검정) : 가설이 올바르다고 생각할 수 있는지 없는지 판단하기 위한 분석 방법

- 검정력 : 어떤 차이가 존재하고 있다는 가설이 올바를 때 정확히 유의차라고 말할 수 있는 확률

- 최강력검정 : 설정된 유의수준에서 가장 검정력이 높은 분석방법

'표준편차 2배 보다는 적지만 현실적인 의미가 있고, 통계학적으로 유의한 차이를 최소한의 데이터 안에서 어떻게 찾아낼 수 있는가, 즉 검정력을 크게 높일 수 있는가'가 중요한 포인트

[ 제1종 오류와 제2종 오류 ]

- 제 1종(α) 오류 : 아무 차이가 없는데도 차이가 있는 것으로 인식시키는 실수

- 제 2종(β) 오류 : 본래 차이가 존재하는데도 그것을 못 보고 놓쳐버리는 실수

- 유의수준 : 제 1종 오류 허용 수준 (관례적으로 5%, 엄밀하게 1% or 0.1

📘'오차범위'와 유의미한 통찰을 위한 표본크기 설계

[ 통계학적 의미의 오차 ]

오차 : 한정된 데이터를 통해 얻어진 평균 또는 비율이 '참값'으로부터 어떤 확률과 정도로 벗어나 있는지를 나타내는 것

→ 데이터의 수 + 원시 데이터의 불규칙성 크기와 관계

[ 데이터의 불규칙성과 평균 ]

원시 데이터의 불규칙성이 크면 클수록 동일한 건수의 데이터로부터 얻어지는 평균값이라도 대단한 차이를 보인다

[예시]

A_data = [4,000원, 4,000원, 3,500원, 4,500원]

A'_data = [4,000원, 4,500원, 3,500원, 4,500원]

→ 4명의 평균값에 미치는 영향 : 500/4 = 125

→ 변심고려 평균값 : 3,875원 ~ 4,125원

B_data = [4,000원, 4,000원, 1,000원, 7,000원]

B'_data = [4,000원, 7,000원, 1,000원, 7,000원]

→ 4명의 평균값에 미치는 영향 : 3000/4 = 750

→ 변심고려 평균값 : 3,250원 ~ 4,750원[ 평균의 표준오차 ]

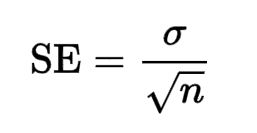

표준오차 (Standard Error: SE)

평균의 표준오차 = (원시 데이터의 표준편차) / (√평균값 계산에 사용한 데이터 수)

- '4명(표본크기)의 데이터로부터 얻어진 평균값'의 표준편차

- 평균의 표준오차, 비율의 표준오차, 표준편차의 표준오차 모두 존재

- 원시데이터 그 자체의 불규칙성을 나타내는 지표

- 다수의 데이터에서 얻어진 평균값의 불규칙성 < 원시 데이터의 불규칙성

- 표본크기가 클수록 표준오차가 작아진다

→ 데이터 수가 많아질수록 원시 데이터 가운데서 진정한 평균값보다 큰 거나 작은 것만이 표본으로 포함될 확률보다, 진정한 평균값보다 큰 값과 작은 값이 혼계하게 될 확률이 커지기 때문

[ 표본크기 설계 ]

표본크기 설계 : 평균과 표준편차를 사용해서 '다음 조사에서 어느 정도의 표준오차로 하기 위해 어느 정도의 데이터 수(표본크기)가 필요한가'를 예측하는 것

[ 비율의 표준오차 ]

비율의 표준오차 = √(비율 * (1-비율)) / √(표본크기)

📘 통계적 가설검정

통계적 가설검정은 손익이 걸린 상황에서 더 최선인 쪽을 선택하는 경우에 위력을 발휘한다

귀무가설 : 자신의 주장을 완전히 뒤집어엎는 가설

ex. 까마귀가 검은지 어떤지는 반반이다

- '존재할 수 없는 귀무가설'과 '부정할 수 없는 귀무가설'의 경계선이 어디부터 어디까지라는 범위를 나타낸 것이 신뢰구간

<br>p-value : 귀무가설이 성립한다는 가정 아래 실제 데이터 또는 그 이상으로 귀무가설에 반하는 데이터가 얻어지는 확률

ex. '까마귀가 검은지 하얀지가 반반인 경우, 100번 연속으로 검은 까마귀가 발견되었다'는

관찰결과가 얻어지는 확률이 1조분의 1보다 작다는 것- 이 값이 작으면 '그 귀무가설은 존재할 수 없다'

- 대략 5% 미만일 때

95% 신뢰구간 : 평균값 ± 2SE라는 가장 자주 사용되는 신뢰구간으로 유의수준은 5%이며 부정할 수 없는 가설 범위

📘 Z 검정

단측검정 : 크든 작든 한쪽 5%만 기각하는 방식

어떤 불규칙성을 지닌 데이터에서 뭔가의 값을 산출하는 한 거기에는 반드시 표준오차가 존재한다

Z 검정 : 비율이나 평균, 그것들의 차이는 표본크기가 큰 경우 정규분포를 따른다는 점을 이용하고, 우연한 데이터의 불규칙성에 의해 생기는 것인지 아닌지 생각하기 위한 방법

📘 t분포와 카이제곱분포

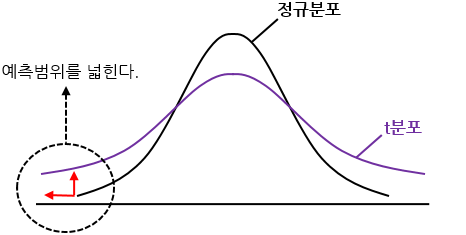

t 검정 : 정규분포가 아니라 소수의 데이터를 검정하기 위해 활용하는 검정 방법

- 현재 평균값 차이가 의미가 있는지 아닌지 생각하는 경우에는 일반적으로 z 검정이 아닌 t 검정을 사용

- '소(小)'를 위한 분석방법은 '대(大)'를 위한 분석방법을 포용한다

- '평균값의 차이'가 '평균값 차이의 표준오차'의 몇 배인가를 생각하고 그것이 어느 정도 존재하기 어려운지를 밝히기 위해 p값을 구함

[ z 검정과 t 검정의 공통점 ]

z 검정과 t 검정 모두 '평균값 차이'가 '평균값 차이의 표준오차'의 몇 배가 되는가 하는 값이 확률적으로 얼마만큼 존재할 수 없는지를 나타내는 p-값을 구할 수 있다

[ 데이터의 적은 표본 문제 ]

but 데이터가 적으면 적을수록 '데이터의 평균값'은 '진정한 평균값'에서 벗어나기 쉽다 (표본의 분산과 표준오차 모두 '진정한 분산'과 '진정한 표준오차'보다 적은 값이 된다)

💡 고셋 & 피셔

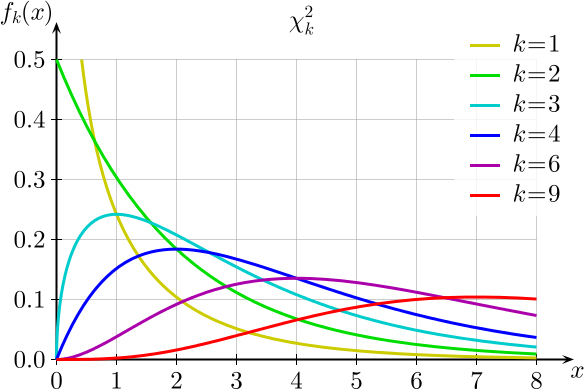

데이터를 통해 얻어진 분산과 그 데이터 수 사이에 어떠한 관계가 있는지 수학적으로 정리

카이제곱분포를 사용하면 계산에 사용된 데이터의 수마다 다르고 데이터로부터 구해진 분산이 진정한 분산과 어느 정도 달라지는지의 분포를 계산할 수 있음

카이제곱분포 : 평균값이 0, 분산이 1(표준편차도 1)의 정규 분포를 따르는 x라는 변수를 생각했을 때 이 변수의 제곱을 전부 더한 것의 분포 (모두 더한 x의 제곱수는 자유도)

1) 자유도가 무한대인 경우: 정규분포와 완전히 일치

2) 수백 수천만큼 자유도가 큰 경우: 정규분포라고 불러도 아무런 문제 없음

t 분포 : 데이터 수에 의해 혹은 카이제곱분포의 자유도별로 '평균값 차이'가 '평균값 차이의 표준오차'의 몇 배 이내로 수용될 확률이 몇 %인지 계산하기 위한 분포

- 한정된 데이터로부터 산출한 표준오차는 데이터를 대량으로 모으면구해지는 진정한 표준오차보다 작기 때문에 신뢰구간이 넓어짐

📘 피셔의 정확검정 (직접확률검정)

정확(직접확률) : 정규분포로의 수렴이 아니라 정확한 확률 계산을 사용하여 p값을 산출한다는 의미

- '조합의 수'를 사용하여 수십 건 정도의 데이터로도 정확하게 비율의 차이에 의미가 있는지를 알기 위해 p값을 구함

📘 다중검정과 한계

피셔의 분산분석

- 세 그룹 이상의 평균값 차이에 대해 분석

- 다른 그룹 간 평균값의 불규칙성을 나타내는 분산과 그룹 안에서 얻어진 값의 불규칙성을 나타내는 분산의 비교

→ 그룹 간의 평균값의 차이가 어느 정도인지 p값 산출 가능

카이제곱검정 : 세 그룹 이상의 비율 차이에 대해 분석

[ 분산분석과 카이제곱검정의 한계 ]

분산분석과 카이제곱검정 모두 'p값이 작아졌다는 것은 평균값이 혹은 비율이 모두 동일하다고 한정지을 수 없다' 정도의 결론만 도출가능하기 때문에 비즈니스에서 많이 사용하지 않음

t검정/카이제곱검정 여러번 수행 : 비교 그룹이 많아질수록 복잡

📘 다중검정과 처방

1. 본페로니 방법

여러 가설 검정을 한 다음 최종적으로 제 1종 오류 리스크를 5%로 유지하기 위해 상응하는 통계 분석방법을 사용하는 접근법

- 단순히 다수의 검정만 반복하면 제 1종 오류 리스크가 증가함 (검정의 다중성)

- p값별로 '유의인가 아닌가'의 판단기준으로 '5%라는 유의수준을 검정한 횟수로 나눈 값'을 사용

- 무제한 검정을 진행하면 제 2종 오류를 범할 위험이 커짐

> ex. 100회 검정을 하면 p값 0.05% 미만이라는 것만 '유의차'로 인정받음

2. 기준 카테고리를 정한 다음 비교

모든 경우의 수로 비교하면 그룹 수가 늘어남에 따라 p값의 수가 증가함. 이를 해결하기 위해 기준이 되는 그룹(카테고리)를 정한 후 비교

- 기준 카테고리 선정

1) 수학적으로 어느 것을 선택해도 무방

2) 전체 차지 비율이 높고 누구에게나 이미지가 떠오르기 쉬운 집단인 '보통그룹'으로 선택하는 것이 결과를 알기 쉬움

3) 해당 인원수나 건수가 어느 정도 확보 되어 있어야 표준오차도 적어지고 유의한 p값을 찾아내기 좋음

3. 탐색적 p값과 검정적 p값을 적절히 사용 ★★★

p값을 기준삼아 이익으로 연결될 만한 새로운 아이디어를 탐색하려는 목적과 그 결과로 얻어진 아이디어는 진정 이익을 창출할 수 있는지 검정