Deep-Learning

1.신경망 이해

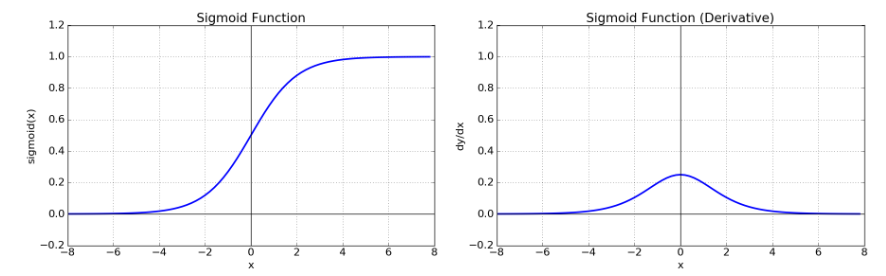

신경망(Neural Network) 단순 선형 회귀 분석과 같이 선형모델은 복잡한 패턴을 지닌 분류나 회귀문제를 해결할 수 없는 문제가 발생한다. 이를 보완하고자 한 것이 선형모델 + 비선형함수를 가진 비선형모델 즉, 신경망이다. > 위 구조를 해석한다면, output

2.Convolution Neural Network

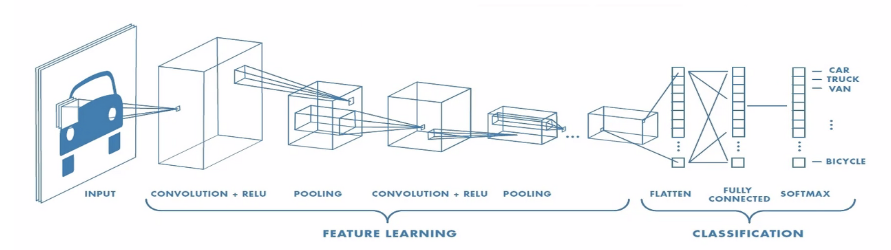

최근 kaggle competition 준비를 위해 ResNet 공부를 하기 전 기본적인 image recognition을 위해 CNN 학습을 진행하고자 한다.feature 값을 얻기 위해 합성곱 연산을 하는 Convolution layer, Convolution을 거

3.CNN #1

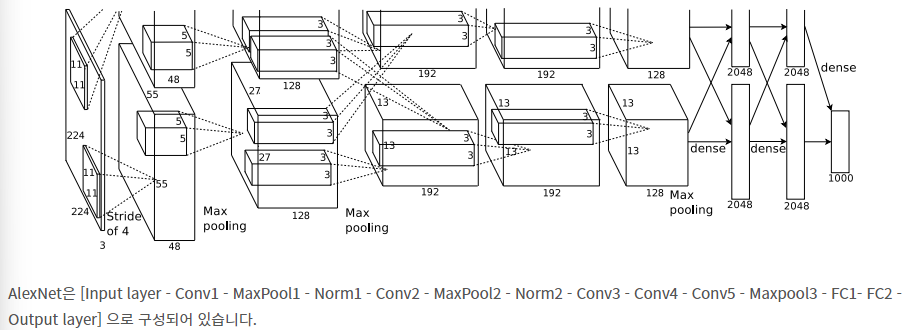

: CNN 모델의 조상 격.구조는 다음과 같다Input / 3개의 Convolution layer(C1, C3, C5) / 2개의 subsampling layer(S2, S4) / 1층의 fully-connected layer(F6) / Output으로 구성< V

4.CNN #2 (Player Contact Detection Detect Player Contacts from sensor & video data

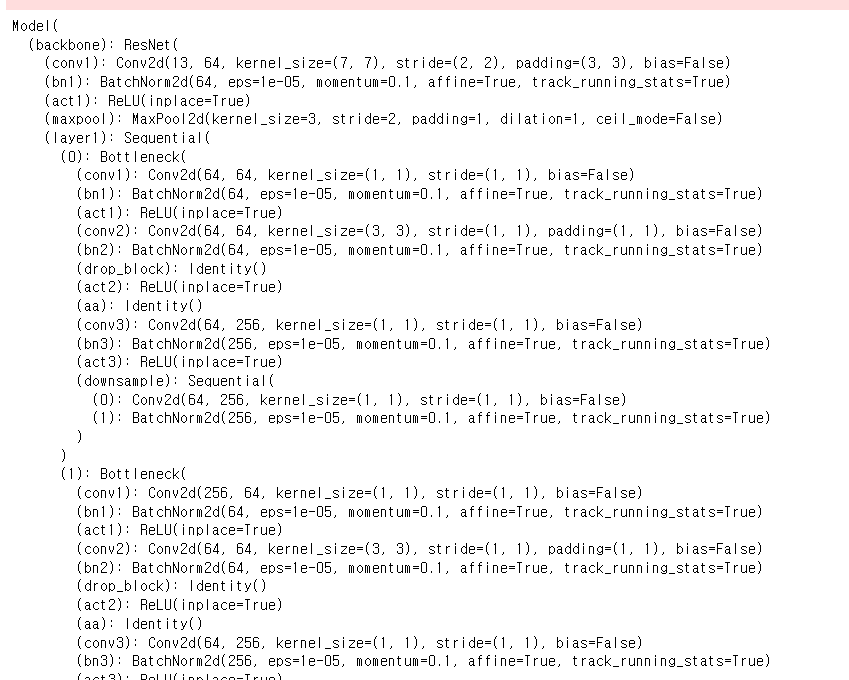

✅ ResNet Residual Neural Network의 줄임말로 이름을 보면 잔차와 관련이 있음을 알 수 있다. Residual representation 함수를 학습함으로써 152개의 layer에 달하는 신경망을 학습할 수 있다. ResNet 사용 시 layer

5.Optimization & Gradient Descent

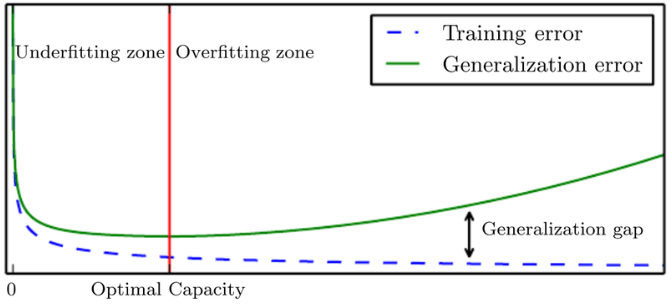

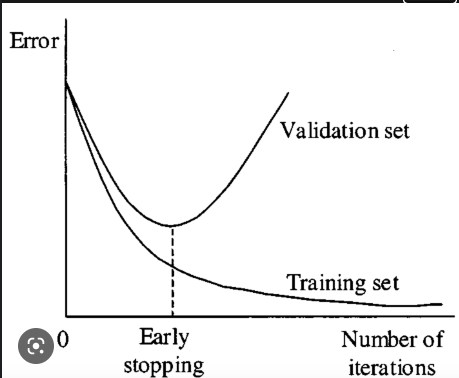

일반화라 불리며 일반화 성능을 향상시키기 위해선 iteration이 커질수록 error가 작아지는 train error와 재차 커지는 test error간의 차이를 뜻하는 generalization gap을 낮춰야 한다.다른 말로, k-fold validation이라

6.Regularization

: Generalization이 잘 되도록, 학습에 반대되는 쪽으로 규제를 거는 것으로 학습 데이터뿐만 아니라 test set에도 잘 적용되게 만들어주는 것1) ✍️ Early Stopping test 데이터는 사용할 수 없으므로, train data와 validati

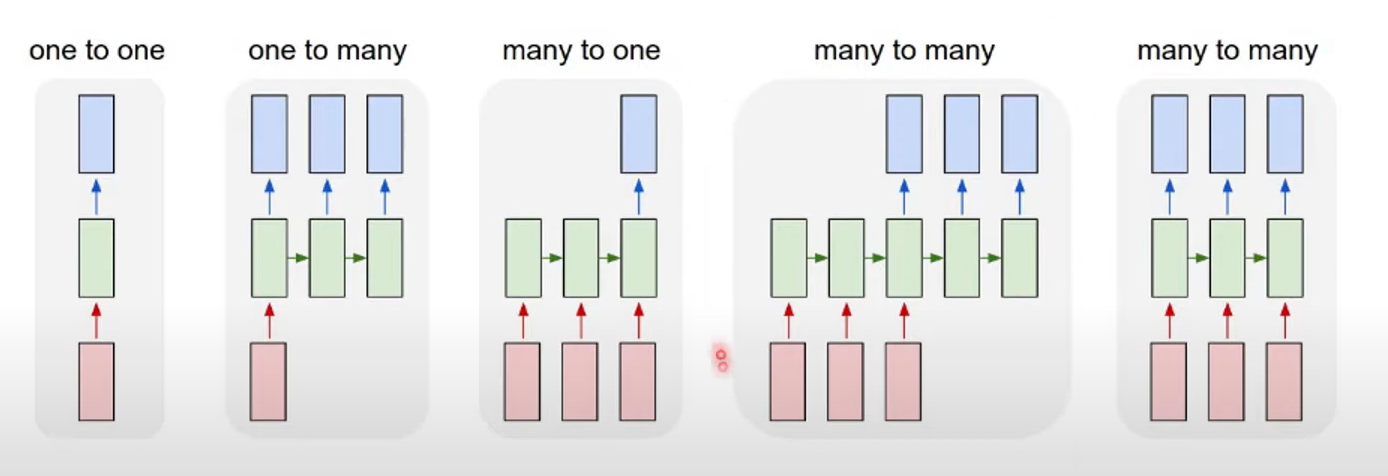

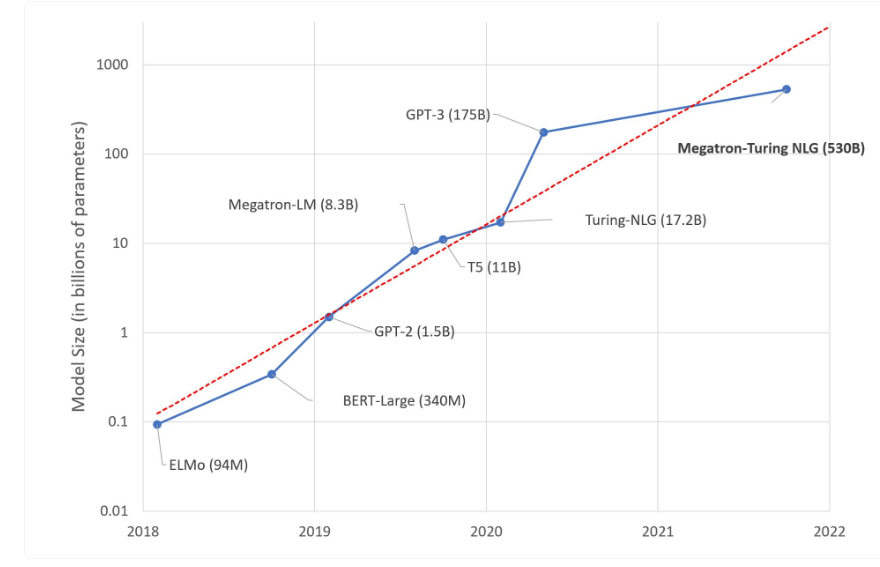

7.LLM - Transformer

Transformer

8.LLM - Detect AI Generated Text

LLM

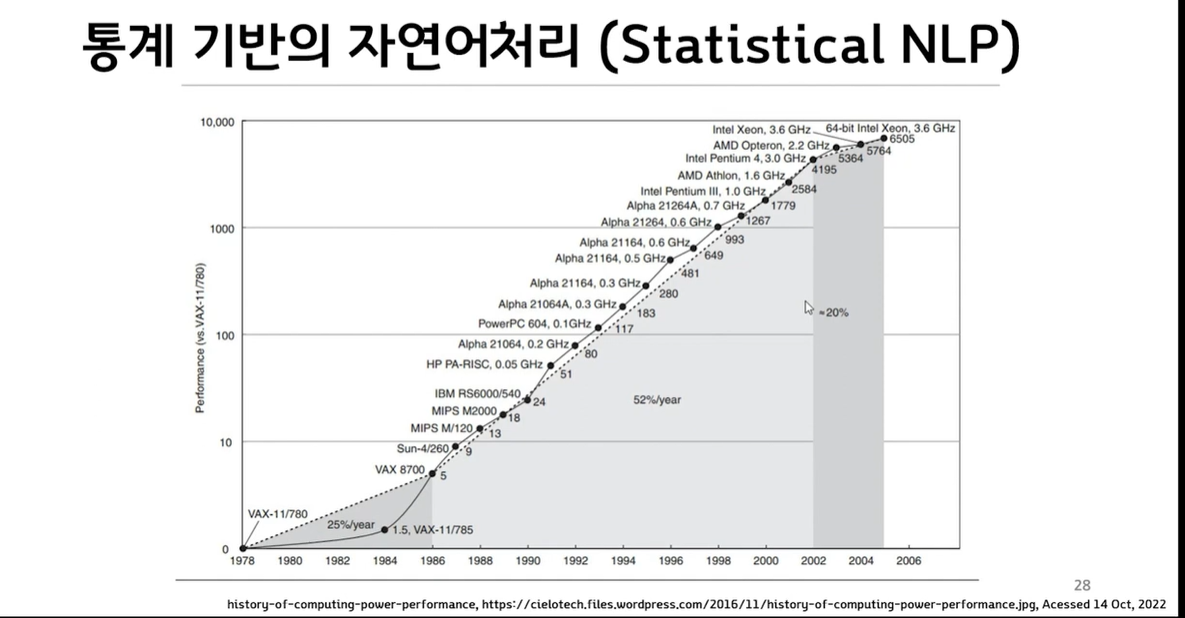

9.NLP (자연어 처리)

NLP 개념

10.NLP (Text preprocessing)

NLP - Text Preprocessing