데이터 전처리

import pandas as pd

import numpy as np

import matplotlib.pyplot as plt

import urllib.request

from collections import Counter

from konlpy.tag import Mecab

from sklearn.model_selection import train_test_split

from tensorflow.keras.preprocessing.text import Tokenizer

from tensorflow.keras.preprocessing.sequence import pad_sequences

urllib.request.urlretrieve("https://raw.githubusercontent.com/bab2min/corpus/master/sentiment/steam.txt", filename="steam.txt")

total_data=pd.read_table('steam.txt', names=['label', 'reviews'])

len(total_data)

중복을 제외한 샘플의 수 카운트

total_data['reviews'].nunique(), total_data['label'].nunique()

(99892, 2)중복있는 내용 제거

total_data.drop_duplicates(subset=['reviews'], inplace=True)

print(len(total_data))

99892훈련, 테스트 데이터 분리

train_data, test_data=train_test_split(total_data, test_size=0.25, random_state=42)

print(len(train_data))

print(len(test_data))

74919

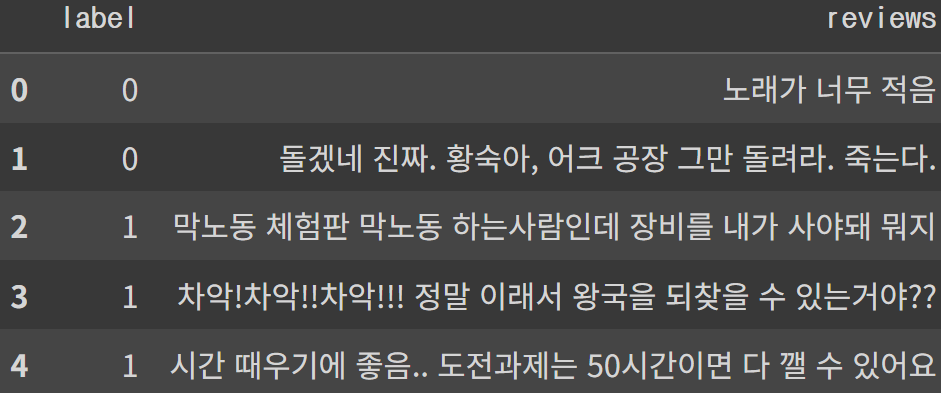

24973레이블 분포 확인

train_data['label'].value_counts().plot(kind='bar')

각 레이블 별 개수 확인

train_data.groupby('label').size().reset_index(name='count')

label count

0 0 37376

1 1 37543텍스트 전처리

한글과 공백을 제외하고 모두 제거

훈련 데이터 전처리

train_data['reviews']=train_data['reviews'].str.replace('[^ㄱ-ㅎㅏ-ㅣ가-힣 ]', '', regex=True)

train_data['reviews'].replace('', np.nan, inplace=True)

train_data.isnull().sum()

테스트 데이터 전처리

test_data.drop_duplicates(subset = ['reviews'], inplace=True) # 중복 제거

test_data['reviews'] = test_data['reviews'].str.replace("[^ㄱ-ㅎㅏ-ㅣ가-힣 ]","", regex=True) # 정규 표현식 수행

test_data['reviews'].replace('', np.nan, inplace=True) # 공백은 Null 값으로 변경

test_data = test_data.dropna(how='any') # Null 값 제거

print('전처리 후 테스트용 샘플의 개수 :',len(test_data))불용어 정의

stopwords = ['도', '는', '다', '의', '가', '이', '은', '한', '에', '하', '고', '을', '를', '인', '듯', '과', '와', '네', '들', '듯', '지', '임', '게', '만', '게임', '겜', '되', '음', '면']토큰화

Mecab을 이용해서 토큰화 작업

mecab = Mecab()

train_data['tokenized'] = train_data['reviews'].apply(mecab.morphs)

train_data['tokenized'] = train_data['tokenized'].apply(lambda x: [item for item in x if item not in stopwords])

test_data['tokenized'] = test_data['reviews'].apply(mecab.morphs)

test_data['tokenized'] = test_data['tokenized'].apply(lambda x: [item for item in x if item not in stopwords])단어와 길이 분포 확인

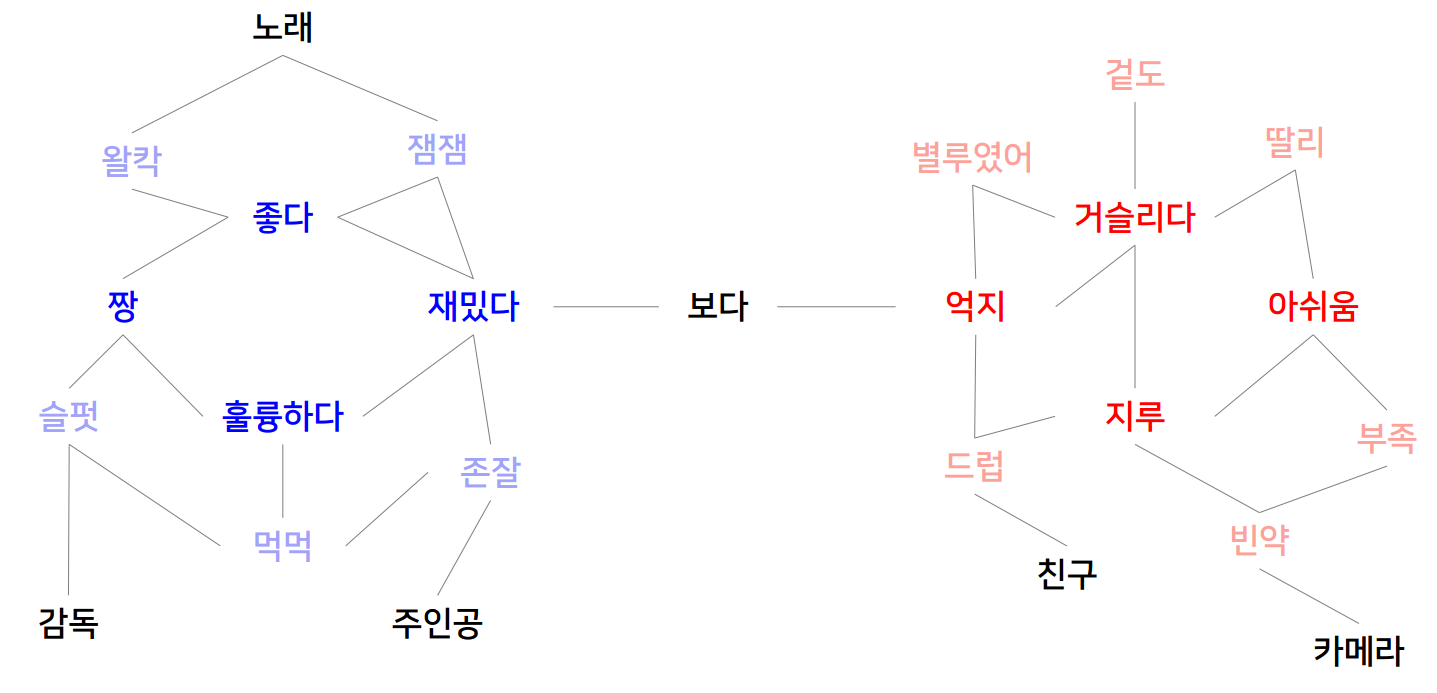

부정 리뷰의 빈도수 높은 단어

negative_words=np.hstack(train_data[train_data.label==0]['tokenized'].values)

positive_words=np.hstack(train_data[train_data.label==1]['tokenized'].values)

negative_word_count = Counter(negative_words)

print(negative_word_count.most_common(20))

[('안', 8129), ('없', 7141), ('는데', 5786), ('있', 5692), ('같', 4247), ('로', 4083), ('할', 3920), ('거', 3902), ('나', 3805), ('해', 3653), ('너무', 3522), ('으로', 3351), ('기', 3348), ('했', 3265), ('어', 3143), ('보', 2987), ('습니다', 2962), ('것', 2935), ('지만', 2911), ('좋', 2899)]긍정 리뷰의 빈도수 높은 단어

positive_word_count=Counter(positive_words)

print(positive_word_count.most_common(20))

[('있', 9987), ('좋', 6542), ('습니다', 5179), ('재밌', 4997), ('할', 4838), ('지만', 4809), ('해', 4354), ('없', 4145), ('보', 3907), ('으로', 3900), ('로', 3879), ('수', 3835), ('는데', 3825), ('기', 3592), ('안', 3368), ('것', 3362), ('같', 3356), ('네요', 3189), ('어', 3112), ('나', 3055)]감정별 길이분포 확인

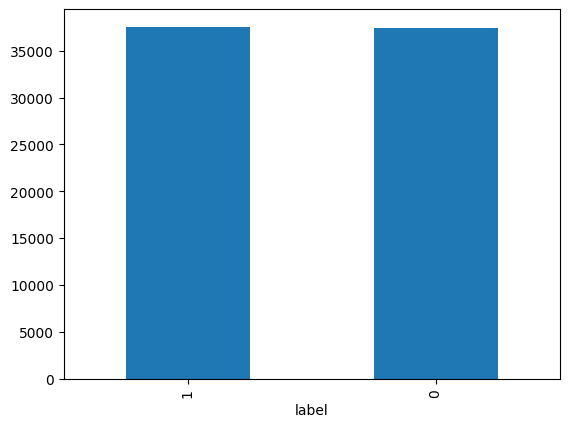

fig,(ax1,ax2) = plt.subplots(1,2,figsize=(10,5))

text_len = train_data[train_data['label']==1]['tokenized'].map(lambda x: len(x))

ax1.hist(text_len, color='red')

ax1.set_title('Positive Reviews')

ax1.set_xlabel('length of samples')

ax1.set_ylabel('number of samples')

print('긍정 리뷰의 평균 길이 :', np.mean(text_len))

text_len = train_data[train_data['label']==0]['tokenized'].map(lambda x: len(x))

ax2.hist(text_len, color='blue')

ax2.set_title('Negative Reviews')

fig.suptitle('Words in texts')

ax2.set_xlabel('length of samples')

ax2.set_ylabel('number of samples')

print('부정 리뷰의 평균 길이 :', np.mean(text_len))

plt.show()

긍정 리뷰의 평균 길이 : 14.947979650001331

부정 리뷰의 평균 길이 : 15.284701412671232

특성, 레이블 분리

X_train=train_data['tokenized'].values

y_train=train_data['label'].values

X_test=test_data['tokenized'].values

y_test=test_data['label'].values정수 인코딩

fit_on_texts: 단어의 고유한 정수 부여

tokenizer = Tokenizer()

tokenizer.fit_on_texts(X_train)등장 횟수가 1인 단어들의 비중 확인

threshold = 2

total_cnt = len(tokenizer.word_index) # 단어의 수

rare_cnt = 0 # 등장 빈도수가 threshold보다 작은 단어의 개수를 카운트

total_freq = 0 # 훈련 데이터의 전체 단어 빈도수 총 합

rare_freq = 0 # 등장 빈도수가 threshold보다 작은 단어의 등장 빈도수의 총 합

# 단어와 빈도수의 쌍(pair)을 key와 value로 받는다.

for key, value in tokenizer.word_counts.items():

total_freq = total_freq + value

# 단어의 등장 빈도수가 threshold보다 작으면

if(value < threshold):

rare_cnt = rare_cnt + 1

rare_freq = rare_freq + value

print('단어 집합(vocabulary)의 크기 :',total_cnt)

print('등장 빈도가 %s번 이하인 희귀 단어의 수: %s'%(threshold - 1, rare_cnt))

print("단어 집합에서 희귀 단어의 비율:", (rare_cnt / total_cnt)*100)

print("전체 등장 빈도에서 희귀 단어 등장 빈도 비율:", (rare_freq / total_freq)*100)

단어 집합(vocabulary)의 크기 : 32817

등장 빈도가 1번 이하인 희귀 단어의 수: 13878

단어 집합에서 희귀 단어의 비율: 42.28905750068562

전체 등장 빈도에서 희귀 단어 등장 빈도 비율: 1.2254607619437832단어 집합 크기 정의

# 전체 단어 개수 중 빈도수 2이하인 단어 개수는 제거.

# 0번 패딩 토큰과 1번 OOV 토큰을 고려하여 +2

vocab_size = total_cnt - rare_cnt + 2

print('단어 집합의 크기 :',vocab_size

단어 집합의 크기 : 18941정수 인코딩

tokenizer = Tokenizer(vocab_size, oov_token = 'OOV')

tokenizer.fit_on_texts(X_train)

X_train = tokenizer.texts_to_sequences(X_train)

X_test = tokenizer.texts_to_sequences(X_test)패딩

print('리뷰의 최대 길이 :',max(len(review) for review in X_train))

print('리뷰의 평균 길이 :',sum(map(len, X_train))/len(X_train))

리뷰의 최대 길이 : 64

리뷰의 평균 길이 : 15.115951894712957최대 길이를 60으로 지정하고 패이할 경우, 온전히 보전할 수 있는 비율

def below_threshold_len(max_len, nested_list):

count = 0

for sentence in nested_list:

if(len(sentence) <= max_len):

count = count + 1

print('전체 샘플 중 길이가 %s 이하인 샘플의 비율: %s'%(max_len, (count / len(nested_list))*100))

max_len = 60

below_threshold_len(max_len, X_train)

전체 샘플 중 길이가 60 이하인 샘플의 비율: 99.99599567532935패딩

X_train = pad_sequences(X_train, maxlen=max_len)

X_test = pad_sequences(X_test, maxlen=max_len)모델 설계

import re

from tensorflow.keras.layers import Embedding, Dense, LSTM, Bidirectional

from tensorflow.keras.models import Sequential

from tensorflow.keras.models import load_model

from tensorflow.keras.callbacks import EarlyStopping, ModelCheckpoint

embedding_dim=100

hidden_units=128

model=Sequential()

model.add(Embedding(vocab_size, embedding_dim))

model.add(Bidirectional(LSTM(hidden_units)))

model.add(Dense(1, activation='sigmoid'))

es = EarlyStopping(monitor='val_loss', mode='min', verbose=1, patience=4)

mc = ModelCheckpoint('best_model.keras', monitor='val_acc', mode='max', verbose=1, save_best_only=True)

model.compile(loss='binary_crossentropy', optimizer='rmsprop', metrics=['acc'])

history=model.fit(X_train, y_train, epochs=15, callbacks=[es, mc], batch_size=256, validation_split=0.2)테스트 데이터 정확도

loaded_model = load_model('best_model.keras')

print("테스트 정확도: %.4f" % (loaded_model.evaluate(X_test, y_test)[1]))

테스트 정확도: 0.7820리뷰 예측

def sentiment_predict(new_sentence):

new_sentence = re.sub(r'[^ㄱ-ㅎㅏ-ㅣ가-힣 ]','', new_sentence)

new_sentence = mecab.morphs(new_sentence) # 토큰화

new_sentence = [word for word in new_sentence if not word in stopwords] # 불용어 제거

encoded = tokenizer.texts_to_sequences([new_sentence]) # 정수 인코딩

pad_new = pad_sequences(encoded, maxlen = max_len) # 패딩

score = float(loaded_model.predict(pad_new)) # 예측

if(score > 0.5):

print("{:.2f}% 확률로 긍정 리뷰입니다.".format(score * 100))

else:

print("{:.2f}% 확률로 부정 리뷰입니다.".format((1 - score) * 100))sentiment_predict('노잼 ..완전 재미 없음 ㅉㅉ')

88.49% 확률로 부정 리뷰입니다.sentiment_predict('조금 어렵지만 재밌음ㅋㅋ')

98.23% 확률로 긍정 리뷰입니다.sentiment_predict('케릭터가 예뻐서 좋아요')

89.17% 확률로 긍정 리뷰입니다.