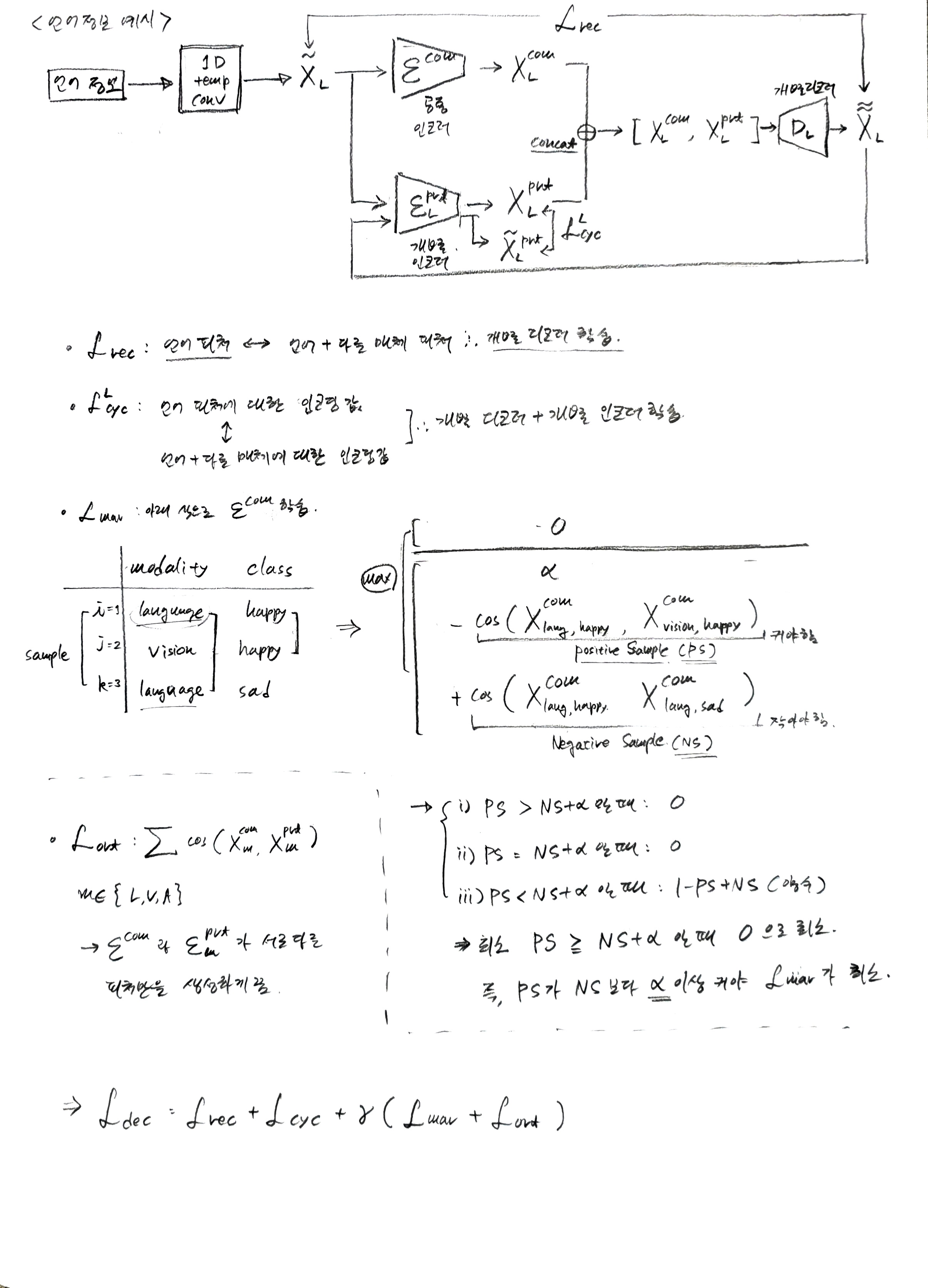

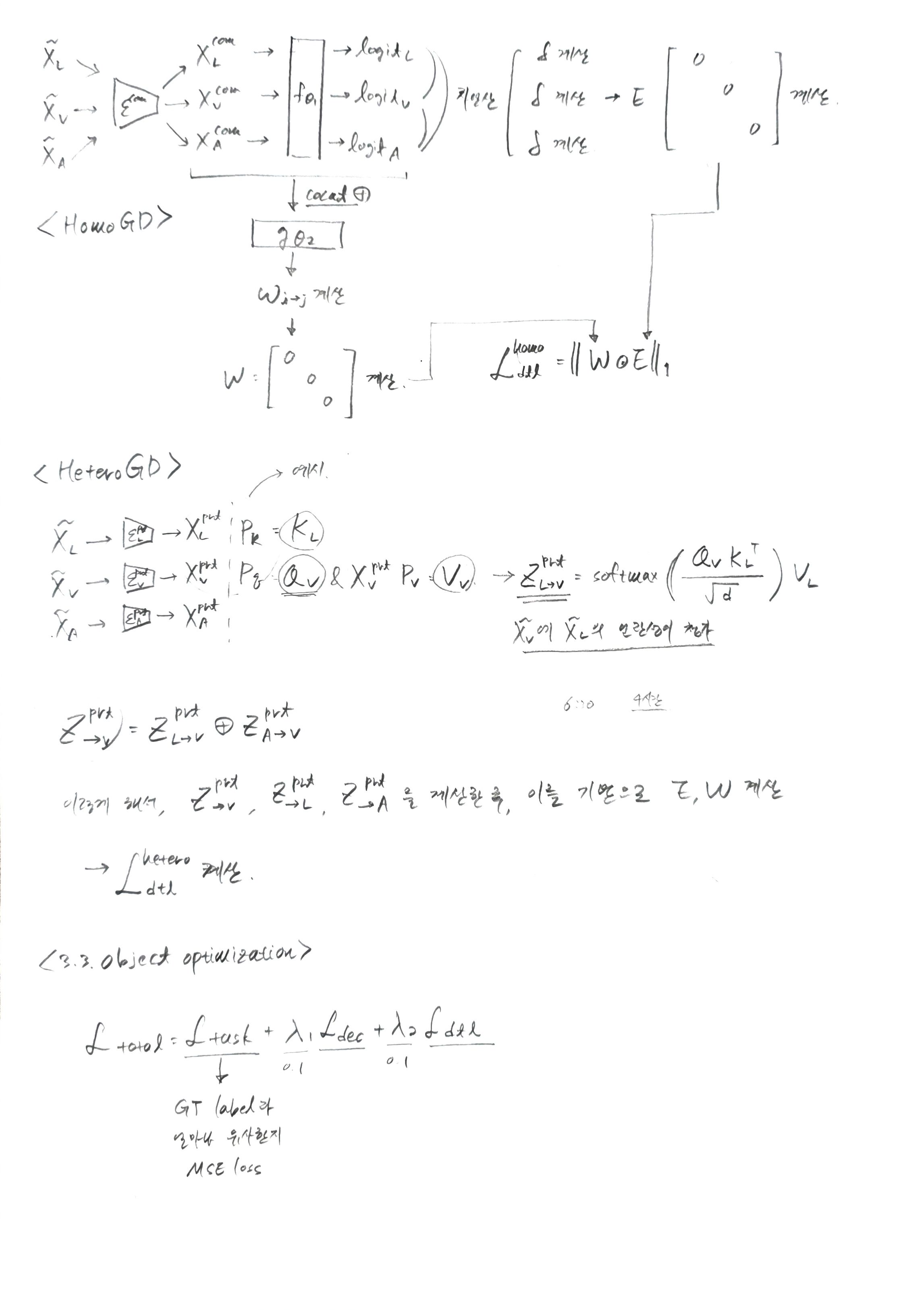

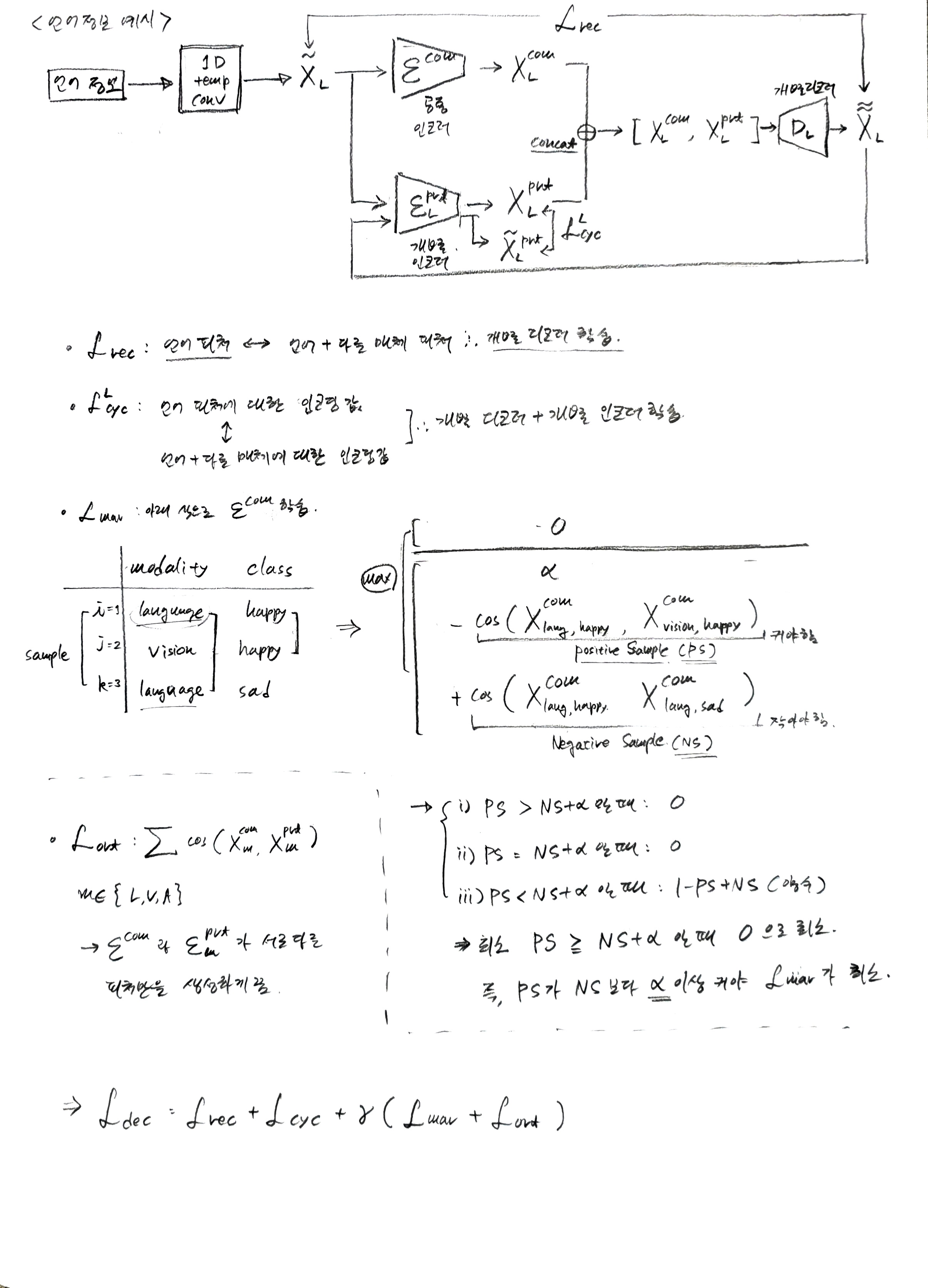

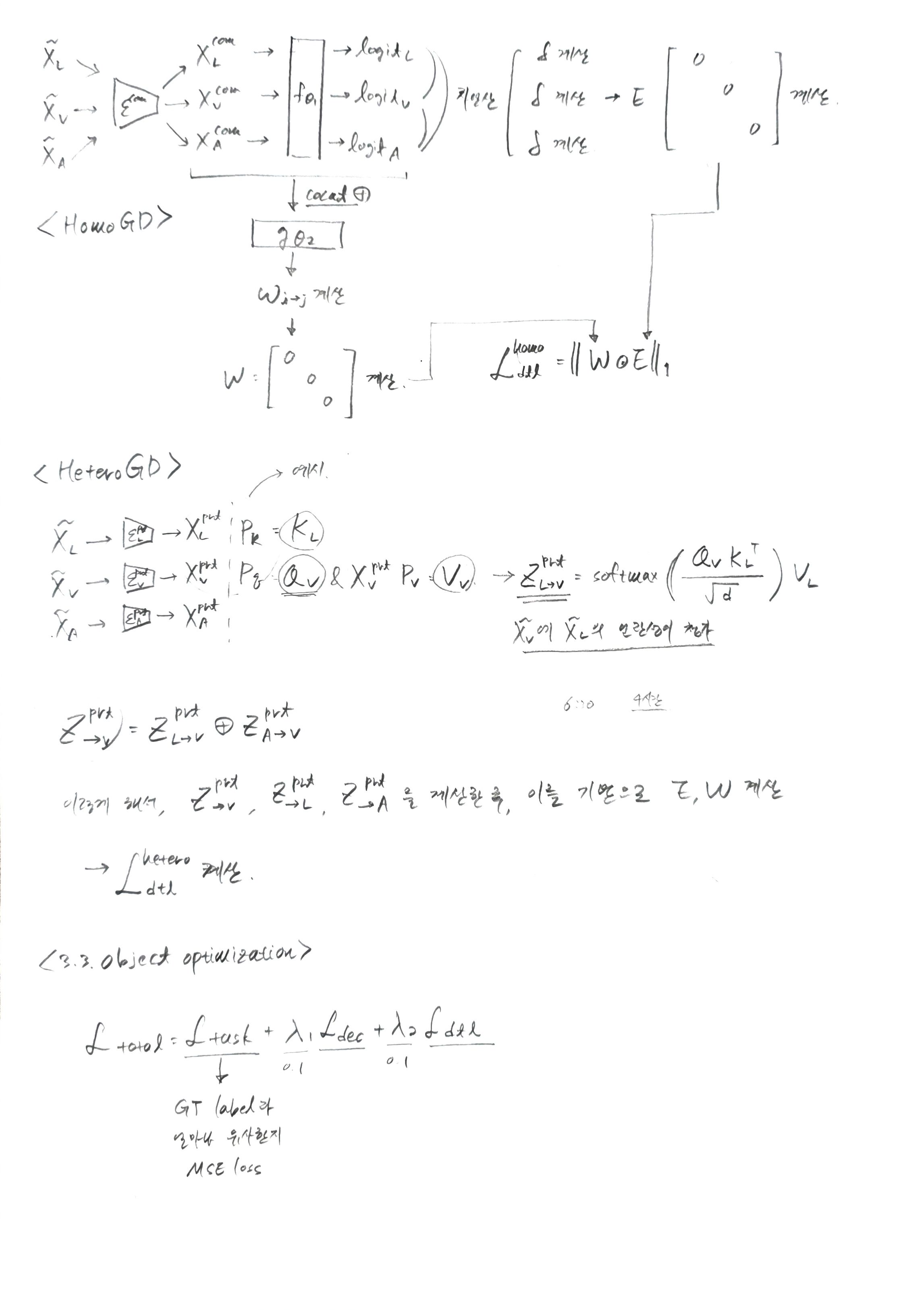

Decoupled Multimodal Distilling for Emotion Recognition

1. Introduction & Method

2. Experiments

Facial Action Unit (얼굴 동작 단위)

- 정의: 얼굴 동작 단위(FAU)는 인간의 얼굴에서 나타나는 다양한 표정을 분석하기 위해 개발된 얼굴 동작 코딩 시스템(Facial Action Coding System, FACS) A citation/reference in this paper: OpenFace: An open source facial behavior analysis toolkit에 기반한 개념이다. FACS는 심리학자 폴 에크만(Paul Ekman)과 월리스 프리센(Wallace V. Friesen)이 개발한 것으로, 얼굴 근육의 움직임을 해부학적으로 분석하여 표준화된 단위로 분류한다.

- 특징:

- 근육 움직임 기반: 각 FAU는 눈썹 올리기, 입꼬리 당기기, 볼 들어 올리기 등 특정 얼굴 근육의 움직임에 의해 발생하는 외관상의 변화를 나타낸다. 예를 들어, 'AU 6 (Cheek Raiser, 볼 들어 올림)'은 눈 아래 근육의 수축을, 'AU 12 (Lip Corner Puller, 입꼬리 당김)'는 광대뼈 근육의 수축을 의미한다.

- 보편성과 객관성: 이러한 단위들은 문화와 인종에 관계없이 인간의 감정 표현에 보편적으로 나타난다고 여겨지며, 감정을 주관적인 해석이 아닌 객관적인 얼굴 움직임으로 측정할 수 있게 한다.

- 수십 개의 단위: FACS에는 다양한 얼굴 동작을 나타내는 수십 개의 FAU가 존재하며, 이 논문에서는 총 35개의 FAU를 사용했다고 언급하고 있다. 이 35개 FAU는 얼굴의 상부, 중부, 하부 등 다양한 영역의 움직임을 포괄한다.

- 메타데이터로서의 역할: 비디오 프레임에서 추출된 FAU 정보는 원시 픽셀 데이터가 아닌, 얼굴 표정의 핵심적인 의미를 담고 있는 구조화된 수치적 메타데이터가 된다. 각 FAU의 존재 여부(이진 값) 또는 활성화 강도(연속적인 값)로 표현될 수 있다.

Facet의 얼굴 동작 단위 인코딩

- Facet의 역할: 논문에서 레퍼런스로 인용한 Facet은 실제로는

OpenFace라는 오픈소스 얼굴 행동 분석 툴킷을 의미한다. OpenFace는 비디오에서 사람의 얼굴을 감지하고, 얼굴 랜드마크를 추적하며, 표정(Action Units 포함)을 분석하는 컴퓨터 비전 라이브러리이다.

- 인코딩 과정:

- 입력: Facet(OpenFace)은 입력으로 비디오 프레임(이미지)을 받는다.

- 얼굴 감지 및 랜드마크 추적: 각 비디오 프레임에서 먼저 사람의 얼굴을 감지한다. 그 다음, 얼굴 내의 눈, 코, 입, 눈썹 등 주요 지점(랜드마크)을 정확하게 추적한다. 이러한 랜드마크의 변화는 얼굴 근육의 움직임을 반영한다.

- FAU 감지 및 정량화: 추적된 얼굴 랜드마크의 움직임과 변형을 기반으로, 미리 학습된 모델(주로 머신러닝 또는 딥러닝 기반의 분류/회귀 모델)을 사용하여 특정 FAU가 현재 프레임에 나타나는지 여부와 그 강도를 예측한다.

- 출력: 결과적으로, 각 비디오 프레임에 대해 35개의 FAU 각각에 대한 수치적 표현(예: 0~5의 강도 점수 또는 활성화 확률)을 출력한다. 이 수치적 데이터가 "인코딩된" 메타데이터이며, 이후 모델 학습에 사용될 수 있는 시계열 특징이 된다.