1.딥러닝 학습의 본질 : 무한 오답노트

딥러닝은 결국 미분을 이용해 정답을 찾아가는 과정이다.

- 순전파(Forward) : 입력 데이터를 넣고 현재 가중치()로 계산해 답을 내는 단계 (문제풀기)

- 손실 계산(Loss) : 내 답과 실제 정답의 차이를 확인. 오차

- 역전파(Backward) : 뒤에서부터 거꾸로 올라가며, 미분을 통해 각 가중치가 오차에 얼마나 기여했는지 '책임'을 묻는 단계 (범인 찾기)

- 최적화(Optimizer) : 찾은 범인(가중치)들을 수정함. 이 과정을 반복(Epoch)할수록 오차가 줄어든다.

2. ResNet (REsidual Network)

분류(Classification) 분야에 혁신을 일으킨 모델

- '깊게 쌓는 것이 무조건 좋은가?'란 질문에 대답한 모델

이론적으로는 층이 깊어질수록 더 복잡한 특징을 배울 수 있어야 함.

하지만 ResNet 이전에는 두 가지 큰 벽에 부딪혔다.

- 기울기 소실(Vanishing Grdient) : 역전파 시 미분값을 계속 곱하며 앞으로 오는데, 층이 너무 깊으면 값이 0에 가까워져 앞쪽 층이 학습을 멈춰버림.

- 망의 퇴화(Degradation) : 층이 깊어질수록 오히려 효율이 떨어져서, 얕은 모델보다 성능이 안 나오는 현상.

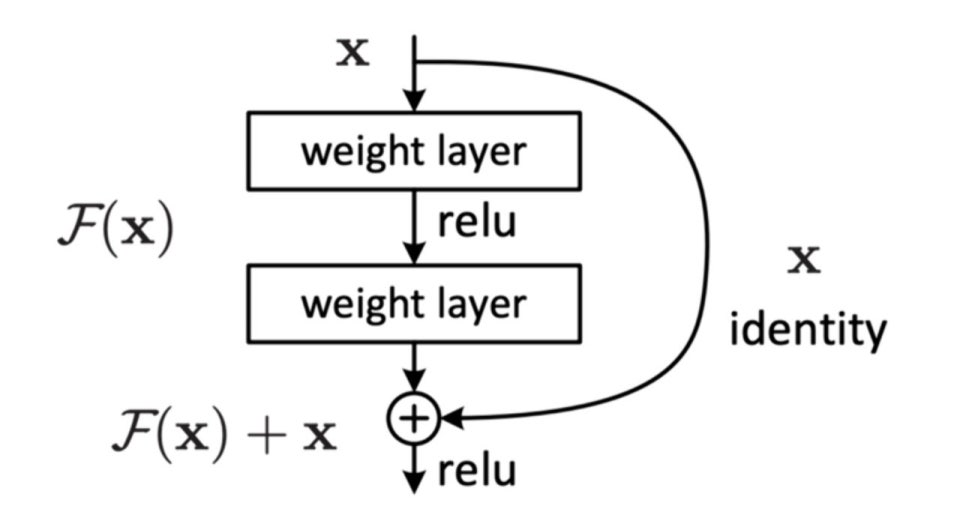

이 문제들을 해결한 것이 바로 ResNet의 Skip Connection(Shortcut)임.

✏️ Skip Connection: "하이패스" 길을 뚫어주다

다른 자료에서 말하는 '지름길'의 핵심은 불필요한 걸 버리는게 아니라, 최소한의 정보 전달 경로를 확보하는 것임.

기존 방식이 를 통째로 새로 학습해야 했다면, ResNet은 '기존 입력()은 그대로 두고, 거기서 추가로 개선할 부분()만 찾아내라' 고 구조를 바꾼 것임.

- Identity Mapping : 입력을 출력에 직접 더해주는 방식.

- 네트워크는 이제 '차이(Residual)'만 학습하면 됨. 덕분에 레이어가 아무리 많아져도 최소한 이전 레이어만큼의 성능이 보장되며, 1000층 이상의 깊은 망도 안정적으로 학습할 수 있게 되엇다.

- 용도 : 이미지 분류(Classification) 및 백본 네트워크(Backbone).

- 특징 : Skip Connection을 통한 레이어의 심층화

- 의의 : 현대 딥러닝 아키텍처의 표준(standard)이 됨.

💡 질문

1. 딥러닝이란 자체가 빅데이터를 다루는 건데 ResNet을 안쓰면 안정적이지가 못해지나?

- ResNet의 '잔차학습(Residual Learnin)'개념이 없었다면 현대 초거대 Ai(GPT등)도 존재하기 어려웠다고함.

- 문제가 2개가 있는데 이를 해결한게 ResNet.(문제는 2.깊은 망의 역설과 ResNet의 등장)

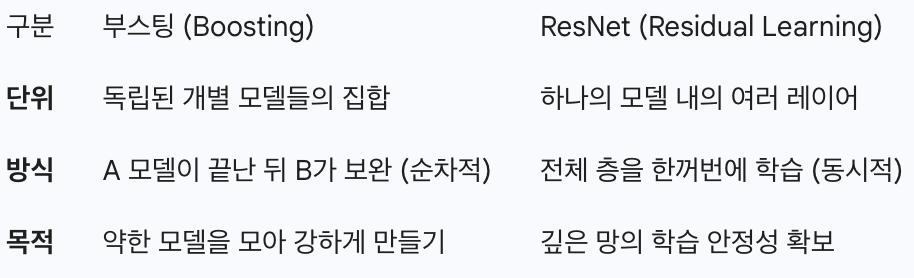

2. 차이만 학습한다는게 앙상블에 있는 부스팅이랑 뭐가 다르지? 부스팅도 이전 모델들의 실수를 다음 모델이 보완해서 학습하는거는 비슷한 학습법같은데?

- 실수(잔차)를 보완하며 학습한다 즉, 이전 단계가 해결하지 못한 나머지(잔차)에 집중한다는 건 같지만, 구현방식이나 최종목적에서 큰 차이가 남.

- 부스팅 :

독립된 개별 모델들의 집합/순차적(A끝난 뒤 B), 약한모델을 모아 강하게 만들기 - ResNet(Residual Learning)

하나의 모델 내의 여러 레이어/동시적(전체 층한꺼번에)/깊은망의 학습 안정성 확보를 위해.

3. 왜 분류(Classification)에 깊은 레이어가 필요할까?

우리가 보는 이미지가 컴퓨터 입장에서는 '숫자의 바다'일 뿐이라서, 그 안에서 추상적인 개념(개,고양이)를 뽑아내려면 엄청나게 복잡한 단계가 필요하기 때문에

-

선 -> 면 -> 형체 -> 개념의 단계 (계층적 학습)

컴퓨터는 이미지를 볼때 픽셀의 밝기 값만 본다. 이 숫자들로부터 '강아지'라는 정답을 맞히기 위해서는 단계별 학습이 필요함.- 초반 레이어(얕은 층) : 아주 단순한 점, 선, 대각선 같은 특징을 찾는다.

- 중반 레이어(중간 층): 선들이 모여 만든 동그라미, 삼각형, 질감(털모양, 가죽 모양)등을 이해한다.

- 후반 레이어(깊은 층) : 이것들을 조합해 '귀의 모양', '눈의 위치', '코의 생김새'같은 구체적인 부위를 인식함.

- 마지막 레이어(마지막 층) : 이 모든 부위가 모였으니 이것은 골든리트리버다!라고 결론을 내림.

- 층이 깊을 수록 더 복잡하고 고차원적인 특징(예:강아지 품종차이 등)을 더 잘 구별해낼수 있음.

- 다양한 환경에 대한 불응 (불변성, Inveriance)

분류 모델은 똑같은 강아지라도 밝은 곳에 있을 때, 어두울때, 옆모습일때, 거꾸로 매달려 있을때 동일한 강아지로 인식해야함. ResNet처럼 층이 깊으면 이런 복잡한 변화들을 층마다 나누어 처리하며 훨씬 견고한 분류성능을 낸다.

요약

ResNet은 단순히 층을 깊게 쌓은 모델이 아니라, '잔차 학습'이라는 개념으로 딥러닝의 고속도로를 뚫어준 모델임. 이 구조 덕분에 현대의 GPT 같은 초거대 AI도 탄생할 수 있음. 현대 딥러닝 아키텍처의 진정한 표준(Standard)이라 불릴만하다.