[논문 리뷰] Deep learning enabled semantic communication systems - 3편

Numerical Results

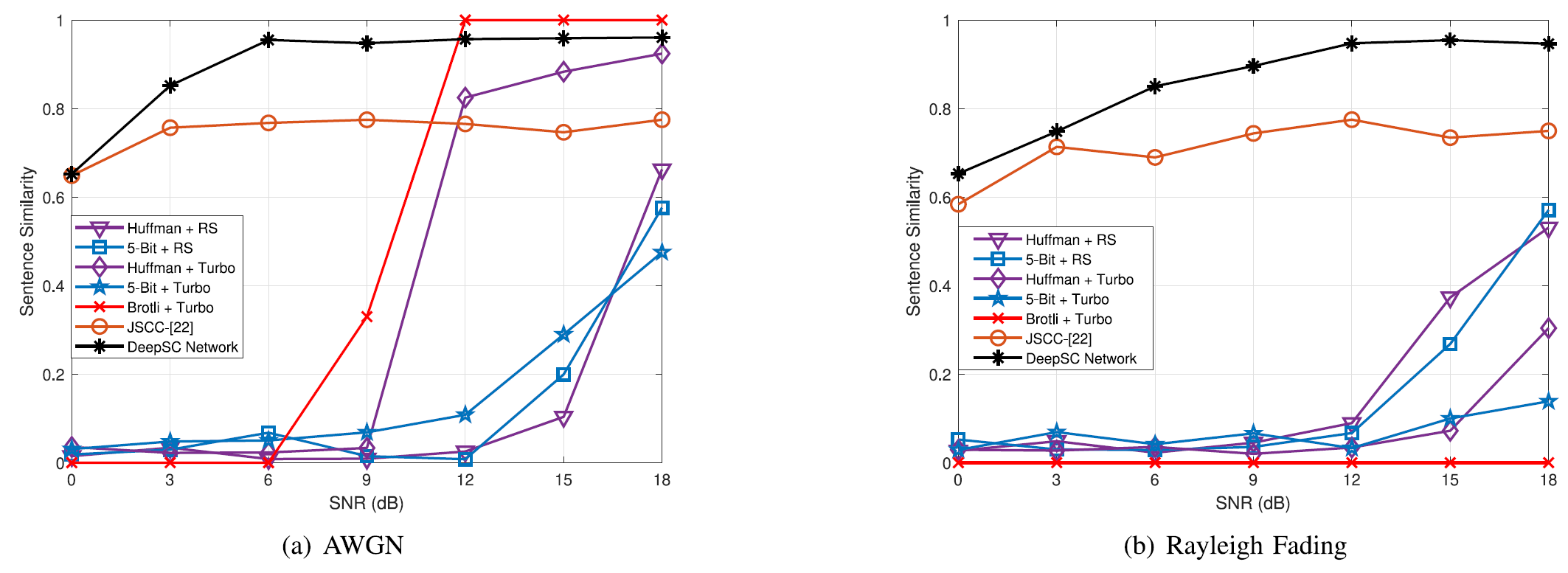

본 part에서는 다른 DNN 알고리즘을 사용한 DeepSC와 기존의 source/channel coding 방식을 AWGN 및 Rayleigh fading channel 상황에서 비교할 것이다. 이때 우리는 모든 scheme에 대해 perfect CSI 상황을 가정하자.

Simulation Settings

사용한 dataset은 proceedings of European Parliament 이다. 이는 약 2백만 개의 문장과 5천 3백만 개의 단어로 구성되어 있으며, 미리 4개에서 30개의 단어로 이루어진 문장으로 전처리 되어 있다.

Model에 대한 자세한 setting은 Table 1을 참고하자.

Table 1: Semantic network의 setting

Baseline으로는 BLSTM(Bi-directional LSTM) layer를 사용한 DNN based joint source-channel coding(JSCC)과 기존의 방식(source/channel coding 기법을 각각 고름)을 채택했다. 성능 평가 지표는 BLEU와 sentence similarity 이다.

(자세한 실험 setting이 궁금하면 논문을 참고하자. 여기서는 graph와 결론 위주로 설명해놓았다.)

Basic Model

먼저 같은 수의 transmitted symbol들을 사용했을 때에 대한 BLEU score 이다.

AWGN channel에 대한 상황이다. SNR이 12dB 보다 큰 영역에서 traditional approach가 더 나은 성능을 보였다. 낮은 SNR 영역에서는 DL 기반 방식들(DeepSC & JSCC)이 더 좋은 것을 알 수 있었다.

Rayleigh fading channel에 대해서는 DL 기반 방식들이 기존의 방법들보다 좋은 성능을 보였다. 2-grams와 4-grams에 대해서는 RS coding이 turbo coding 보다 낫다는 것도 확인할 수 있었다.

또한 주목할 점은, DeepSC가 adjacent words에 대해서도 decoding 성능이 좋았다는 것이다. (이는 4-grams의 결과를 통해 알 수 있다)

먼저 (a)를 통해 제안한 metric이 BLEU score와 같은 경향성을 보여준다는 것을 확인했다.

주목할만한 것은 Huffman + Turbo (보라색 선)의 결과이다. 비록 해당 방식을 통해 SNR = 9 근처에서 1-gram BLUE score accuracy은 20%로 얻을 수 있었지만, sentence similarity는 0에 가까웠다. 따라서 새롭게 제안한 기준을 통해, text의 의미를 이해할 수 없는 상태가 되었다는 것을 알 수 있었다.

이러한 경향성은 (b)에 대해서도 동일했다.

Mutual Information

SNR이 증가함에 따라 mutual information이 증가하는 것을 확인할 수 있었다.

SNR vs 1-gram BLEU score, SNR = 12.

이를 통해 NNs가 stable state로 수렴해도 최적값이 아닐 수 있음을 확인할 수 있다. 학습 과정에서 mutual information은 model이 잘 수렴했는지 확인하는 도구로 사용될 수 있다.

Transfer Learning For Dynamic Environment

여기서는 channel이 바뀌는 상황과 background knowledge가 바뀌는 상황 (총 두 가지 경우)에 대해 transfer learning이 잘 동작하는지 확인해보았다.

Same AWGN channel + Different background knowledge.

(a)를 통해 수렴에 필요한 epoch 수가 30에서 5로 감소한 것을 확인했다.

(b)를 통해서는 transfer learning이 model의 성능 향상에 도움을 줄 수 있다는 사실을 확인했다.

Same background knowledge + Different channel (erasure & Rician).

이전 case와 마찬가지로 BLEU 성능이 비슷하게 유지되는 것을 확인할 수 있다. 따로 첨부되진 않았지만, 달라진 두 channel 모두에 대해 학습이 진행되는 속도가 빨라지는 것도 확인할 수 있었다.

Complexity Analysis

DL을 기반으로 한 방법들의 runtime이 기존의 방식들보다 더 낮은 것을 확인할 수 있었다.

Average sentence processing runtime

DeepSC

JSCC

RS coding

Turbo coding

Conclusion

본 논문에서는 text transmission을 위한 semantic/channel coding을 동시에 수행하는 system인 DeepSC를 소개했다.

DeepSC에서는 input text의 길이와 output symbol이 variable이고, 더 높은 data rate을 얻기 위해 mutual information이 loss function의 일부로 반영된다. 또한 deep transfer learning을 통해 다른 통신 환경에서도 빠르게 학습이 진행될 수 있도록 하였고, sentence similarity라는 metric을 제시하여 사람의 판단과 비슷한 결과를 만들 수 있었다.

한편 simulation 결과를 통해, 특히 낮은 SNR 상황에서의 text transmission task에 대해, DeepSC이 잘 적용될 수 있다는 것을 확인할 수 있었다. 따라서 제한된 spectrum 자원 내에 수많은 기기가 연결되어 있는 상황에서 이는 매우 유용하게 사용될 수 있을 것이다.

마지막으로 semantic communication system과 conventional communication system의 차이를 정리하면 다음과 같다.

- Different data processing domains.

Semantic system은 semantic domain에서 data를 처리, conventional system은 entropy domain에서 data 압축을 수행한다.- Different communication targets.

Conventional system은 정확한 data 복원에 집중한다. 하지만 semantic system은 transmission target 혹은 decision을 제공한다.- Different system designs.

Conventional system에서는 기존의 transceiver에 포함되어 있는 information transmission module만을 design 및 optimize 한다.

반면, semantic system은 source information 부터 application의 final target에 이르는 전체 information processing block을 한번에 설계한다.

참고로 이 논문에서 제안한 semantic communication의 concept을 가지고, text와 speech transmission을 위한 L-DeepSC, DeepSC-S 같은 model도 개발했다.

Reference

Xie, Huiqiang, et al. "Deep learning enabled semantic communication systems." IEEE Transactions on Signal Processing 69 (2021): 2663-2675.

DeepSC - PyTorch Official code.