Scaling Laws

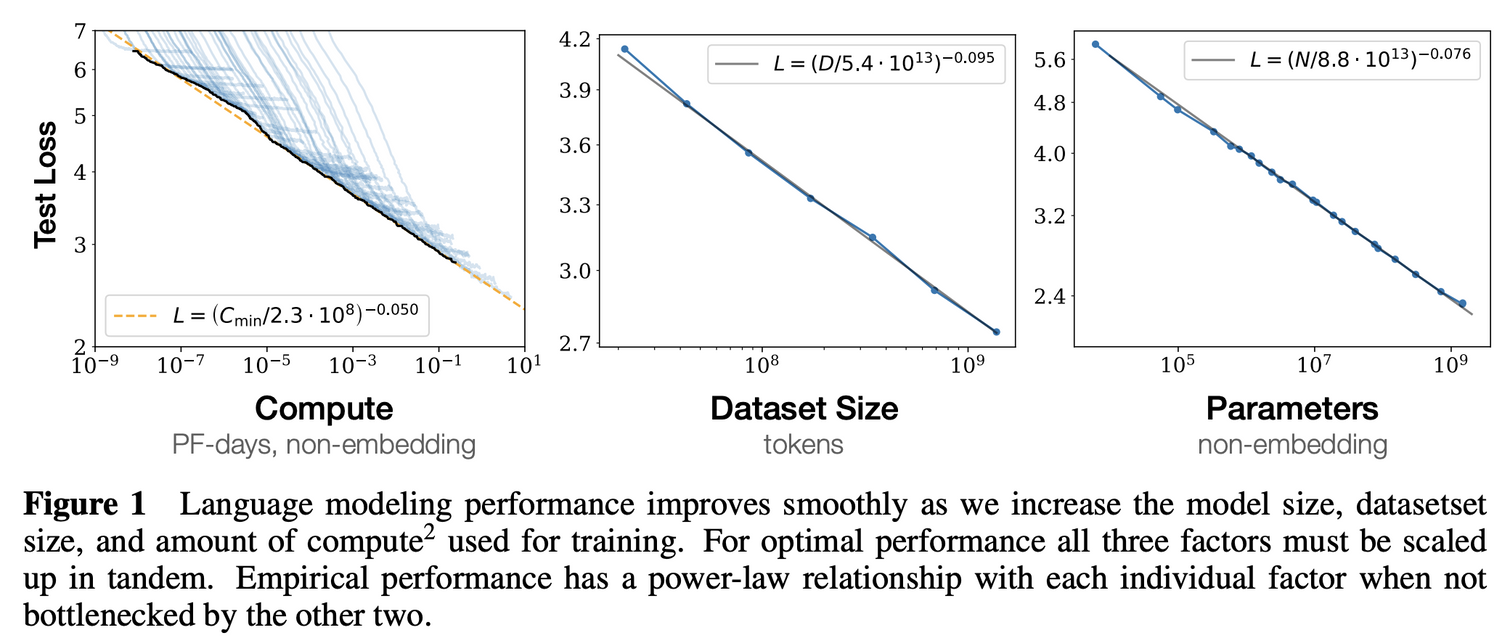

1.[Paper Review] Scaling Laws for Neural Language Models

Our results strongly suggest that larger models will continue to perform better, and will also be much more sample efficient

2023년 8월 22일

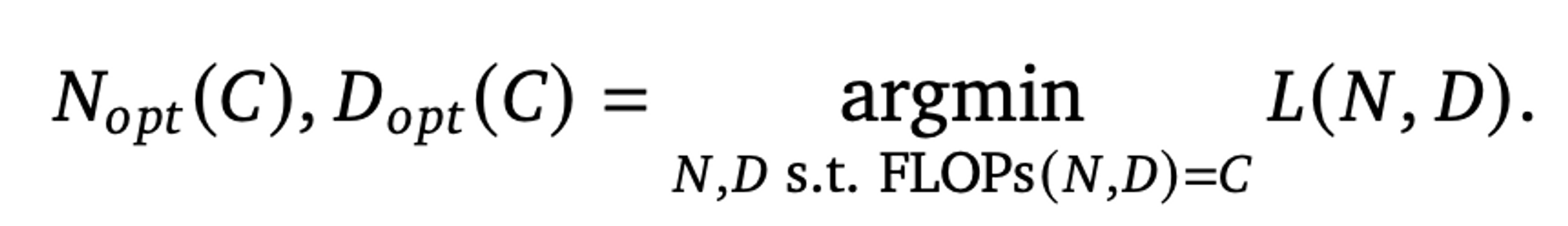

2.[Paper Review] Training Compute-Optimal Large Language Models (NeurIPS 2022)

Transformer 구조의 LM 에서 주어진 compute budget (FLOPs 로 표현) 에 대한 optimal model size 와 tokens 간의 관계에 대한 실험 연구

2023년 8월 29일