기존 GAN에서 Loss 함수를 개선한 것입니다.

WGAN의 논문에는 수학과 증명에 관한 내용이 매우 많은데, 일체 제외하고 추상적으로만 설명 하겠습니다.

기존 GAN의 문제점

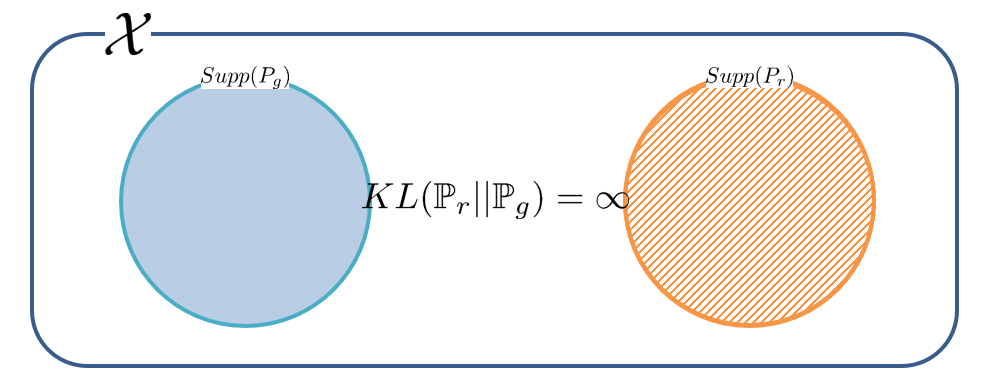

기존 GAN은 Loss 계산해서 Binary cross Entropy를 사용하는데 이는 Kullback-Leibler(KL) Divergence와 연관있는 LossFunction으로 사용되었습니다. 이 계산 방식을 간단히 설명하자면,

.png)

빨간 원과 노란 원이 겹치는 정도라고 보면 될 것입니다. 진짜 이미지가 생성하는 데이터 분포와 Generator의 가짜이미지가 생성하는 분포가 얼마나 겹치는가 를 통해서 Loss를 판단하게 되는데, 원이 겹치면 계산 할 수 있는데 아예 겹치지 않으면 계산 값이 무한대로 발산하게 됩니다.

따라서 진짜 이미지와 가짜 이미지가 생성한 데이터의 분포가 너무 다르다면 Generator의 학습을 어느 방향으로 해야할지 피드백을 해줄 수가 없게됩니다.

WGAN은 이 문제를 해결하기 위해 데이터 분포간의 측정 방법으로 Wasserstein distance를 사용하는 것을 제안합니다. 기조

.png)

.png)

변경점

- Loss Function: Binary Cross Entropy → Wasserstein loss

- Discriminator에 Gradient Panalty를 추가

- Discriminator에 weight clipping 및 BN 제거