[Abstract]

Adversarial learning

- robust한 네트워크 훈련 가능

- 복잡한 샘플 생성 가능

- domain distribution간의 차이 줄일 수 있고, 일반화 가능함.

Prior generative 접근

- 설득력 있는 시각화 보여주지만, 작은 shift만 다룰 수 있음.

Prior discriminative 접근

- 큰 shift를 처리할 수 있지만, 모델에 얽매인 weight을 부과하고 GAN기반 loss를 활용하지 않음.

@ discriminative modeling, untied weight sharing, GAN loss를 사용한 프레임워크

@ Adversarial Discriminative Domain Adaptation(ADDA) 제안

1. Introduction

[2가지 challenges]

-

하나의 모델을 서로 다른 데이터에 사용하는 것은 dataset bias와 domain shift 때문에, 일반화하기 어려움.

-

fine-tuning은 충분한 양의 라벨 데이터가 필요하다는 한계점 있음.

[Domain adaptation]

-

Domain adaptation이 domain shift의 영향을 완화해줌.

-

최근 Domain adaptation 방법들은 2개의 domain 모두를 하나의 feature space로 맵핑시킴.

-

domain shift 측정 지표에는 maximum mean discrepancy, correlation distances가 있음.

-

비대칭 매핑은 대칭 기능보다 낮은 수준의 기능의 차이를 더 잘 모델링할 수 있음.

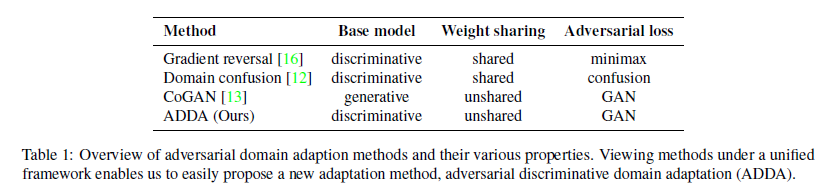

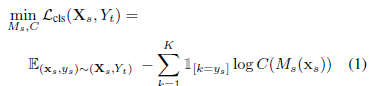

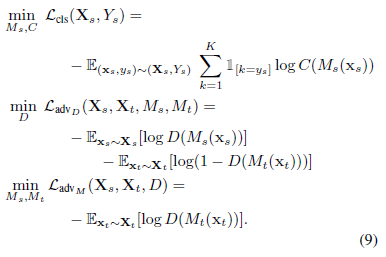

3. Generalized adversarial adaptation

-

source classification model

-

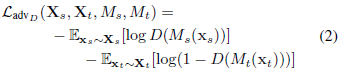

domain adaptation (source or target domain 구분)

-

source and target mappings

3.1. Source and target mappings

-

source와 target domain mapping의 특정 매개변수화

-

discriminative task를 사용하면 입력 이미지가 차별적 작업에 유용한 특징 공간에 맵핑됨.

-

source에서 맵핑된 값과 target에서 맵핑된 값이 하나의 discriminator에서 사용되기 위해 유사해야 함.

3.2. Adversarial losses

- 는 변하지 않기 때문에

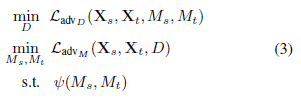

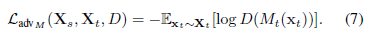

4. Adversarial discriminative domain adaptation

-

discriminative base model을 선택함

- 샘플을 생성하는데 필요한 많은 매개변수가 discriminative adaptation task에 관련이 없다고 가정하기 때문

-

가중치를 풀어서 독립적인 source and target mapping을 하기로 함.

-

이는 도메인별 특징 추출을 학습할 수 있기 때문에 더 유연한 학습 패러다임임.

-

그러나, target domain에는 레이블과 가중치 공유가 없기 때문에, 초기화와 훈련에 유의해야 함.

-

따라서, 사전 훈련된 source model을 target space의 초기화로 사용하고 적대적 훈련으로 업데이트함.

-

이렇게 학습한 비대칭 맵핑을 사용함.

-

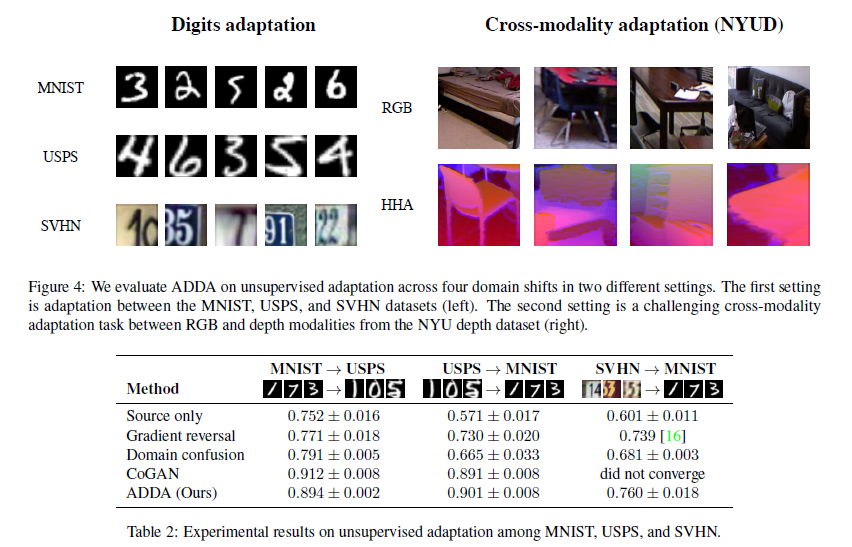

5. Experiments

- 사용한 데이터셋

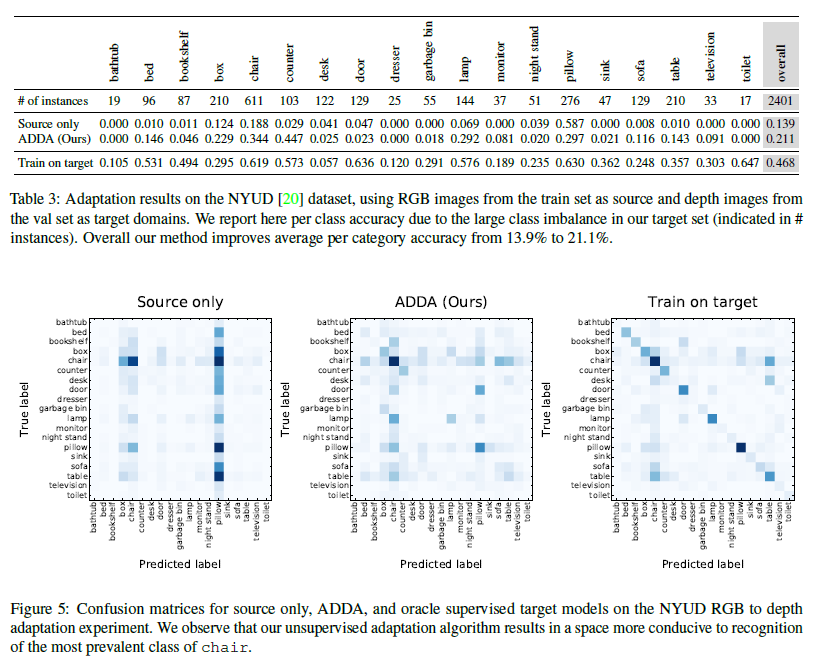

: MNIST, USPS, and SVHN + NYUD(-> adaptation across modalities)

-> generator를 사용한 CoGAN은 domain shift가 큰 데이터의 경우 아예 학습이 불가능함.

-> source only heatmap을 보면 target domain과 domain shift가 심한 것을 확인할 수 있음

-> 이를 ADDA를 사용하면 완화함.

6. 결과 해석

-

서로 다른 데이터에 대해 transfer learning을 사용할 경우, 타겟 데이터에 대해 성능을 높이기 위해서는 Adversarial Adaptation이 필요하다.

-

fine tuning 방법만 사용할 경우, 서로 다른 도메인을 학습한다는 domain adaptation 기법이 추가적으로 필요하다.

-

서로 다른 네트워크를 경쟁하며 학습할 때 discriminative learning을 사용하면 좋을 듯 하다.

-

GAN의 궁극적인 목적은 "생성"인데, GAN 구조에서 discriminator만 사용하는게 타당할까?

-> 그래서 한쪽 네트워크(target)를 generator 취급하잖아

-> 그럼 target cnn을 generator 취급하는 거고, target cnn이 기존 cnn(source cnn)의 결과값과 다른 결과값을 뱉도록 노력하는 방향으로 학습이 진행됨.

-> 그럼 source와 target domain의 공통된 부분은 최대한 배제하고 차이점 위주로 학습을 하겠네?

(-> 아닌가, pretrained parameter 쓰니깐 공통된 부분 남아있을라나)

-> 그럼 결과적으로 target domain을 잘 분류하는 방향이 아닌 source domain과 구분되는 이미지를 추출하는 방향으로 학습해서 성능면에서 한계가 있지 않을까

-> 그럼 어떻게 하는게 좋을까? 1. 이전에 학습하여 얻은 지식을 보존하면서, 2. 이전과 다른 부분은 학습하게