[2018 preprint] An empirical evaluation of generic convolutional and recurrent networks for sequence modeling

Paper review

목록 보기

21/21

TCN

Bai, S., Kolter, J. Z., & Koltun, V. (2018). An empirical evaluation of generic convolutional and recurrent networks for sequence modeling. arXiv preprint arXiv:1803.01271.

Motivation

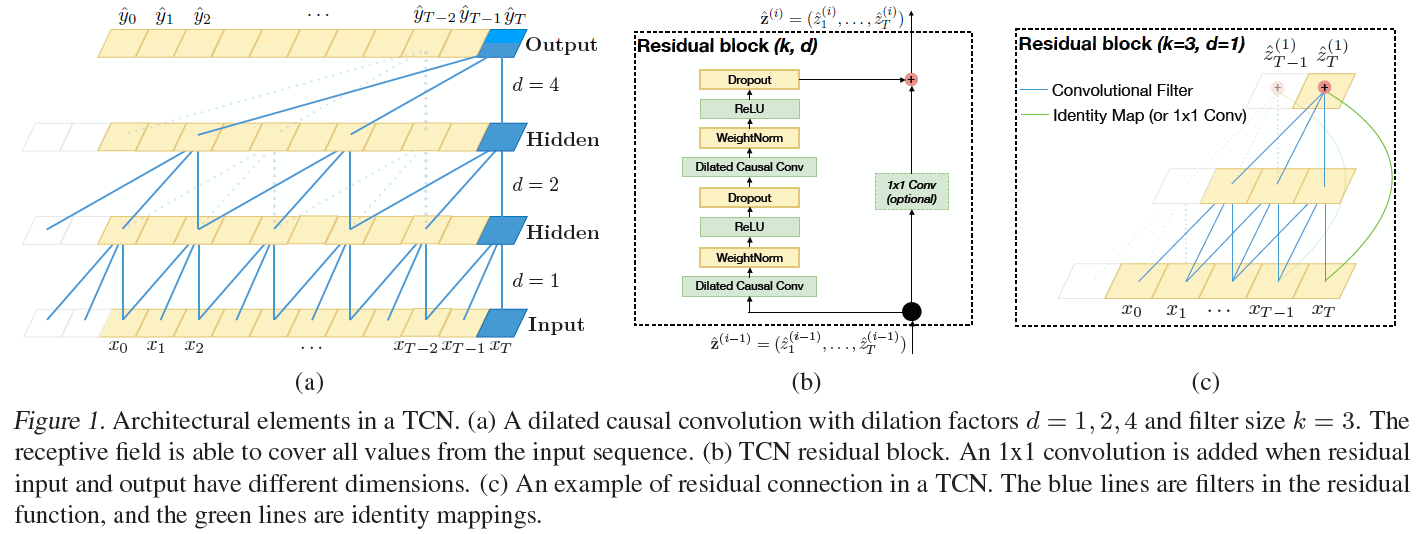

- 시퀀스 모델링에서 convolution architecture가 recurrent networks를 능가함을 보여줌.

- convolution의 locality를 잡는 특성과 dilation을 이용해 receptive field를 넓힌 WaveNet의 등장 이후 1차원 convolution을 시퀀스 데이터에 적용하려는 시도가 많았음.

Method

Result

- convolution을 사용하므로 같은 파라미터에 대해 병렬적으로 연산되므로 RNN에 비해 연산이 빠름.

- 모델의 깊이와 dilation으로 receptive field 크기를 유연하게 조절 가능함.