AI

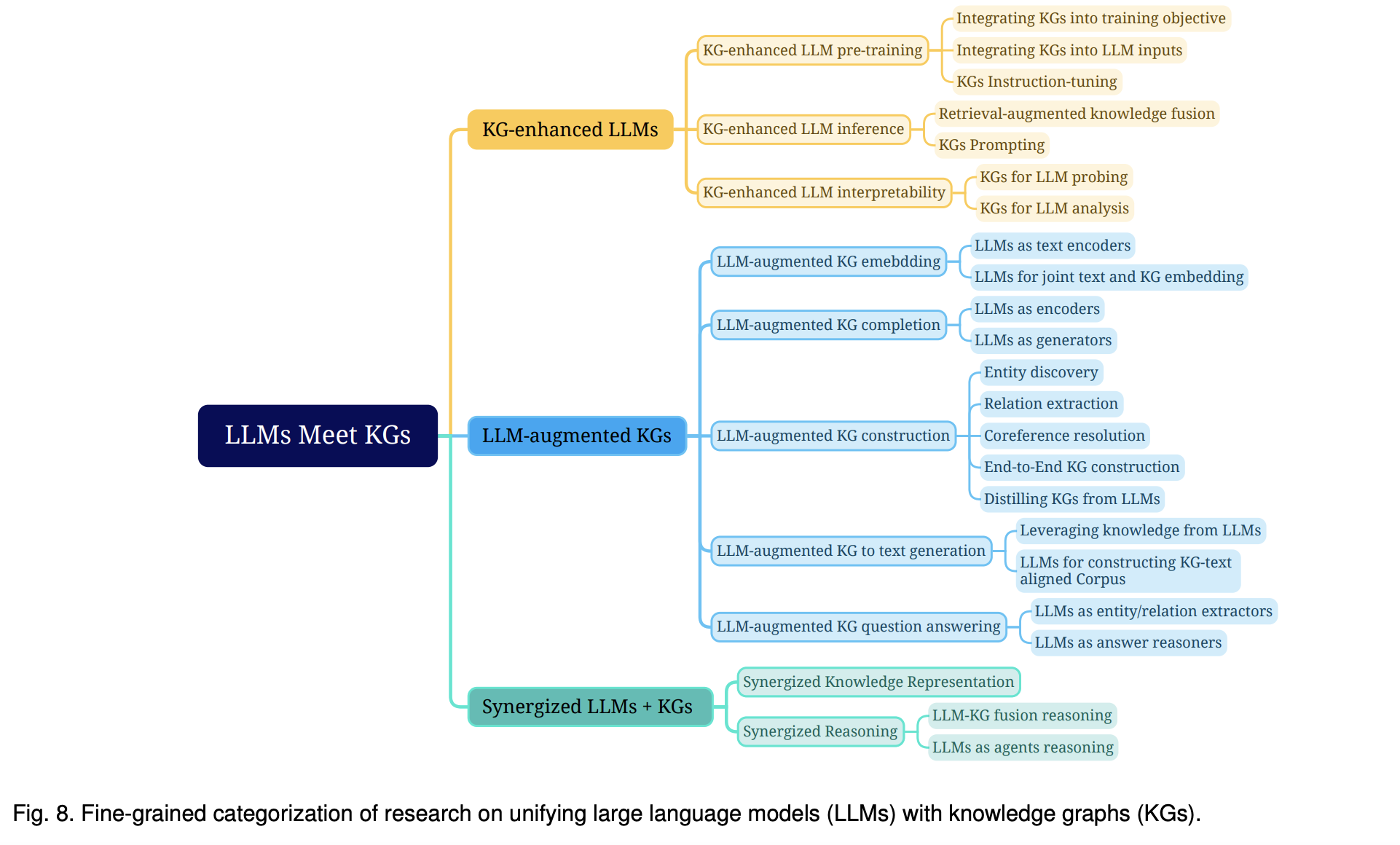

1.Unifying Large Language Models and Knowledge Graphs: A Roadmap

본 논문이 등장한 배경 : LLM 1.LLM의 사실적 지식 부족 => 사실과 다른 진술 생성해서 환각 현상을 겪음 LLM은 블랙박스 모델로서 해석 가능성이 부족함(매개변수 안에 지식을 암묵적으로 표현하기 때문) KG 엄청난 양의 사실을 트리플 (head entit

2024년 9월 20일

2.Give Us the Facts: Enhancing Large Language Models with Knowledge Graphs for Fact-aware Language Modeling

Give Us the Facts 논문 리뷰

2024년 10월 3일

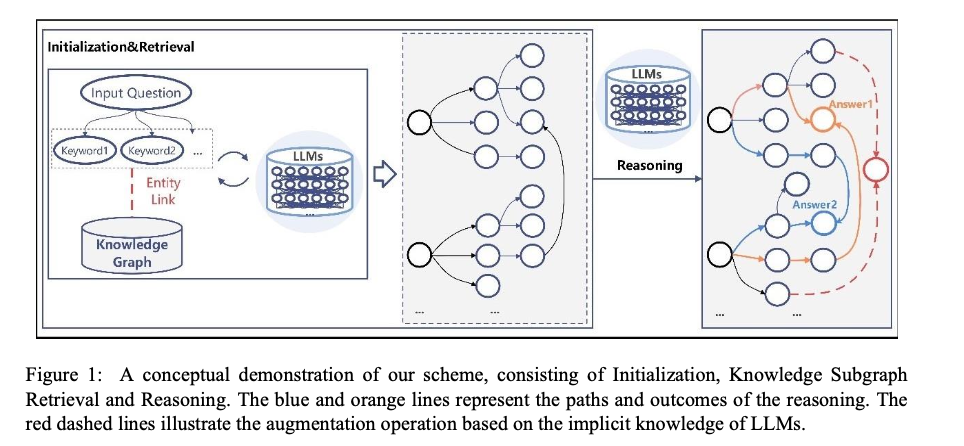

3.An Enhanced Prompt-Based LLM Reasoning Scheme via Knowledge Graph-Integrated Collaboration

https://arxiv.org/pdf/2402.04978 본 포스팅은 International Conference on Artificial Neural Networks 2024 에 게재된 논문 리뷰입니다. 수정 예정

2024년 10월 4일