1. 머신러닝(Machine Learning)이란?

-> 입력과 출력을 통해 규칙을 찾고, 새로운 입력이 들어왔을 때도 출력을 잘 예측하도록 하는 방법

머신러닝 모델은 입력과 출력 사이의 관계를 내부적으로 학습하지만, 그 과정이 사람이 이해하기 쉬운 규칙 형태로 드러나지 않는 경우가 많음.

이 때문에 머신러닝은 종종 블랙박스(Black Box) 로 불림.특히 트리 앙상블이나 딥러닝과 같은 복잡한 모델은 높은 예측 성능을 보이는 대신, 왜 그런 예측이 나왔는지 직관적으로 설명하기 어렵다는 한계를 가짐.

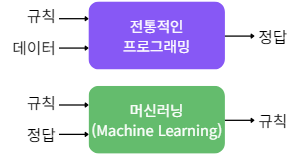

2. 전통적인 프로그래밍 VS 머신러닝

| 구분 | 전통적인 프로그래밍 | 머신러닝 |

|---|---|---|

| 기본 개념 | 사람이 명시적인 규칙을 직접 작성 | 데이터로부터 규칙을 자동 학습 |

| 문제 유형 | 규칙이 명확한 문제에 강함 | 규칙을 명시하기 어려운 문제에 강함 |

| 예시 | 90점 이상 → A 80점 이상 → B |

이메일 → 스팸/정상 예측 거래 → 사기 확률 예측 |

| 규칙 변화 | 규칙이 바뀌면 코드를 직접 수정해야 함 | 새 데이터로 재학습하여 대응 가능 |

| 예외 처리 | 예외가 많아지면 로직이 깨지기 쉬움 | 예외도 패턴으로 흡수 가능 |

| 성능 평가 | 정답/오답 정도로만 판단 | Accuracy, F1, AUC 등 수치로 성능 측정 |

| 확장성 | 문제 복잡해질수록 유지보수 어려움 | 데이터가 쌓일수록 성능 개선 가능 |

| 주요 리스크 | 규칙 누락, 하드코딩 | 과적합, 편향, 데이터 누수 |

| 해석 가능성 | 로직이 명확하여 설명 쉬움 | 복잡한 모델은 블랙박스가 되기 쉬움 |

| 대표 사용처 | 계산 로직, 정책 규칙, 단순 판별 | 추천, 검색, 사기 탐지, 예측 문제 |

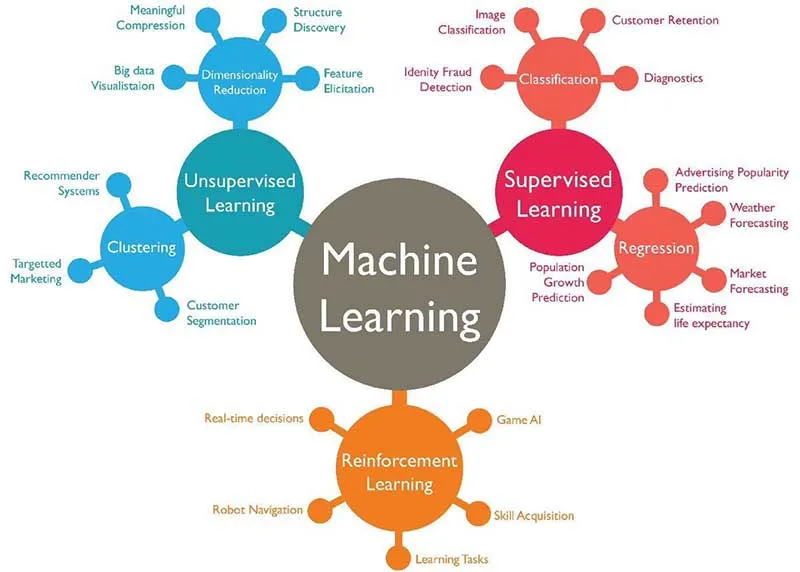

3. 머신러닝 종류

| 구분 | 지도학습 (Supervised Learning) |

비지도학습 (Unsupervised Learning) |

준지도학습 (Semi-supervised Learning) |

강화학습 (Reinforcement Learning) |

|---|---|---|---|---|

| 정답(Label) | 있음 | 없음 | 일부만 있음 | 없음 (보상만 존재) |

| 목적 | 입력에 대한 정답 예측 | 데이터의 구조·패턴 발견 | 적은 정답으로 학습 성능 향상 | 누적 보상을 최대화하는 행동 학습 |

| 대표 문제 유형 | 분류, 회귀 | 클러스터링, 차원 축소, 이상 탐지 | 라벨 부족 문제 | 의사결정, 정책 학습 |

| 주요 기법 |

로지스틱 회귀 결정 트리 랜덤 포레스트 XGBoost |

K-means DBSCAN PCA Isolation Forest |

Pseudo-labeling Self-training Label Propagation |

Q-Learning SARSA Policy Gradient DQN |

| 데이터 예시 |

이메일 + 스팸 여부 집 정보 + 가격 |

고객 행동 로그 사용자 특성 데이터 |

일부 라벨된 데이터 다수의 미라벨 데이터 |

환경 상태 행동과 보상 |

| 활용 예시 |

스팸 분류 사기 거래 예측 가격 예측 |

고객 세그먼트 분석 데이터 탐색(EDA) |

의료 데이터 분류 이미지 분류 |

게임 AI 로봇 제어 자율주행 |

- 추천시스템은 지도학습이나 비지도학습과 같이 특정 학습 방식이 아니라, 사용자에게 적절한 아이템을 추천하기 위한 응용 시스템이며, 실제로는 지도학습, 비지도학습, 협업 필터링 등 다양한 기법을 조합해 구현됨.

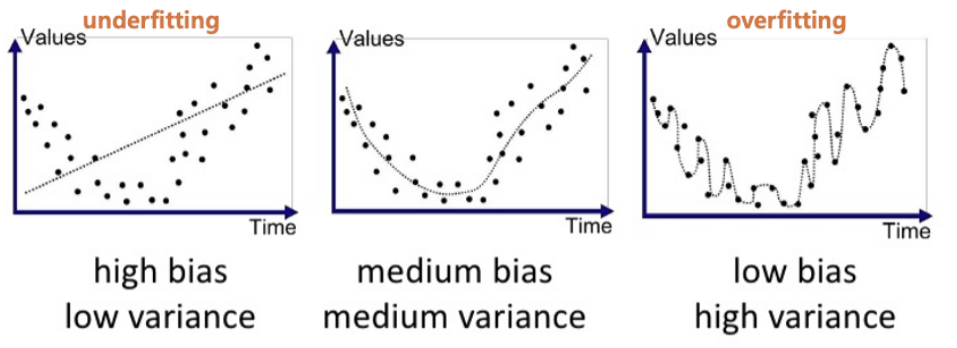

4. 모델의 일반화

- Overfitting(과적합): 학습 데이터에 지나치게 맞춰진 상태

- 새로운 데이터에 대해서는 성능이 떨어짐

- 일반적인 패턴뿐만 아니라 노이즈까지 학습함

- Underfitting(과소적합): 모델이 자나치게 단순하여 데이터의 패턴을 충분히 학습하지 못한 상태

- 학습 데이터와 새로운 데이터 모두에서 성능이 낮게 나타남

- 데이터의 구조를 제대로 표현하지 못한 경우에 발생

- 머신러닝의 목표: 과적합이나 과소적합에 치우치지 않고, 학습 데이터와 보지 못한 데이터 모두에서 안정적인 성능을 높이는 일반화(Generalization)가 잘 된 모델을 만드는 것

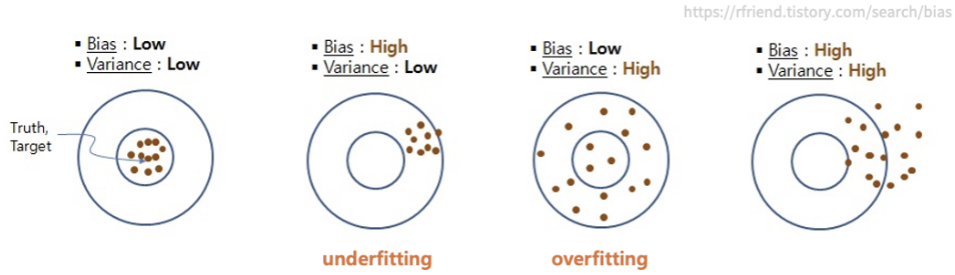

- 위 그림은 모델의 복잡도에 따라 발생하는 편향(Bias)과 분산(Variance)의 관계를 나타냄.

- Bias(편향): 모델이 실제 데이터의 패턴을 얼마나 단순하게 가정하고 있는지를 의미

- 항상 비슷한 방향으로 틀리면 - 편향이 큼

- 정답 근처를 중심으로 맞추면 - 편향이 작음

- Variance(분산): 학습 데이터가 조금만 달라져도 모델의 예측 결과가 얼마나 크게 변하는지를 의미

- 예측 결과들이 넓게 흩어져 있으면 - 분산이 큼

- 예측 결과들이 한곳에 모여 있으면 - 분산이 작음

사격 비유로 보면,

- 편향(Bias): 조준점이 어디를 향하고 있는가 (초점)

- 분산(Variance): 탄착이 얼마나 흩어지는가 (흔들림)

편향이 큰 경우에는 초점만 조정하면 개선할 수 있어 더 많은 데이터나 모델 개선으로 성능을 높일 수 있음. 반면 분산이 큰 경우에는 예측이 들쭉날쭉해 새로운 데이터에 대한 일반화가 어려우며, 이는 오버피팅으로 이어짐.

-> 편향이 크면 언더피팅이 발생하고, 분산이 크면 오버피팅이 발생하기 때문에 편향과 분산이 적절히 균형을 이루는 지점에서 보지 못한 데이터에도 잘 동작하는 일반화된 모델을 찾는 것이 중요함!