본 게시물은 참조블로그1참조블로그2참조블로그3사진1사진2를 참고하여 정리한 내용이다.

Pooling이란?

저번에 다뤘던 Max pooling의 내용을 좀 더 보충하기 위해 본 게시물을 작성한다.

Pooling이전 단계를 이해하고 pooling에 대한 설명을 진행해보도록 하겠다.

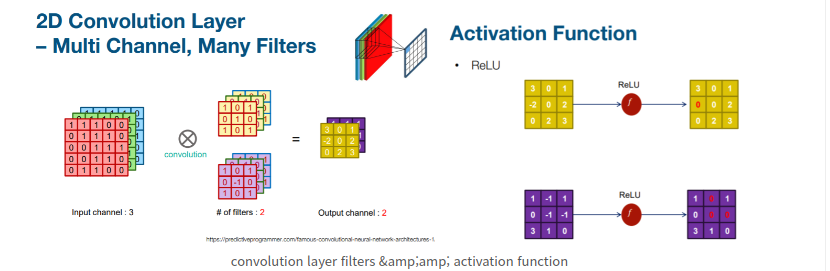

- 1.convolution layer에서 filter(learnable parameter)를 이용해 이미지 feature map을 계산하는 과정이 있다

- 2.계산 결과를 activation 함수를 이용해 nonlinearity(비선형성)를 부여해 준다.

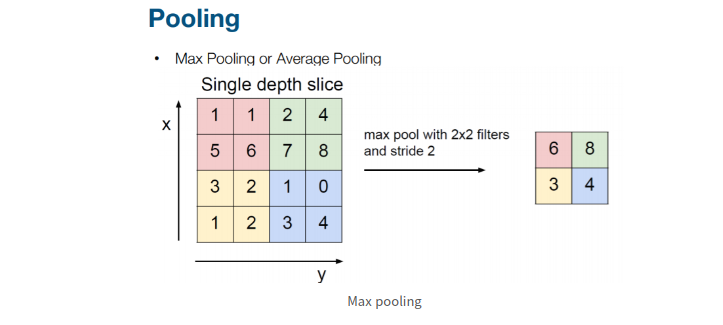

- convolution layer의 계산 결과(feature maps)를 pooling(sub sampling)하는 과정이다

- convolution layer의 계산 결과(feature maps)를 pooling(sub sampling)하는 과정이다

위 글에 Pooling을 subsampling이라 표현하였는데,subsampling이란 해당 이미지 데이터를 작은 size의 image로 줄이는 과정이다.

Pooling 종류

-

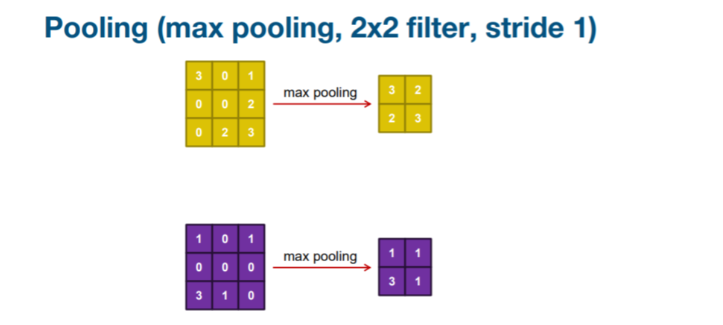

MaxPooling:필터에서 가장 큰 값을 추출

-

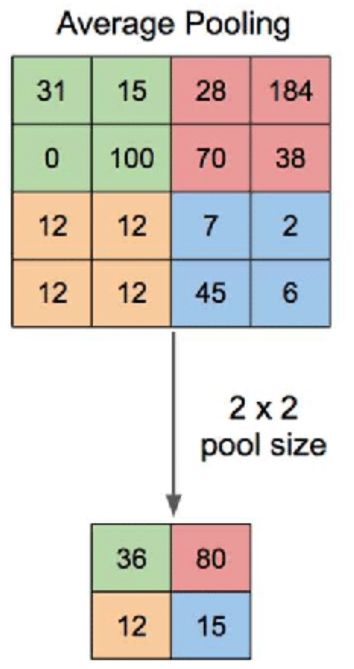

AveragePooling:필터의 평균값

-

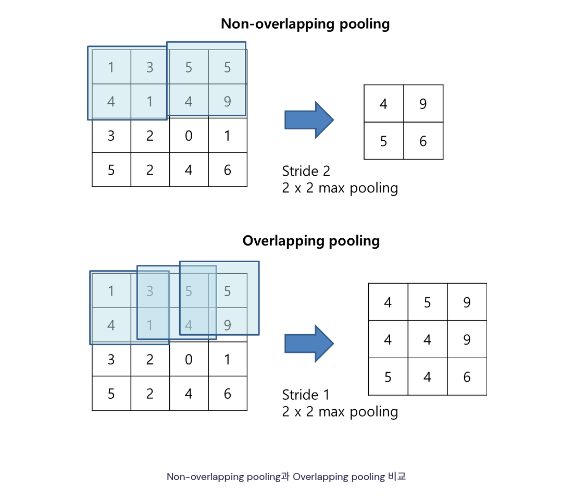

Overlapping Pooling:일반적인 Max pooling은 중복되지 않는 영역에서 pooling을 진행하나 AlexNet의 overlapping Pooling은 2픽셀 단위로 pooling을 진행하여 조금씩 겹치는 부분을 만들어 overfitting을 개선하였다.

Pooling의 목적

-

input size를 줄인다.

:tensor의 크기를 줄인다. -

overfitting을 조절

input size가 줄어드는 것은 불필요한 parameter의 수가 줄어드는것 이라고 생각할 수 있다. -

특징을 잘 뽑아낸다.

:pooling을 진행하였을때 feature를 잘 인식할수 있다.

Pooling의 특징

- training을 통해 train되어야 할 parameter가 없다.

- pooling의 결과는 channel 수에는 영향이 없으므로 channel의 수는 유지가 된다.(independent)

- input feature map에 변화가 있어도 pooling 값의 변화는 적다.(robustness)