본 게시물은 참고블로그의 내용을 정리하였습니다.

LRN(Local Response Normalization)은 현재 많이 사용되지 않는다.그러나 image net에서 최초의 cnn 우승 모델인 AlexNet에서 사용되었다.

측면 억제(lateral inhibition)

측면 억제는 신경생리학 용어로 한 영역에 있는 신경 세포가 상호간 연결되어 있을때 한 그자신의 축색이나 자신과 이웃 신경 세포를 매개하는 중간신경세포를 통해 이수에 있는 신경세포를 억제하려는 경향이다.

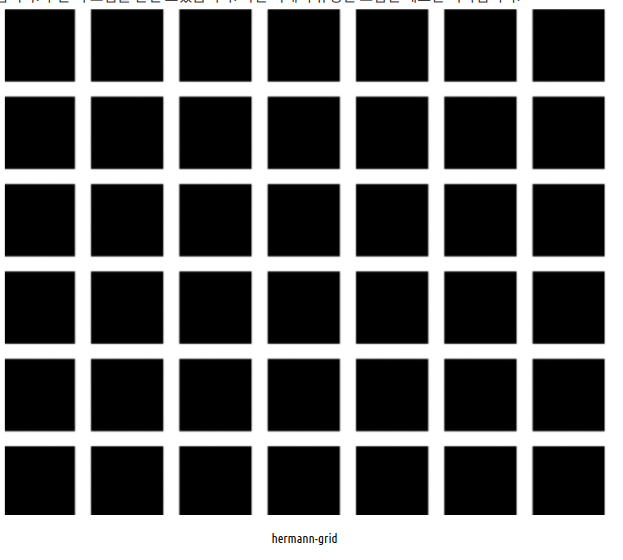

위 사진은 측면억제의 유명한 그림인 헤르만 격자이다.

검은 사각형 안에 흰색의 선이 지나가고 있는데,흰색의 선에 집중하지 않을때 회색점이 보인다.이런 현상을 측면억제라고 한다.

AlexNet에서 LRN을 사용한 이유는 ReLu때문이다.ReLu는 양수의 방향으로는 입력값을 그대로 사용한다.그렇게 되면 Conv이나 pooing을 진행할때 매우 높은 하나의 픽셀값이 주변 픽셀에 영향을 미치게 된다.이런 부분을 방지하기 위해 다른 ActivationMap의 값은 위치에 있는 픽셀 끼리 정규화를 해준다.