CV정리

1.CNN의 구조

CNN(Convolution Neural Network)의 기본구조 해당내용은 참조블로그에 기반하여 정리를 하였다. 진행 순서 Convolution layer Pooling layer FC layer Convolution Layer

2.보간법(interpolation)

본 내용은 참조 블로그1,참조블로그2의 내용을 정리한 것이다. 차례 보간법이란? Nearest Neighbor interpolation Bilinear interpolation Bicubic interpolation B_Spline interpolation Trans

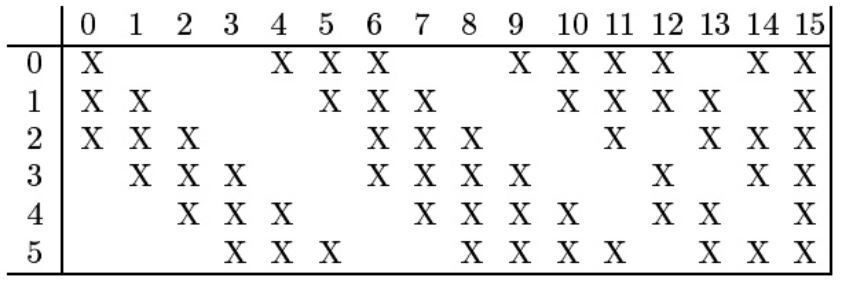

3.Upsampling(Transposed Convolution)

본 내용은 참조 블로그1, 참조블로그2의 내용을 정리하였다. Upsampling이란? NN를 사용하여 저해상도 이미지에서 고해상도 이미지로 만들때 upsampling이 사용된다. 이때 upsampling은 저해상도에서 고해상도로 만드는 작업이기 때문에 보간법이 사용되

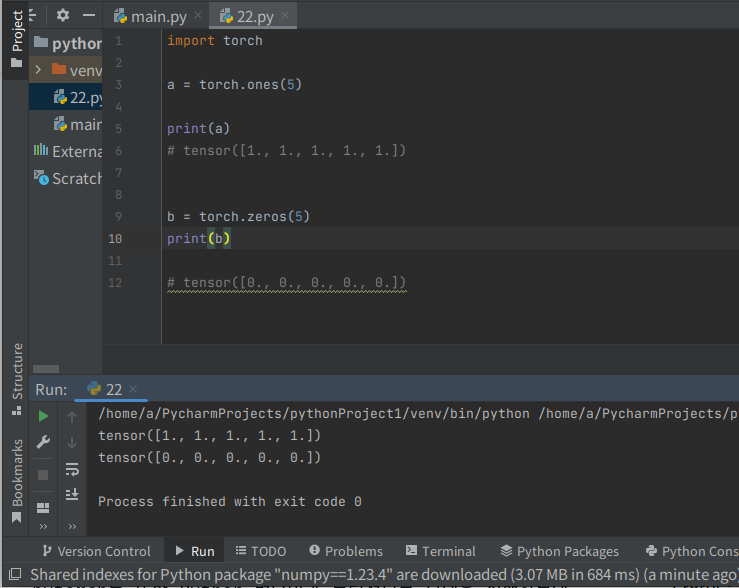

4.Pytorch 기초

해당 내용은 Learn opencv의 내용을 번역하여 정리하였다. 초보자를 위한 Pytorch 기초 필자는 tensorflow,keras,opencv dnn 모듈로 학습을 진행해보았으나 Pytorch는 얘기만 많이 들어봤을 뿐 직접 해본적이 없었다.따라서 이번기회에

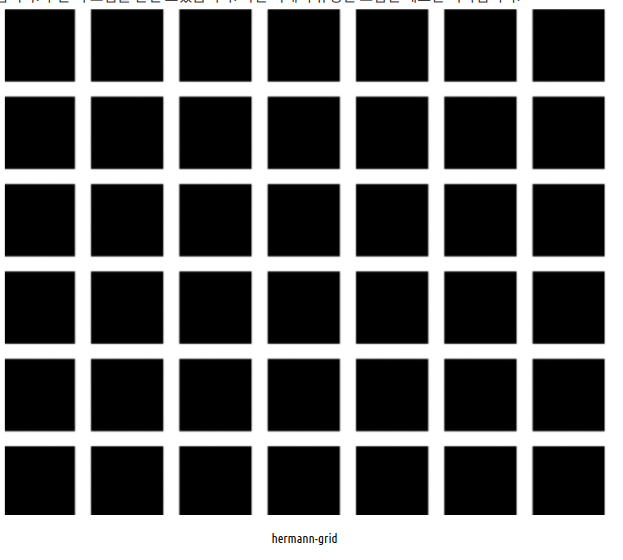

5.Pooling

본 게시물은 참조블로그1참조블로그2참조블로그3사진1사진2를 참고하여 정리한 내용이다. Pooling이란? 저번에 다뤘던 Max pooling의 내용을 좀 더 보충하기 위해 본 게시물을 작성한다. Pooling이전 단계를 이해하고 pooling에 대한 설명을 진행해보

6.Local Response Normalization

본 게시물은 참고블로그의 내용을 정리하였습니다.LRN(Local Response Normalization)은 현재 많이 사용되지 않는다.그러나 image net에서 최초의 cnn 우승 모델인 AlexNet에서 사용되었다.측면 억제는 신경생리학 용어로 한 영역에 있는 신

7.AlexNet

본 게시물은learn-opencv의 내용을 번역하여 정리한 글이다. Input AlexNet은 ILSVRC 2012에서 수상한 항목이다.입력이 1000개의 다른 class(고양이,개)중 하나의 이미지이고 출력이 1000개의 숫자로 구성된 벡터인 이미지 분류 문제를 해

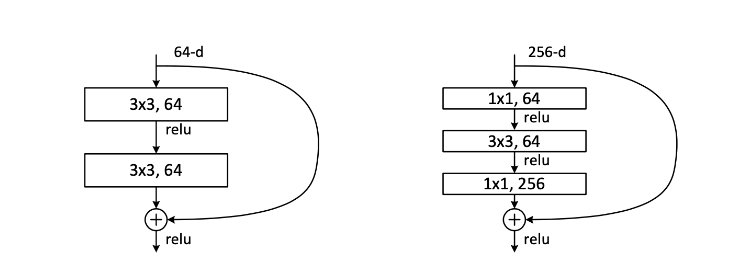

8.ResNet

본 게시물은 참고 블로그1,위키독스를 읽고 정리하였습니다. ResNet ResNet(Residual Learning)이 나오기 전 CNN을 연구하며 기존 모델들(AlexNet,VGGNet)의 layer를 깊게 쌓으면서 성능 향상을 기대했으나, 실제로는 20층 이상부

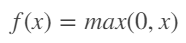

9.활성화 함수

본 게시물은 참고블로그의 내용을 정리하였다. 활성화 함수 딥러닝 네트워크에서 노드에 입력된 값들을 비선형 함수에 통과시킨 후 다음 레이어로 전달할때 사용하는 함수를 활성화 함수라고 한다. 선형함수가 아닌 비선형 함수를 사용하는 이유는 딥러닝 모델의 레이어 층을 깊게

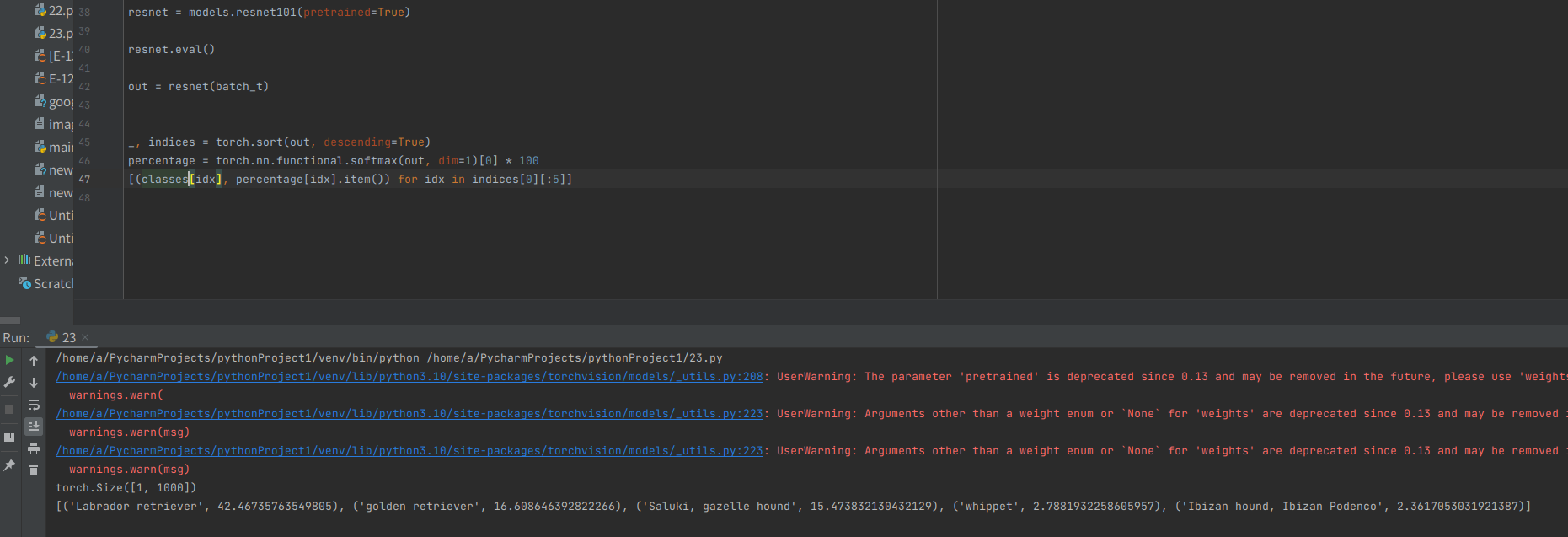

10.초보자를 위한 Pytorch: Pre-trained 모델을 사용한 image classification

해당 게시물은 learn_opencv사이트의 게시물을 번역하여 정리하였다. 이전 게시물에서 Pytorch의 장점과 배워야 하는 이유를 기재하였다.또한 Pytorch에서 사용되는 핵심 데이터 구조인 Tensor에 대해서 간단하게 살펴보았다.본 게시물에선 image cl

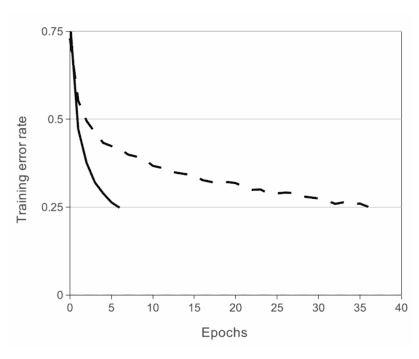

11.LeNet-5

본 게시물은 참고블로그내용을 정리하였다. LeNet LeNet은 CNN중 초기 모델이며 본 게시물은 최종 모델인 LeNet-5의 내용을 다룬다. LeNet은 CNN을 처음으로 개발한 얀 르쿤(Yann Lecun)연구팀이 1998년에 개발한 CNN알고리즘이다. 위 사