그레디언트 클리핑은 굉장히 간단하다.

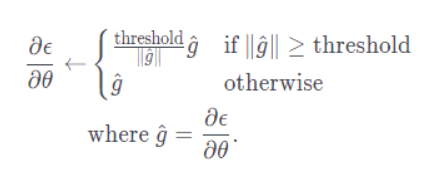

이름에서부터 유추가 가능한데 그레디언트가 일정 임계값을 넘어가면 clipping을 해주는 것이다.

보통 gradient의 L2 norm을 나눠주는 방식을 이용한다.

임계값은 gradient가 가질 수 있는 최대 L2 norm을 의미하고 하이퍼 파라미터이다.

clipping을 사용함으로서 gradient exploding을 방지하고 gradient가 방향은 유지하면서 적은 값만큼만 이동하며 안정적으로 내려갈 수 있다.

보통 RNN에서 많이 사용된다고 한다.

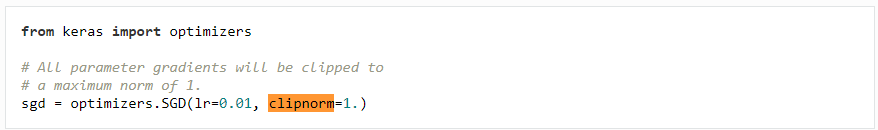

tensorflow keras에서는 모든 optimizer의 공통변수로

과 같이 사용할 수 있다.

참고 링크 : https://keras.io/ko/optimizers/, https://sanghyu.tistory.com/87