Linguistic Probing

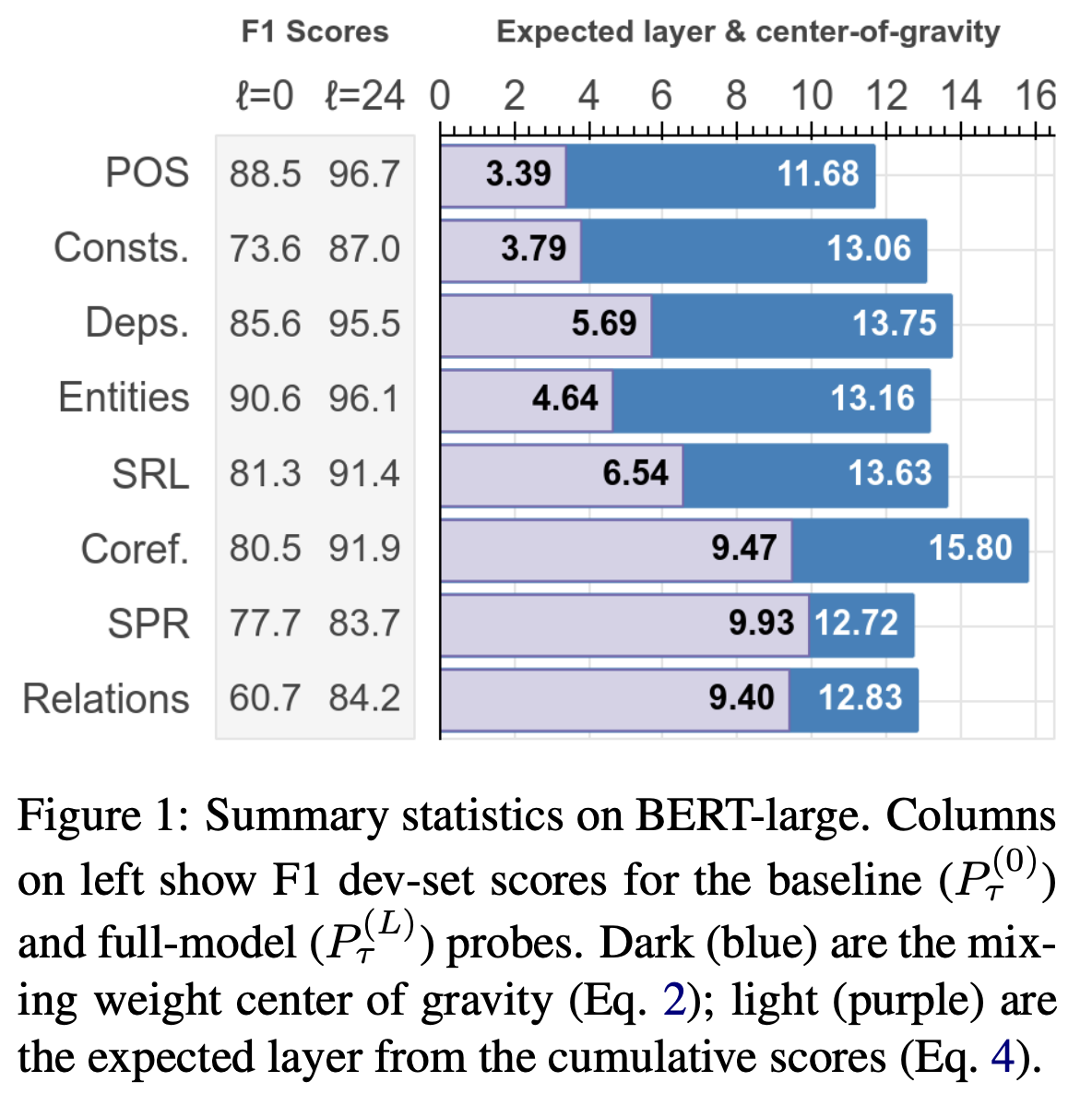

1.[Linguistic Probing] BERT Rediscovers the Classical NLP Pipeline

Tenney(2019), ACL shortperformance는 증가하였으나 interpretability를 잃음우리가 직관적으로 믿고 중요하다고 여기는 것들을 모델도 실제로 배우고 있는지 vs 복잡한 co-occurrence 통계학을 모델링 한 것인지 모름이를 파헤치

2.[Linguistic Probing] What do you learn from context? Probing for sentence structure in contextualized word representations

1. Introduction 💡 Goal 문맥을 반영한 벡터가 전통적인 단어 벡터와 어떤 차이가 있는지 ? 💡 Focus 각 위치에서 어떤 정보가 인코딩 되는지 ? 문장 내에서 각 단어의 역할을 구조적으로 잘 인코딩하는지 ? 💡 Significance

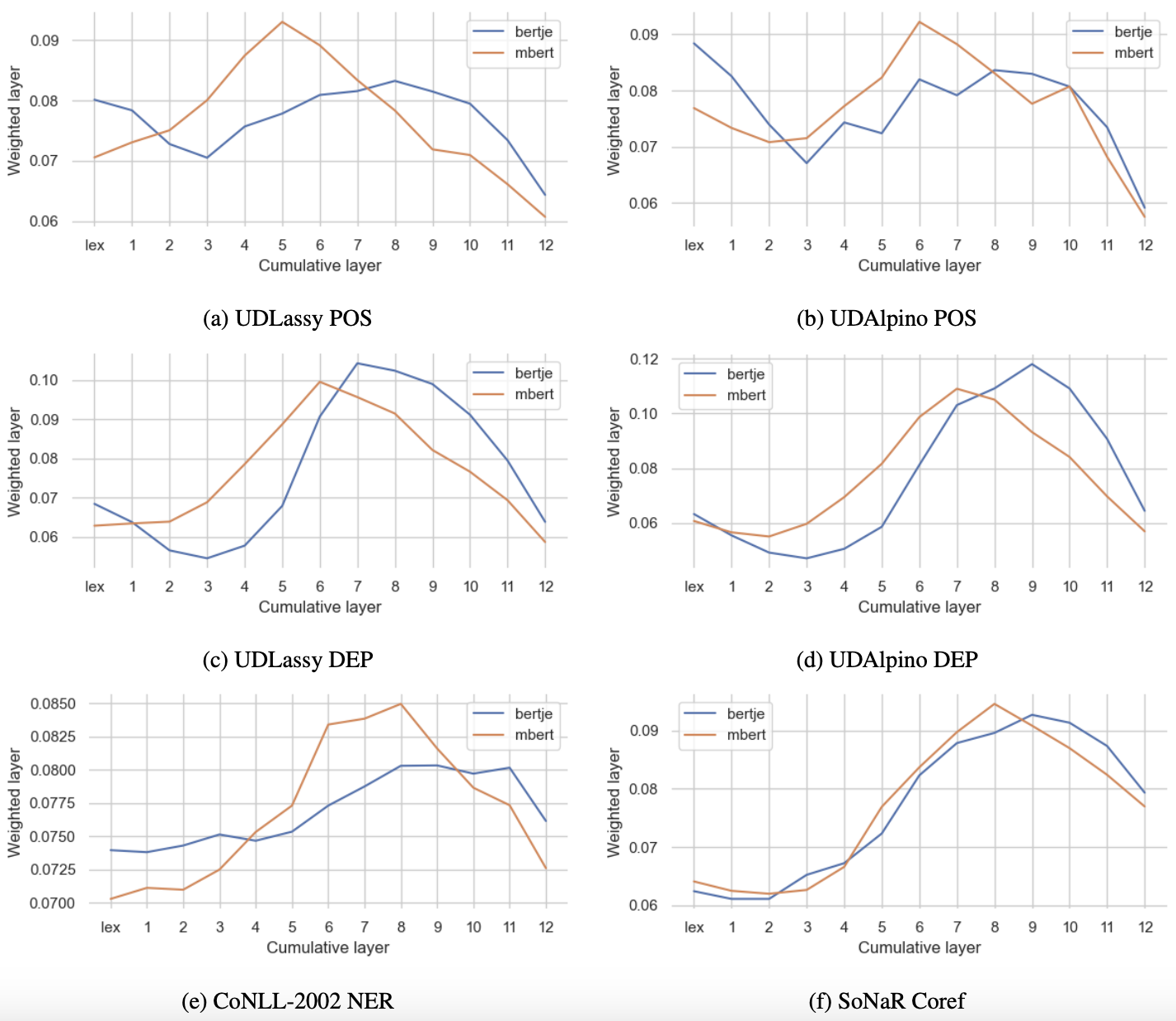

3.[Linguistic Probing] What’s so special about BERT’s layers? A closer look at the NLP pipeline in monolingual and multilingual models

저자: Wietse de Vries, Andreas van Cranenburgh, and Malvina Nissim (University of Groningen) 연도: 2020 학회: EMNLP findings

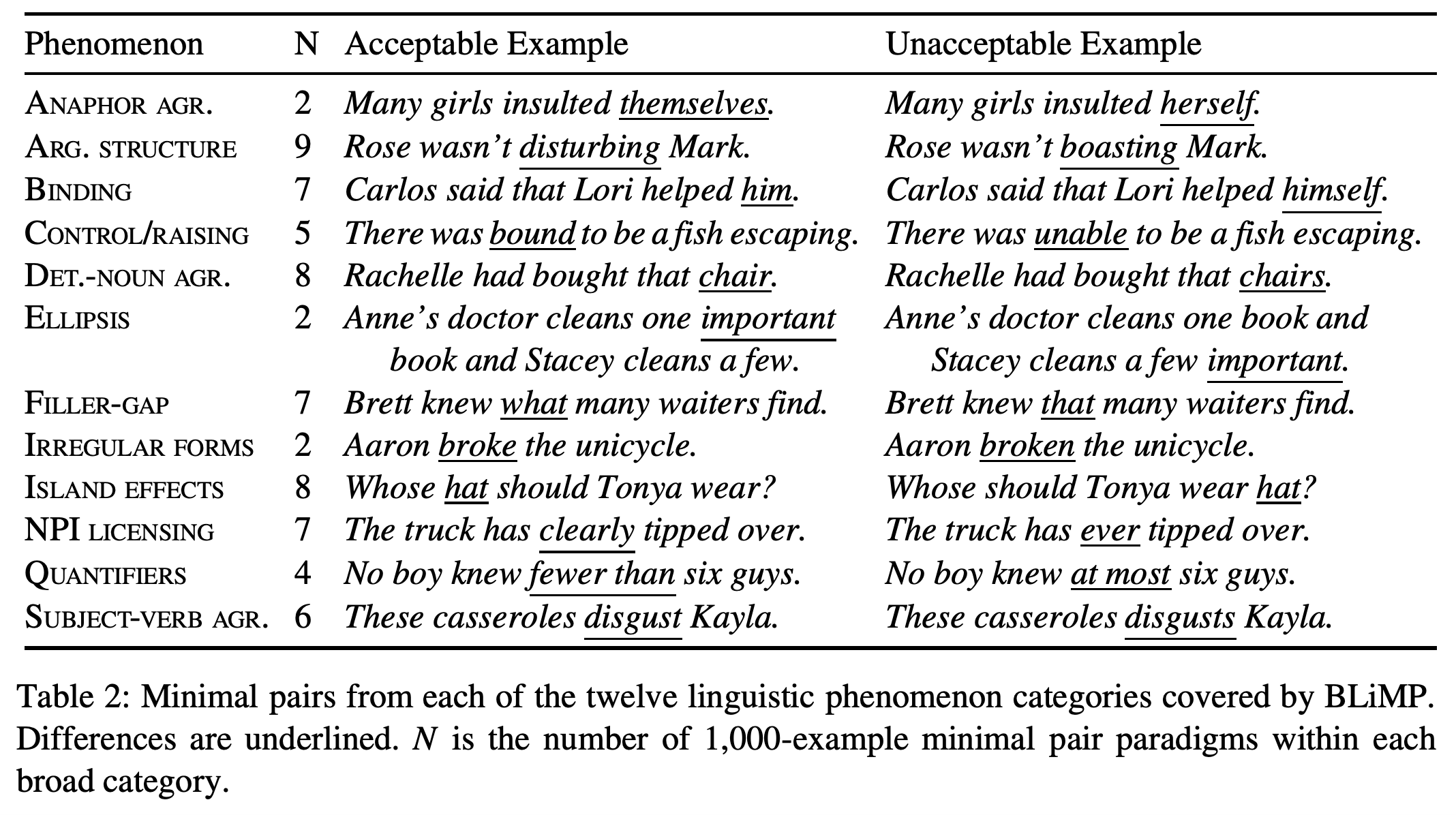

4.[Linguistic Probing] BLiMP: The Benchmark of Linguistic Minimal Pairs for English

저자: Alex Warstadt, Alicia Parrish, Haokun Liu, Anhad Mohananey, Wei Peng, Sheng-FuWang, Samuel R. Bowman (New York University)연도: 2020제출: TACL링크: http

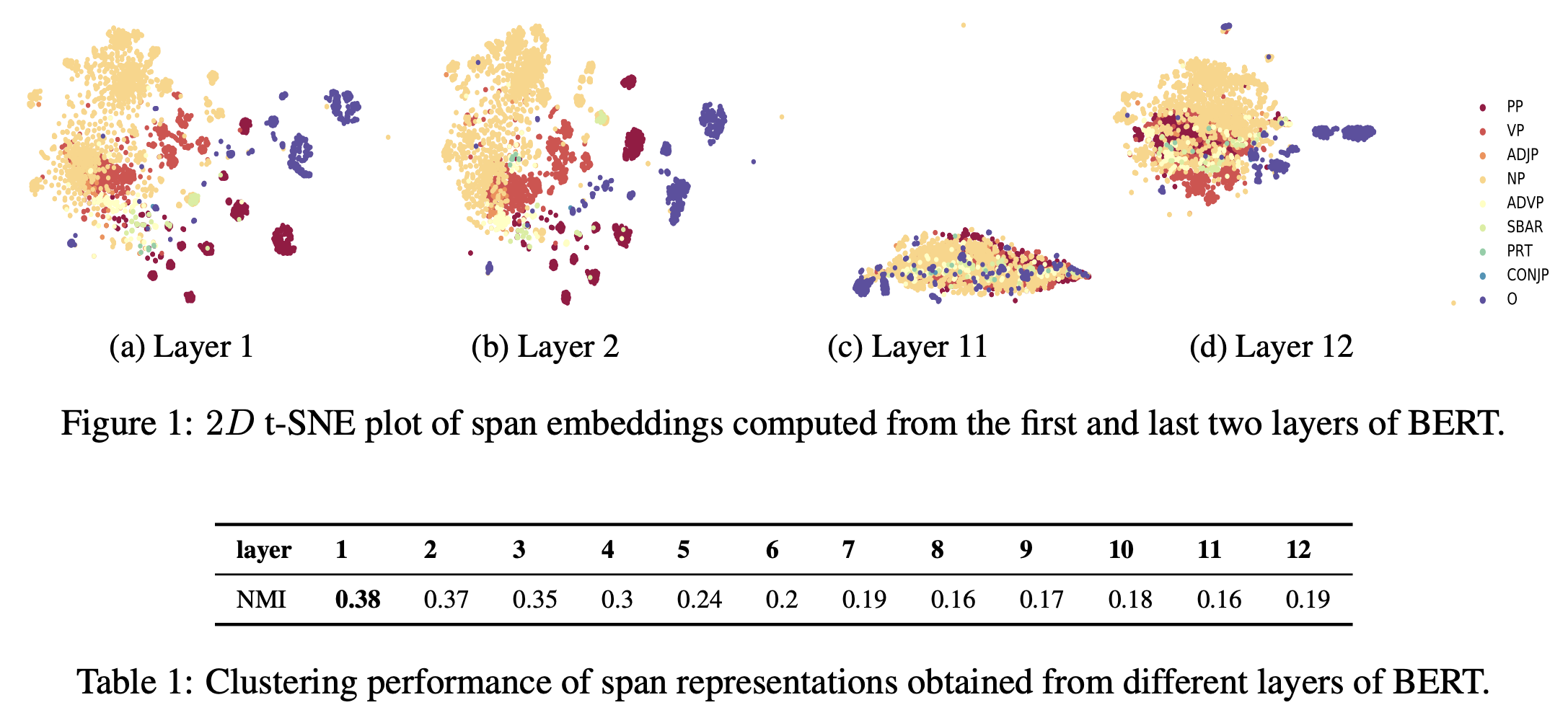

5.[Linguistic Probing] What Does BERT Learn about the Structure of Language?

저자: Jawahar et al.연도: 2019제출: ACL링크: https://aclanthology.org/P19-1356/BERT 가 언어의 구조적 정보를 가지고 있는가 ?lower layer 에서 phrase-level information 이 capt

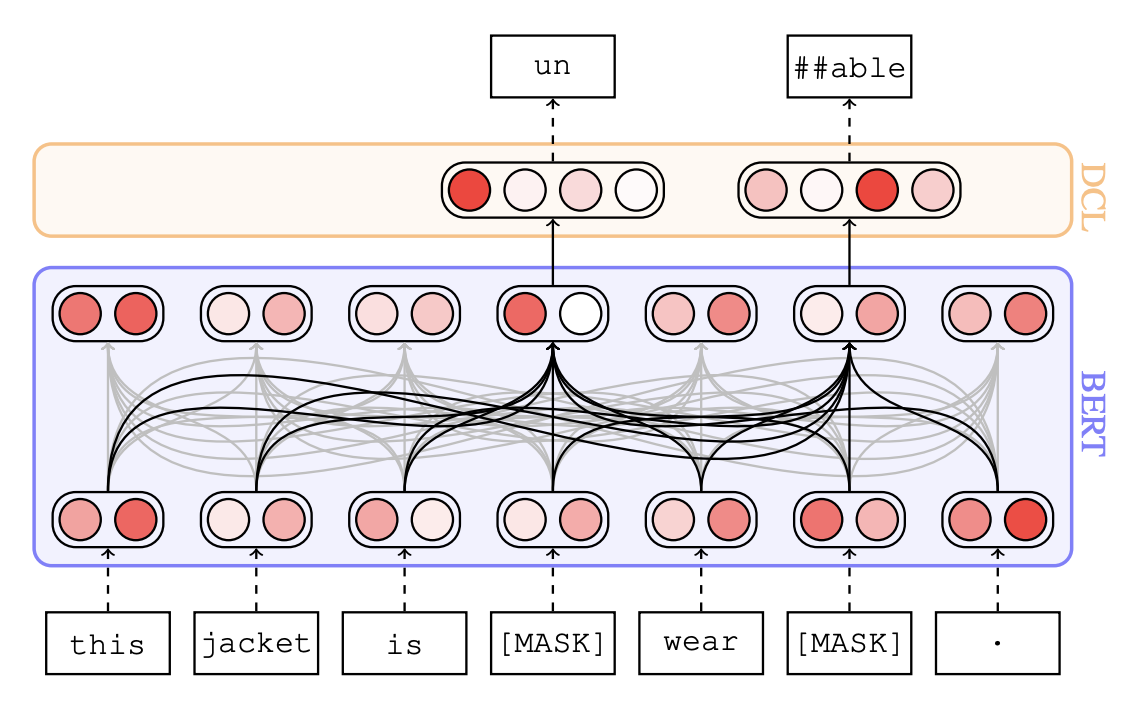

6.[Linguistic Probing] DagoBERT: Generating Derivational Morphology with a Pretrained Language Model

저자: Valentin Hofmann, Janet B. Pierrehumbert (University of Oxford), Hinrich Schutze (LMU Munich)연도: 2020제출: EMNLP링크: https://aclanthology.org/20