[논문리뷰] Agent0: Unleashing Self-Evolving Agents from Zero Data via Tool-Integrated Reasoning

Paper Review

한 줄 요약: 에이전트 시스템에 사용될 베이스 LLM을 에이전트 기반 학습 구조로 사후 강화하는 방법인 Agent0 프레임워크를 소개하는 논문

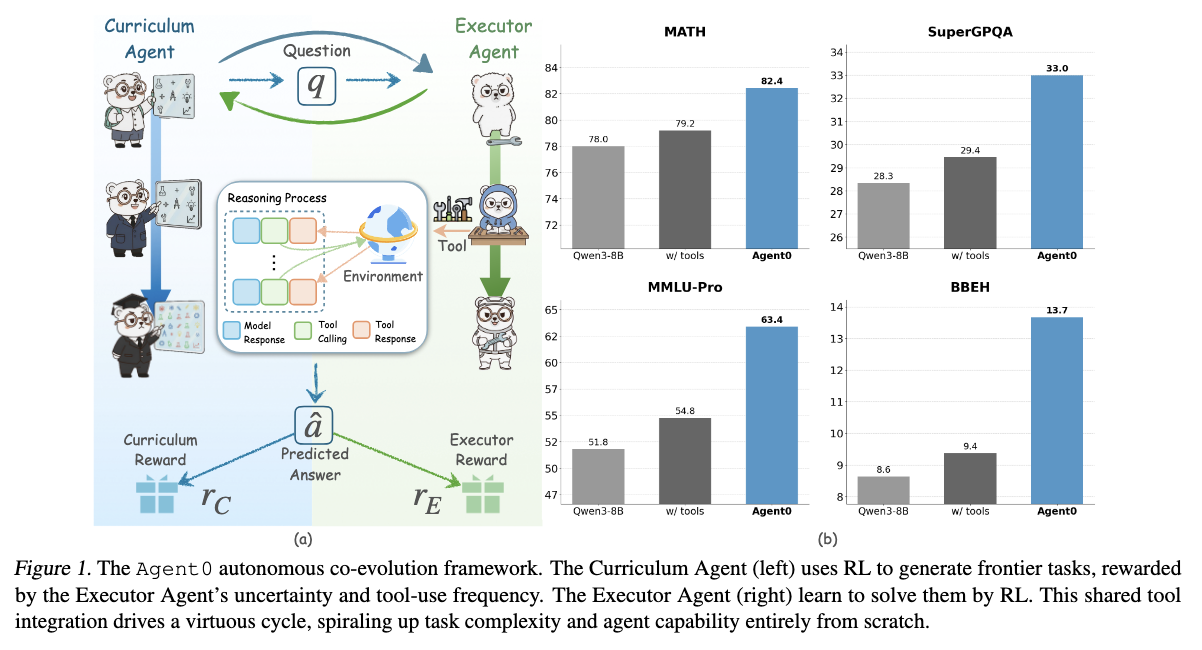

이 논문은 스탠포드 대학교를 포함한 연구진이 제안한 Agent0를 소개한다. Agent0는 기존 언어모델 기반 에이전트가 인간이 생성한 학습 데이터에 의존함으로써 발생하는 확장성과 일반화의 한계를 극복하기 위해 설계된 완전 자율형 다단계 에이전트 학습 프레임워크이다. 본 프레임워크는 동일한 기반 언어모델에서 출발한 '커리큘럼 에이전트'와 '실행 에이전트'가 상호 경쟁적·공진화적(co-evaluation)으로 학습하는 구조를 통해, 외부 (annotated) 데이터 없이도 점진적으로 더 복잡한 문제와 추론 능력을 스스로 생성하고 학습할 수 있도록 한다.

✅ Introduction

RLHF(Reinforcement Learning from Human Feedback)은 LLM의 성능 향상에 효과적인 방법이지만, 방대하고 고품질의 인간 생성 학습 데이터셋이 필요하다는 한계가 있다. 이는 시간과 비용 측면의 부담일 뿐만 아니라, 근본적으로 AI의 학습 범위를 인간이 제공한 지식과 판단 기준에 묶어둔다는 점에서 구조적 제약을 갖는다.

이러한 한계의 대안으로 self-evolution frameworks가 제안되었다. 이는 모델이 스스로 학습데이터를 생성하며 발전하는 방식인데, 생성되는 학습 신호가 이미 모델에 내재된 지식과 추론 능력에 의존한다는 점에서 난이도가 쉽게 정체되는 문제가 있다. 또한 대부분의 self-evolution 프레임워크는 단일 순회(single-turn) 상호작용을 중심으로 설계되어 실제 문제 해결에 중요한 다단계 추론과 반복적 사고 과정을 충분히 학습하기 어렵다는 한계를 가진다.

Agent0는 이런 문제점들을 해소하기 위해 위와 프레임워크로 구성되는 자율현 다단계 에이전트 학습 프레임워크이다. 본 프레임워크는 동일한 기반 언어모델에서 출발한 두 개의 에이전트가 서로 다른 역할을 수행하면서도 상호 발전하는 공진화(co-evolution) 구조를 따른다. 구체적으로, (1) 커리큘럼 에이전트(curriculum agent)는 실행 에이전트가 가장 혼란을 겪는 경계선 수준의 어려운 문제(frontier tasks)를 생성하고, (2) 실행 에이전트(executor agent)는 해당 문제를 효과적으로 해결하도록 학습된다. 이 과정에서 문제 생성과 문제 해결 능력이 서로를 자극하며 점진적으로 고도화된다.

Agent0의 핵심 기여는 외부 인간 데이터에 의존하지 않으면서도, 도구 사용을 통합한 추론(tool-augmented reasoning)을 통해 언어모델 기반 에이전트를 초기 상태에서부터 자동으로 발전시킬 수 있는 새로운 self-evolution 프레임워크를 제안했다는 점에 있다. 이를 통해 기존 self-evolution 접근에서 나타난 커리큘럼 정체와 단일 상호작용 중심 학습의 한계를 효과적으로 극복한다.

✅ The Agent0 Framework

📌 GRPO란?

Group Relative Policy Optimization은 강화학습의 한 방법으로, 절대적인 보상값 대신, 동일한 프롬프트에서 생성된 여러 응답 간의 상대적 우열을 보상으로 사용한다. 정답 레이블이 존재하지 않는 환경에서도 적용 가능하고, 모델이 생성한 여러 답변을 서로 비교하여 학습 신호를 구성한다는 점에서 학습 안정성이 높고 구현이 단순하다는 특징이 있다.

Agent0는 커리큘럼, 실행 에이전트 모두 GRPO계열 방식을 기반으로 설계했다고 한다.

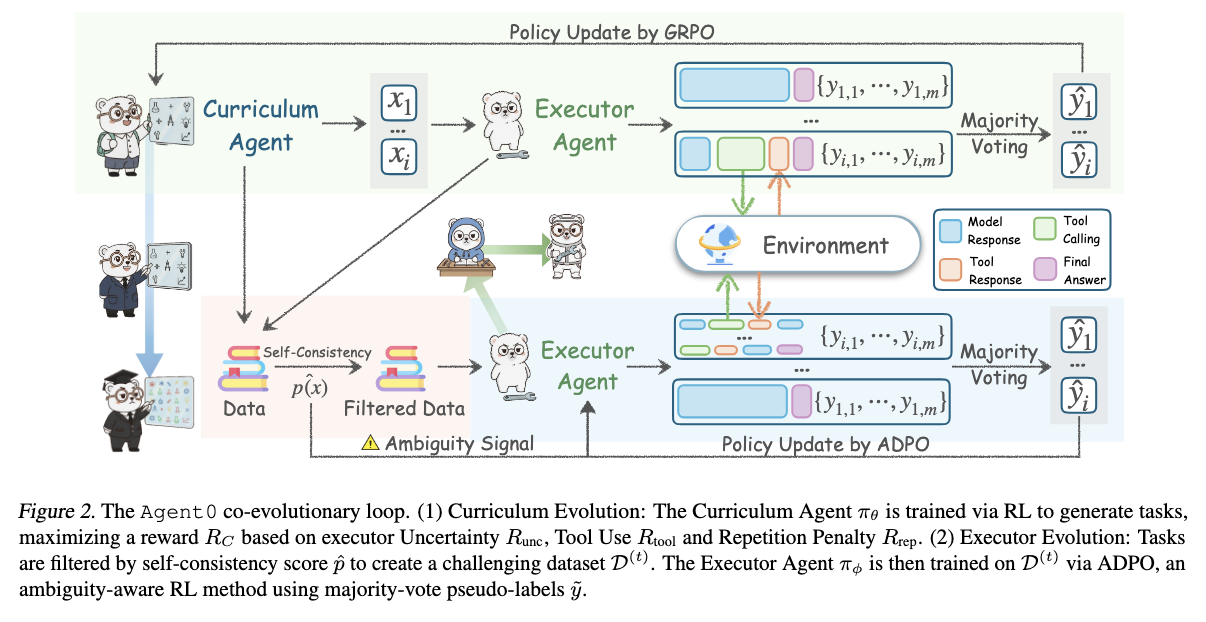

Agent0 프레임워크는 동일한 기반 LLM에서 출발한 두 에이전트가 위 구조에서 제시된 것처럼 공생적 경쟁(symphbiotic competion) 구조 속에서 반복적으로 함께 진화한다. 논문에서 수식적으로 각 에이전트의 강화 과정을 설명하는데, 이 글에서는 본인이 이해한 개념적 수준에서 정리하도록 하겠다.

(1) Curriculum Agent Training

커리큘럼 에이전트의 목적은 현재 실행 에이전트의 능력 수준을 기준으로, 학습에 가장 효과적인 frontier 과제를 생성하는 것이다. 최적화하기 위해서 실행 에이전트의 self-consistency(불확실성-얼마나 혼란을 겪는지-을 대리하는 지표)와 도구 사용 패턴을 기반으로하는 '복합 보상 함수' R_C를 최대화하는 방식으로 학습되며, 이때 GRPO 알고리즘이 사용된다.

- Uncertainty Reward: 불확실성 보상. k개의 응답 중 다수결로 선택된 답변에 동의한 비율로 정의되며, 0.5일때 최대값으로 설계된다. 1에 가까울수록 너무 쉬운문제이고, 0에 가까울수록 너무 어려운 문제라서 학습 효율이 낮다고 판단하여 보상이 낮아진다.

- Tool Use Reward: 실행 에이전트의 응답 과정에서 나타난 도구 호출 횟수를 기반으로 계산. 도구 호출 횟수가 많을수록 보상이 증가하지만, 과도하거나 의미없는 도구 호출을 방지하기 위해 상한성(C)를 두고 보상을 제한함

- Repetition Penalty: 커리큘럼 에이전트가 유사한 과제를 반복 생성하는 것을 방지하기 위해, 각 배치에서 생성된 과제들 간의 유사도를 BLUE 점수와 같은 텍스트 유사도 지표로 계산하고 임계값 이하인 과제들을 동일 클러스터로 묶음. 클러스터의 크기가 클수록(=유사한 과제가 많이 생성되었을수록) 패널티는 증가함

(2) Executor Agent Training

실행 에이전트의 목표는 커리큘럼 에이전트가 생성하는 점점 더 복잡한 과제를 성공적으로 해결하는 능력을 극대화하는 것이다. 실행 에이전트의 학습 역시 GRPO를 기반으로 하되, self-evolution 환경에서 발생하는 불확실성과 노이즈를 고려하여 데이터 선별 방식과 정책 최적화 방법을 확장한다.

- Challenging Dataset Construction: 리큘럼 에이전트가 학습된 이후에는 이를 고정(freeze)한 뒤, 다수의 과제 집합 후보 X_pool을 생성한다. 각 과제x에 대해 실행 에이전트는 k개의 응답을 생성하고 이를 기반으로 self-consistency가 계산된다.

- Multi-Turn Rollout: 실행 에이전트는 다단계 추론과 도구 사용을 포함한 방식으로 학습한다. 우선 자연어 추론을 생성하고, 추론 과정에서 도구 호출 트리거가 발생하면, 도구를 실행한 뒤 실행 결과를 다시 입력으로 넣어서 추론을 계속한다 (텍스트-추론-도구실행-피드백 반영). 이러한 반복 과정을 통해 실행 에이전트가 오류를 인식하고 스스로 수정해나가는 추론 과정을 학습하도록 한다.

이때 사용한 도구는 파이썬 기반 코드를 생성하고, 실행 결과를 다시 추론에 통합하는 역할을 수행하며, 이때 명확히 해야 할 부분은 '도구를 어떻게, 언제 사용해야 하는지'에 대한 부분이 학습 대상이며, 도구 자체는 재학습 대상이 아니다.

- Pseudo-Label Advantage: 각 과제에 대해 k개의 추론 과정과 최종 답변이 생성되면, 다수결을 통해 선택된 답변 y를 pseudo-label로 사용한다. 이후 각 추론 과정에 대해 최종 답변이 y와 일치하는지 여부에 따라 종료 보상 R_i를 부여한다. 이 종료 보상은 추론 과정 전체에 대한 advantage 신호로 사용되어, 실행 에이전트가 올바른 추론 경로를 강화하도록 유도한다.

일반적인 GRPO는 모든 샘플을 동일하게 취급하지만, Agent0의 self-evolution 환경에서는 다수결 기반 의사 레이블이 틀릴 수도 있으므로 필연적으로 노이즈를 포함하게 된다. 특히 self-consistency가 낮은 과제에서는 다수결 답변 자체가 틀릴 가능성이 높으며, 이 경우 기존 방식은 잘못된 추론을 강화할 위험이 있다. 따라서 본 논문에서는 ADPO를 제안한다.

ADPO(Ambiguity-Dynamic Policy Optimization)는 우선 self-consistency가 낮은 과제일수록 레이블의 신뢰도가 낮다고 판단하여 advantage 크기를 축소하고, 반대의 경우는 크기를 유지하여 노이즈에 과적합되지 않고 안정적인 학습을 유도한다. 또한 policy를 업데이트 할 때 적용되는 클리핑(policy 수정을 막는 안전장치) 범위를 고정하지 않고, 모호한 과제일수록 상한 클리핑 범위를 완화하여 기존 정책에서 낮은 확률을 갖던 토큰이나 추론 경로가 더 크게 강화될 수 있도록 하며, 확신도가 높으면 보수적인 업데이트를 유지해서 학습 안정성을 확보한다.

✅ Experiments & Conclusion

Agent0의 성과 파트는 간단하게 정리했다. 우선 성능은 기존의 방식 대비 일관되게 향상되었다고 한다. 특히 다단계 추론이나 계산이 필요한 문제 등에서 개선의 폭이 컸으며, 이를 통해 외부 데이터 없이도 실질적인 성능 향상이 가능하다는 것을 확인했다. 또한 ADPO는 self-evolution 환경에서 기존의 GRPO 대비 안정적이고 우수한 성능을 보였다는 점에서 대체 가능성을 입증했다.

결론적으로, Agent0는 data-free 방법 중에서 모델의 성능을 향상 시킬 수 있는 가장 좋은 방법임을 확인했고, 도구를 단순히 제공한 것 보다 도구 활용을 학습 대상에 포함시킨 부분이 결정적인 성능 향상에 기여했다고 한다.

논문을 읽고 난 뒤 개인적으로 한 생각은, 특정 도메인의 에이전트 시스템을 구성할 때 활용하는 기반 모델을 이런식으로 강화학습 할 수 있을 것 같다는 것이었다. 이해하기로는 이 논문에서 사용한 도구는 파이썬 인터프리터 수준인데, 만약 특정 도메인의 DB를 연결해서 답변을 생성할 수 있도록 한다면 커리큘럼 에이전트를 이를 기반으로 관련된 답변을 반복적으로 생성해낼 수 있을 것 같다. 다만, QnA의 과정이 자율적으로 운영된다는 점에서 과연 얼마나 도메인 범위가 잘 고정될 수 있을지, 이를 위해서 어떤 Policy와 Penalty들이 필요할지는 의문이다.