개요

안전 자율주행을 위해 정확한 dynamic object perception software가 필요로 하며 high precision(no false detection), high recall(never missing an obstacle on the road)을 요구한다.

이를 달성하기 위하여 camera, lidar, radar 등의 센서와 컴퓨팅을 하기위한 GPU가 요구된다.

각 센서는 장단점이 있으며 이를 상호 보완하여 보다 정확한 인지를 위하여 fusion을 진행하게 된다.

Camera-Lidar sensor fusion의 경우,

Lidar : 정확한 depth 추정이 가능하지만 color 정보가 없음

Camera : color 정보를 얻을수 있지만, depth정보를 추정하기가 힘듦

그래서 두 센서의 장단점을 상호보완하기 위해 fusion을 진행하게 된다.

sensor fusion의 패러다임

deep learning의 발전과 함께 두개의 fusion 패러다임이 나타나게 된다.

late fusion 그리고 early fusion 이 있다.

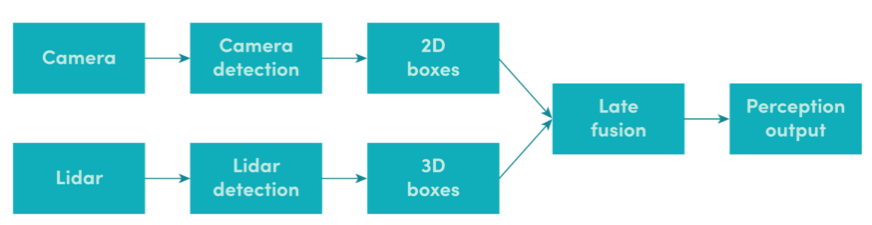

Late Fusion

마지막까지 각 감지 양식을 독립적으로 처리한 후 확률적 기술을 사용하여 최종 단계에서 융합한다.

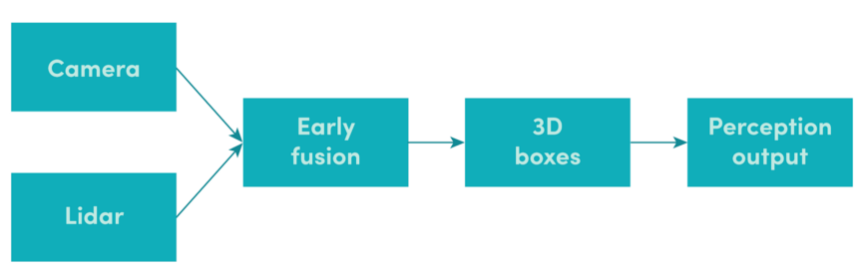

Early Fusion

초기 단계에서 각 sensor 에서 취득한 raw data를 융합하여 신경망을 사용한다.