Decision Tree는 Parameter를 사용하지 않는 머신러닝 방법으로 Classification이나 Regression하는 경우에 사용한다.

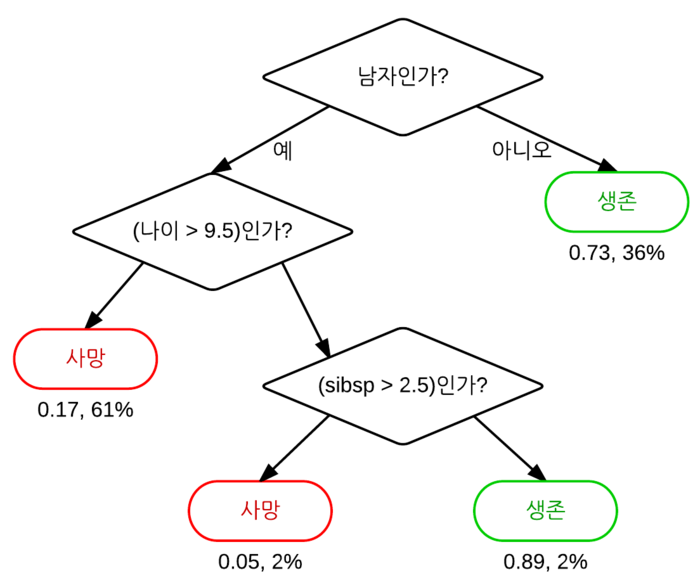

Decision Tree는 몇몇의 입력 변수들을 통해 target의 값을 예측하게 된다. 다음은 타이타닉 생존자의 데이터를 통하여 생존 여부를 판단하는 Decision Tree이다.

Decision Tree의 장점들은 다음과 같다.

1. 시각화시키기 쉬워 이해하기 편하다.

2. 데이터 전처리의 과정이 상대적으로 덜 필요하다.

3. log(n)의 복잡도를 가진다.

4. numerical, categorical 데이터에 공통적으로 적용 가능하다.

단점들은 다음과 같다.

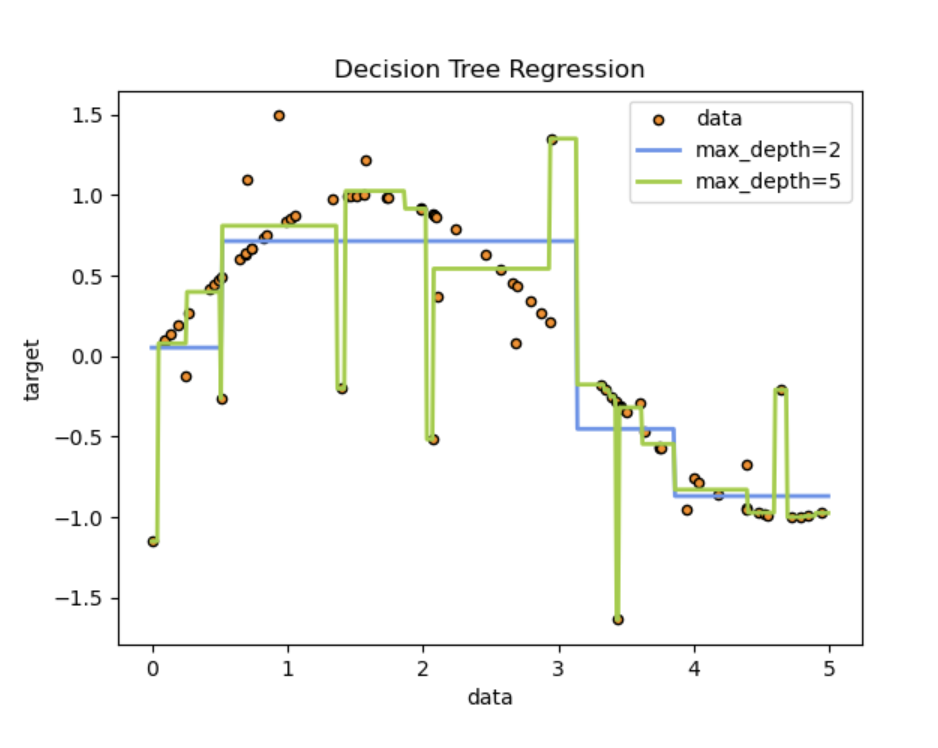

1. 입력 변수의 수가 많은 경우 Overfitting이 빈번하게 일어난다.

2. 데이터의 변화에 민감해서 unstable하다.

3. Decision Tree는 최적해를 보장하기 어렵다. 따라서 greedy algorithm같은 heuristic한 방법으로 local의 최적해를 찾게 되는 경우가 있다.

Reference : https://scikit-learn.org/stable/modules/tree.html