저번 포스팅에 이어서 진행하도록 하겠습니다.

ResNet

ResNet입니다.

전에 나왔던 모델모다 훨씬 더 깊은 계층(152개의 계층)으로 구성이 되어있습니다.

여기서 주목해야 하는 부분은 error값 입니다.

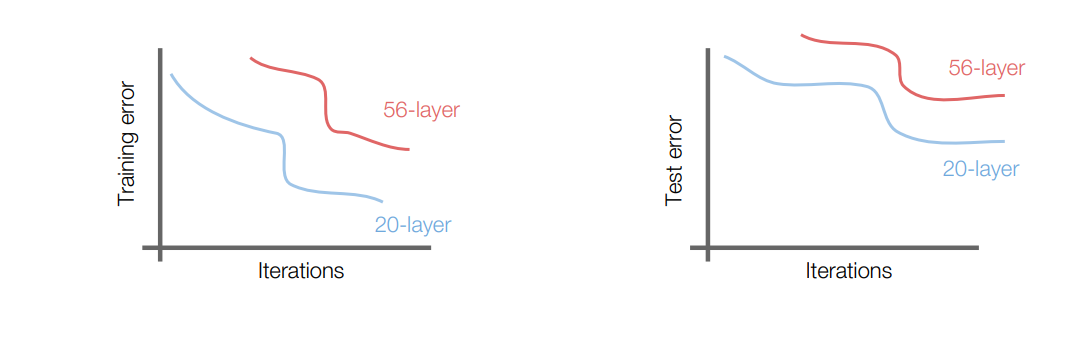

이 그림은 각각 20-layer, 56-layer, error값 형태인데, 계층이 더 깊다고 무조건 좋은게 아니라는 것을 알려줍니다.

물론 ResNet은 152개의 계층으로 획기적인 error값을 냈지만, 이 부분은 주의해서 볼 필요가 있습니다.

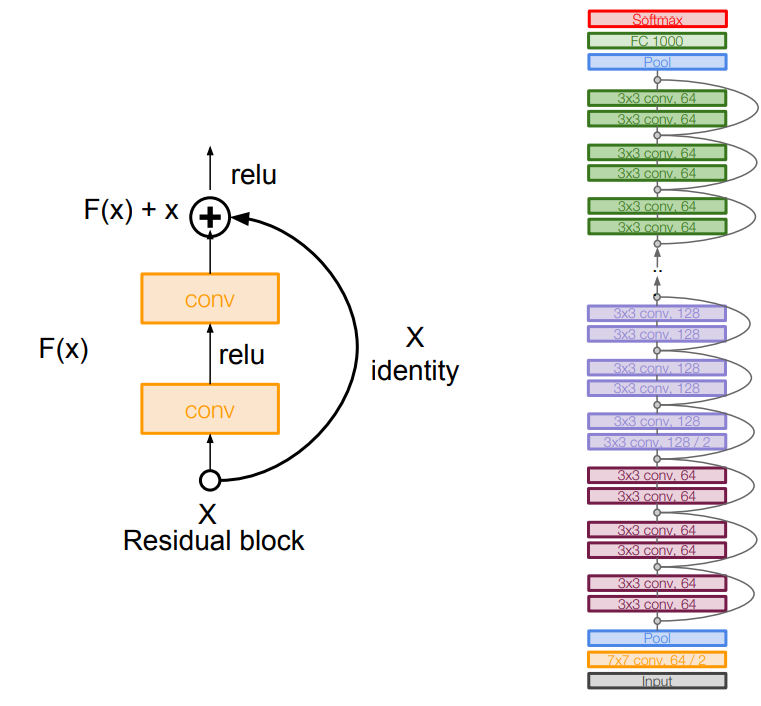

이 그림은 ResNet계층 구성 방식입니다.

기존 계층은 일렬로 나열하여 계속해서 전달하는 방식이었다면, ResNet은 그림에서 알 수 있듯이, 몇가지 계층을 뛰어넘는 방식의 계층을 구성했습니다.

이 모델의 특징은

1. Conv계층 이후 Batch Normalization

2. SGD 모멘텀

3. Dropout 사용 안함.

4. GoogleNet 처럼 BottleNeck 사용

로 정의할 수 있습니다.

Wide Residual Networks

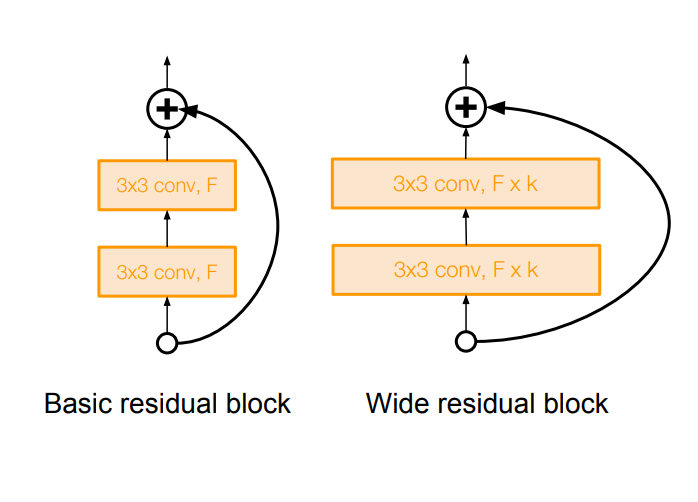

Wide Residual Networks입니다.

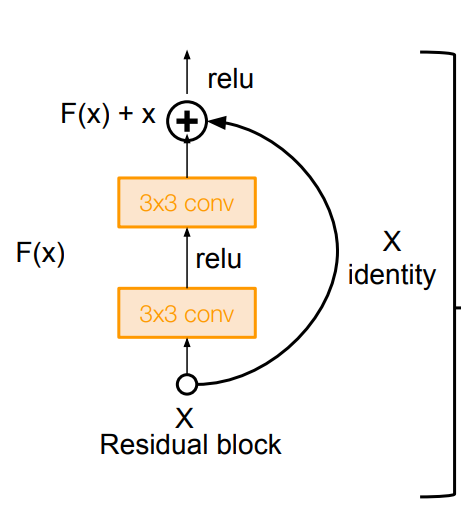

ResNet에서 보았던 계층 구성 방식 그림이 보입니다.

신경망 이름에서도 알 수 있듯이, 더 넓은 필터를 사용했고, 계층 깊이 대신 넓이를 증가시킨 형태 입니다.

ResNet은 계층이 152개인데, Wide Residual Networks는 50개의 계층으로 ResNet을 이겼습니다.

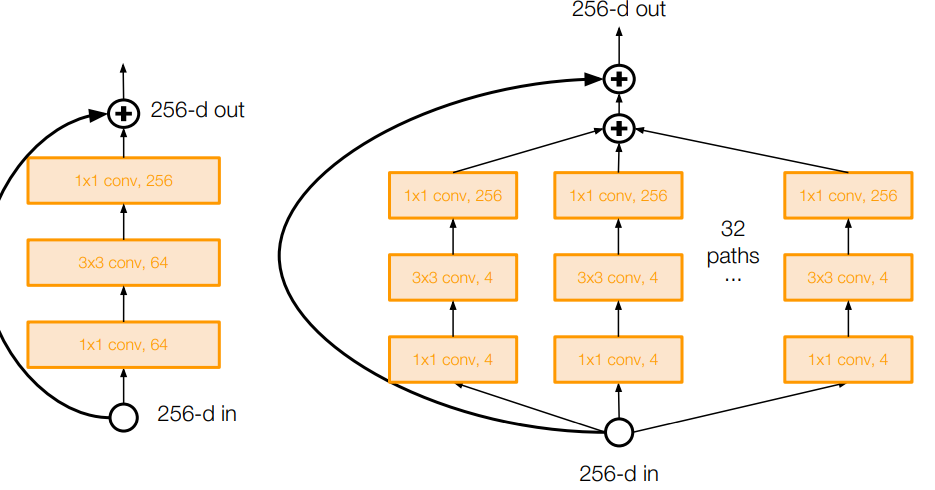

ResNext

ResNet연구진들이 만든 ResNext입니다.

ResNet의 블록보다 넓이를 키우고, GoogleNet의 인셉션 모듈처럼 BottleNeck이 보인다는 특징을 갖고 있습니다.

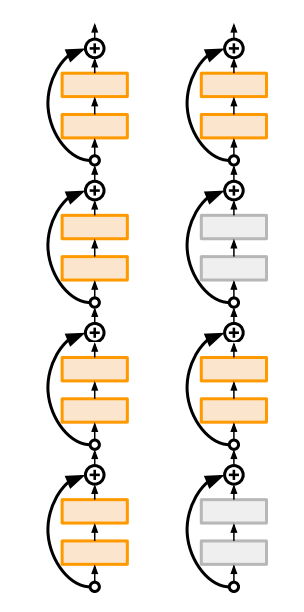

Deep Networks with Stochastic Depth

이 모델은 기울기 사라짐 문제를 최소화 하고, train동안 Dropout을 통해, 상대적으로 짧은 layer를 거치게 됩니다. 그래서 train 시간을 줄이게 되었습니다.

Dropout은 무작위로 하게 됩니다.

또한 test시에는 전체 계층을 사용한다는 특징을 갖고 있습니다.

기울기 사라짐 문제는 Backpropagation시에, 역방향으로 기울기를 전달하는데, 이때 기울기 값이 점점 작아지는 문제라고 한다.

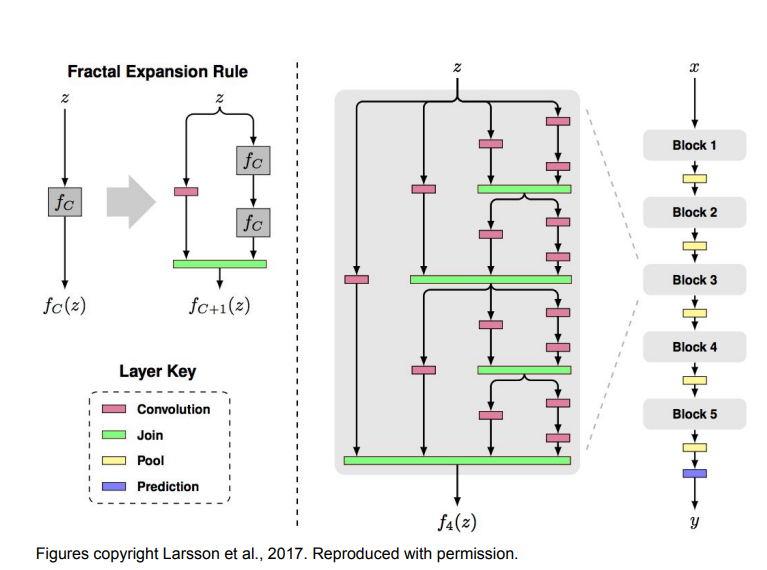

FractalNet

또한 위와 비슷한 모델인 FractalNet입니다.

중복 표현 (모델 내에서 비슷한 레이어를 반복적으로 사용하는 것)을 사용 안했고, train시에는 Dropout, test시에는 전체 계층을 다 사용했다는 특징을 갖고 있습니다.

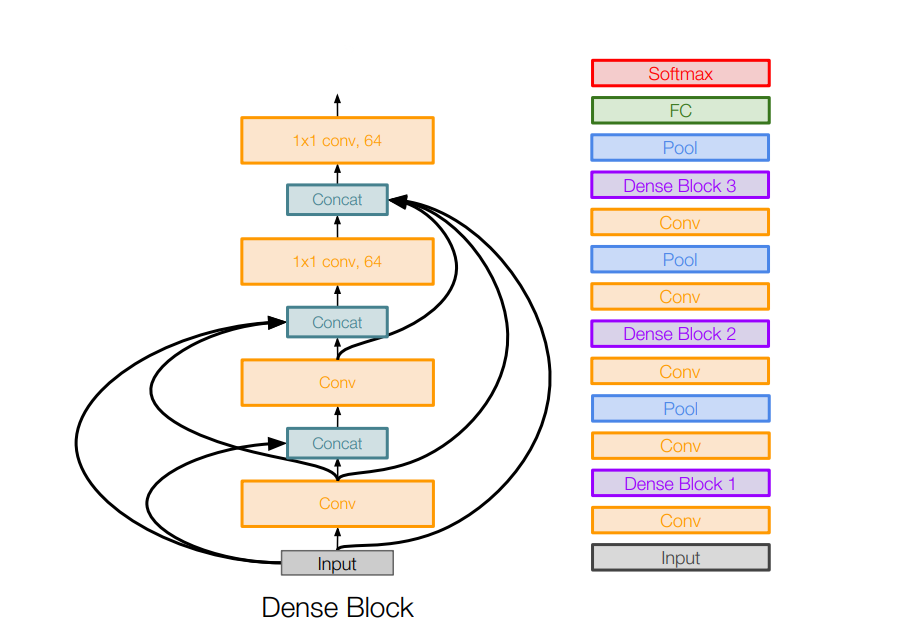

DenseNet

Dense Block을 보면, 전의 계층에서 다음 계층까지 계속 연결되어 있는 구조가 보입니다.

이 구조를 피쳐 재사용 구조라고 합니다.

정말 획기적이다

SqueezeNet

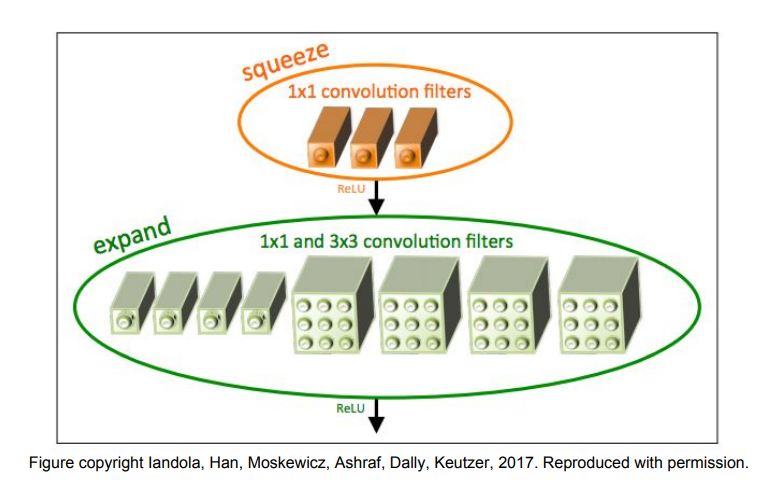

squeeze 계층을 expand계층으로 전달하는 구조 입니다.

squeeze계층에서는 1x1 필터를 적용하고, expand 계층에서는 1x1, 3x3 필터를 적용하여 그냥 계층에 이름 붙일 때 squeeze, expand라고 붙인거 같습니다.

50배 적은 파라미터 수로, AlexNet과 비슷한 정확도를 끌어 올렸고, 510배 더 작게 압축이 가능하다고 합니다.

ResNet 다음으로는 너무 간략하게 설명해줘서 나중에 논문 읽어봐야겠다...

감사합니당 ~ 🦾