배깅 개요

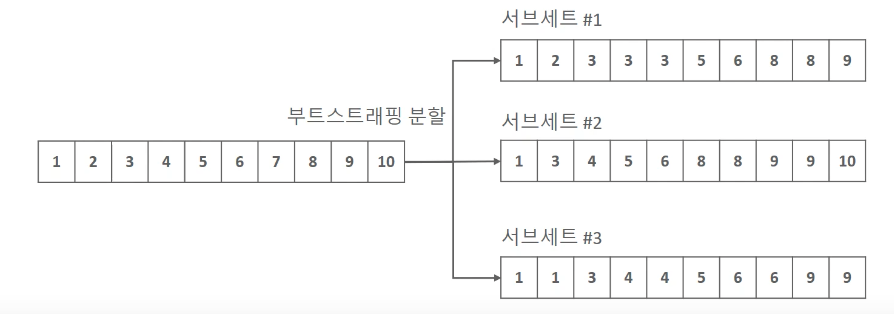

배깅 (Bagging)은 Bootstrap aggregating의 줄인말이다.

앙상블 학습의 유형 중 하나로 부트스트랩 방식으로 데이터에서 샘플링을 해서

하나의 분류기로 소프트 보팅을 하는 것!

보팅은 같은 데이터로 서로 다른 분류기로 예측을 하고 제일 좋은 것 하나를 선택하기 때문에 차이가 있음

배깅의 샘플링 방식의 예시 그림 (복원 추출이기 때문에 이렇게 같은 데이터가 뽑힐 수 있음)

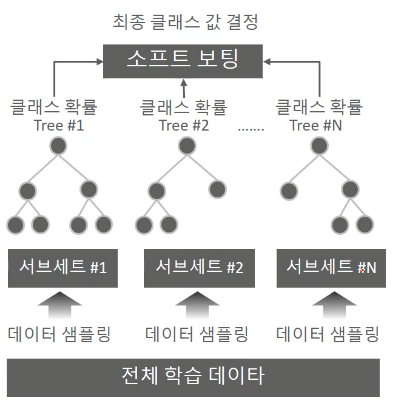

랜덤 포레스트

랜덤 포레스트 (Random Forest)는 배깅의 대표적인 알고리즘이다.

여러 개의 결정 트리 (Decision Tree)를 앙상블 하는 것!

랜덤 포레스트 실습

결정 트리 실습 때 사용 했던 사용자 행동 인식 데이터를 사용함 (링크)

데이터 불러올 때 사전 작업이 좀 있음 (중요x)

test 데이터 분리하는 함수까지 만들기

import pandas as pd

def get_new_feature_name_df(old_feature_name_df):

feature_dup_df = pd.DataFrame(data=old_feature_name_df.groupby('column_name').cumcount(),

columns=['dup_cnt'])

feature_dup_df = feature_dup_df.reset_index()

new_feature_name_df = pd.merge(old_feature_name_df.reset_index(), feature_dup_df, how='outer')

new_feature_name_df['column_name'] = new_feature_name_df[['column_name', 'dup_cnt']].apply(lambda x : x[0]+'_'+str(x[1])

if x[1] >0 else x[0] , axis=1)

new_feature_name_df = new_feature_name_df.drop(['index'], axis=1)

return new_feature_name_df

def get_human_dataset( ):

# 각 데이터 파일들은 공백으로 분리되어 있으므로 read_csv에서 공백 문자를 sep으로 할당.

feature_name_df = pd.read_csv('./human_activity/features.txt',sep='\s+',

header=None,names=['column_index','column_name'])

# 중복된 피처명을 수정하는 get_new_feature_name_df()를 이용, 신규 피처명 DataFrame생성.

new_feature_name_df = get_new_feature_name_df(feature_name_df)

# DataFrame에 피처명을 컬럼으로 부여하기 위해 리스트 객체로 다시 변환

feature_name = new_feature_name_df.iloc[:, 1].values.tolist()

# 학습 피처 데이터 셋과 테스트 피처 데이터을 DataFrame으로 로딩. 컬럼명은 feature_name 적용

X_train = pd.read_csv('./human_activity/train/X_train.txt',sep='\s+', names=feature_name )

X_test = pd.read_csv('./human_activity/test/X_test.txt',sep='\s+', names=feature_name)

# 학습 레이블과 테스트 레이블 데이터을 DataFrame으로 로딩하고 컬럼명은 action으로 부여

y_train = pd.read_csv('./human_activity/train/y_train.txt',sep='\s+',header=None,names=['action'])

y_test = pd.read_csv('./human_activity/test/y_test.txt',sep='\s+',header=None,names=['action'])

# 로드된 학습/테스트용 DataFrame을 모두 반환

return X_train, X_test, y_train, y_test데이터 분리하고 Random Forest 학습/예측 후 정확도 측정하기

from sklearn.ensemble import RandomForestClassifier

from sklearn.metrics import accuracy_score

import pandas as pd

import warnings

warnings.filterwarnings('ignore')

# 결정 트리에서 사용한 get_human_dataset( )을 이용해 학습/테스트용 DataFrame 반환

X_train, X_test, y_train, y_test = get_human_dataset()

# 랜덤 포레스트 학습 및 별도의 테스트 셋으로 예측 성능 평가

rf_clf = RandomForestClassifier(random_state=0)

rf_clf.fit(X_train , y_train)

pred = rf_clf.predict(X_test)

accuracy = accuracy_score(y_test , pred)

print('랜덤 포레스트 정확도: {0:.4f}'.format(accuracy))랜덤 포레스트 정확도: 0.9253몇 가지 파라미터 이용해서 그리드 서치 진행

n_jobs=-1은 CPU를 풀로 돌리겠다는 뜻임 (코드를 좀 더 빨리 돌림)

교차 검증은 2회만 실시

from sklearn.model_selection import GridSearchCV

params = {

'n_estimators':[100],

'max_depth' : [6, 8, 10, 12],

'min_samples_leaf' : [8, 12, 18 ],

'min_samples_split' : [8, 16, 20]

}

# RandomForestClassifier 객체 생성 후 GridSearchCV 수행

rf_clf = RandomForestClassifier(random_state=0, n_jobs=-1)

grid_cv = GridSearchCV(rf_clf , param_grid=params , cv=2, n_jobs=-1 )

grid_cv.fit(X_train , y_train)

print('최적 하이퍼 파라미터:\n', grid_cv.best_params_)

print('최고 예측 정확도: {0:.4f}'.format(grid_cv.best_score_))최적 하이퍼 파라미터:

{'max_depth': 10, 'min_samples_leaf': 8, 'min_samples_split': 8, 'n_estimators': 100}

최고 예측 정확도: 0.9180최적 하이퍼 파리미터 조합으로 피팅하고 예측하기

rf_clf1 = RandomForestClassifier(n_estimators=100, max_depth=10, min_samples_leaf=8, \

min_samples_split=8, random_state=0)

rf_clf1.fit(X_train , y_train)

pred = rf_clf1.predict(X_test)

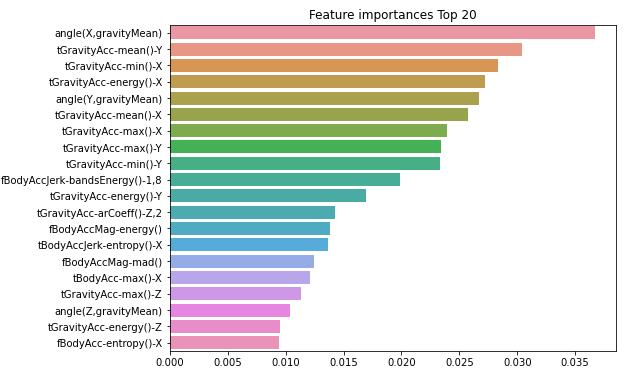

print('예측 정확도: {0:.4f}'.format(accuracy_score(y_test , pred)))예측 정확도: 0.9196Feature Importances 시각화하기

feature_importances_는 많이 쓸 거니까 잘 봐두기

칼럼이 엄청 많으니까 Top 20 뽑아서 확인

import matplotlib.pyplot as plt

import seaborn as sns

%matplotlib inline

ftr_importances_values = rf_clf1.feature_importances_

ftr_importances = pd.Series(ftr_importances_values,index=X_train.columns )

ftr_top20 = ftr_importances.sort_values(ascending=False)[:20]

plt.figure(figsize=(8,6))

plt.title('Feature importances Top 20')

sns.barplot(x=ftr_top20 , y = ftr_top20.index)

plt.show()