딥러닝은 XOR문제에서 답을 선형적으로 구분하는 Line을 찾으려는 노력에서 시작되었다.

기본적인 problem들..

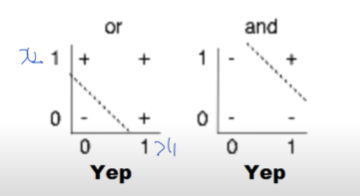

AND/OR Problem은 linearly 하게 separate할 수 있는 line이 존재한다.

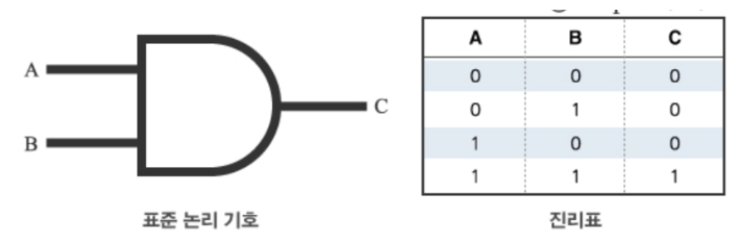

AND

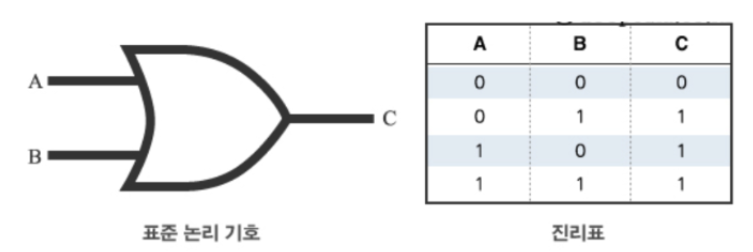

OR

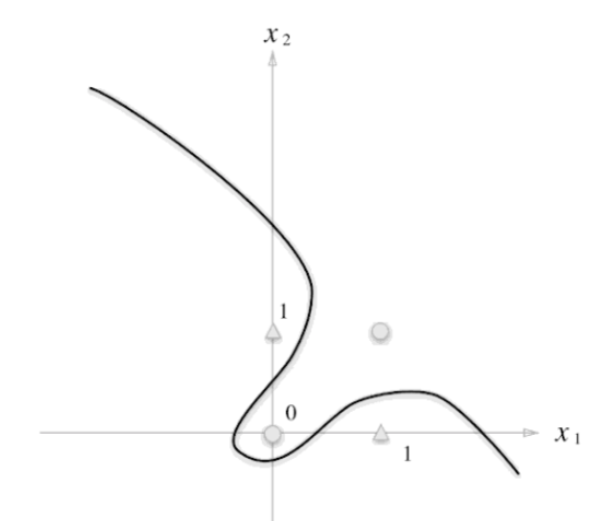

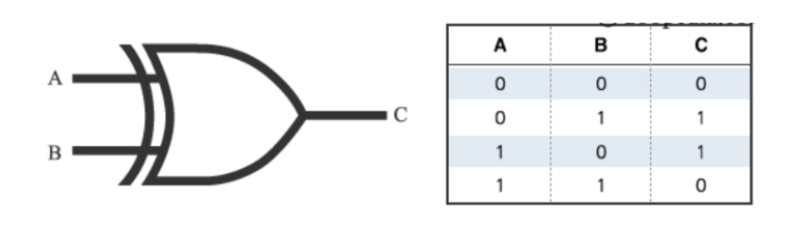

하지만 아래와 같은 XOR문제는 선형방정식으로 풀지 못한다.

XOR

[XOR 문제 해결을 위한 역사]

1. MLP

-> train 불가..

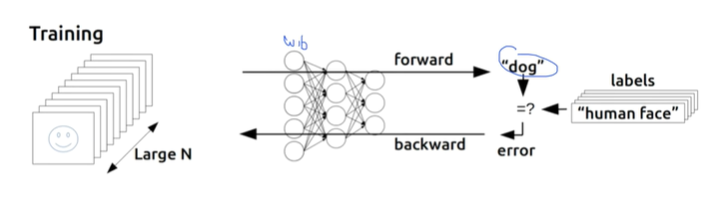

2. Backpropagation

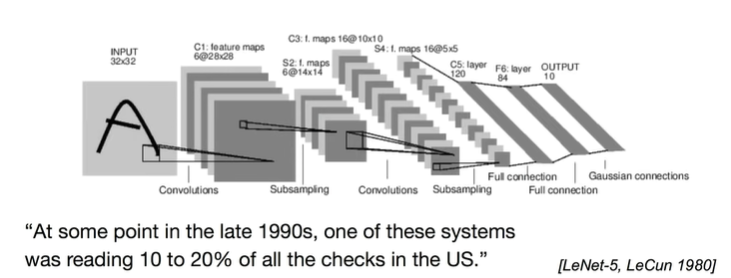

3. Convolutional Neural Networks

고양이가 그림의 전체적인 부분을 보는 것이 아니라, 처음 볼 때는 부분부분 뜯어서 본다는 것, 그림의 부분 부분을 달리 보면서, 그때마다 각각 서로 다른 뉴런이 활성화되는 것을 발견함

-> convolution 의 아이디어

결과적으로 한계가 존재.

Backpropagation이 끝에서 처음부분, 입력단으로 거꾸로 가면서, 학습을 할 때 점점 그 의미가 퇴화되어 깊은 신경망에서는 학습이 잘 이뤄지지 않는 현상이 발생함.

오히려 간단한 머신러닝 알고리즘이 더욱 학습이 잘 되는 아이러니한 일도 발생함 -> SVM,RandomForest, etc.

Breakthrough

=> 2006/2007 Breackthrough라는 이름의 논문과 함께 깊은 신경망에 대해 train, 학습할 수 있는 방법에 대한 내용이 발표됨

=> 아이디어: "if the weights are initialized in a clever way rather than randomly,"

Neural networks with many layers really could be trained well.