📒 RNNs

이미 한번 배운 내용을 다시 설명해주셔서 좋은 복습이 되었다.

input - hidden - outpur 과정을 상세히 설명해주셔서 좋았다.

미래에는 컴퓨터가 코딩을 대신 해준다더니 그 기술이 RNN일줄 몰랐다.

예시를 많이 들어주셔서 큰 도움이 되었다.

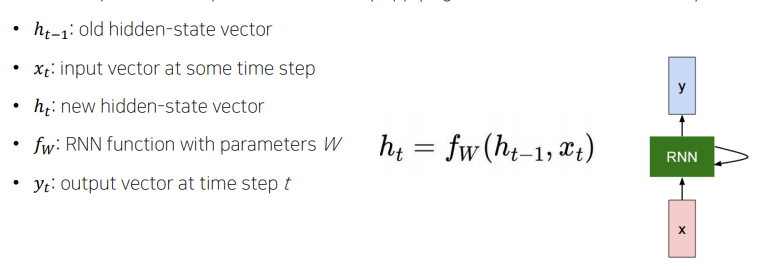

📝 Basic

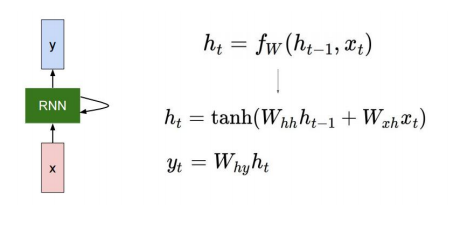

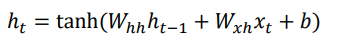

- hidden state를 구하는 공식은 다음과 같다.

- 보통 활성화 함수를 사용한다.

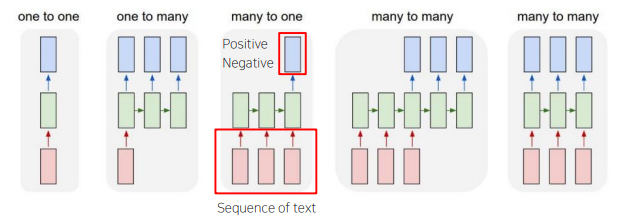

- 입 출력 갯수에 따라 종류가 다양하다.

📝 'hello' model

- character level에서 다음 나올 문자를 예측하는 모델

- traning sequence로 'hello' 한 개의 문자열을 넣는다.

- Vocabulary : [h, e, l, o]

- 각 character를 one-hot vector로 놓는다.

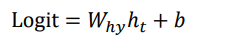

- 하단 공식으로 hidden layer의 값을 먼저 구한다.

- 각 timestep마다 output vector를 얻어낸다.

- 전체적인 플로우는 다음과 같다.

📒 LSTM and GRU

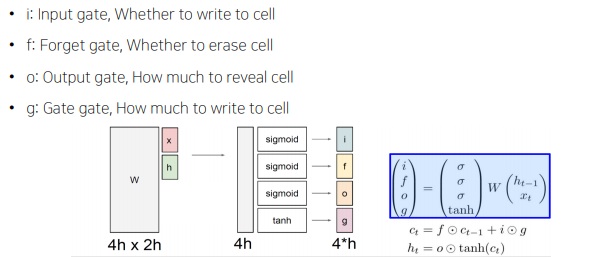

📝 LSTM

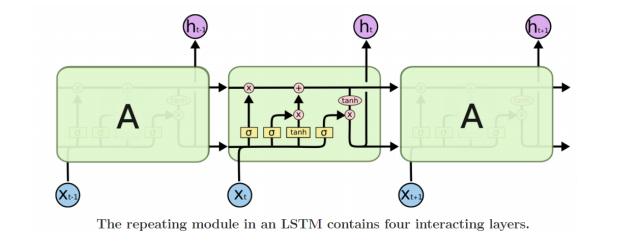

- hidden state vector에서 time step이 길어도 이전 것들을 가져올 수 있게끔 개선했다.

- 연산 과정을 구체적으로 살펴보면 다음과 같다.

- 각 gate에 대한 정보는 링크 에 정리되어 있다.

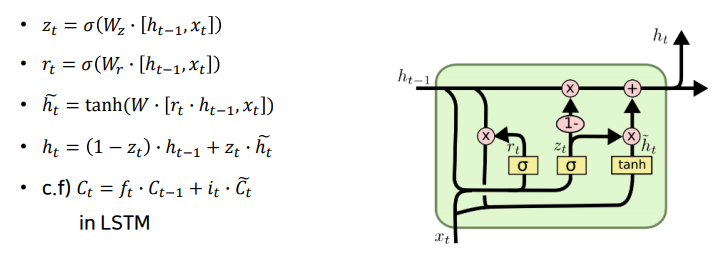

📝 GRU

- LSTM을 경량화하여 적은 메모리 요구량과 빠른 계산시간을 갖는다.