💥 AI는 GPU 전쟁이다

초거대 언어모델 시대, 누가 더 많은 GPU를 갖고 있는가?

요즘 AI 개발 경쟁은 사실상 GPU 확보 전쟁이라고 해도 과언이 아닙니다.

GPT-4 같은 초거대 언어모델을 학습하려면 수만 개 이상의 고성능 GPU가 필요하며,

이를 확보하려는 글로벌 기업과 국가들의 경쟁이 매우 치열해졌습니다.

GPU 확보에 사활을 건 글로벌 기업들

1️⃣ OpenAI (feat. Microsoft)

- 마이크로소프트는 OpenAI에 Azure 클라우드 + 수만 개의 A100/H100급 GPU를 제공

- GPT-4 학습에만 약 10,000개 이상의 GPU가 사용된 것으로 보고됨

2️⃣ NVIDIA

- GPU 제조사이자 연구 주도 기업

- 자사 슈퍼컴 Selene에는 A100 약 4,500개 탑재

- 고객뿐 아니라 자체 AI 연구도 활발히 진행 중

3️⃣ Meta (Facebook)

- LLaMA 등 자체 모델 개발 위해 대규모 인프라 확보

- 2023년 기준 21,000개 이상 A100/H100 GPU 운영 발표

4️⃣ Google

- TPU 중심이지만, GPU도 함께 활용

- TPU Pod로 수천 개 TPU 운영하며, GPU도 수만 개 이상 보유로 추정

5️⃣ Amazon (AWS)

- 세계 최대 GPU 클라우드 인프라 운영

- 고객용 + 자사용으로 수십만 개 GPU 인스턴스 가동 중

6️⃣ Anthropic

- Claude 모델 개발사

- 2024년 기준 수천 개 A100/H100 확보 공식 발표

아래 사진 출처 링크

🌍 GPU 패권 경쟁 중인 국가들

| 국가 | 동향 요약 |

|---|---|

| 🇺🇸 미국 | OpenAI, Google, Meta, Amazon 등 빅테크가 수십만~수백만 개 GPU 자원 보유 |

| 🇨🇳 중국 | Alibaba, Tencent, Baidu 등 주요 기업이 수만 개 단위 GPU 클러스터 운용 |

| 🇦🇪 UAE | G42, Falcon LLM 개발 위해 수천~수만 개 GPU 확보 |

| 🇸🇦 사우디 | 세계 최대 AI 데이터센터 추진, 대규모 GPU 인프라 구축 중 |

| 🇶🇦 카타르 | 국가 차원의 AI 전략에 따라 GPU 클러스터 대형화 계획 발표 |

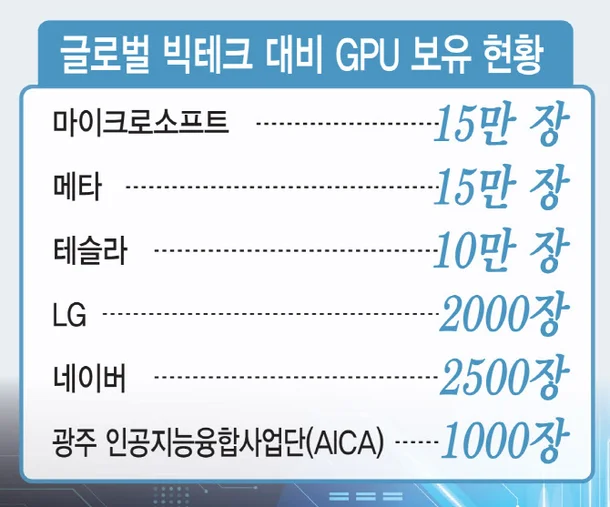

🇰🇷 한국의 GPU 상황은?

- 네이버, 카카오, 삼성, LG 등 자체 GPU 팜 보유

- 대부분 수백~수천 개 수준에 머물러 있음

- 정부 주도의 AI 초거대 인프라 사업으로 10,000개 이상 GPU 확보 계획 발표 (~2025년)

- 하지만 GPT-4 학습에 필요한 수만 개에는 크게 못 미침

✅ 한눈에 요약

| 항목 | 내용 |

|---|---|

| GPT-4급 모델 학습 | 10,000개 이상 GPU 필요 |

| GPU 최다 보유국 | 미국 (OpenAI, Meta, Google, Amazon 등) |

| 국가 간 경쟁 | 미국 vs 중국, 중동 국가들(UAE, 사우디 등)의 GPU 투자 확대 |

| 한국 상황 | 수천 개 보유 예정이나 글로벌 대비 부족 |

왜 이게 중요한가?

GPU는 단순한 하드웨어가 아닙니다.

지금은 AI 국력의 핵심 자원으로 떠올랐고,

얼마나 많은 GPU를 확보했는지가 초거대 AI 개발 능력을 좌우합니다.