Basic of Regression

학습 데이터 각각에 정답이 주어져 있는 학습을 지도학습 이라고 하며, 이 정답을 연속된 값으로 예측하는 것을 회귀라 한다.

- 학습 데이터 셋을 학습 알고리즘에 넣어 학습시킨뒤, 테스트하고자 하는 값을 이 알고리즘에 넣어 예측값을 얻어낸다.

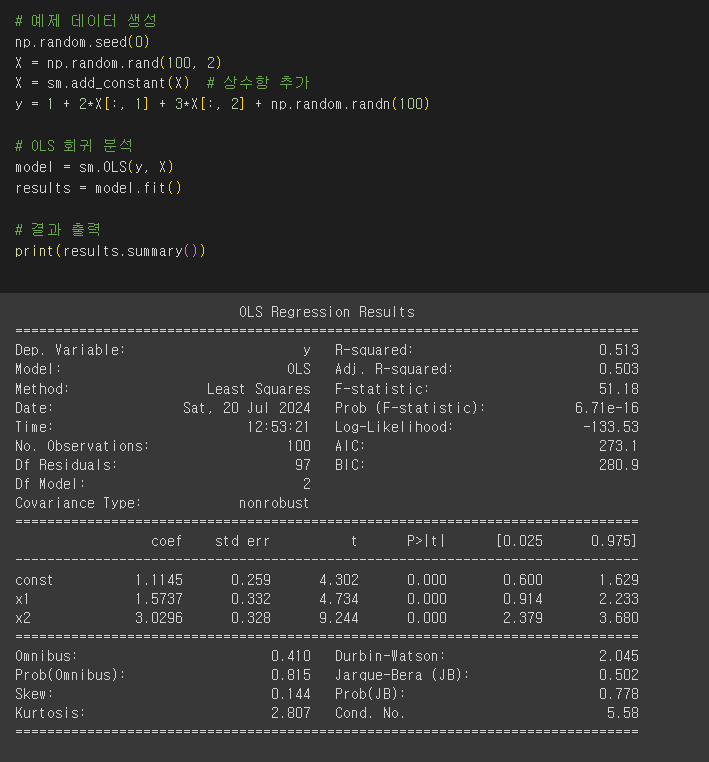

OLS

Ordinary Linear Least Square (최소 제곱법)

- 주어진 데이터세트에서 종속 변수 y와 독립변수 x간의 선형관계를 모델링하는데 사용된다.

- 실제 관측값(y)과 예측값(y_hat) 간의 오차의 제곱합을 최소화하는 회귀선을 찾는 것이 목적이다.

- 데이터 전체에 대한 모든 행렬을 구하고 거기에 역행렬을 취하는 것.

Cost Function

가설이 얼마나 정확한지 판단하는 기준을 말하며, loss function 의 합, 평균 에러를 다룬다. 순간 마다의 loss를 판단할때는 loss function을 사용하고, 학습이 완료된 후에는 전체 데이터에 대한 cost function을 확인한다.

Cost Function과 Gradient Descent

- 실제 데이터는 너무 복잡해서 손으로 풀기 어렵기 때문에 평면상의 방정식이 아니라 다차원에서 고민해야할 때가 많음.

- 때문에 단순하게 한번의 시도로 cost function의 최소값을 구할 수 없을 때가 더 많다.

- 이를 위해 Gradient Descent를 사용하여 cost function이 최소값을 가지는 지점을 확인한다.

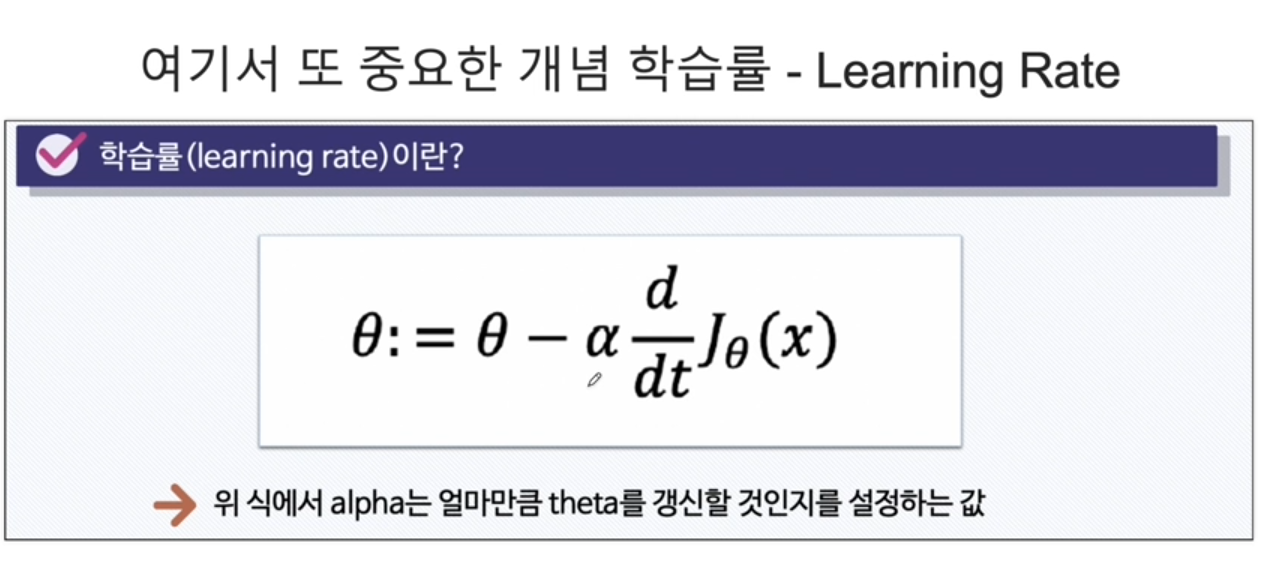

Gradient Descent

- 랜덤하게 임의의 점을 선택

- 임의의 점에서 미분(or편미분)한 값을 계산해서 업데이트

- 계산한 값을 원래 방정식의 또는 에 차감을 시켜 방정식을 업데이트 시킨다.

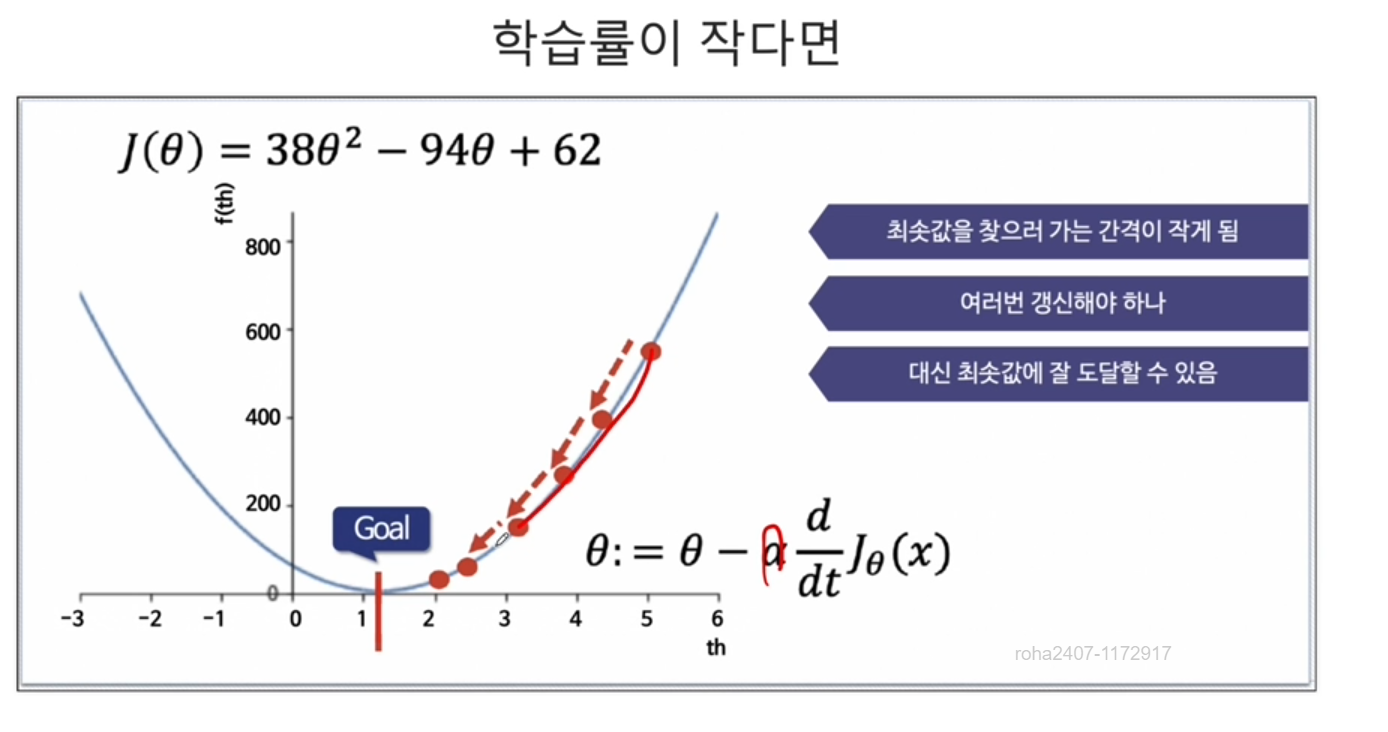

- 학습률이 크다면 최솟값을 찾으러 가는 간격이 크게 되고, 찾게 되어도 갱신횟수는 상대적으로 적을 수 있으나 수렴하지 않고 진동할 수도 있음.

- 따라서 학습률은 적당한 값을 찾아야 하는 hyper parameter이다.

- 다변수 데이터에 대한 회귀의 경우 Multivariate Linear Regression으로 해결한다.