머신러닝

1.머신 러닝 3가지 종류

아침의 맑은 정신으로 오전 10시에 사람들과 머신러닝 스터디를 진행하기로 했다.주중에 20분동안 책을 읽고 각자 중요하게 생각하는 부분 또는 궁금한 점을 질문하는 식으로 진행하였다.책은 「머신러닝 교과서 with 파이썬, 사이킷런, 텐서플로」로 정해서 읽고있다.워낙 수

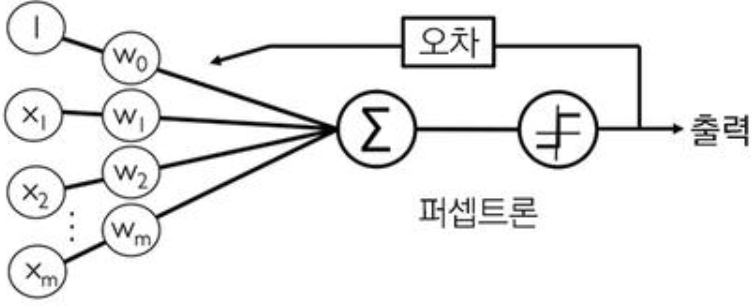

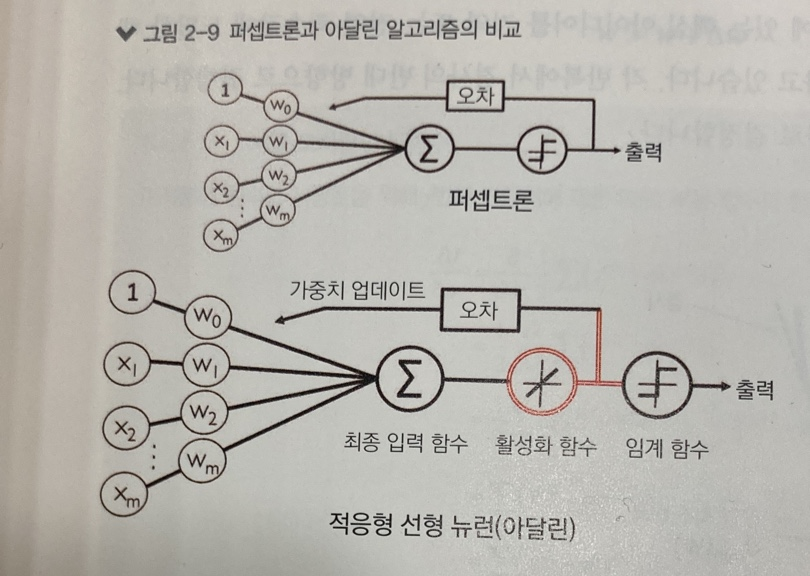

2.퍼셉트론 알고리즘

인공신경망의 기본이 되는 알고리즘.: 입력 데이터를 두 클래스로 분류하기 위해 가중치를 학습간단하게 과정 설명샘플 x를 입력받아 가중치 w를 연결하여 최종 입력을 계산하는 방법. 최종 입력은 임계함수로 전달되어 샘플의 예측 클래스 레이블인 -1 or +1의 이진 출력

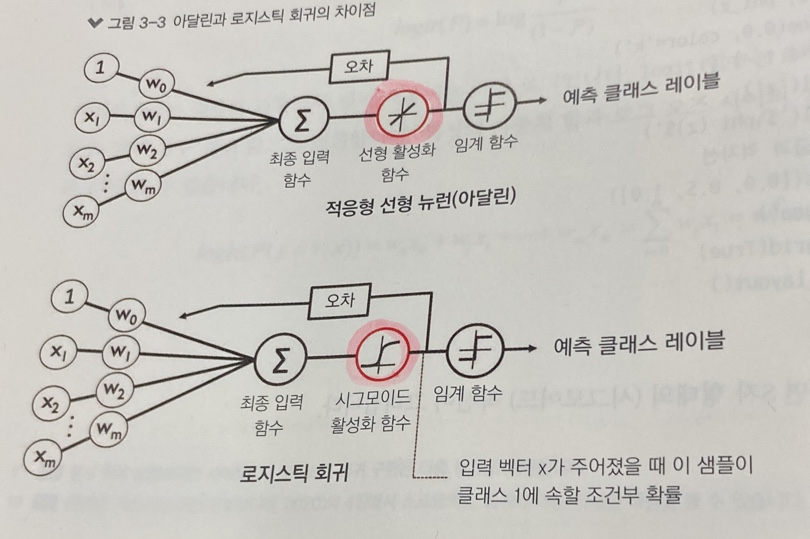

3.아달린

적응형 선형 뉴런을 표현경사하강법을 통해 가중치를 업데이트하여 예측 오류를 최소화하는 학습 알고리즘함수의 최소값(또는 최대값)을 찾기 위해 반복적으로 매개변수(가중치)를 업데이트하는 방법함수의 최소값을 왜 찾지?최소값 -> 최적의 성능을 의미실제값과 예측값의 차이가 작

4.로지스틱 회귀를 사용한 클래스 확률 모델

입력 변수에 대한 가중합을 시그모이드 함수에 통과시켜 확률값을 예측하고, 이를 기반으로 이진 분류 문제를 해결하는 통계적 모델이진 분류를 위한 선형모델이기도 함.정의이진 분류에서 입력값을 0과 1 사이의 확률 값으로 변환하는 S자 형태의 비선형 함수특징지수 함수: 시그

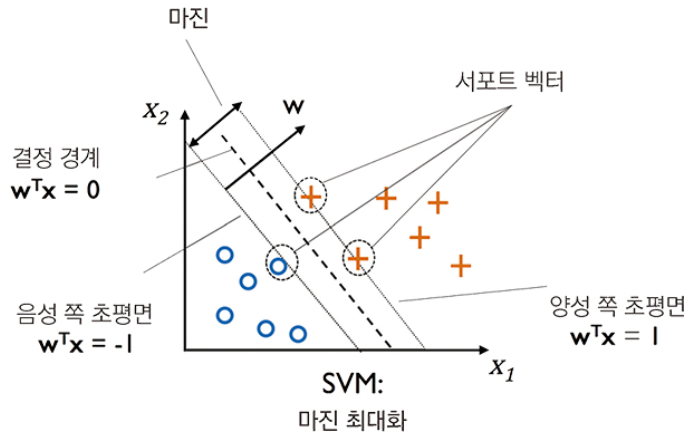

5.서포트 벡터 머신(SVM), 결정 트리

SVM SVM이란? 두 클래스 간의 최대 마진을 가지는 결정 경계를 찾는 지도 학습 알고리즘. 마진이란? 결정경계에 가장 가까운 데이터 점(서포트 벡터)과의 거리 결정 경계란? 두 클래스를 구분짓는 경계 >최대 마진이 왜 필요한걸까? 마진이 클수록 일반화 오차

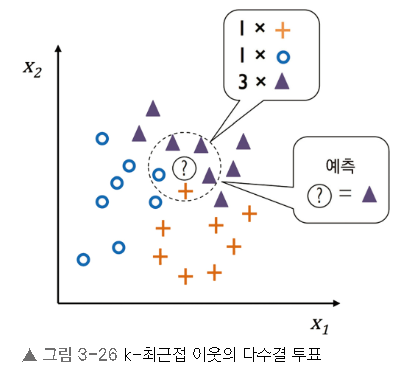

6.KNN(k-최근접 이웃)

기존의 알고리즘처럼 훈련데이터에서 판별함수를 학습하는 것이 아니라 훈련데이터셋을 메모리에 저장하는 것.\*출처: 머신 러닝 교과서 with 파이썬, 사이킷런, 텐서플로위 과정처럼 최근접 이웃을 뽑아 다수결 투표로 진행 > 동점 처리는 물음표에 더 가까운 이웃으로모수 모

7.데이터 전처리

좋은 머신 러닝 모델을 구축하는데 중요한 것은, 데이터를 주입하기 전에 조사하고 전처리하는 것! -> 데이터 전처리1\. 누락된 값을 제거하거나 대체하기제거를 하게되면 데이터를 너무 많이 잃게 될 때는 대체하는 것도 좋은 방법대체(보간; 주어진 데이터 포인트 사이에 값

8.차원 축소를 사용한 데이터 압축

차원 축소를 위한 또 다른 방식 -> 특성 추출원본 특성을 유지 여부 \- 특성 선택은 원본이 유지되지만, 추출은 유지X데이터의 차원을 축소하면서도 정보 손실을 최소화하기 위해, 데이터 분산이 가장 큰 방향(주성분)을 찾아 새로운 축으로 변환하는 비지도 학습 기법

9.머신러닝 모델 성능 평가, 학습 곡선 & 검증 곡선

일반화 성능 추정 방법초기 데이터셋을 별도의 훈련데이터셋과 테스트 데이터셋으로 분리하여 훈련 세트로 모델을 학습시키고 테스트 세트로 모델 성능을 평가하는데 사용하는 기법가장 좋은 방법은 훈련/검증/테스트 데이터셋 3개로 나누는 것.단점: 데이터 분할 방식에 민감 ->

10.앙상블 학습

여러 분류기를 하나의 메타 분류기로 연결하여 더 좋은 일반화 성능을 달성하는 것. 1. 과반수 투표 50% 이상 투표를 받은 클래스 레이블 선택 2. 다수결 투표 가장 많은 투표(최빈값)를 받은 클래스 레이블 선택 **다수결 투표를 이진분류에 적용하면 자동으로 과반

11.감성 분석

감정 분석: 사람들의 의견, 리뷰가 긍정 정보인지 부정 정보인지 구별하고 분석하는 것. 자연어 처리의 하위분야. 문서성향분석=> 대표적 작업: 특정 주제에 대해 표현한 의견이나 감정을 기반으로 문서를 분류하는 것텍스트나 단어 같은 범주형 데이터는 알고리즘에 주입하기 전

12. 선형 회귀

선형 회귀: 하나 이상의 특성(설명변수, x)과 연속적인 타킷 변수(응답 변수, y) 사이의 관계를 모델링 하는 것.단순 회귀: 특성 한개다중 회귀: 특성 여러 개회귀직선: 위 그림처럼 데이터와 가장 잘 맞는 직선오프셋(잔차,오차) : 이 회귀 직선과 훈련 샘플 사이의

13.군집 분석

비지도학습: 정답을 모르는 데이터 안에서 숨겨진 구조나 정보를 찾는 것.종류: 1) 프로토타입 기반(k-평균, 계층적 군집): 각 클러스터가 하나의 프로토타입으로 표현됨. 연속적인 특성에서도 비슷한 데이터 포인트의 센트로이드(평균)이거나, 범주형 특서에서는 메도이드(대