강의 복습 내용

8. 베이즈 통계론 맛보기

: Posterior (사후 확률)

: Prior (사전 확률)

: Likelihood (가능도)

: Evidence

, - True Positive

, - False Negative

, - False Positive

, - True Positive

- Precision (정밀도)

- Recall (민감도)

- 인과 관계

데이터 분포의 변화에 강건한(Robust) 예측 모형을 만들 때 필요

중첩요인(Confounding Factor)의 효과를 제거해야 해당 변수끼리의 인과 관계를 알 수 있다.

과제 수행과정, 결과 정리

선택과제 1 Gradient Descent

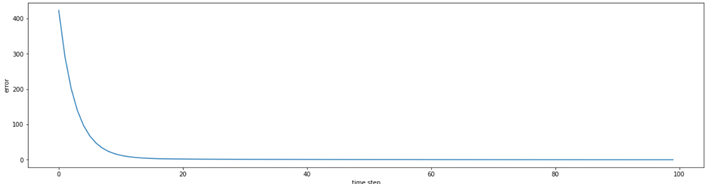

Gradient descent error plot

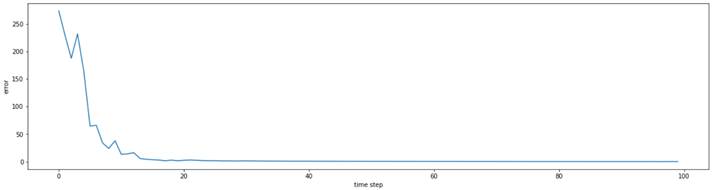

Mini-batch gradient descent error plot

피어세션 정리

8월 6일 금요일 피어세션

- 추창한님 새로 오셨습니다!!

- 코딩테스트 이야기

- 멘토님과의 대화내용

- 한준님의 공분산, 왜도, numpy random 함수, MLE, 선형변환 내용발표 & 알고리즘 풀이방법 공유

- 전공에 대한 고민 공유

학습회고

선택과제1만 수행했는데, 주말동안 선택과제 2,3도 더 살펴보고 다음 주 일정으로 넘어가고 싶다.