1. 생성 모델링의 개요와 데이터 유형

생성 모델링의 일반적 프레임워크

생성 모델링의 목표는 데이터 분포 에서 추출된 데이터셋 이 주어졌을 때, 이를 근사하는 파라미터화된 모델 를 학습하는 것입니다. 모델이 잘 학습된다면, 우리는 새로운 흥미로운 샘플을 생성할 수 있게 됩니다.

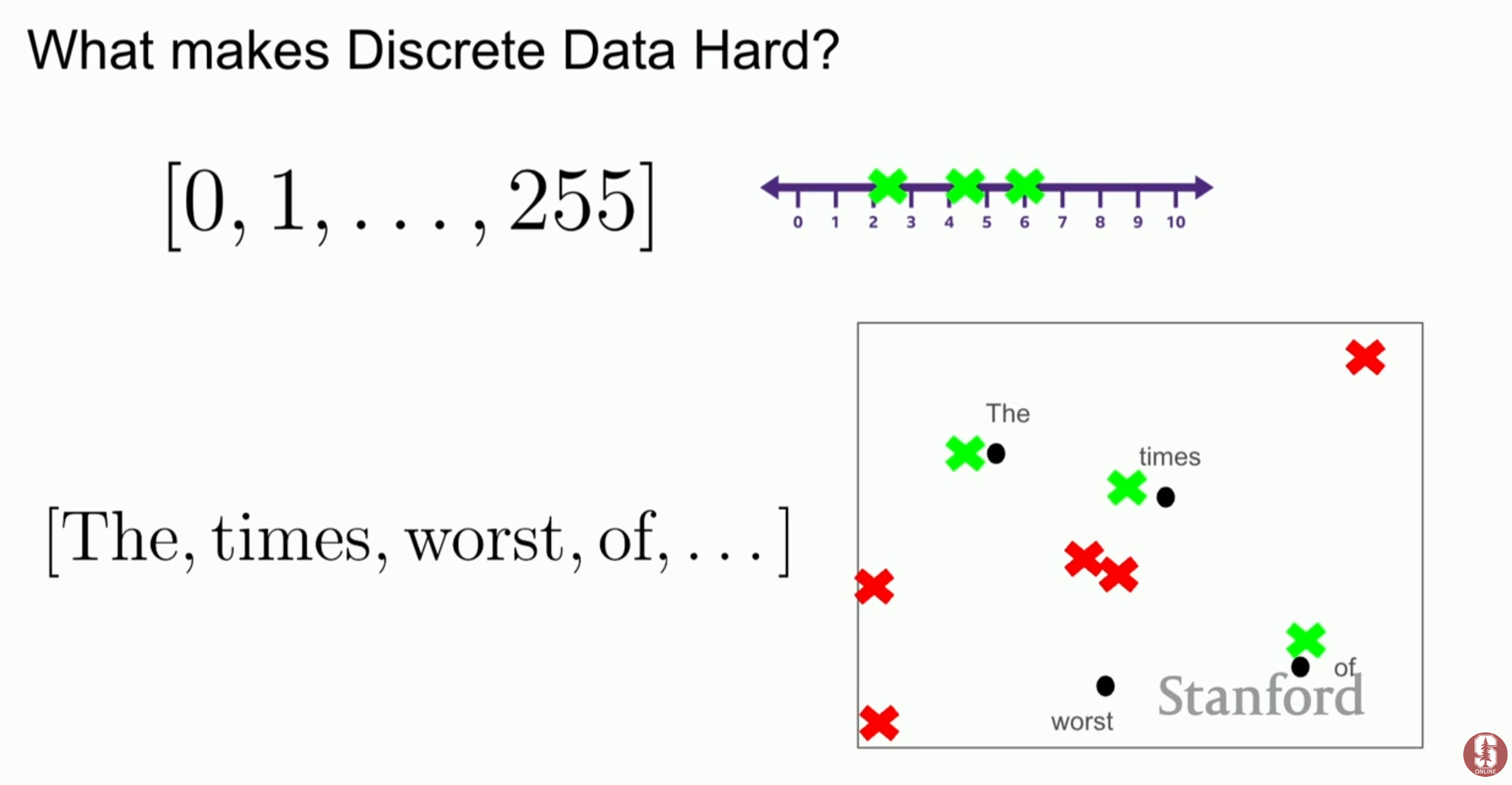

연속형 데이터 vs 이산형 데이터

기존에 학습한 GAN, VAE, Diffusion Model 등 대부분의 생성 모델은 이미지를 주된 대상으로 하며, 이는 연속적인 데이터 공간()을 가정합니다.

- 연속 공간의 특성: 픽셀 값 사이를 보간(interpolate)해도 여전히 유효한 이미지 샘플이 됩니다. 이는 연속 공간 모델링의 근본적인 이점입니다.

- 이산 공간의 특성: 텍스트나 DNA 서열과 같은 이산 데이터 공간()은 격자(lattice) 구조를 가집니다. 이 공간에서는 데이터 포인트 사이의 값을 취하는 것이 불가능하며, 이는 이산 데이터 모델링을 근본적으로 어렵게 만듭니다.

이산 데이터 모델링의 중요성

이산 데이터 모델링이 중요한 이유는 다음과 같습니다.

- 대규모 언어 모델(LLM): ChatGPT와 같은 모델은 근본적으로 이산적인 문장(토큰 시퀀스)을 생성합니다.

- 과학적 응용: DNA, 단백질, 분자 구조 등은 모두 이산 데이터이며, 이를 생성하는 것은 신약 개발 등에 큰 영향을 미칩니다.

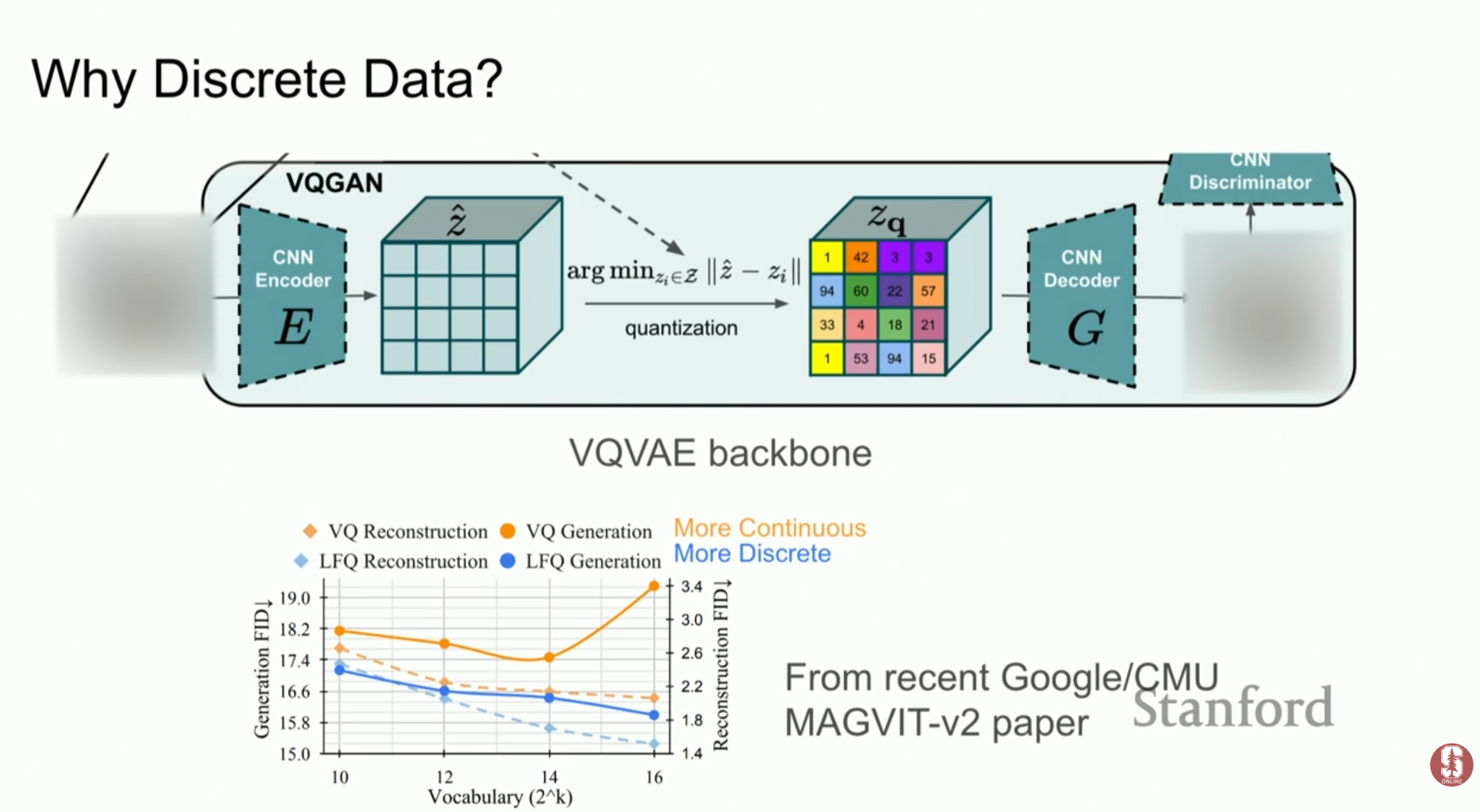

- 이미지 압축: Stable Diffusion과 같은 최신 모델은 VQ-VAE 등을 통해 이미지를 이산화된 잠재 공간(discrete latent space)으로 압축하여 사용합니다.

2. 이산 데이터 모델링의 난제와 기존 접근법

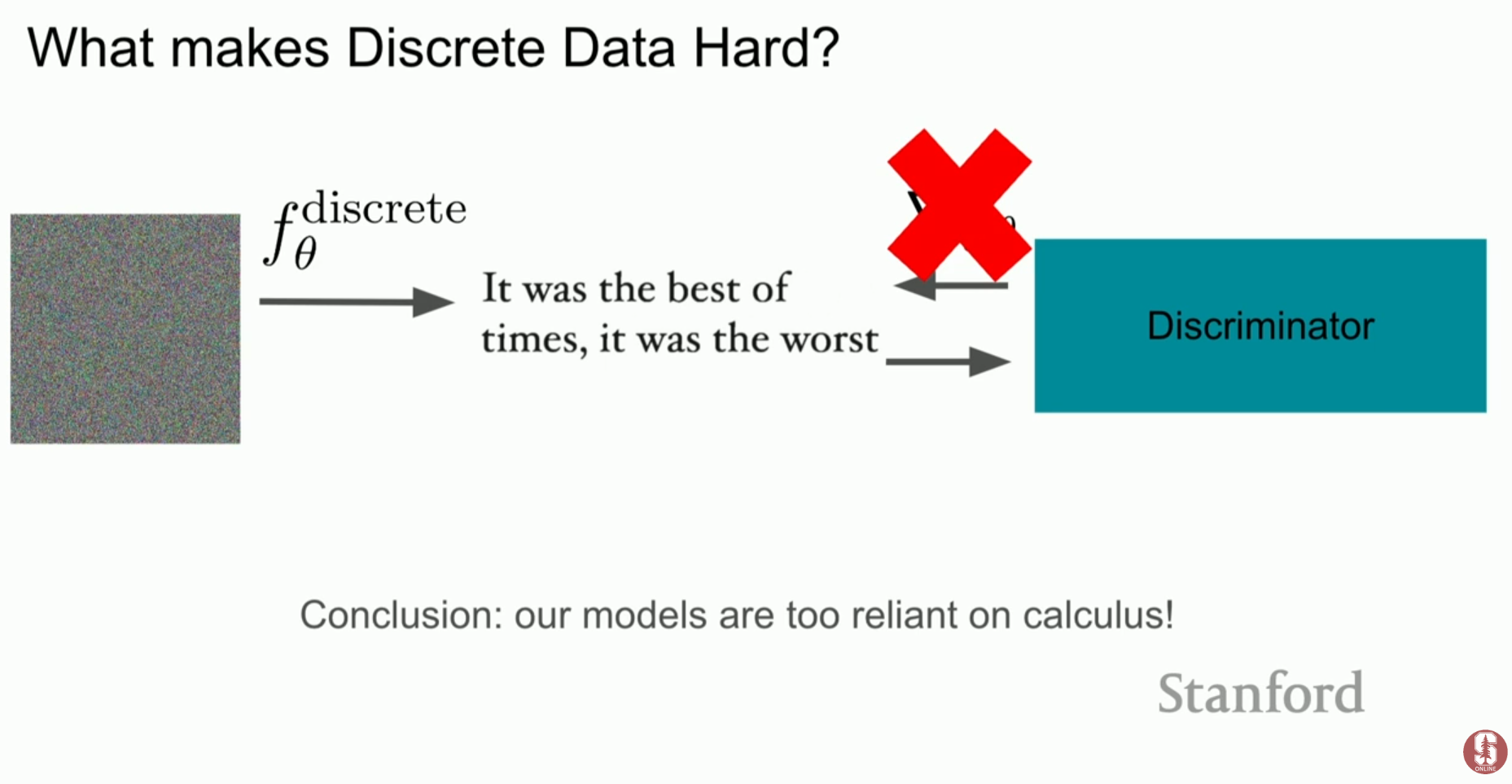

연속 모델을 이산 데이터에 적용할 때의 문제점

기존의 연속 공간 모델을 단순히 이산 데이터에 적용하려 하면 다음과 같은 문제에 직면합니다.

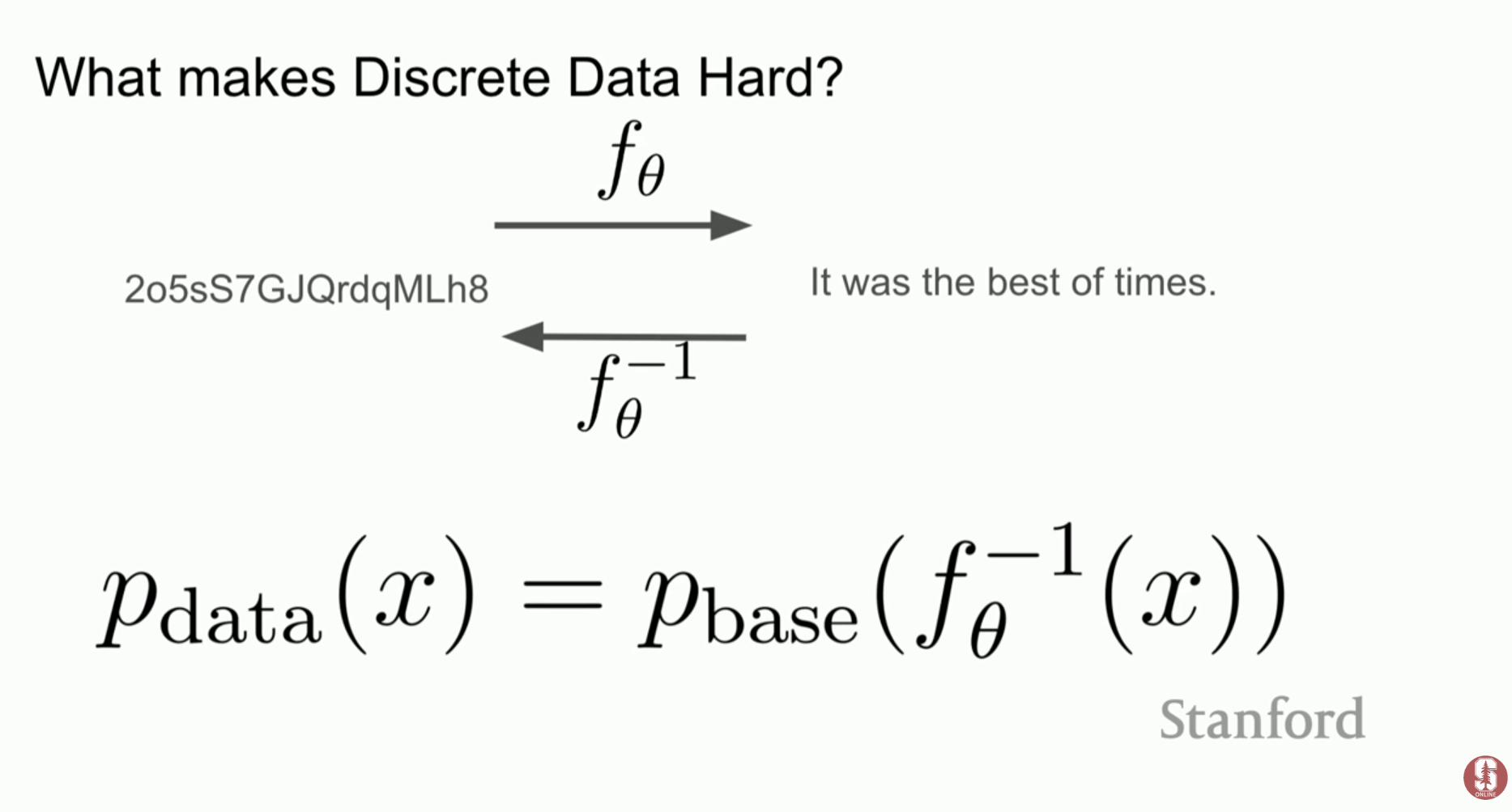

1. Flow Models: 변수 변환(change of variables) 공식이 이산 공간에는 존재하지 않아 적용이 어렵습니다.

2. GANs: 이산적인 출력에 대해서는 미분(calculus)이 불가능하여 판별자(discriminator)의 그래디언트를 역전파할 수 없습니다.

3. 연속 임베딩 후 이산화: 토큰을 연속 공간에 임베딩하여 생성한 후 가장 가까운 토큰으로 반올림하는 방식은 이미지(0-255)에는 효과적일 수 있으나, 텍스트와 같은 고차원 희소 공간(sparse space)에서는 토큰 사이의 빈 공간이 너무 많아 제대로 작동하지 않습니다.

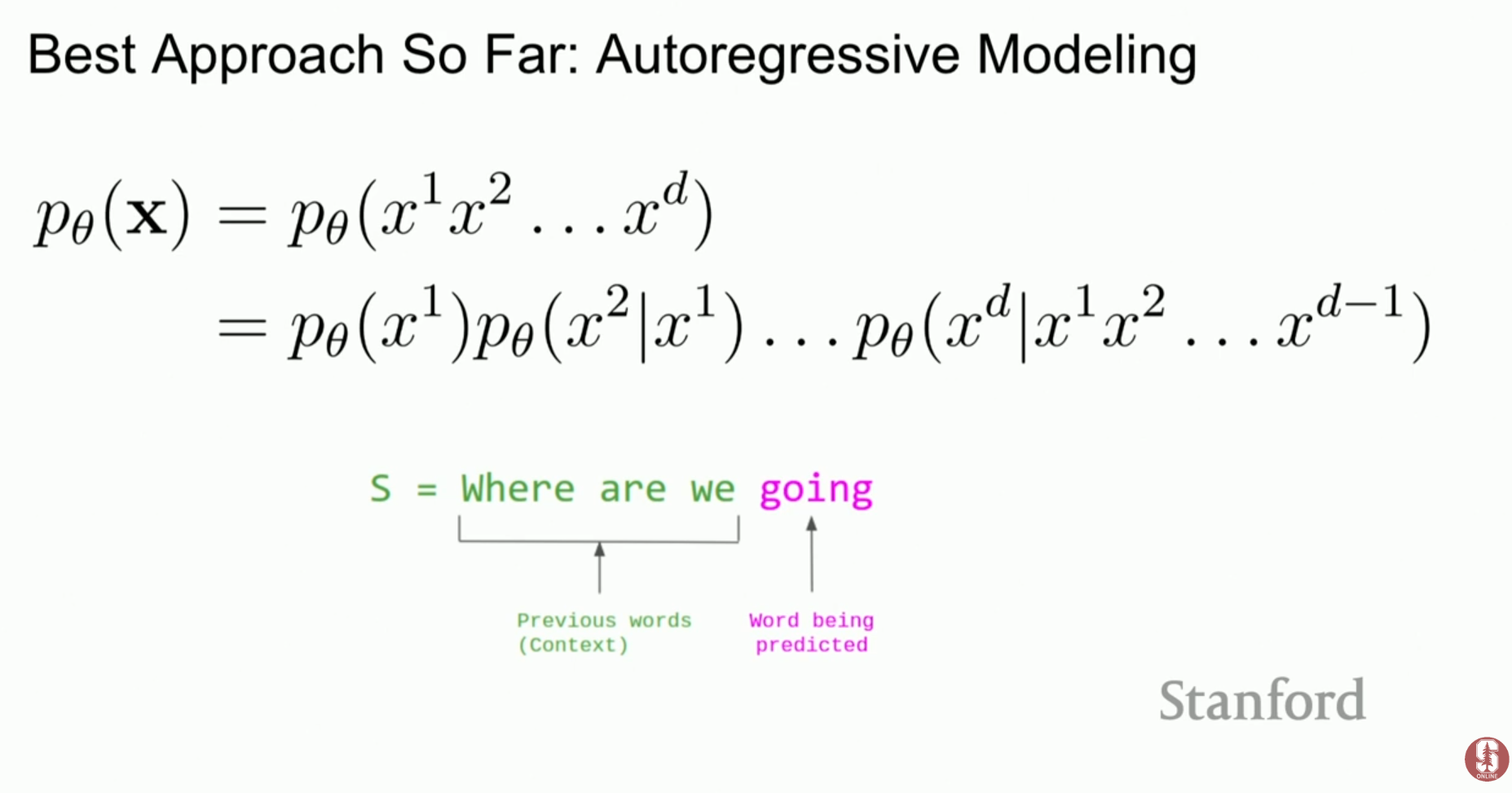

현재의 지배적 패러다임: 자기회귀(Autoregressive) 모델

현재 텍스트 생성의 표준은 트랜스포머(Transformer) 기반의 자기회귀 모델입니다.

- 작동 원리: 시퀀스의 확률을 조건부 확률의 곱 으로 분해하여 모델링합니다.

- 장점: 확장성(Scalability)이 뛰어나며, 충분히 강력한 신경망을 사용하면 어떤 확률 분포도 이론적으로 표현 가능합니다.

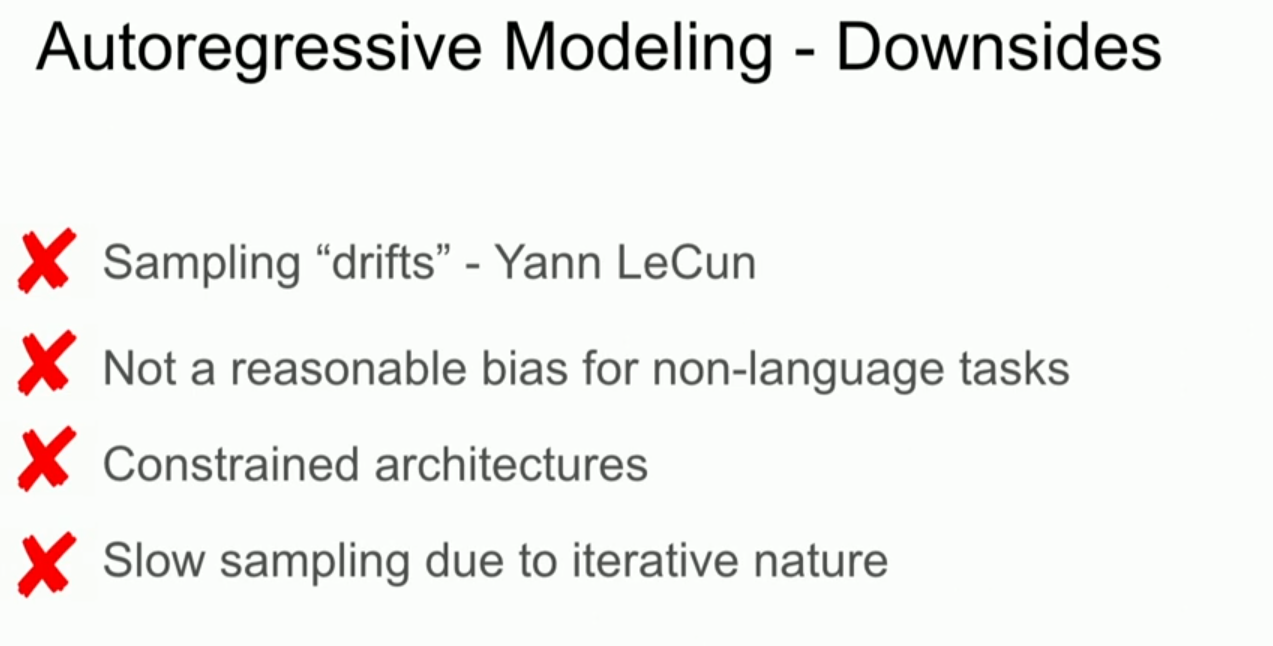

- 단점:

- 샘플링 드리프트: 오류가 누적되어 긴 시퀀스 생성 시 품질이 저하될 수 있습니다.

- 비효율성: 토큰을 하나씩 순차적으로 생성해야 하므로 속도가 느립니다.

- 유연성 부족: DNA 서열이나 이미지 채우기(infilling)와 같이 왼쪽에서 오른쪽으로 생성하는 순서가 부자연스러운 데이터에는 적합하지 않습니다.

3. 이산 공간으로의 스코어 매칭(Score Matching) 확장

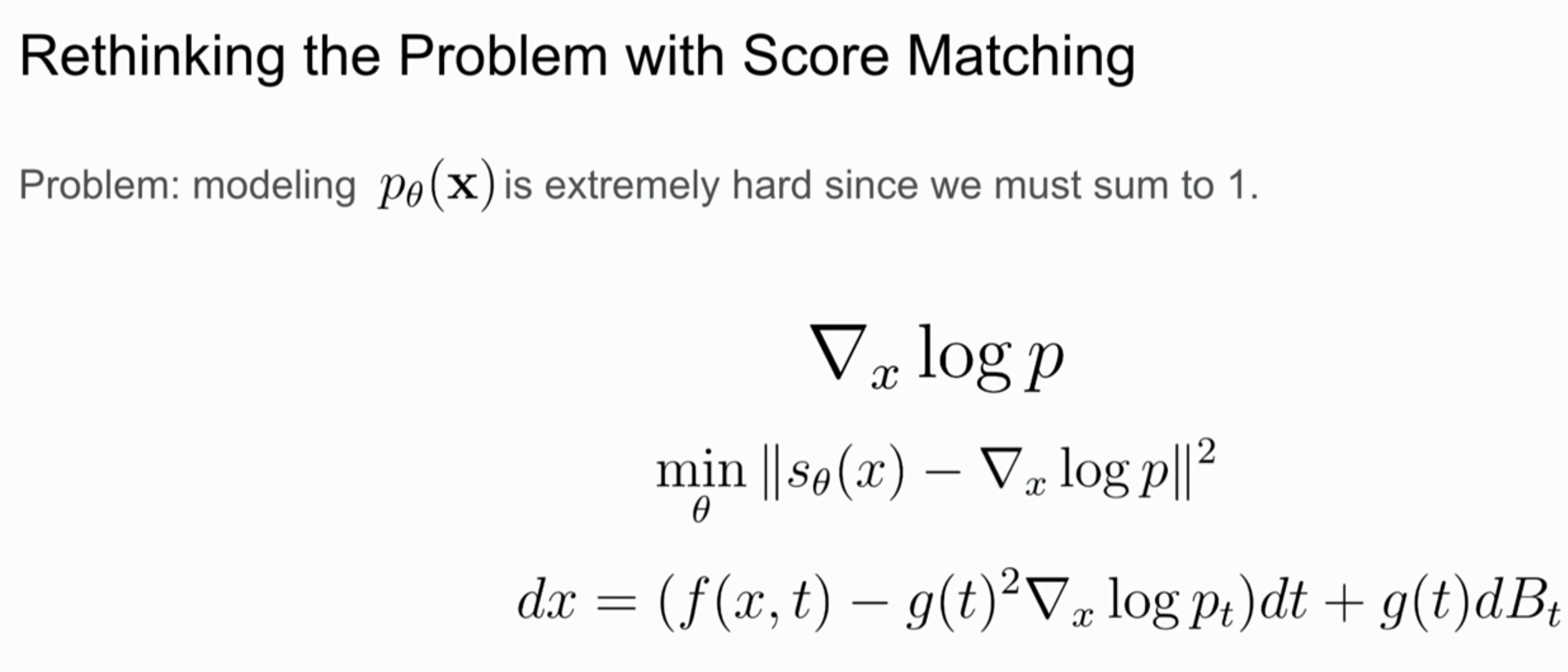

강의의 핵심 질문은 "자기회귀 모델의 대안으로 스코어 매칭을 이산 공간으로 확장할 수 있는가?"입니다. 이를 위해 세 가지 단계(학습, 샘플링, 평가)를 거칩니다.

이산 공간에서의 스코어 함수 정의

연속 공간에서의 스코어 함수 를 이산 공간으로 일반화하기 위해 유한 차분(finite difference) 개념을 사용합니다.

- 이산 그래디언트: (여기서 는 의 이웃).

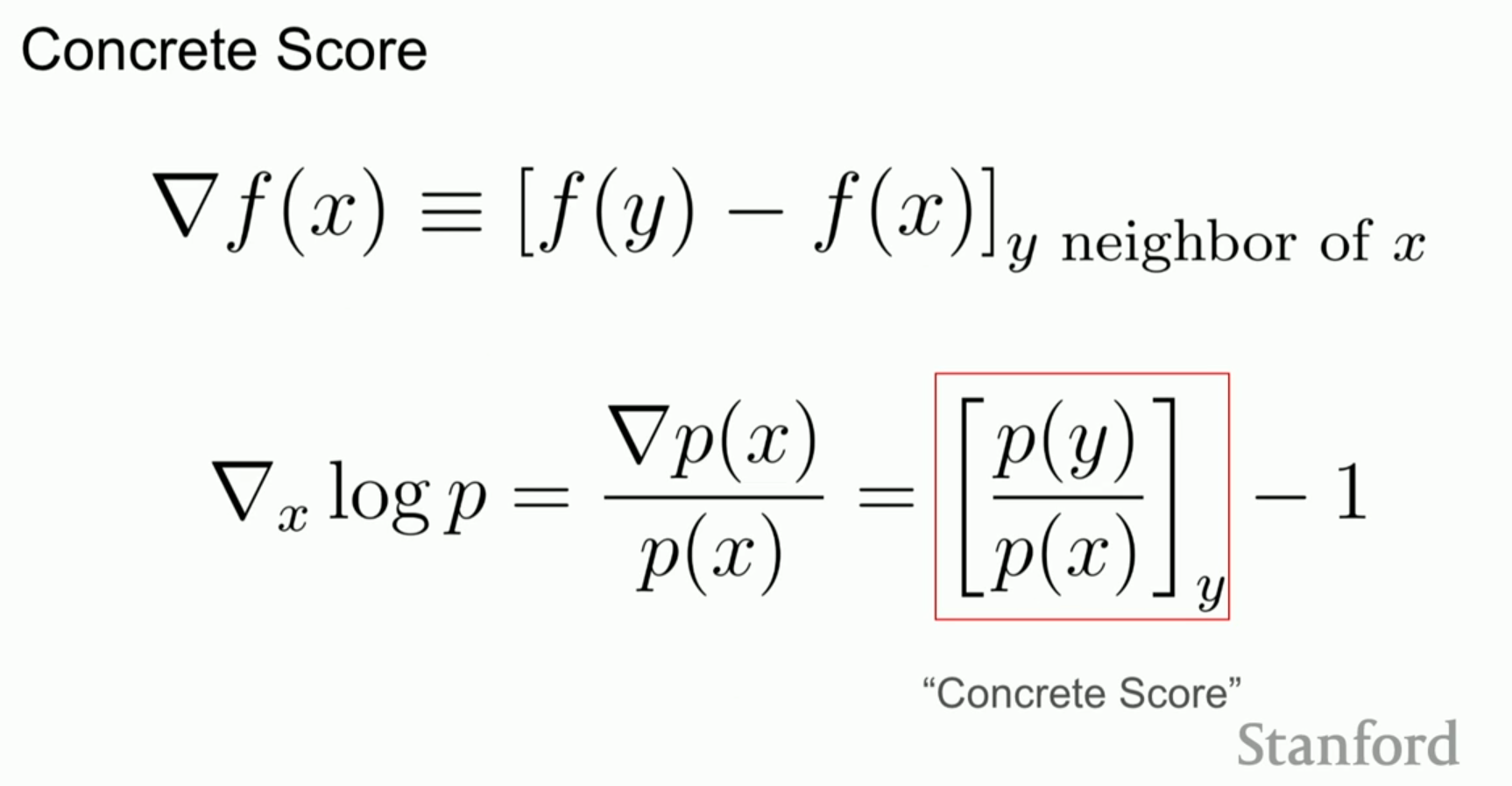

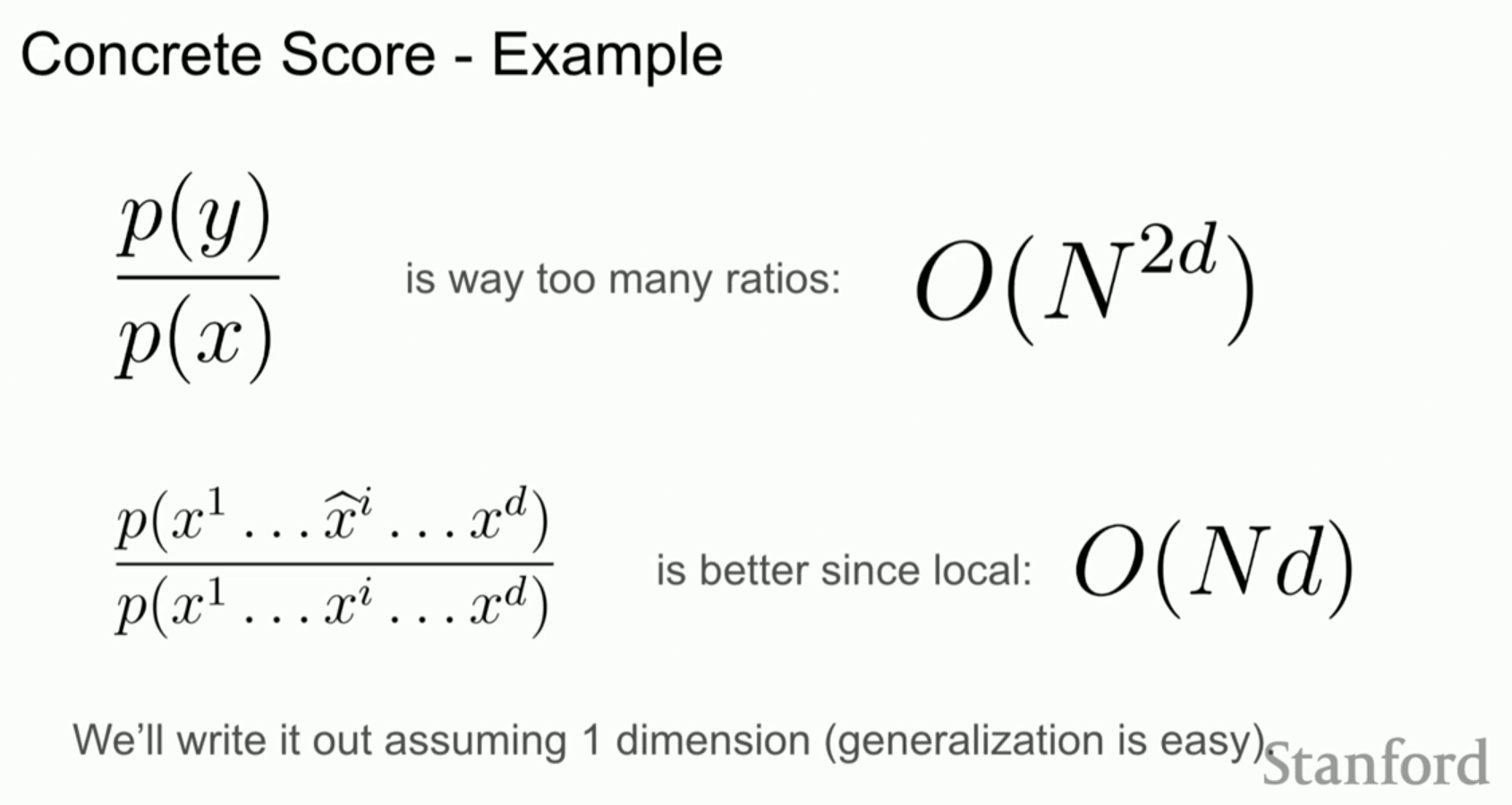

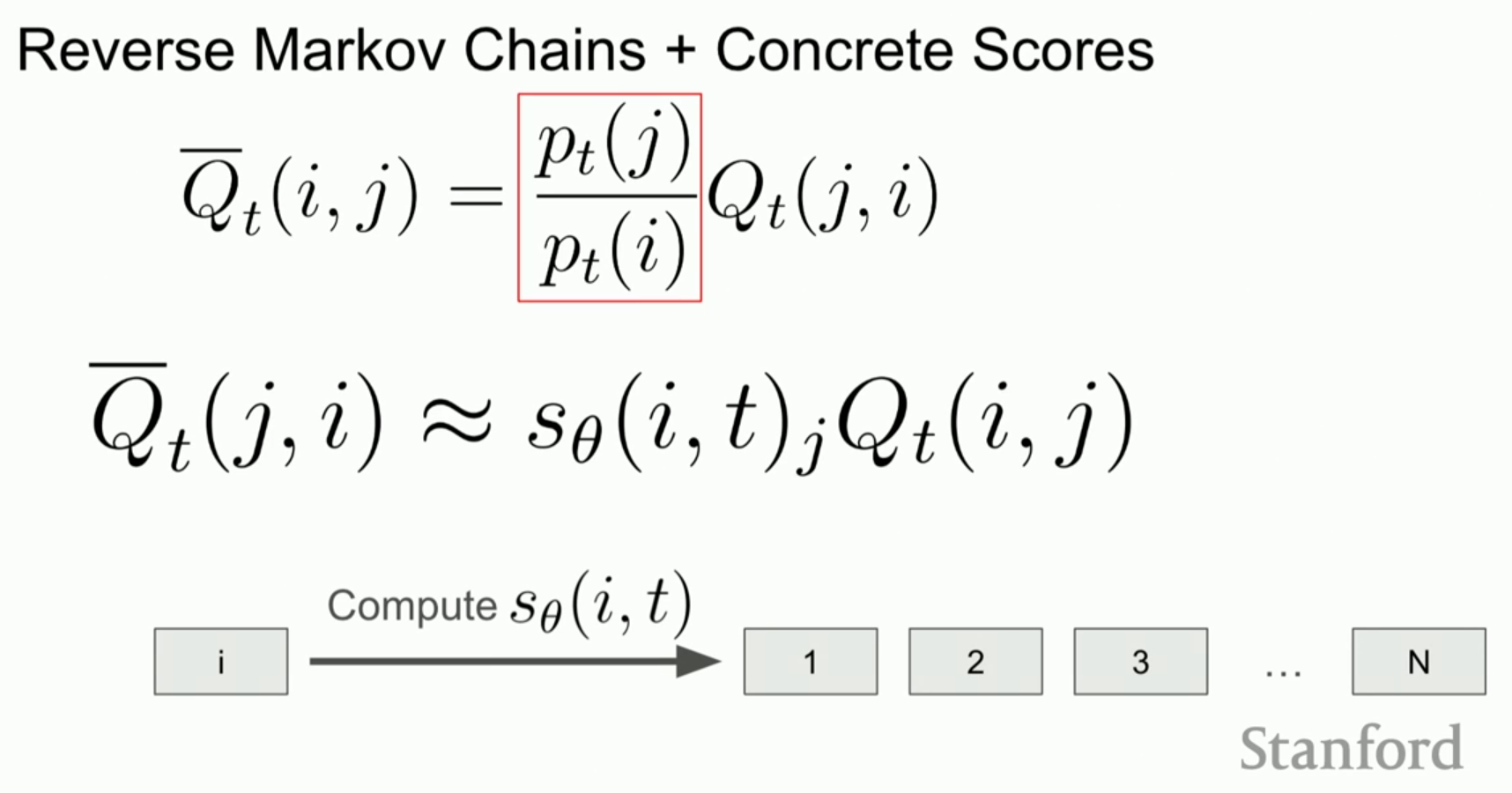

- 콘크리트 스코어(Concrete Score): 이를 확률 로그에 적용하면, 우리가 학습해야 할 대상은 확률의 비율인 가 됩니다.

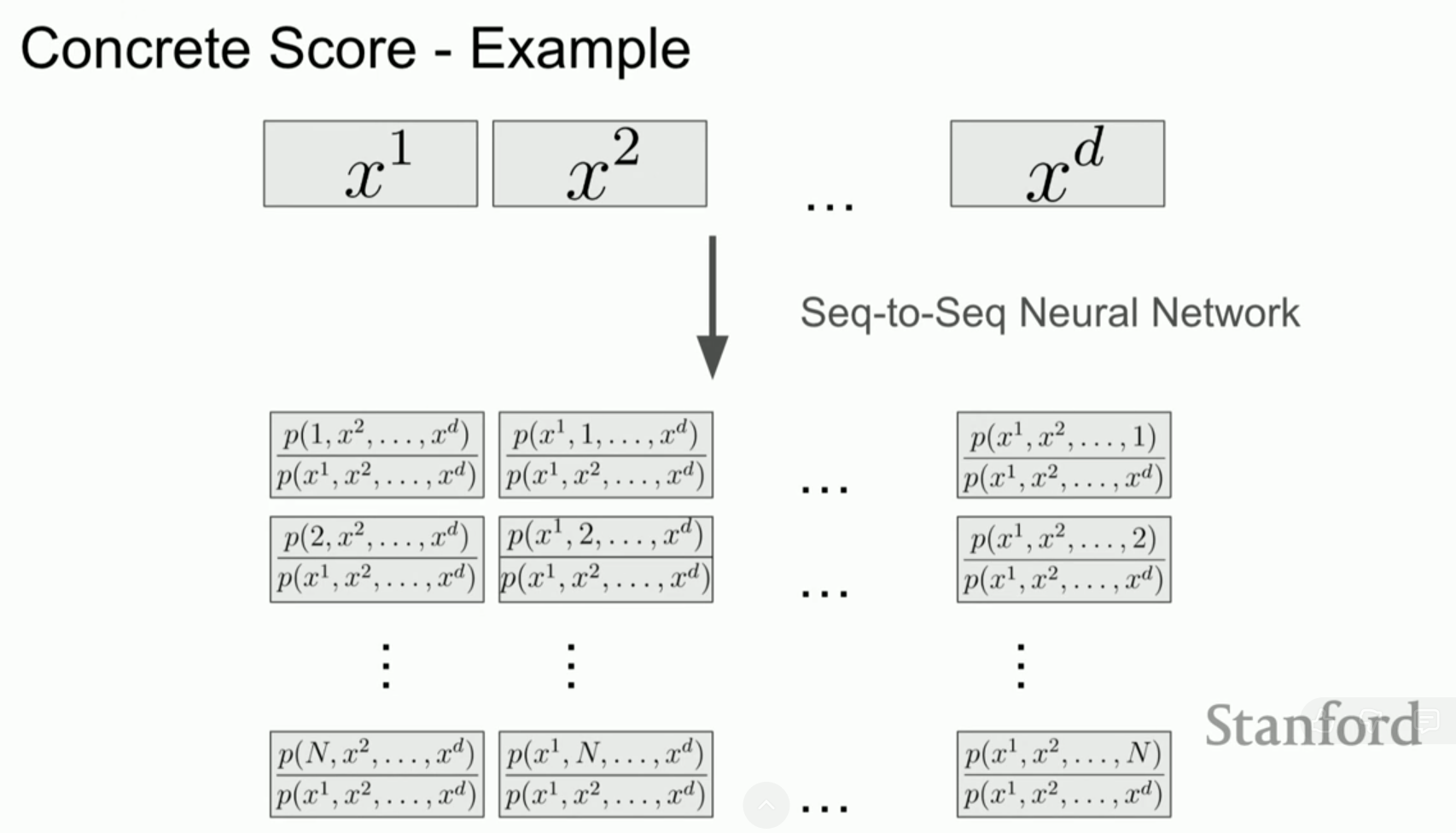

효율적인 모델링 전략

모든 가능한 시퀀스 에 대해 비율을 계산하는 것은 불가능()하므로, 해밍 거리(Hamming distance)가 1인 이웃, 즉 한 위치의 토큰만 다른 시퀀스들과의 비율만을 모델링합니다. 이 경우 복잡도는 로 줄어들어 계산이 가능해집니다.

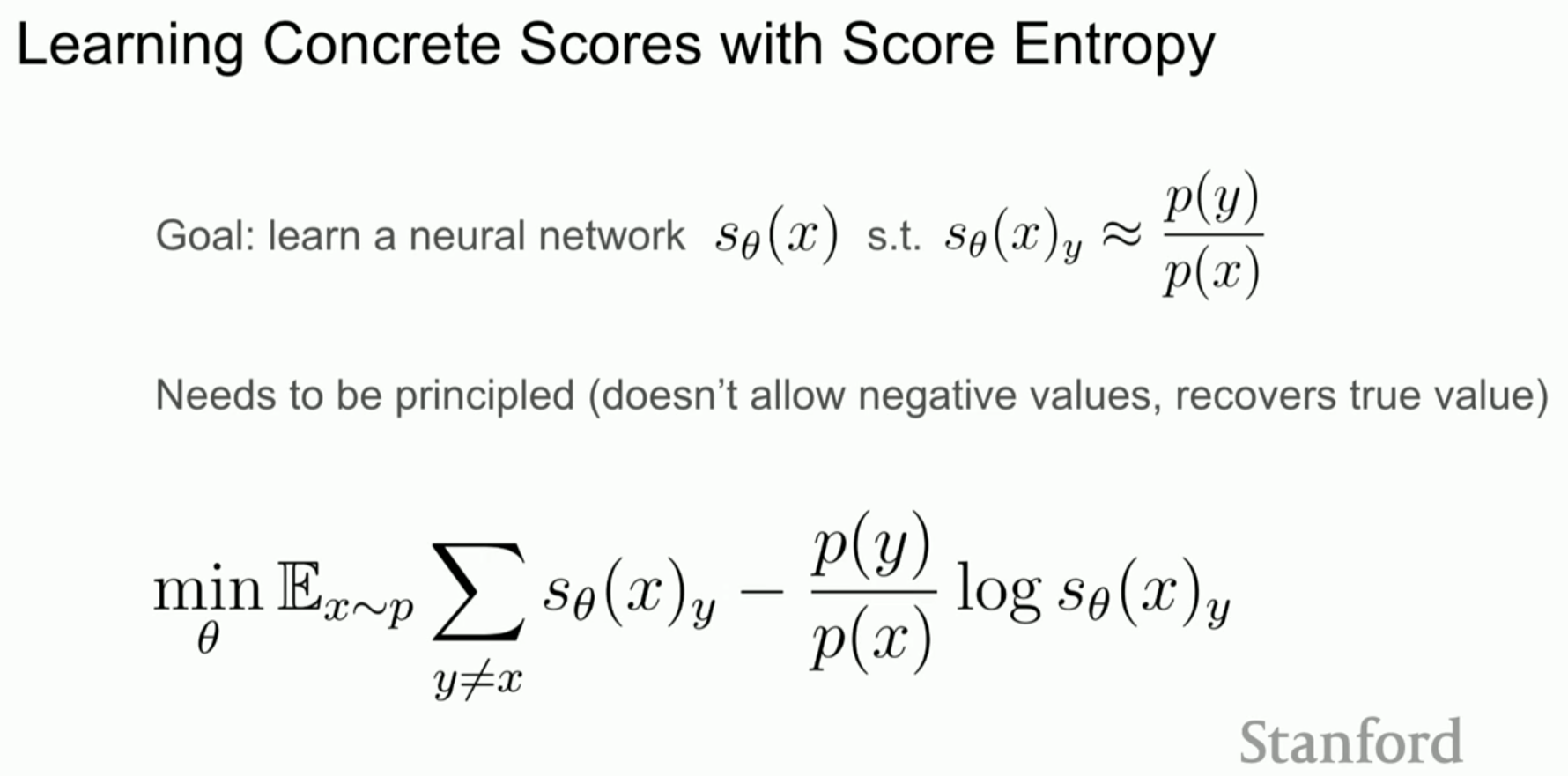

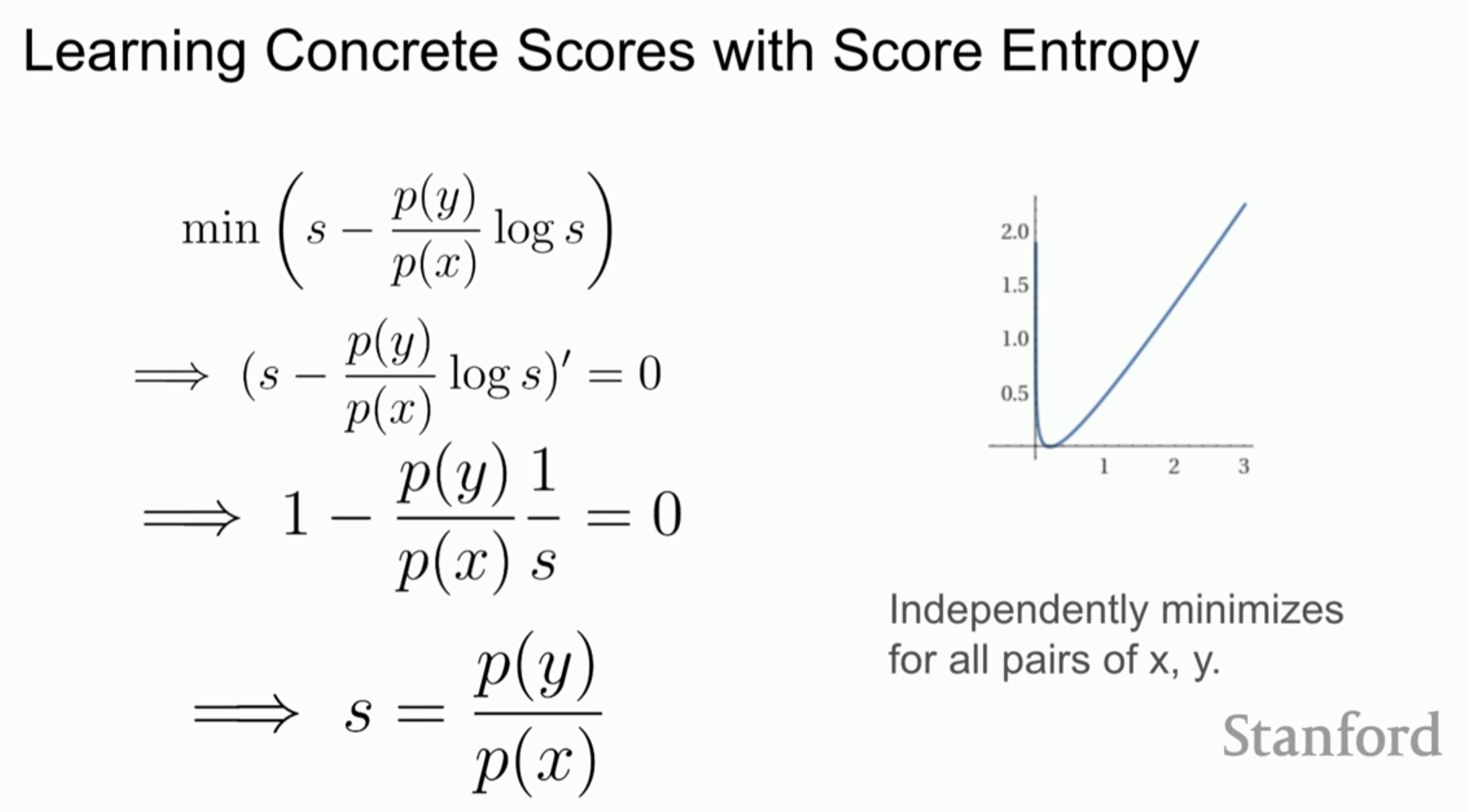

스코어 엔트로피(Score Entropy) 손실 함수

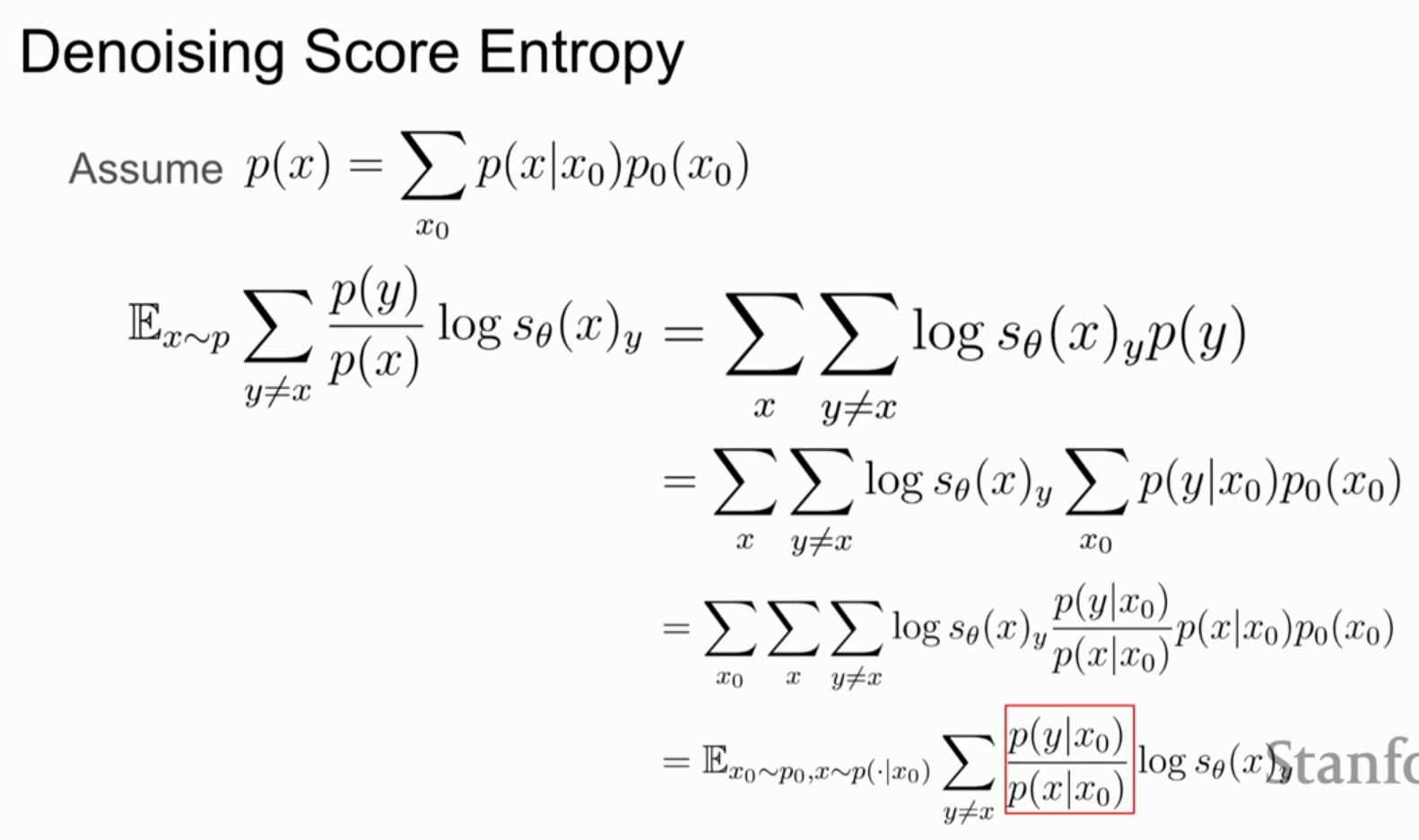

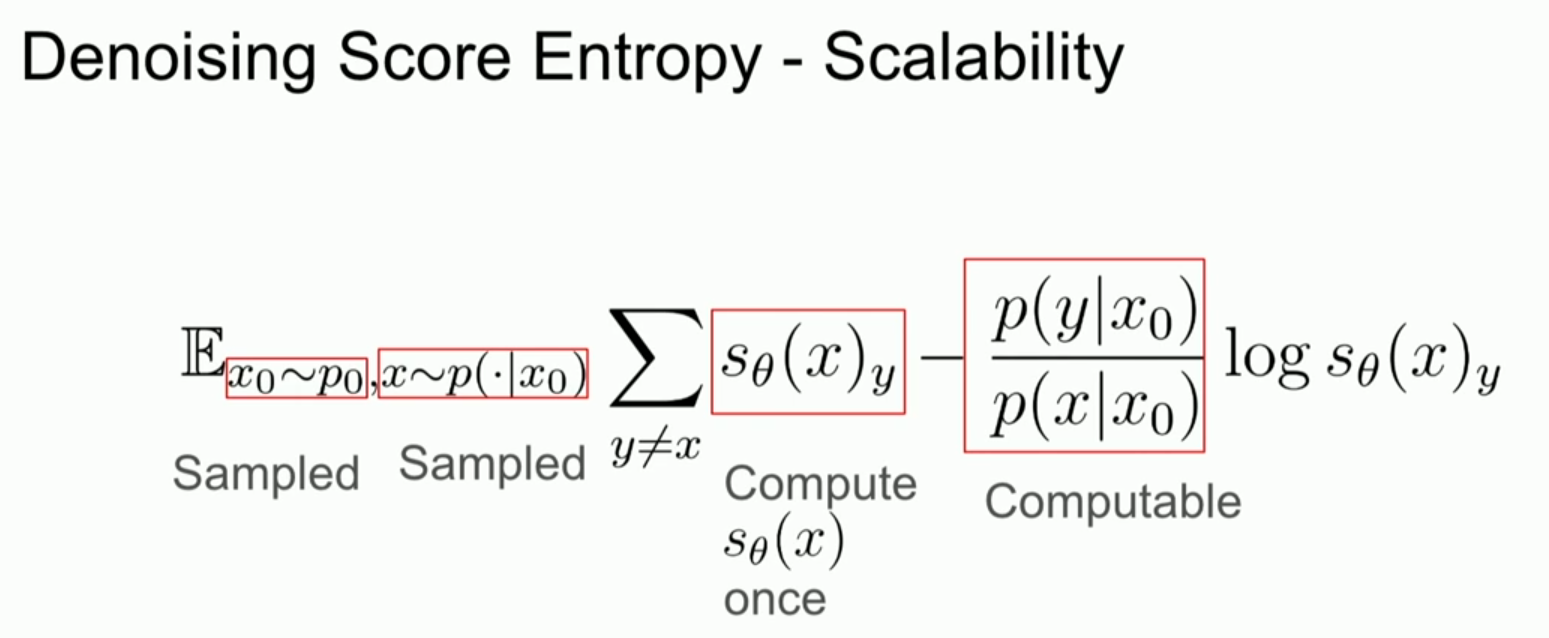

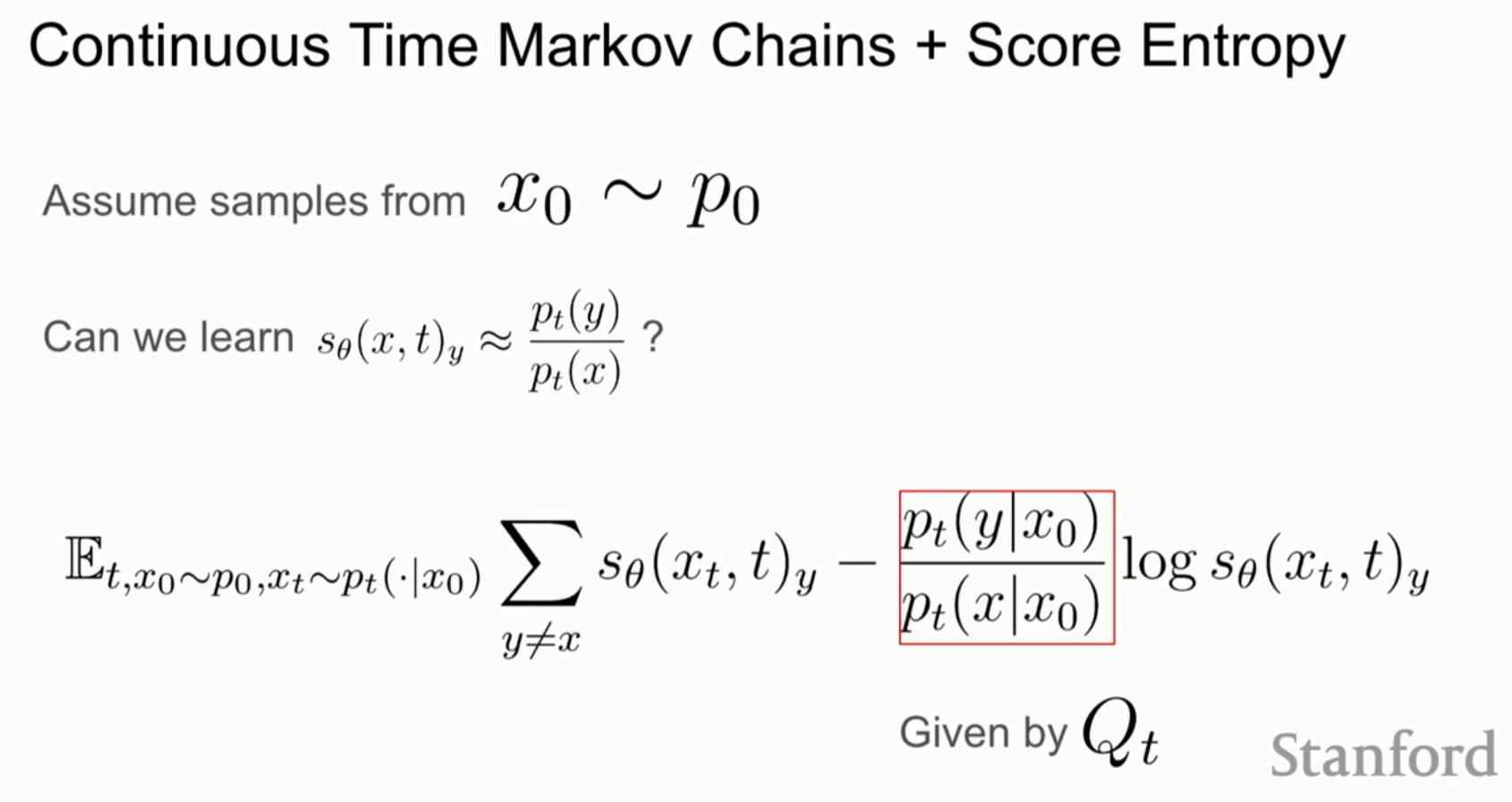

이산 스코어(비율)를 학습하기 위해 스코어 엔트로피라는 새로운 손실 함수를 도입합니다.

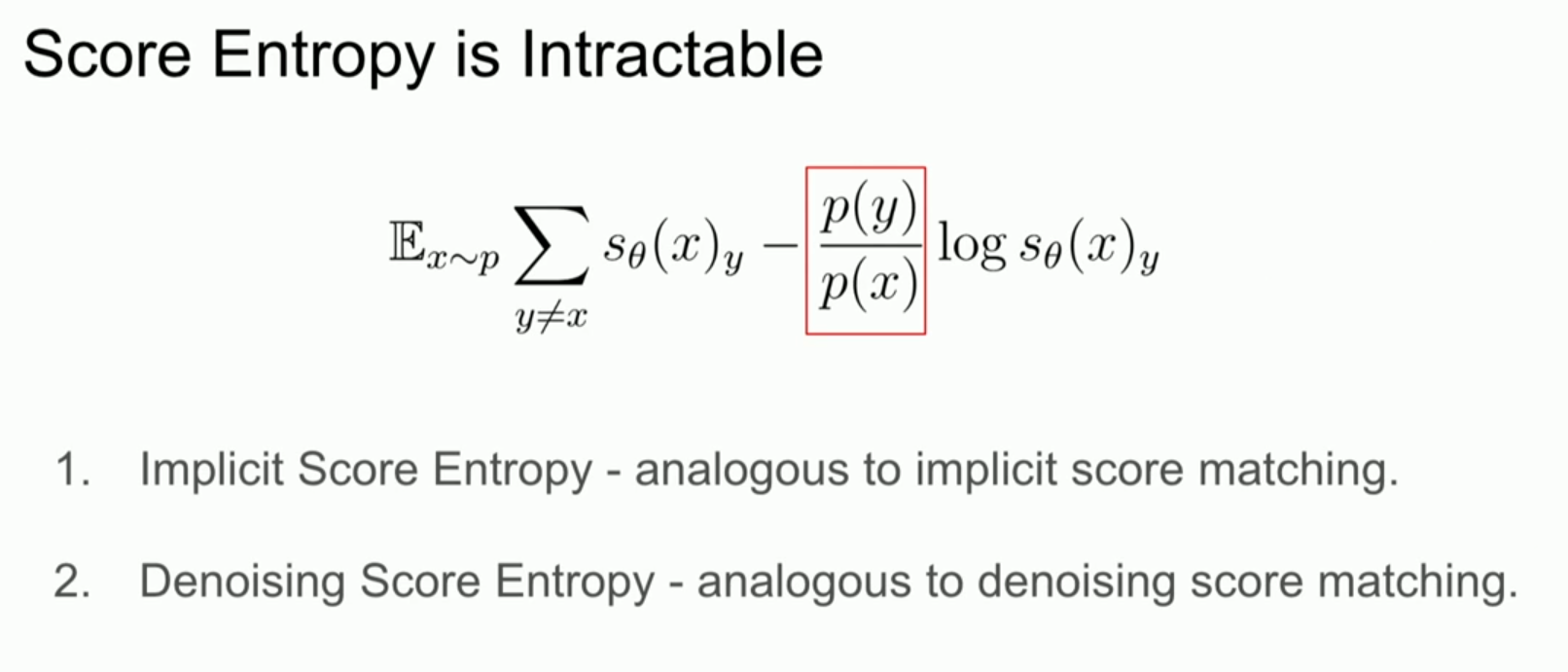

이 손실 함수를 최소화하면 신경망 가 실제 확률 비율 를 학습하게 됨이 증명되었습니다. 하지만 실제 데이터 분포 를 모르기 때문에, 디노이징 스코어 엔트로피(Denoising Score Entropy) 방식을 사용하여 학습합니다.

하지만 실제 데이터 분포 를 모르기 때문에, 디노이징 스코어 엔트로피(Denoising Score Entropy) 방식을 사용하여 학습합니다. 이는 잡음이 섞인 데이터 와 원본 데이터 사이의 전이 확률(transition kernel)을 이용하여 계산 가능한 형태의 손실 함수를 만듭니다.

이는 잡음이 섞인 데이터 와 원본 데이터 사이의 전이 확률(transition kernel)을 이용하여 계산 가능한 형태의 손실 함수를 만듭니다.

4. 이산 확산 모델을 이용한 샘플링

이산 확산 과정 (Forward Process)

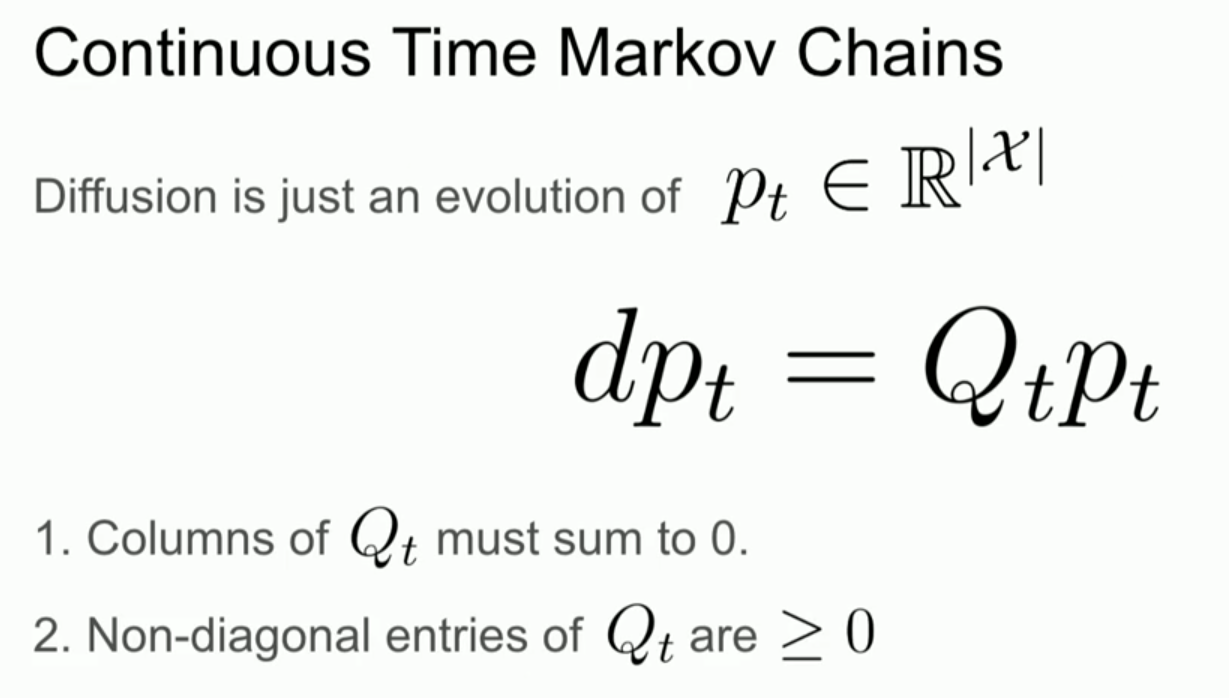

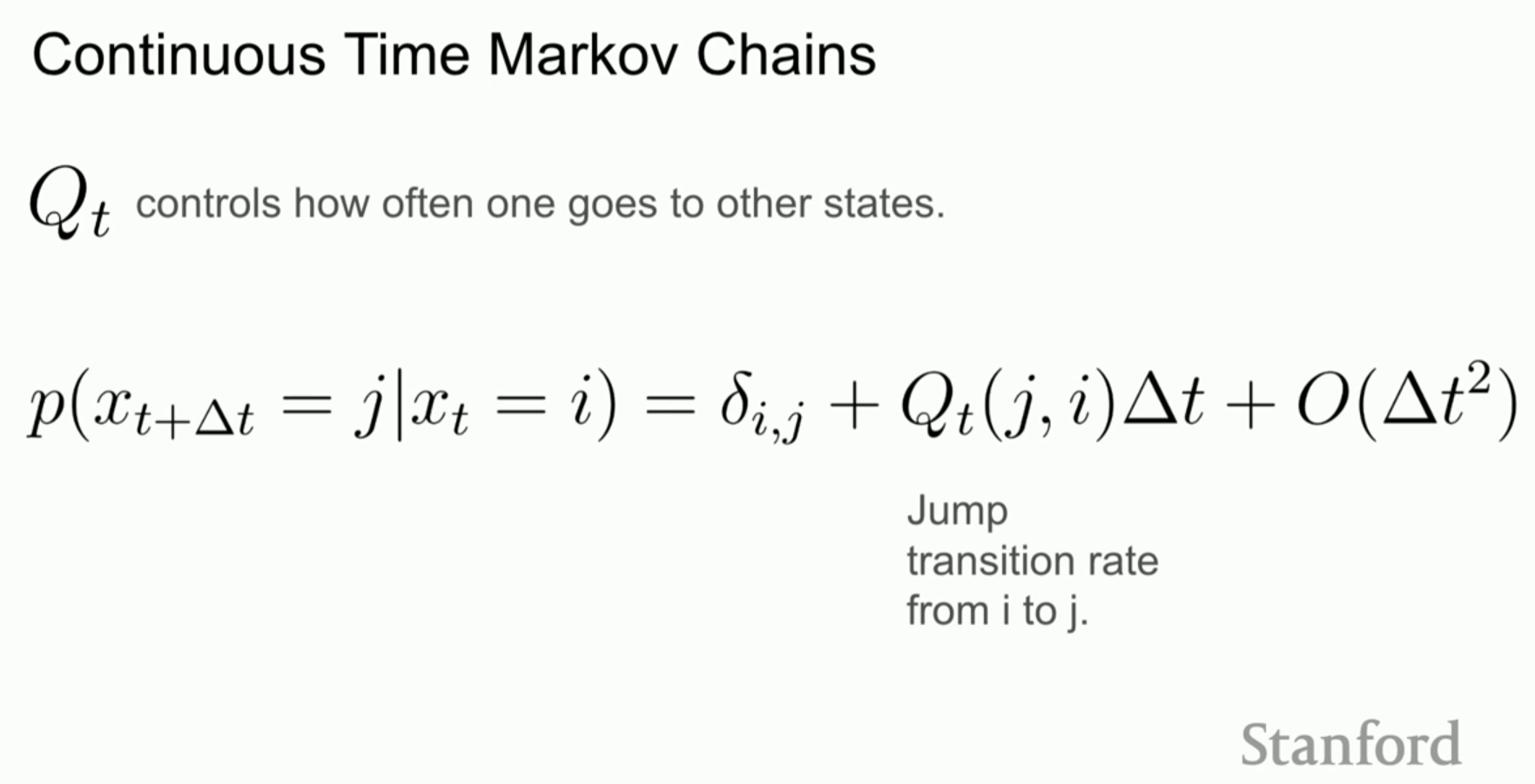

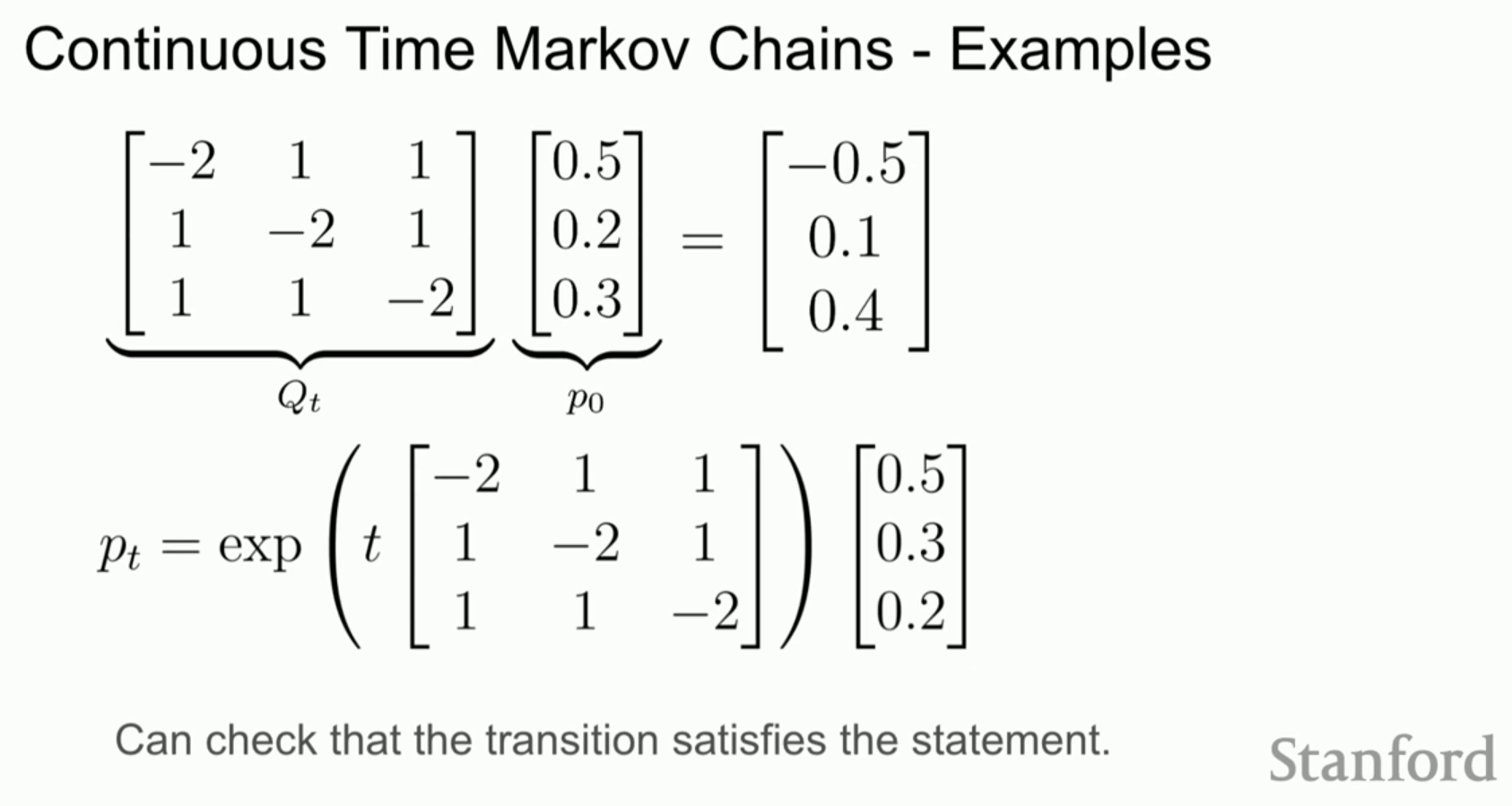

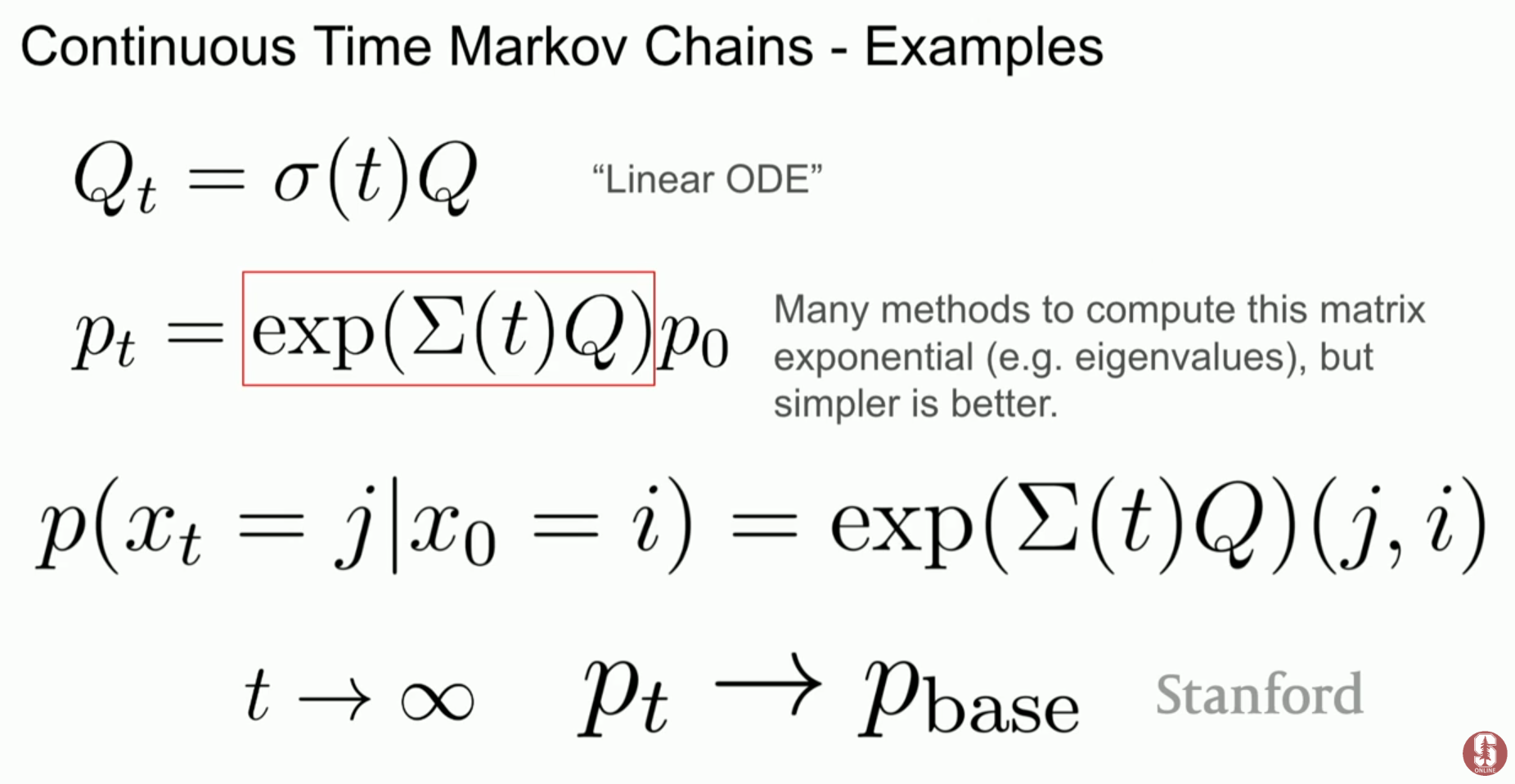

이산 데이터의 확산 과정은 연속 시간 마르코프 체인(Continuous Time Markov Chain)으로 정의됩니다.

- 상태 변화: 확률 분포 의 변화는 전이 속도 행렬(Rate Matrix) 를 이용한 미분 방정식으로 표현됩니다: .

-

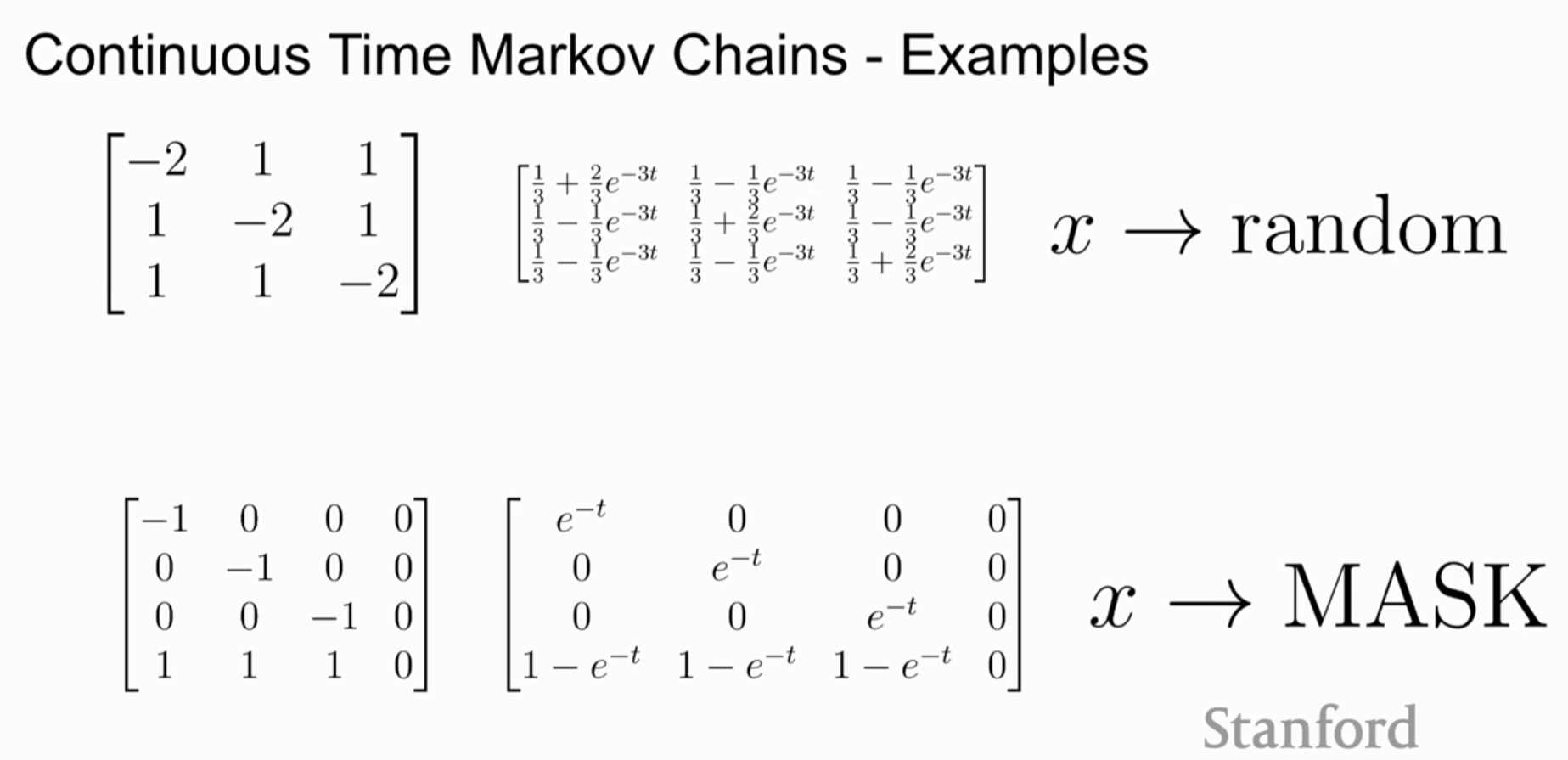

전이 행렬 유형:

- Uniform: 현재 토큰에서 임의의 다른 토큰으로 무작위 전이.

- Masking: 현재 토큰이 'MASK' 토큰(흡수 상태)으로 전이.

-

시간이 무한대로 흐르면(), 분포는 정해진 기저 분포(Base distribution, 예: 균등 분포 또는 모든 마스크)로 수렴합니다.

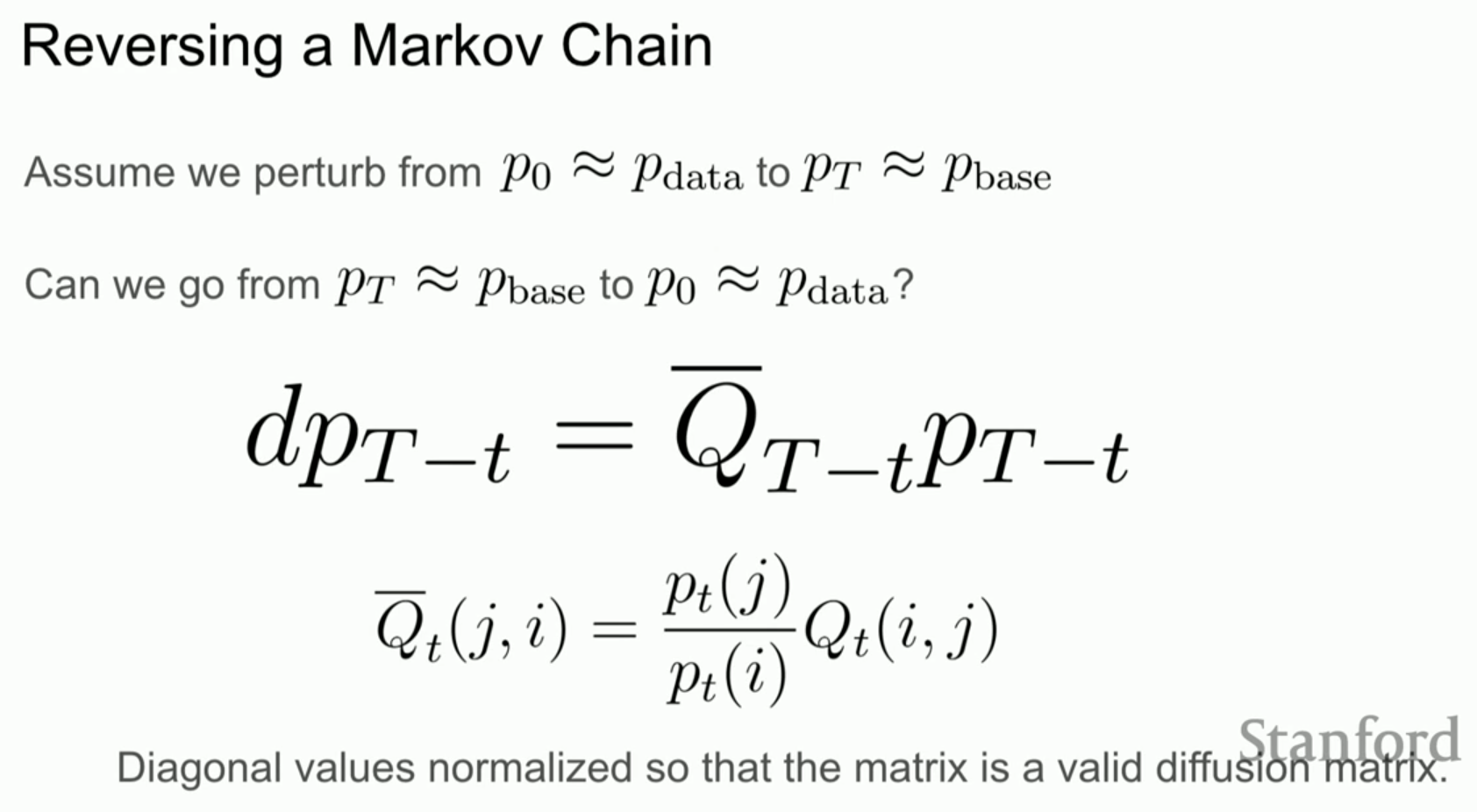

역확산 과정 (Reverse Process) 및 생성

데이터를 생성하기 위해서는 확산 과정을 역으로 수행해야 합니다.

-

역전이 행렬 : 역방향 과정의 전이 행렬은 시점 에서의 확률 밀도 비율 에 의존합니다.

-

생성 방법: 앞서 학습한 신경망(Concrete Score)이 이 확률 비율을 추정하므로, 이를 역전이 행렬 공식에 대입하여 잡음(마스크 등)에서 시작하여 원래 데이터로 복원하는 과정을 수행합니다.

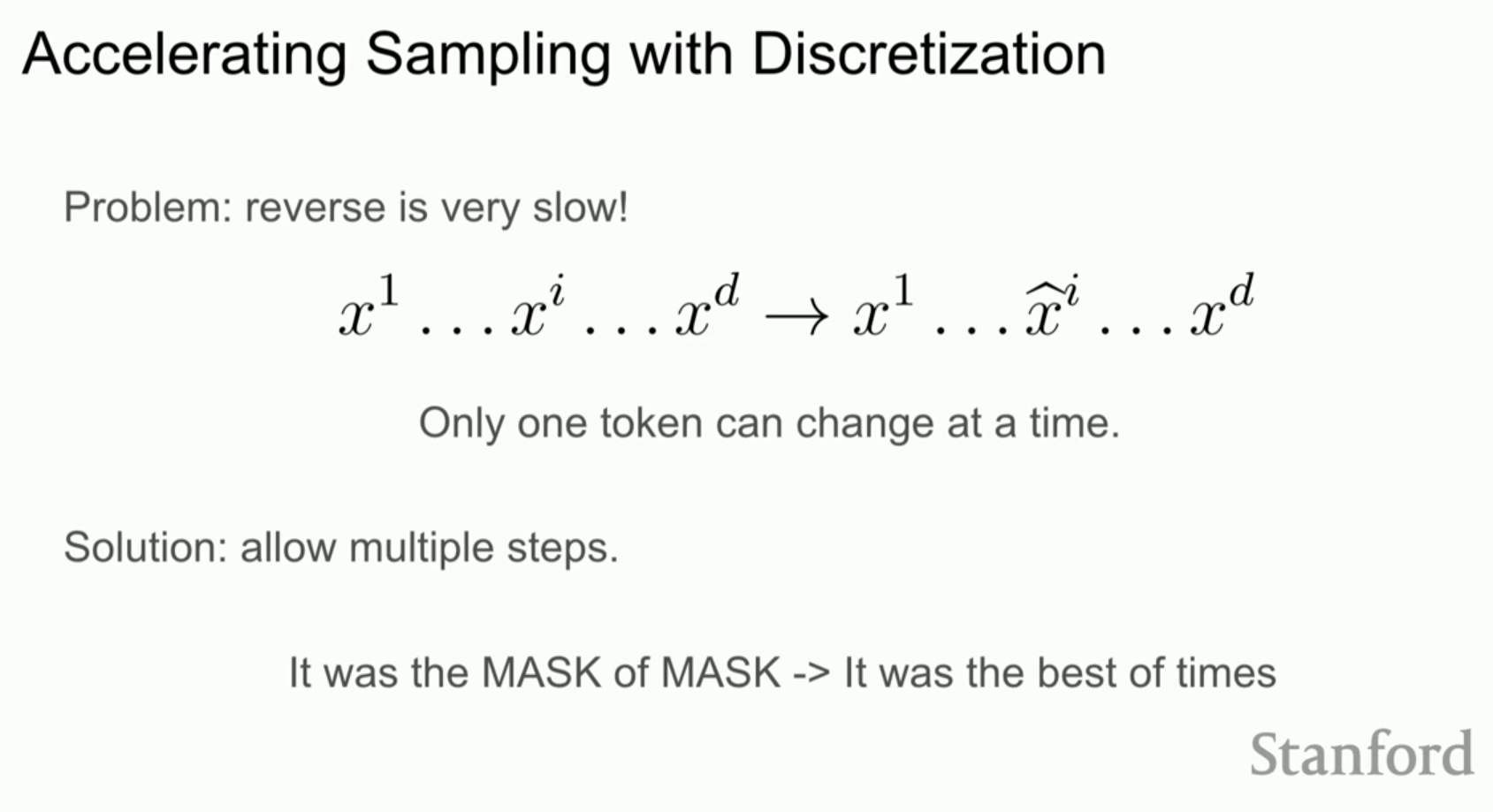

타우-리핑(Tau-leaping)을 통한 가속

토큰을 하나씩 복원하는 것은 여전히 느릴 수 있습니다. 이를 해결하기 위해 한 번의 단계에서 여러 토큰을 동시에 업데이트하는 타우-리핑 기법을 사용하여 샘플링 속도를 획기적으로 높일 수 있습니다.

5. 성능 평가 및 자기회귀 모델과의 비교

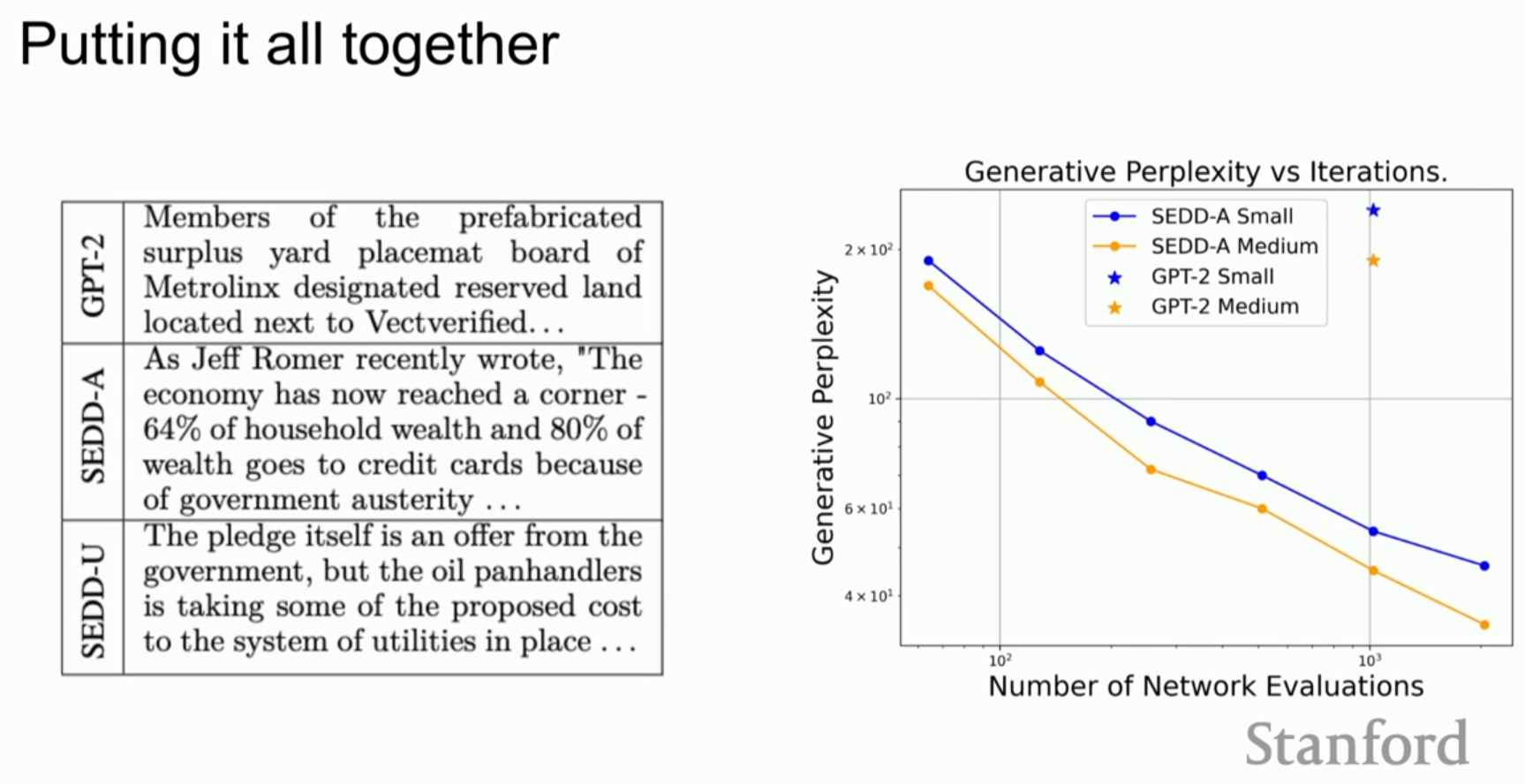

생성 품질 및 속도

- 품질: 제안된 SEDD(Score Entropy Discrete Diffusion) 모델은 GPT-2와 비교했을 때, 유사하거나 더 나은 일관성(coherence)을 가진 텍스트를 생성합니다.

- 속도: 샘플링 스텝 수를 조절하여 품질과 속도를 트레이드오프할 수 있습니다. 적은 스텝(예: 64 steps)으로도 GPT-2 수준의 품질을 훨씬 빠르게 생성할 수 있으며, 스텝 수를 늘리면 품질이 로그-선형적으로 향상됩니다.

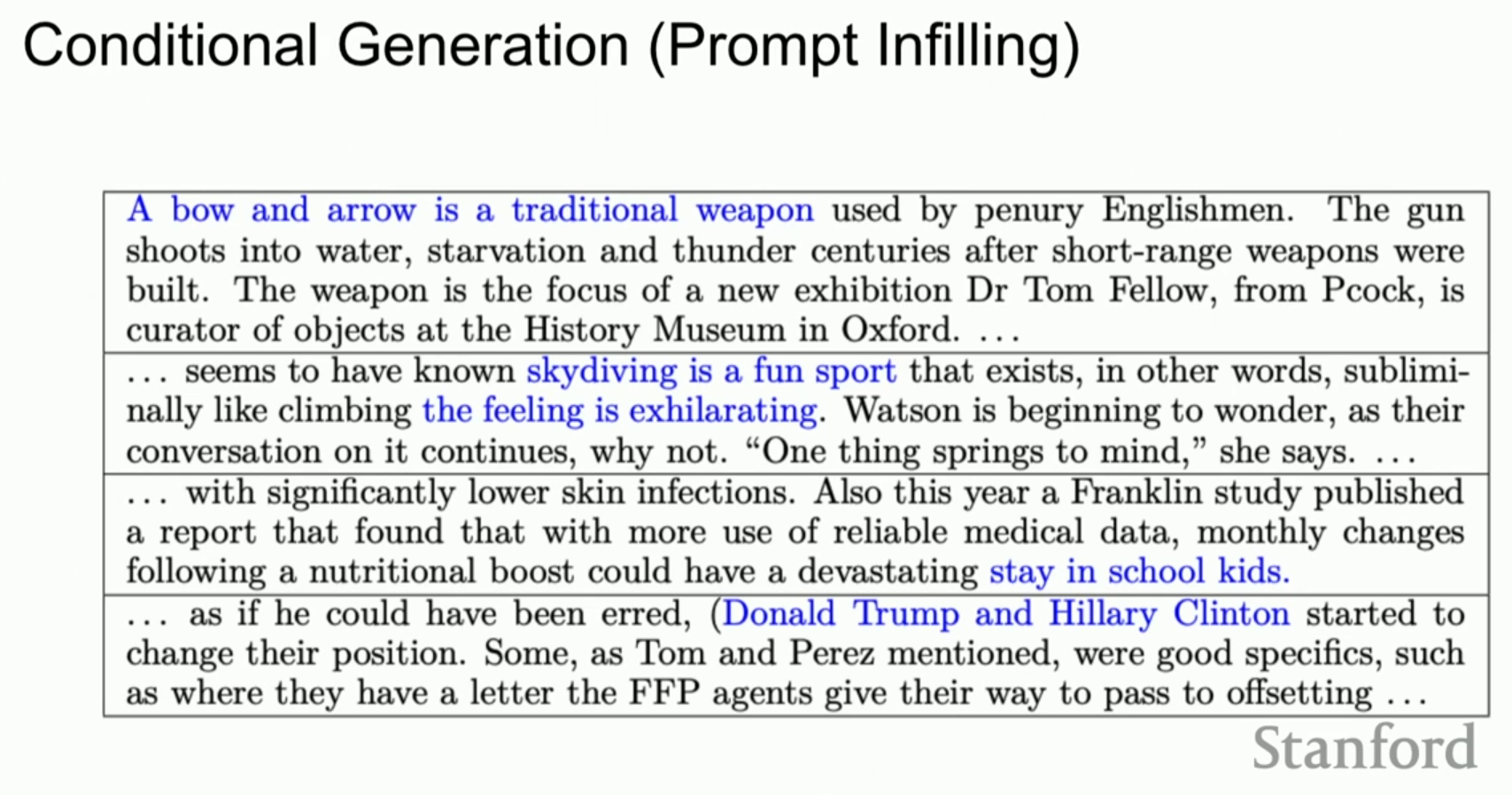

제어 가능한 생성 (Controllability)

이 모델의 강력한 장점은 인필링(Infilling) 능력입니다.

- 자기회귀 모델은 프롬프트의 뒷부분만 생성할 수 있지만, 이산 확산 모델은 텍스트의 앞, 뒤, 혹은 중간에 구멍이 뚫려 있어도 주변 문맥을 고려하여 자연스럽게 채워 넣을 수 있습니다.

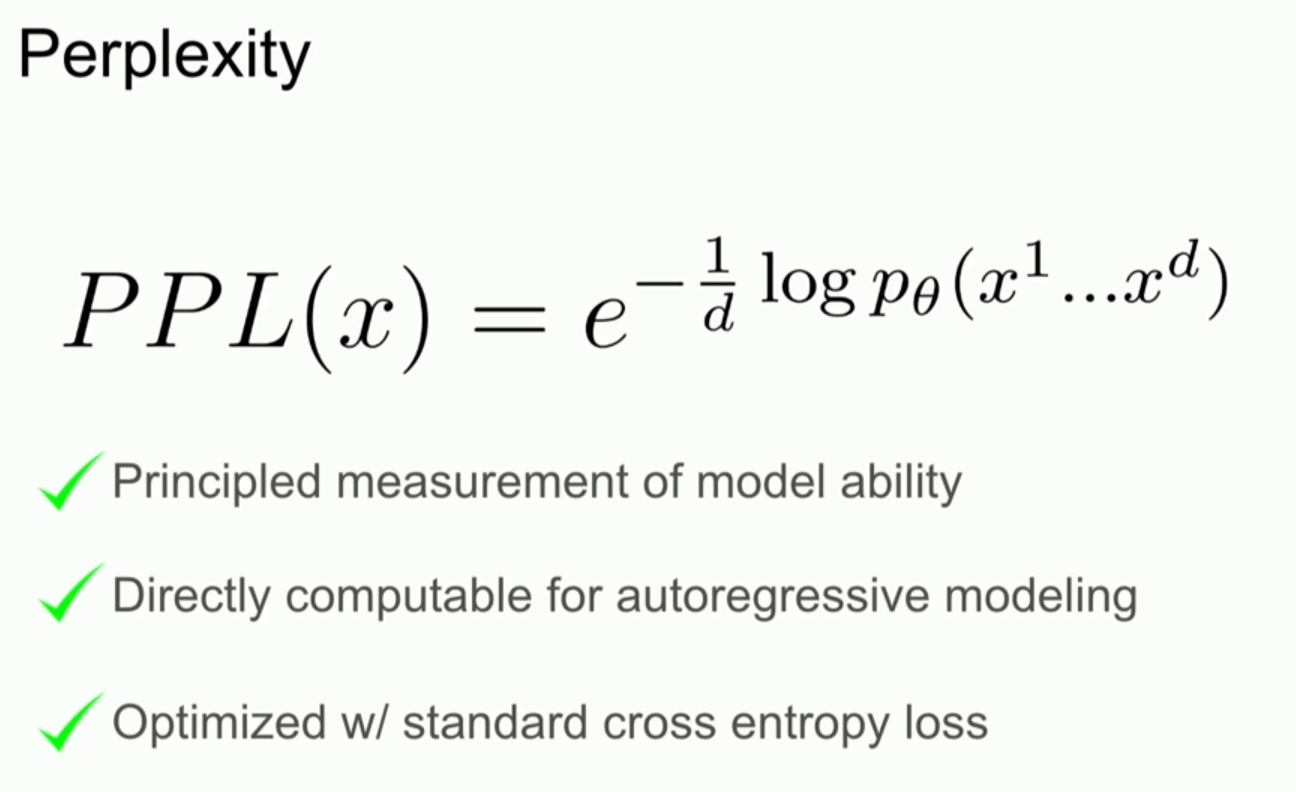

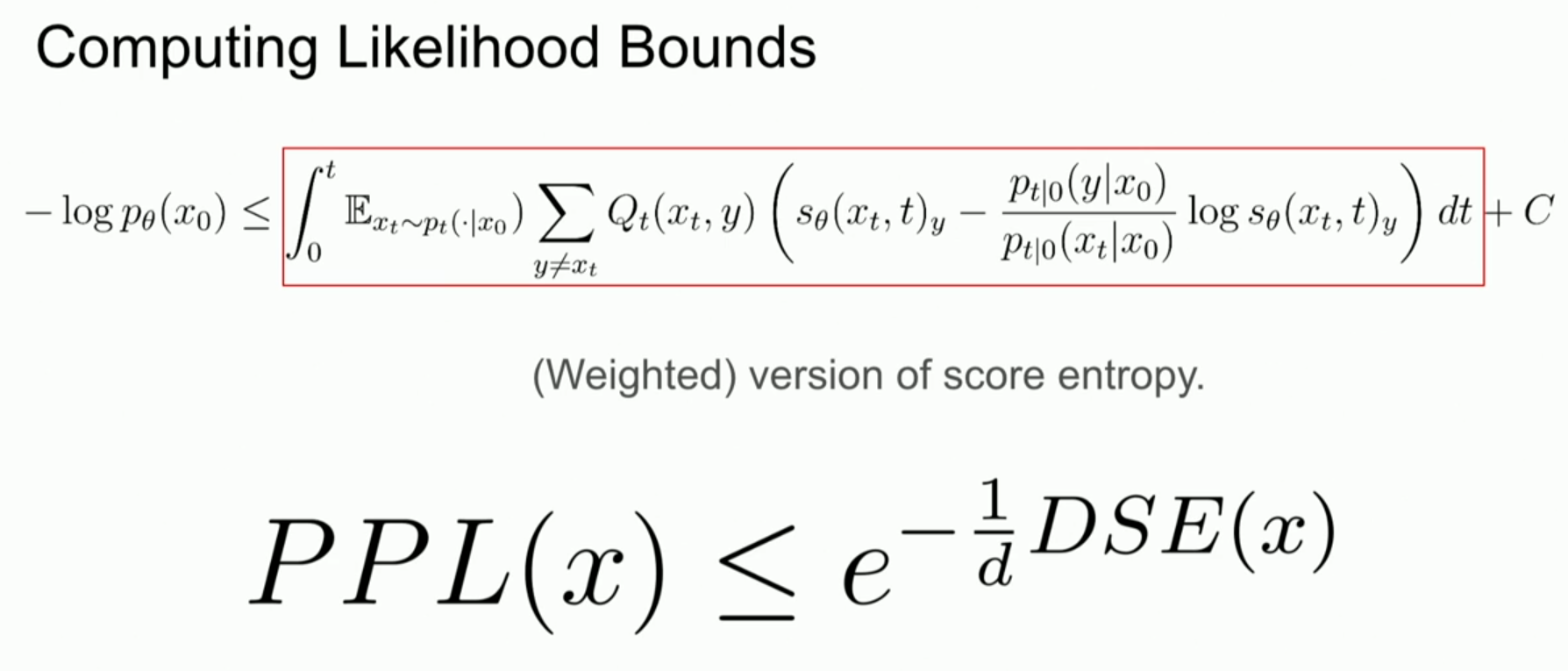

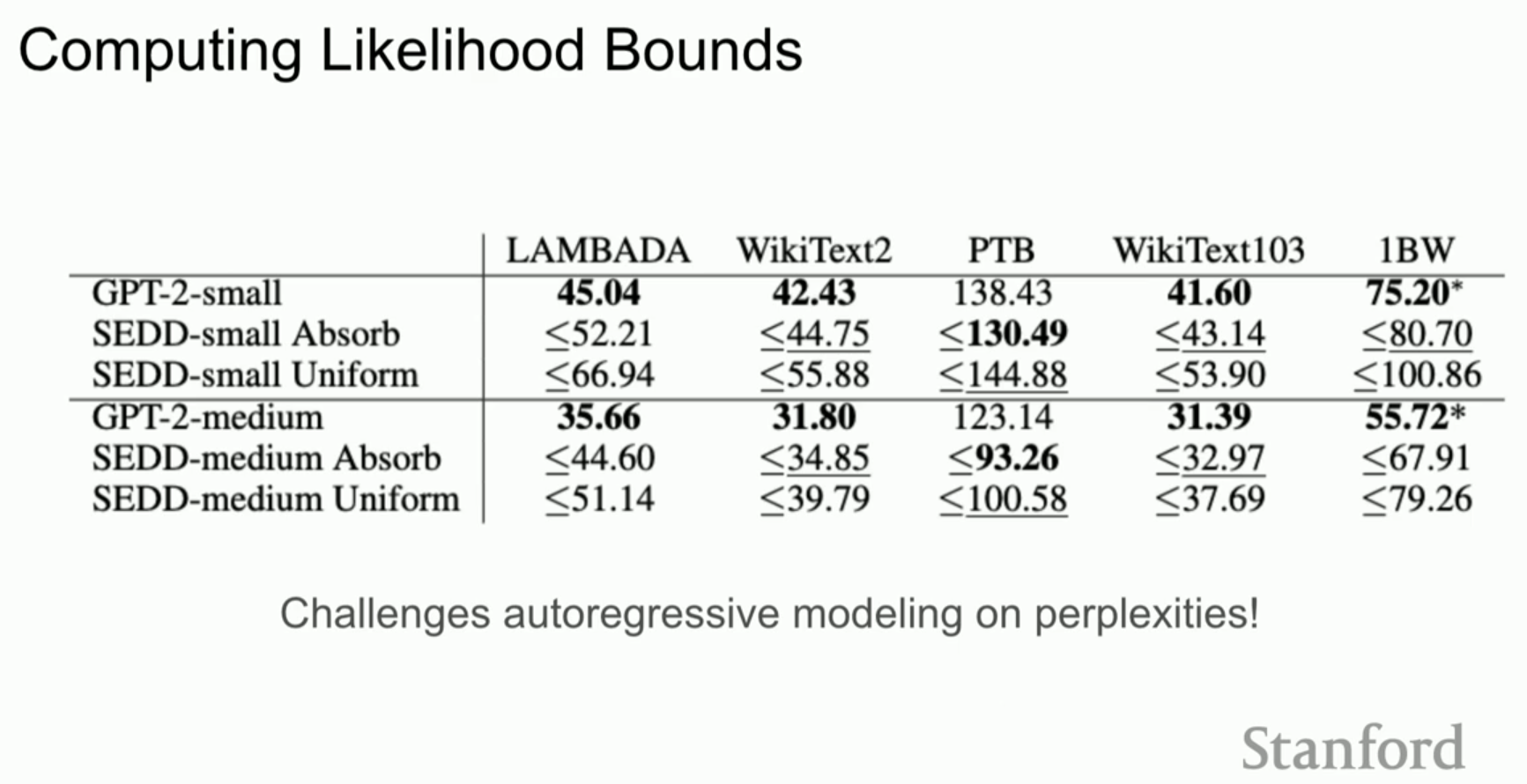

우도(Likelihood) 평가

- 스코어 엔트로피 손실은 음의 로그 우도(Negative Log Likelihood)의 상한(Upper Bound)과 연결됩니다.

- 실험 결과, SEDD 모델은 위키텍스트(WikiText) 등의 벤치마크에서 GPT-2와 대등하거나, PTB 데이터셋에서는 GPT-2를 능가하는 퍼플렉서티(Perplexity) 성능을 보여주었습니다.

6. 질문 및 답변 (Q&A)

Q1: 토큰을 연속 공간에 임베딩한 후 기존의 연속 확산 모델을 사용하는 것과 비교하면 어떤가요?

A1: 연속 임베딩 방식은 일반적으로 성능이 훨씬 떨어집니다. 로그 우도(NLL) 측면에서 약 2.5배 더 나쁜 결과를 보이며, 이산화 과정에서의 오차를 줄이기 위해 매우 많은 스텝(예: 4000 steps)이 필요하여 속도도 매우 느립니다.

Q2: Uniform 전이와 Masking 전이 중 어느 것이 더 성능이 좋습니까?

A2: 일반적으로 Masking 전이가 더 좋은 성능을 보입니다. 무작위로 토큰을 뒤집는(Uniform) 것보다 정보를 지우는(Masking) 방식이 데이터의 구조를 덜 파괴하며, 복원 시 문맥을 파악하기에 더 유리하기 때문입니다.

Q3: 더 복잡한 전이 행렬 를 사용하지 않는 이유는 무엇인가요?

A3: 행렬 의 크기가 어휘 사전의 크기(예: 50,000)만큼 커지면, 행렬 지수 함수(Matrix Exponential)를 계산하는 데 막대한 연산 비용이 듭니다. 따라서 계산 효율성을 위해 구조가 단순한 Uniform이나 Masking 행렬을 사용합니다.

7. 핵심 내용 요약

- 이산 데이터의 특수성: 텍스트와 같은 이산 데이터는 미분이 불가능하고 격자 구조를 가지므로, 기존의 연속형 생성 모델을 직접 적용하기 어렵습니다. 현재는 자기회귀(Autoregressive) 모델이 지배적이나 속도와 유연성에 한계가 있습니다.

- 이산 스코어 매칭: 확률의 비율(Ratio)인 '콘크리트 스코어'를 정의하고, 이를 학습하는 '스코어 엔트로피' 손실 함수를 통해 이산 공간에서의 확산 모델 학습을 가능하게 했습니다. 이는 의 복잡도로 효율적입니다.

- 성능과 가능성: 제안된 이산 확산 모델은 GPT-2 수준의 생성 품질과 더 나은 퍼플렉서티를 달성하였으며, 특히 비순차적 생성(Infilling)이 가능하고 병렬 샘플링을 통해 속도를 높일 수 있다는 점에서 차세대 생성 모델로서의 가능성을 입증했습니다.