1. 배경 및 문제 정의

로봇 조작 분야는 대규모 사전 학습을 거친 비전-언어-행동(Vision-Language-Action, VLA) 모델의 등장으로 큰 발전을 이루었습니다. 그러나 실제 환경에서의 로봇 제어는 **부분적 관찰성(partial observability)**과 **지연된 피드백(delayed feedback)**이라는 고질적인 문제에 직면합니다. 로봇의 현재 결정이 초래하는 결과는 긴 시간이 지난 후에야 명확해지기 때문입니다. 이를 해결하기 위해 강화학습(RL)에서는 가치 함수(Value Function)를 도입하여 작업의 진행도를 평가하고 정책(Policy) 개선을 유도합니다.

최근의 방법론(예: RECAP, )은 이러한 가치 함수를 학습하기 위해 비전-언어 모델(VLM)을 활용했습니다. 그러나 여기에는 치명적인 한계가 존재합니다. VLM은 주로 정적인 이미지-텍스트 쌍으로 학습되어 장면에 '무엇'이 있는지는 잘 파악하지만, 로봇의 상호작용에 따라 환경이 시간에 따라 '어떻게' 변화하는지(Temporal dynamics)를 모델링하는 데에는 취약합니다.

본 논문은 가치 추정(Value Estimation)이 본질적으로 미래가 어떻게 전개될지 예측하는 문제라는 통찰에서 출발합니다. 정적인 데이터로 학습된 판별(Discriminative) 모델 대신, 장면의 시공간적 진화를 캡처하도록 훈련된 비디오 생성(Video Generative) 모델을 활용하여 로봇 강화학습을 위한 보다 신뢰할 수 있는 가치 추정 모델을 구축하는 것을 핵심 문제로 정의합니다.

2. 제안 방법 (Method)

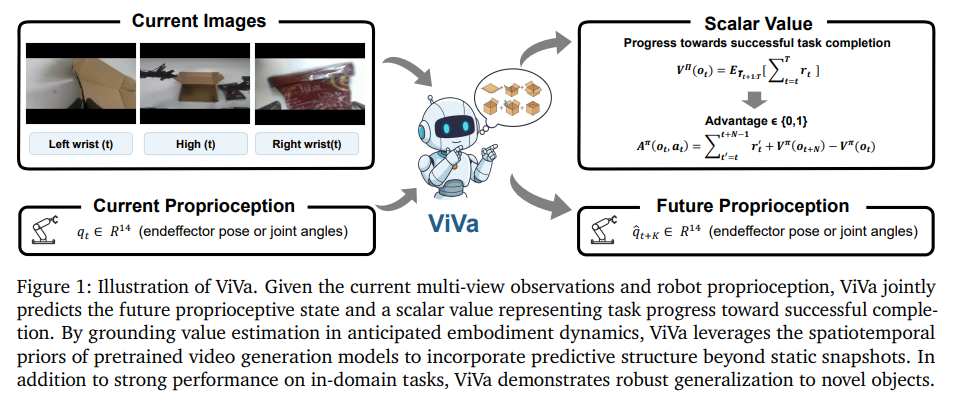

본 연구는 사전 학습된 비디오 생성 모델(Wan2.2 기반 확산 트랜스포머)을 가치 함수로 용도 변경한 비디오 생성형 가치 모델인 **ViVa(Video-Generative Value Model)**를 제안합니다. 이 방법의 핵심 아이디어는 현재의 시각적 관측치와 로봇의 고유 수용성(proprioception) 정보를 입력받아, 특정 시점 이후의 '미래 고유 수용성 상태'와 '현재 상태의 스칼라 가치(Scalar Value)'를 동시에 예측하는 것입니다.

전체 마르코프 결정 과정(MDP)에서 관측치 가 주어졌을 때, 정책 에 대한 가치 함수는 다음과 같이 정의됩니다.

이때 성공과 실패를 명확히 구분하기 위해 수익(Return) 를 정밀하게 설계했습니다. 성공한 에피소드의 수익은 범위로, 실패한 에피소드는 단말 페널티(Terminal penalty)를 부여하여 범위로 매핑함으로써 성공과 실패 간에 항상 1.0의 여백(Margin)을 보장합니다.

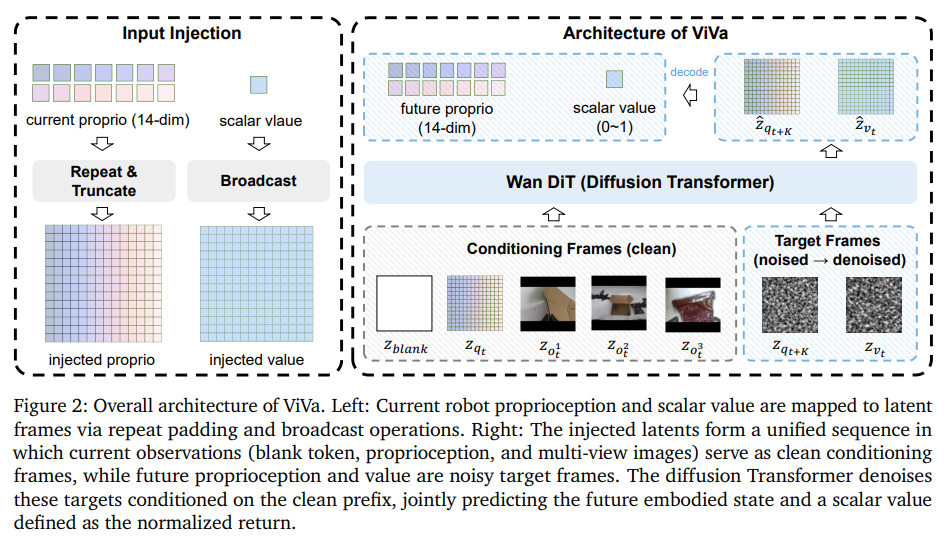

입력 데이터의 표현 및 전처리 방식 (Latent Injection)

ViVa는 비디오 모델의 기본 아키텍처를 수정하지 않고 차원이 다른 이종 데이터를 처리하기 위해, 모든 입력값을 2D 영상 형태의 잠재 프레임(Latent frame)으로 변환하는 특수한 주입 방식을 사용합니다.

- 이미지 (): 3개의 독립적인 카메라 뷰는 사전 학습된 시공간 VAE를 통해 압축되어 각각의 잠재 프레임으로 변환됩니다.

- 고유 수용성 상태 (): 차원이 작은 1차원 관절 위치/속도 벡터는 잠재 프레임의 공간적 크기()에 맞게 요소를 반복해서 채워 넣는 반복 패딩(Repeat-padding) 방식을 적용합니다.

- 스칼라 가치 (): 로 정규화된 단일 가치 값을 잠재 프레임의 모든 픽셀(요소) 위치에 동일하게 복사하여 덮어씌우는 브로드캐스트(Broadcast) 방식을 사용합니다.

학습(Training) 및 추론(Inference)의 알고리즘 흐름

-

학습 단계 (Training): 모델에는 다음과 같이 고정된 길이의 잠재 프레임 시퀀스가 구성되어 입력됩니다.

앞의 5개 프레임(빈 토큰, 현재 고유 수용성, 현재 3시점 이미지)은 노이즈가 없는 깨끗한 **조건(Condition)**으로 입력됩니다. 반면 뒤의 2개 프레임( 스텝 뒤의 미래 고유 수용성 및 현재 가치 )에는 가우시안 노이즈가 추가되며, Flow Matching 목적 함수를 통해 모델이 이 노이즈를 제거하여 원본으로 복원하도록 훈련됩니다.

-

추론 단계 (Inference): 실제 환경에서는 타겟 프레임 없이 조건 프레임만 주어집니다. 역확산(Reverse diffusion) 과정을 통해 와 를 생성합니다. 최종 스칼라 가치 는 예측된 가치 잠재 프레임의 '모든 요소의 평균'을 구한 뒤 원래의 범위로 스케일링하여 얻습니다. 예측된 미래 고유 수용성 역시 평탄화 후 청크 단위로 평균을 내는 역 패딩 과정을 통해 1차원 벡터로 복원됩니다.

기존 VLM 모델이 정적 이미지를 바탕으로 가치를 단순 분류하는 데 그쳤다면, ViVa는 비디오 코퍼스에서 학습한 시공간적 사전 지식을 바탕으로 데이터 주입 파이프라인을 거쳐 로봇의 물리적 동역학을 내부적으로 모의실험하여 가치를 추정한다는 명확한 구조적 차별성을 지닙니다.

3. 실험 결과 (Experiments)

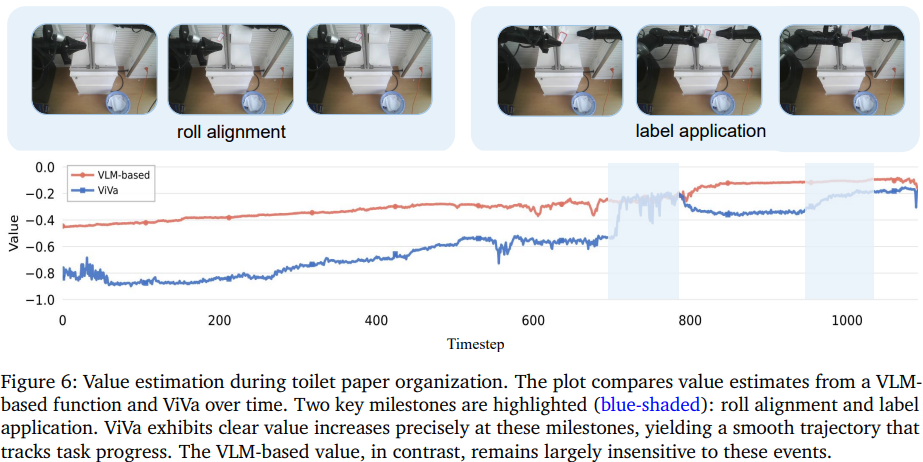

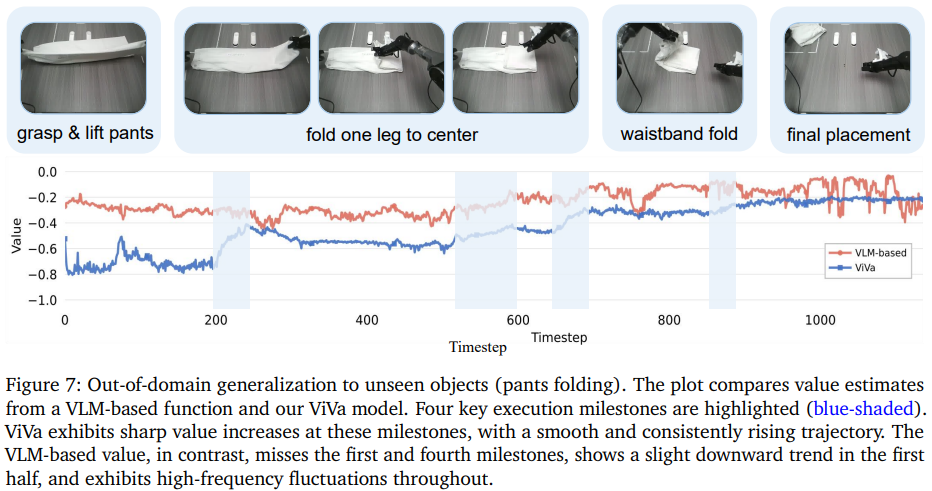

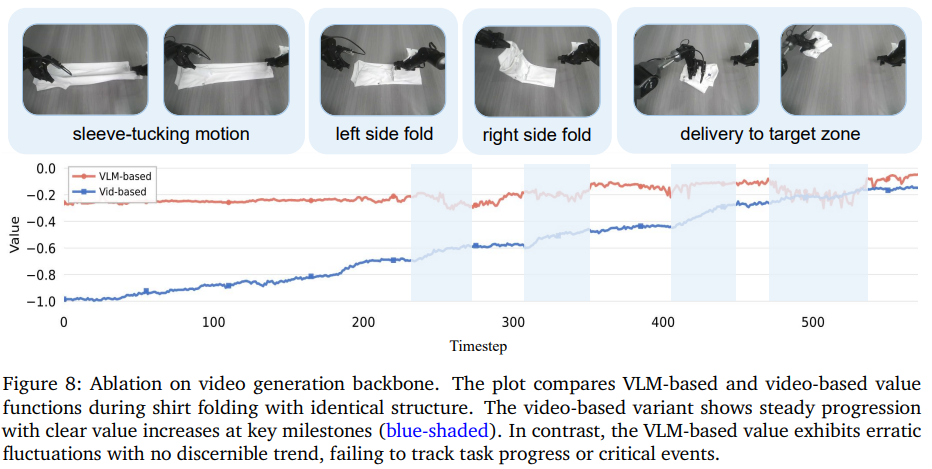

실험은 셔츠 접기, 상자 포장 및 조립, 휴지 정리라는 세 가지 실제 환경의 장기(Long-horizon) 조작 데이터셋에서 진행되었습니다. 비교군(Baseline)으로는 모방 학습 모델인 와 Gigabrain-0, 그리고 동일한 RECAP 파이프라인에 VLM 기반 가치 함수를 적용한 모델이 사용되었습니다.

가장 난이도가 높은 상자 조립 실제 로봇 실험에서, VLM 기반 RECAP 모델은 58%의 성공률을 기록한 반면, **ViVa를 적용한 RECAP 모델은 73%의 성공률과 시간당 14개의 가장 높은 처리량(Throughput)**을 달성했습니다.

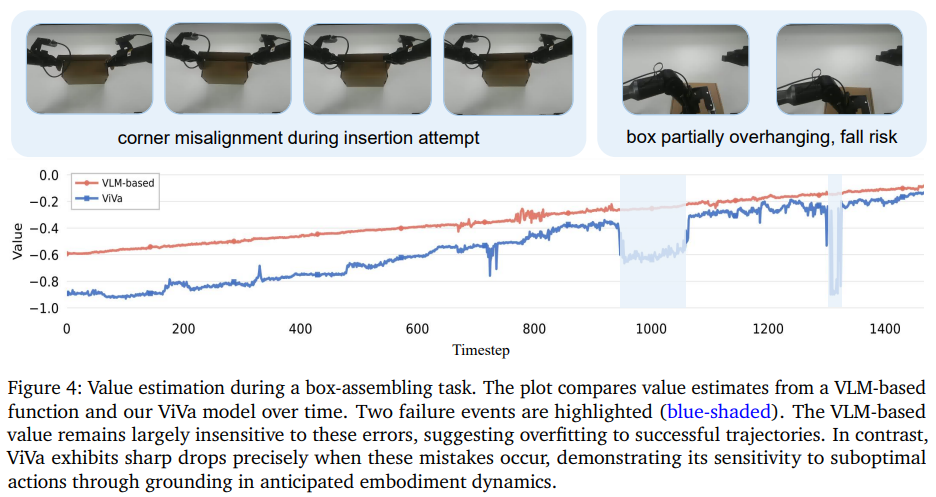

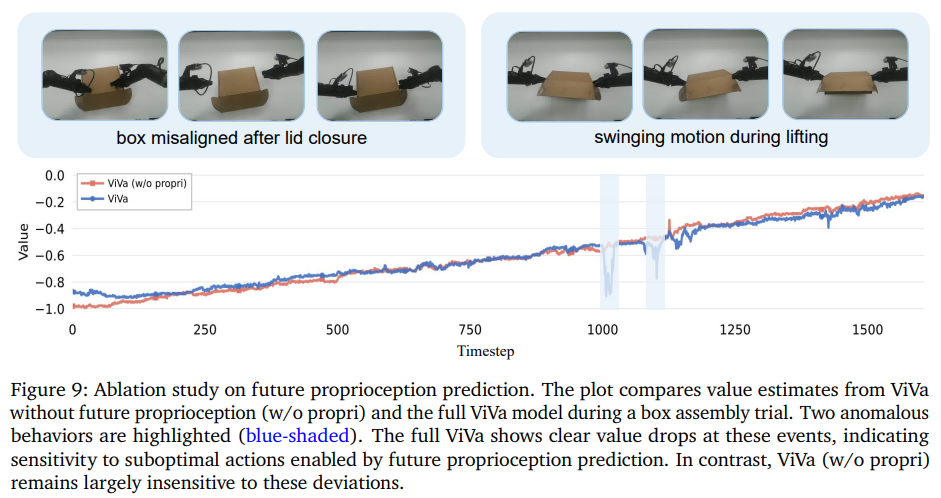

이러한 성능 향상의 원인은 정성적 분석과 어블레이션 스터디(Ablation Study)에서 명확히 드러납니다.

- 미래 고유 수용성 예측의 효과 (에러 감지 능력): 상자 모서리가 어긋나거나 흔들리는 미세한 조작 오류 발생 시, 고유 수용성 예측을 제외한 모델과 VLM은 이를 인지하지 못하고 가치를 계속 높이는 오버피팅 경향을 보였습니다. 반면 전체 구조를 갖춘 ViVa는 미래 상태 변화와의 괴리를 감지하여 가치를 즉각적으로 하락시키는 정확한 평가 능력을 보여주었습니다.

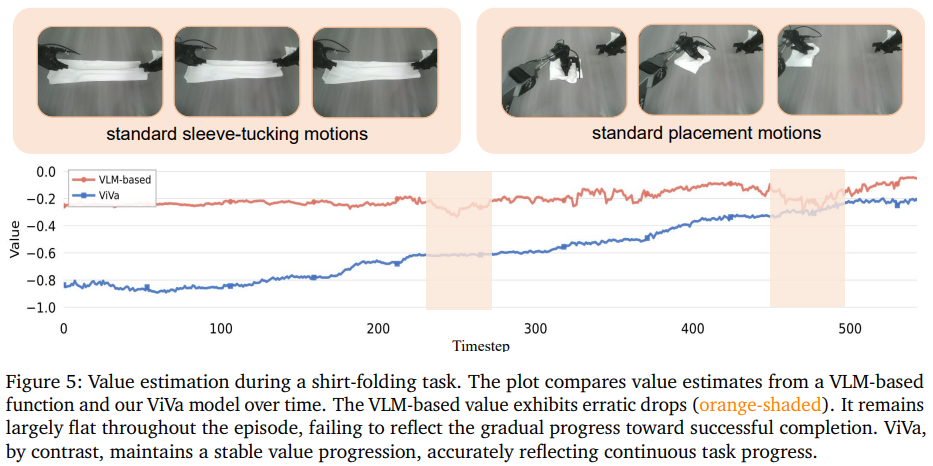

- 미학습 객체(Novel Objects)에 대한 일반화: 학습 데이터에 없던 '바지 접기' 작업에 투입되었을 때, VLM은 표면적인 시각 패턴에 의존해 가치 평가가 요동쳤으나, ViVa는 비디오 생성 백본의 물리적 진화 지식을 활용하여 작업 진행 단계(들어올리기, 다리 접기 등)마다 안정적으로 상승하는 진행 곡선을 추적했습니다.

4. 한계점 및 시사점

ViVa는 훌륭한 성과를 보여주었으나, 논문에서 언급된 몇 가지 명확한 한계점과 적용 시 제약 조건이 존재합니다.

- 평가 환경 및 연산 비용의 제약: 정책 학습 파이프라인(RECAP)의 롤아웃 주기가 길고 하드웨어 연산 비용이 높아, 실제 로봇 평가는 세 가지 작업 중 가장 복잡한 상자 조립 하나에만 집중될 수밖에 없었습니다.

- 시각적 예측의 간섭 현상 (Visual Reconstruction Interference): 학습 시 스칼라 가치, 고유 수용성 정보와 함께 미래의 '시각적 이미지 프레임'까지 동시에 복원하도록 강제했을 때 오히려 가치 추정의 정확도가 크게 떨어졌습니다. 고차원의 공간적 구조를 캡처해야 하는 시각 정보의 난이도가 가치 평가라는 단순한 구조의 학습 과정에 간섭(Interference)을 일으켰기 때문입니다.

- 예측 구간(Prediction Horizon)의 민감도: 모델이 타겟으로 삼는 미래 프레임 수 에 따라 성능이 크게 달라집니다. 로 너무 짧게 잡으면 가치가 불안정하게 요동치고, 로 너무 길게 잡으면 삽입 실패 등 미세한 조작 오류를 놓치는 현상이 발생하여, 중간 수준인 을 설정해야만 최적의 안정성을 확보할 수 있었습니다.

본 연구는 비디오 생성 모델이 단순히 미래의 행동을 계획하거나 영상을 생성하는 데 그치지 않고, 복잡한 엔지니어링 파이프라인을 통해 로봇의 작업 진행도를 정밀하게 추적하는 '가치 평가자(Value Estimator)'로 기능할 수 있는 강력한 잠재력을 가지고 있음을 실증했습니다. 특히, 시각 정보 복원을 배제하고 고유 수용성 예측을 통한 경량화를 통해 기존 VLM(0.32초)보다 빠른 추론 시간(0.18초)을 달성한 점은, 향후 실시간 로봇 제어 시스템 설계에 중요한 이론적/실무적 시사점을 제공합니다.