🖇 1. 인공신경망이란?

🖇 2. 생물학적 뉴런의 구조

🖇 3. 인공 뉴런 모델

🖇 4. 인공신경망의 계층 구조

🖇 5. 활성화 함수의 역할

🖇 6. 역전파 알고리즘

딥러닝에서 가장 먼저 이해해야 하는 개념이 인공신경망(Artificial Neural Network, ANN)이다. 핵심 원리는 생각보다 간단할 수 있다. 인간의 뇌 구조에서 영감을 받아 수학적으로 구현된 모델이기 때문이다.

이 글에서는 인공신경망의 동작 원리를 생물학적 뉴런의 구조와 비교하며 설명하고, 실제로 컴퓨터가 데이터를 처리하고 학습하는 과정을 단계별로 다루고 있다.

- 생물학적 뉴런은 어떤 구조로 신호를 주고받을까?

- 인공 뉴런은 이를 어떻게 수학적으로 흉내 낼까?

- 신경망은 입력부터 출력까지 어떤 과정을 거쳐 학습할까?

이 질문을 바탕으로 입력층-은닉층-출력층으로 구성된 계층 구조와 활성화 함수, 역전파 알고리즘의 순서로 딥러닝의 기초를 정리해 보았다.

🖇 1. 인공신경망이란?

인공신경망(Artificial Neural Network)은 인간의 뇌를 수학적으로 모방한 구조로, 기계가 데이터를 학습하고 패턴을 인식할 수 있게 해주는 계산 모델이다. 뇌의 뉴런들이 자극을 받고 신호를 전달하는 생물학적 구조에서 착안해 설계되었다.

기본적으로 인공신경망은 입력층(Input layer), 은닉층(Hidden layer), 출력층(Output layer)의 계층 구조를 가지고, 각 층은 여러 개의 뉴런(노드)으로 구성된다.

신경망은 데이터가 입력되어 → 가중치 연산을 거치고 → 비선형 변환을 통해 → 예측 또는 분류 결과를 출력하는 흐름으로 동작한다.

이러한 구조는 이미지 분류, 음성 인식, 자연어 처리 등 실제 문제를 해결하기 위해 딥러닝에서 광범위하게 활용된다.

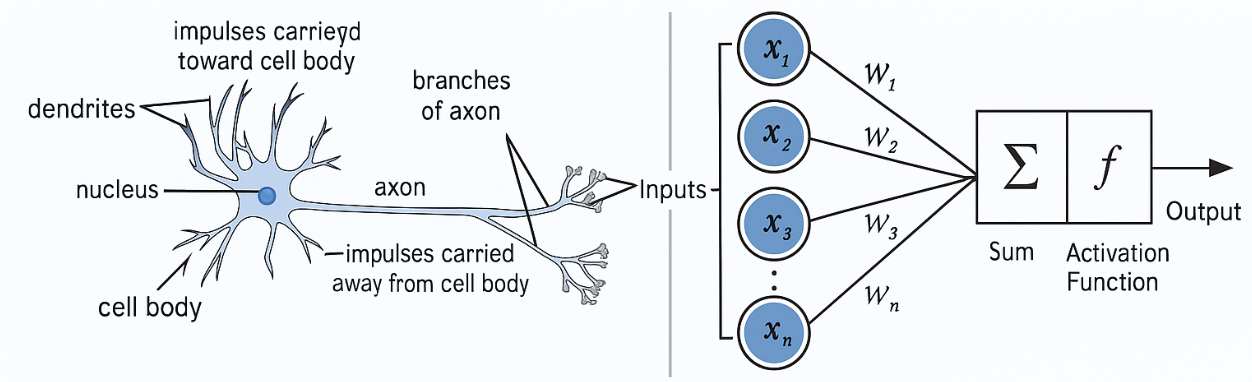

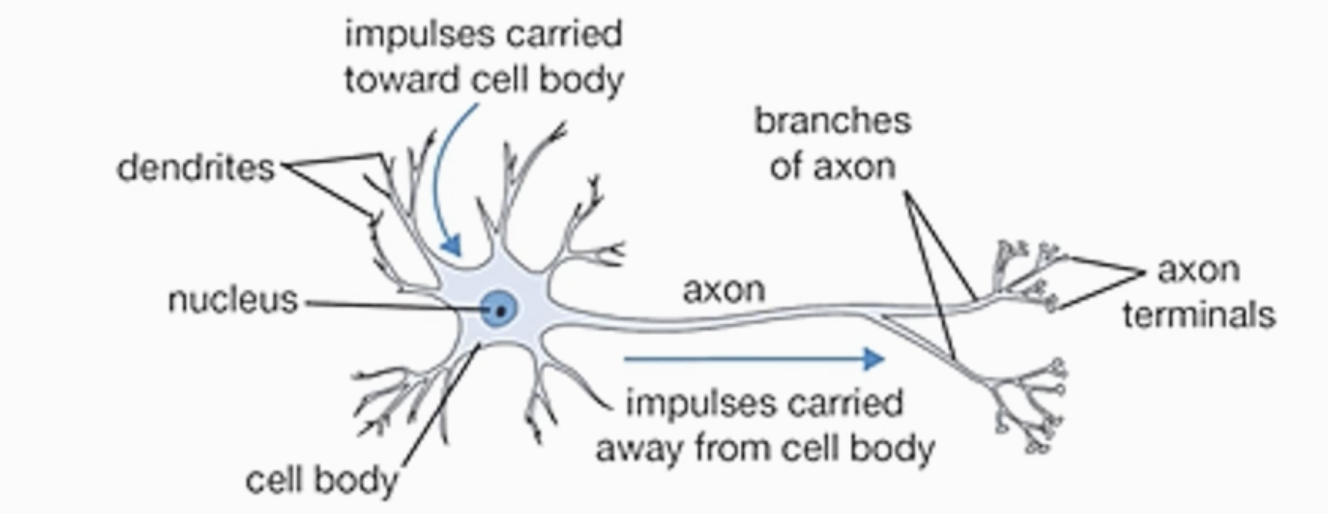

🖇 2. 생물학적 뉴런의 구조

인간의 뇌에는 약 860억 개의 뉴런이 존재하며 이들은 서로 전기·화학적 신호를 주고받는다.

- 수상돌기(Dendrite): 다른 뉴런에서 오는 신호를 받아들이는 역할

- 세포체(Cell Body): 신호를 종합하고 필요한 연산을 수행

- 축삭(Axon): 처리된 신호를 다른 뉴런으로 전달

- 축삭 말단(Axon Terminal): 신호가 다음 뉴런의 수상돌기로 전달되는 지점

- 시냅스(Synapse): 두 뉴런이 연결되어 신호를 주고받는 접합부

생물학적 뉴런의 정보 흐름은 ‘자극의 수용 → 종합 → 전달’이고, 이는 인공 뉴런의 정보 처리 방식에 그대로 반영된다.

🖇 3. 인공 뉴런 모델

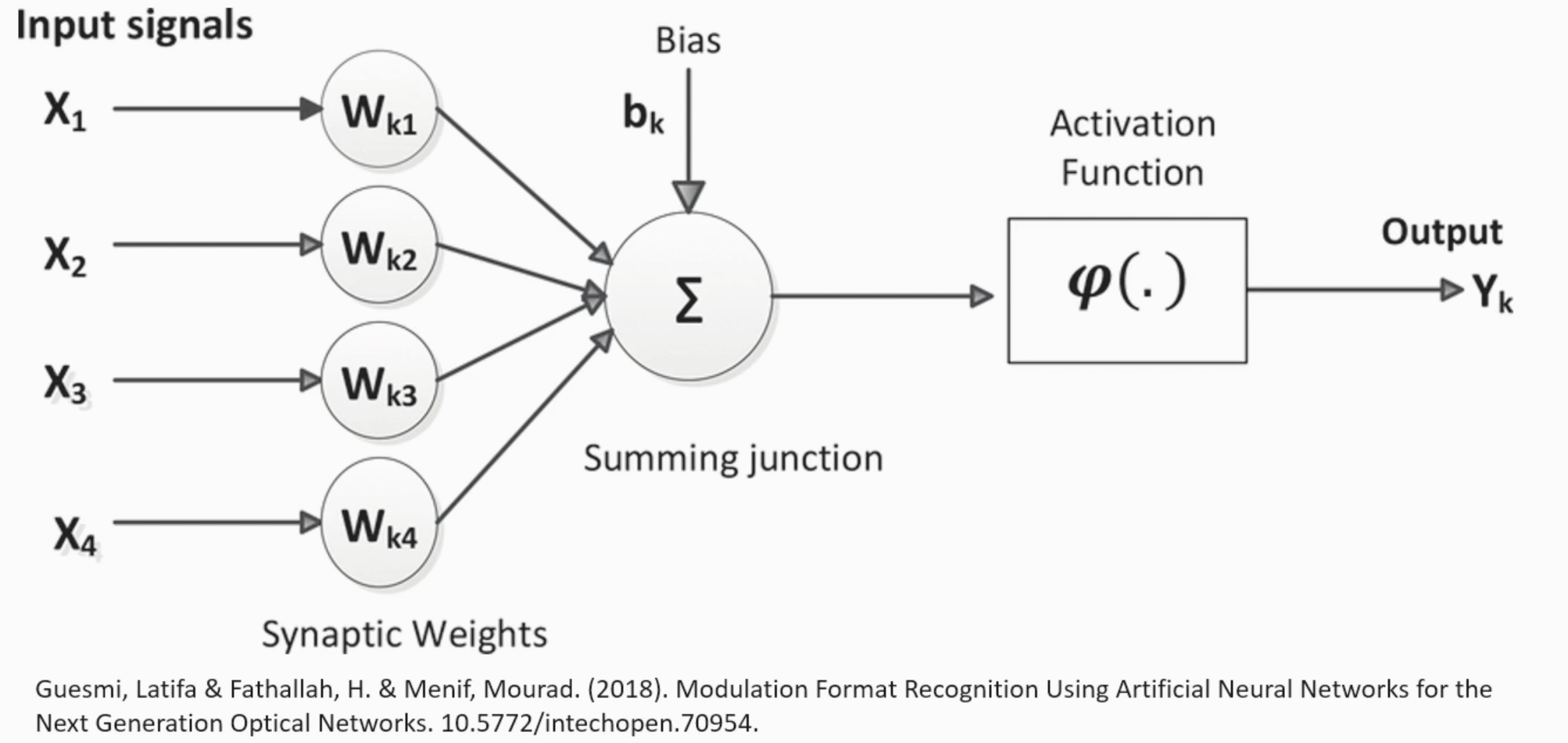

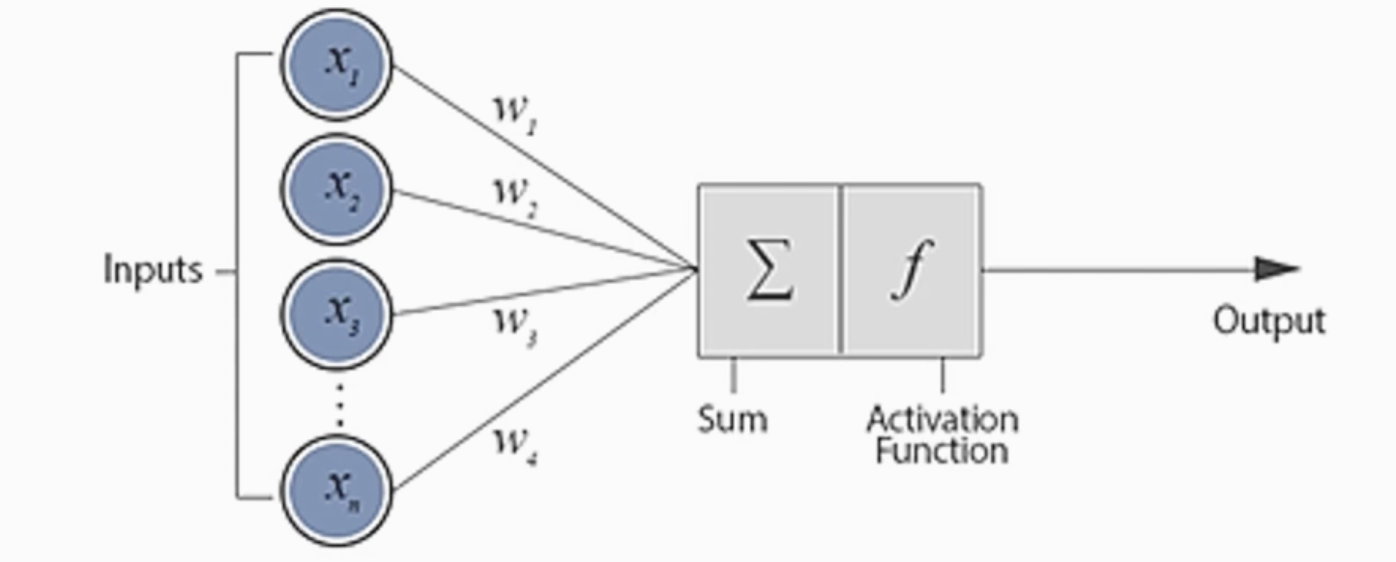

인공 뉴런은 실제 뉴런의 작동 원리를 수학적으로 단순화한 구조이다.

하나의 인공 뉴런은 다음과 같은 계산 과정을 거친다.

- : 입력값 (이미지의 각 픽셀, 사용자 행동 데이터 등)

- : 입력에 대한 가중치. 입력의 중요도를 조절하는 파라미터

- : 바이어스. 뉴런의 출력 기준을 조정

- : 활성화 함수. 출력값을 비선형적으로 변환하여 표현력을 높임

이 모델은 단순한 연산처럼 보이지만 뉴런을 여러 개 연결하면 매우 복잡한 함수도 근사할 수 있다. 실제로 신경망은 이런 단순한 계산 단위를 수천, 수만 개 쌓아 복잡한 문제를 해결한다.

[이미지] 최초의 인공신경망

🖇 4. 인공신경망의 계층 구조

인공신경망은 하나의 인공 뉴런이 아닌 수많은 뉴런들이 층 단위로 연결된 구조를 가진다.

입력층(Input Layer)

- 데이터를 받아들이는 역할. 원본 데이터를 은닉층으로 전달

은닉층(Hidden Layer)

- 입력을 바탕으로 특징을 추출하거나 가공

- 깊은 신경망일수록 이 층이 많아짐

- 은닉층은 일반적으로 Dense Layer, 즉 모든 뉴런이 완전히 연결된 구조(Fully Connected)로 구성됨. 이 구조는 각각의 입력 특징이 출력 결과에 모두 반영되도록 함.

출력층(Output Layer)

- 최종적으로 예측값을 출력

e.g., 분류 문제에서는 softmax 함수 등을 통해 확률값 출력

각 층의 뉴런은 이전 층의 모든 뉴런과 연결되며, 이로 인해 네트워크는 고차원의 비선형 함수도 학습할 수 있다.

예를 들어 고양이 사진과 개 사진을 분류하는 경우, 입력층은 픽셀 값, 은닉층은 귀, 털, 코 같은 중간 특징을, 출력층은 ‘고양이’, ‘개’ 같은 결과를 출력하게 된다.

🖇 5. 활성화 함수의 역할

활성화 함수는 선형 연산만으로는 표현할 수 없는 복잡한 관계를 학습하기 위한 핵심 구성 요소이다.

선형 함수만 사용하면 신경망의 모든 층을 합쳐도 결국 하나의 선형 함수로 축소되며 이로 인해 표현력이 떨어지게 된다.

대표적인 활성화 함수는 다음과 같다.

- Step Function: 초기 퍼셉트론에서 사용. 0 이상이면 1, 미만이면 0. 하지만 미분 불가능하여 학습이 불가능

- Sigmoid Function: 출력값을 0~1 사이로 압축. 하지만 gradient vanishing 문제 발생

- ReLU (Rectified Linear Unit): 0 이하에서는 0, 0 이상은 그대로 출력. 계산이 빠르고 성능이 뛰어나 현대 딥러닝에서 가장 널리 사용됨

활성화 함수는 신경망에 비선형성(non-linearity)을 부여해주므로 이 덕분에 신경망은 매우 복잡한 문제도 다룰 수 있다.

🖇 6. 역전파 알고리즘

다층 구조의 신경망은 수많은 가중치와 바이어스를 가진다. 이들을 효과적으로 학습시키기 위해서는 역전파 알고리즘이 필요하다.

역전파(Backpropagation)는 예측값과 실제값의 차이(오차)를 기준으로, 각 가중치가 얼마나 잘못된 결과에 영향을 끼쳤는지 계산하여 이를 바탕으로 가중치를 수정하는 방식이다.

다음과 같은 흐름으로 학습하게 된다.

- 순전파 (Forward Propagation): 입력 → 은닉층 → 출력층으로 예측값 계산

- 오차 계산 (Loss Function): 예측값과 정답의 차이 측정 (MSE, Cross Entropy 등)

- 역전파 (Backpropagation): 오차를 뒤로 전달하면서 각 파라미터의 기울기(gradient) 계산

- 가중치 갱신 (Gradient Descent): 기울기를 기반으로 가중치 업데이트

이 알고리즘은 1980년대 중반 루멜하트(Rumelhart), 힌튼(Hinton) 등이 실용화하면서 본격적으로 딥러닝이 부활하게 된 계기가 되었다.

인사이트 및 회고

인공신경망은 인간의 뇌를 본떠 만든 모델이지만 단순한 수학 연산을 반복적으로 구성한 구조로 만들어진다. 이 구조를 깊고 넓게 쌓아 올리면 매우 복잡한 문제도 해결할 수 있는 강력한 모델이 된다는 것이 흥미롭다.

흔히 "딥러닝은 어렵다"고 생각하는 이유 중 많은 부분이 용어나 구조에 대한 첫 진입 장벽 때문이라는 생각이 들었다.

뉴런 하나의 작동 원리와 학습 흐름을 명확히 이해하면 그 위에 다양한 모델을 쌓을 수 있을 것이다. 이 글을 통해 인공신경망의 기본 개념, 작동 방식, 학습 흐름을 체계적으로 정리할 수 있었다.