🖇 1. 퍼셉트론(Perceptron)이란?

🖇 2. 퍼셉트론: AND 연산

🖇 3. 퍼셉트론: XOR 문제

🖇 4. 퍼셉트론의 한계

🖇 5. 다층 퍼셉트론(MLP)의 등장

🖇 6. MPL 학습 한계

🖇 7. MPL 학습 한계 해결

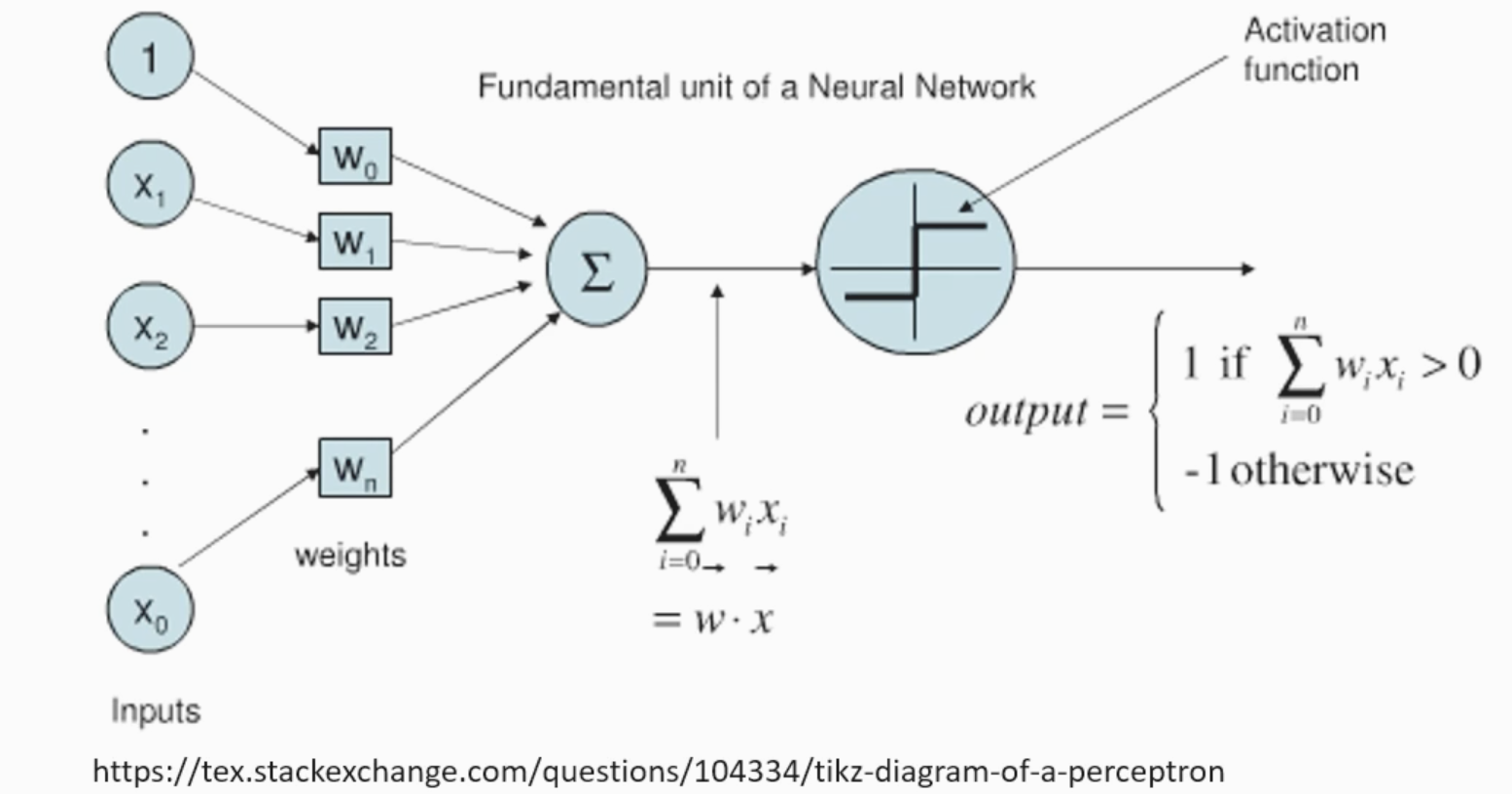

퍼셉트론은 입력과 가중치의 선형 결합을 바탕으로 이진 분류를 수행하는 가장 기본적인 인공 신경망 구조이다.

AND, OR처럼 선형적으로 구분 가능한 문제는 퍼셉트론 하나로 해결할 수 있지만, XOR처럼 비선형적인 구조를 가진 문제는 해결하지 못하는 한계가 존재한다. 이러한 한계를 극복하기 위해 은닉층을 추가한 구조인 MLP(Multi-Layer Perceptron)가 등장하게 된다.

이 글에서는 퍼셉트론의 동작 원리를 짚어보고, XOR 문제를 통해 구조적 한계를 이해한 뒤 MLP로의 확장 과정을 정리해 보았다.

🖇 1. 퍼셉트론(Perceptron)이란?

퍼셉트론은 1957년 프랭크 로젠블랫(Frank Rosenblatt)이 제안한 인공 뉴런의 초기 모델이다.

인간의 신경세포(뉴런)가 일정한 자극을 받았을 때만 신호를 전달하듯, 퍼셉트론도 입력값을 받아 조건에 따라 출력을 할지 말지를 결정한다.

이때 출력을 할지 말지를 정하는 기준이 되는 것이 활성화 함수다.

퍼셉트론의 계산은 다음과 같은 흐름을 따른다.

- : 입력값

- : 가중치

- : 바이어스

- : 입력과 가중치의 선형 조합

- : 활성화 함수의 결과값 (0 또는 1)

이 구조는 신경세포의 ‘발화 여부 결정’, 즉 세포체(soma)에서 받아들인 자극이 일정 기준을 넘으면 반응하고, 넘지 않으면 반응하지 않는 생물학적 원리를 모방한 것이다.

퍼셉트론 vs 생체신경망

인공신경망은 실제 생물학적 뉴런의 작동 원리를 수학적으로 단순화한 구조이다. 퍼셉트론은 이러한 생물학적 뉴런을 수식으로 표현한 가장 기초적인 모델인데, 두 구조는 구성 요소와 정보 처리 방식에서 많은 유사점을 보인다.

아래 표는 퍼셉트론의 연산 구조와 생체신경망의 생리적 작동 방식을 비교한 것이다. 이를 통해 인공신경망이 뇌의 뉴런을 어떤 식으로 모방했는지를 이해하는 데 도움이 될 수 있다.

퍼셉트론은 입력값과 가중치를 곱해 모두 더하고, 이 결과에 바이어스를 더한 뒤, 활성화 함수를 통해 출력 신호를 만들어낸다. 이 흐름은 뇌에서의 자극 수용 → 연산 → 발화 → 전달의 구조와 흡사하다.

| 분류 | 퍼셉트론 | 생체신경망 |

|---|---|---|

| 입력 | 입력 벡터 x = (x₁, x₂, ..., xₙ) | 이전 뉴런이 발화한 신호 |

| 가중치 | 가중치 벡터 w = (w₁, w₂, ..., wₙ) | 시냅스의 연결 강도 |

| 입력과 가중치 곱 | 각 입력과 가중치의 곱: wᵢ × xᵢ (i = 1, 2, ..., n) | 시냅스 강도에 따라 신호가 강화되거나 약해지는 과정 |

| 가중 합산 | 선형 결합: z = ∑ (wᵢ × xᵢ) + b | 세포체에서 수상돌기를 통해 들어온 신호를 종합하는 과정 |

| 활성 함수 | f(z) = 1 if z ≥ 0, else 0 | 세포체의 신호 발화 여부 결정 |

| 출력 | f(x) = f(wᵗx + b) | 축삭을 따라 시냅스로 신호가 전달되는 과정 |

이처럼 퍼셉트론은 생체신경망의 작동 원리를 기반으로 한 수학적 모델로, 신호의 입력부터 출력까지 전반적인 처리 과정을 단순하지만 효과적으로 모사한다. 이 개념은 이후에 나올 될 다층 신경망, 역전파, 딥러닝의 기반이 된다.

🖇 2. 퍼셉트론: AND 연산

퍼셉트론은 간단한 논리 연산을 매우 잘 수행한다.

퍼셉트론으로 AND 연산을 수행하는 예시를 하나 살펴보자.

- 입력: = 1, = 1

- 가중치: = 0.6, = 0.6

- 바이어스: = -1

- 반면 , 이면

이처럼 퍼셉트론은 직선 하나를 기준으로 데이터를 양분하는 데 매우 적합하다.

🖇 3. 퍼셉트론: XOR 문제

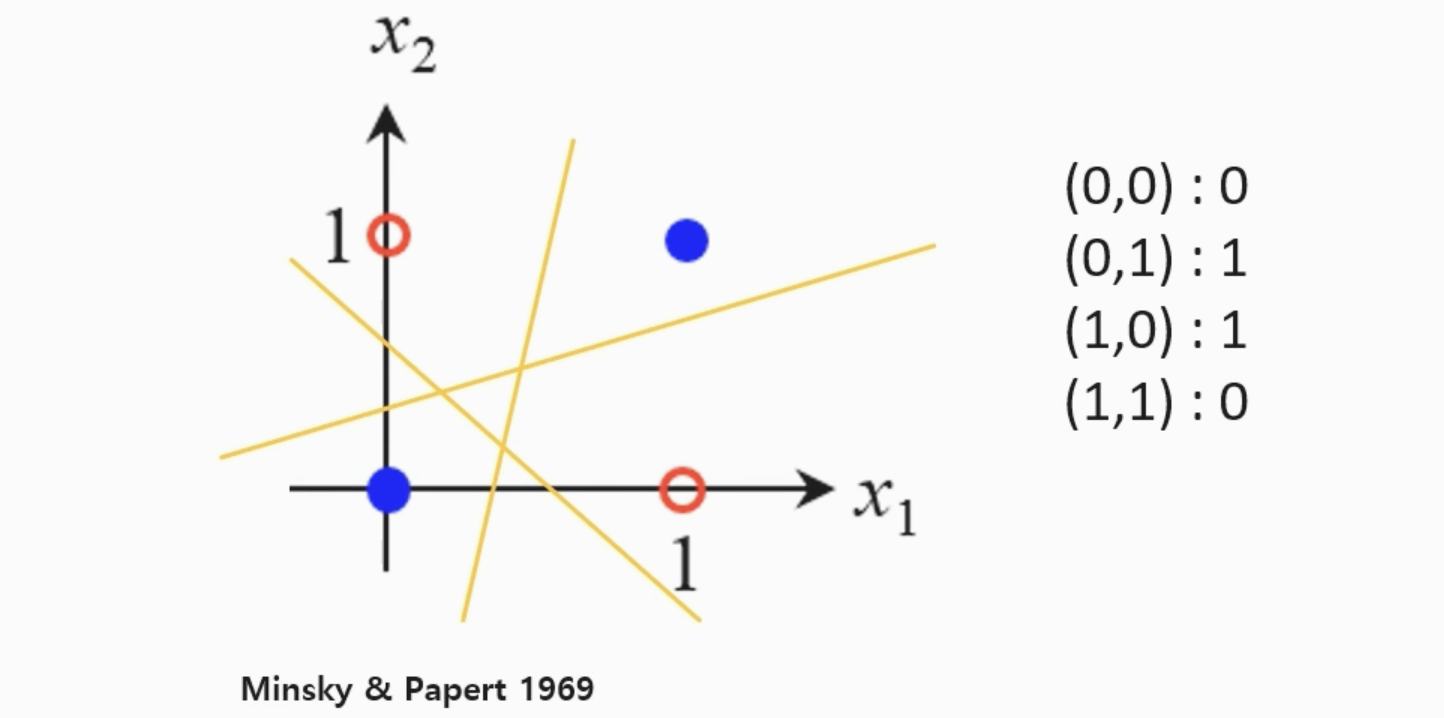

그러나 퍼셉트론은 선형 분리가 불가능한 문제에서는 제대로 작동하지 않는다.

그 대표적인 예가 바로 XOR 문제다.

| x1x_1x1 | x2x_2x2 | 출력 (XOR) |

|---|---|---|

| 0 | 0 | 0 |

| 0 | 1 | 1 |

| 1 | 0 | 1 |

| 1 | 1 | 0 |

XOR 진리표의 네 개의 좌표를 2차원 평면에 표시하면 다음과 같은 분포가 된다.

- (0,0)과 (1,1)은 클래스 0

- (0,1)과 (1,0)은 클래스 1

이들은 직선 하나로는 나눌 수 없다. 즉, 퍼셉트론의 구조로는 XOR 문제를 해결할 수 없는 것이다.

💡 단일 퍼셉트론은 하나의 직선(결정 경계)만 학습할 수 있기 때문에 비선형 문제나 곡선 경계를 요구하는 문제는 풀 수 없다.

🖇 4. 퍼셉트론의 한계

1969년, 마빈 민스키(Marvin Minsky)와 시모어 페퍼트(Seymour Papert)는 저서 『Perceptrons』 에서 퍼셉트론이 XOR 문제를 해결하지 못한다는 사실을 수학적으로 증명했다.

이로 인해 인공지능에 대한 과도한 기대가 꺾였고, 정부와 기업의 투자도 끊기면서 AI 연구는 1970~80년대 동안 정체 상태에 빠지게 되었고, 이를 AI 겨울(AI Winter)이라고 부른다.

그러나 이 시기의 좌절은 오히려 더 강력한 신경망 구조의 필요성을 자각하게 해준 중요한 계기로 작용했다.

🖇 5. 다층 퍼셉트론(MLP)의 등장

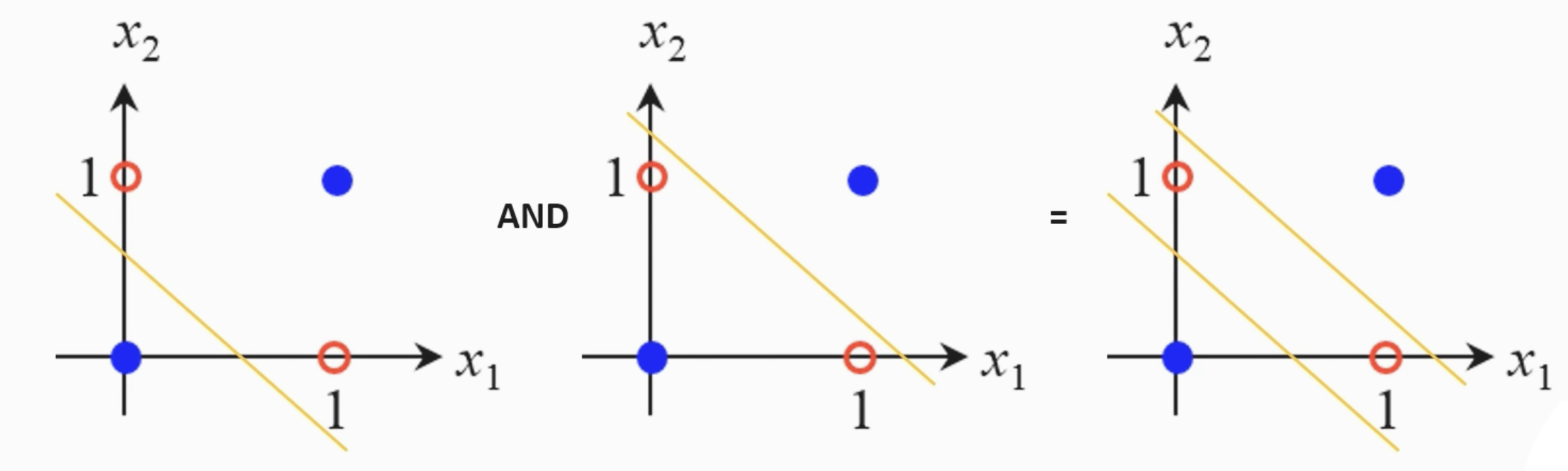

XOR 문제는 입력 공간을 비선형적으로 변형해야 해결할 수 있다.

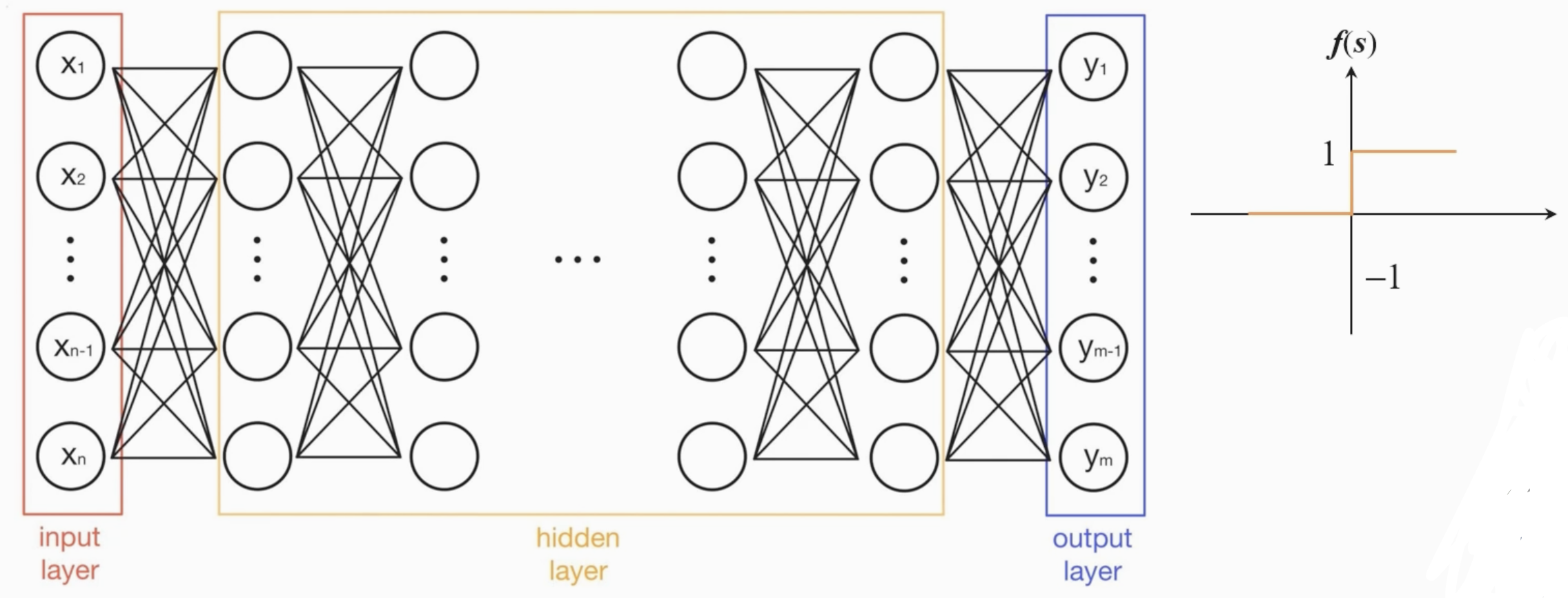

이러한 변형을 가능하게 만드는 구조로 다층 퍼셉트론(MLP, Multi-Layer Perceptron)이 등장하였다.

MLP의 구조

- 입력층: 원본 데이터를 입력받음

- 은닉층: 입력을 조합하여 중간 표현을 만들어냄 (1개 이상 존재)

- 출력층: 최종 예측값을 출력

MLP는 여러 뉴런과 여러 층을 활용해 단일 퍼셉트론이 학습할 수 없는 복잡한 관계나 곡선 경계까지도 학습할 수 있게 해준다.

- 첫 번째 은닉 뉴런이 (0,1), (1,0)을 감지한다.

- 두 번째 은닉 뉴런이 (0,0), (1,1)을 감지한다.

- 출력 뉴런은 위 둘을 조합하여 XOR 출력값을 만든다.

결과적으로, XOR 문제도 MLP에서는 해결 가능하다.

다층 퍼셉트론과 딥러닝의 경계

참고로 MLP은 은닉층이 1~2개 정도인 얕은 구조를 말할 때가 많고, 딥러닝(Deep Learning)은 은닉층이 수십~수백 개 이상으로 구성된 깊은 구조(Deep Neural Network, DNN)를 의미한다.

또한 딥러닝에는 CNN, RNN, Transformer 등 다양한 구조도 포함된다.

하지만 이 모든 복잡한 모델도 결국 퍼셉트론 구조를 층층이 확장한 것이라는 점에서 MLP은 딥러닝의 뿌리라고 할 수 있다.

🖇 6. MPL 학습 한계

구조를 확장한다고 해서 모든 문제가 해결되지는 않는다.

MLP은 구조적으로는 유연하지만 학습 자체는 매우 어렵다. 크게 두 가지의 이유로 설명할 수 있다.

1) 계단 함수 사용의 한계

- 퍼셉트론은 보통 계단 함수(step function)를 활성화 함수로 사용한다.

- 계단 함수는 불연속적이기 때문에 기울기(gradient)를 계산할 수 없고, 따라서 가중치를 수정하는 학습이 불가능하다.

2) 은닉층의 오차 측정 불가능

- 출력층은 정답과 비교해 오차를 알 수 있지만

- 은닉층은 "이 뉴런이 얼마나 잘못된 결과에 기여했는지"를 측정하기 어렵다.

→ 학습이 불가능한 구조가 되어버린다.

🖇 7. MPL 학습 한계 해결

(1) 미분 가능한 활성화 함수 도입

퍼셉트론의 계단 함수 대신 Sigmoid, Tanh, ReLU 같은 함수가 도입되었다.

| 함수 | 출력 범위 | 특징 |

|---|---|---|

| Sigmoid | 0 ~ 1 | 미분 가능, 초창기 사용 |

| Tanh | -1 ~ 1 | 중심 대칭, 수렴 빠름 |

| ReLU | 0 또는 입력값 | 계산 효율 높고, 딥러닝에서 표준 |

이 함수들은 미분 가능하기 때문에 가중치의 기울기를 계산할 수 있게 해주며 경사하강법 적용이 가능해진다.

(2) 역전파 알고리즘(Backpropagation)

1986년, 데이비드 루멜하트(David Rumelhart)와 제프리 힌튼(Geoffrey Hinton) 등은 역전파 알고리즘을 소개했다.

이 알고리즘은 오차를 출력층 → 은닉층 → 입력층 방향으로 거슬러 올라가며 가중치를 조정하는 방식이다.

- 출력층에서 손실을 계산

- 각 뉴런이 손실에 얼마나 영향을 끼쳤는지 기울기 계산

- 이 기울기를 바탕으로 가중치를 조금씩 수정

- : 학습률 (learning rate), 가중치를 얼마나 크게 조정할지를 결정하는 하이퍼파라미터

- : 손실 함수 에 대한 가중치 의 변화율 (기울기)

퍼셉트론은 인공지능 모델의 시작이었지만, XOR 같은 단순한 비선형 문제도 해결할 수 없는 구조적 한계를 가지고 있었다.

이 한계를 정확히 짚어낸 연구 덕분에 다층 퍼셉트론 구조가 등장했고, 이어서 활성화 함수 개선과 역전파 알고리즘이 도입되며 현대 딥러닝의 기반이 완성되었다.

인사이트 및 회고

퍼셉트론은 신경망의 기초를 이루는 개념이지만 선형 분류 문제만 해결 가능하다는 한계를 알 수 있었다.

XOR 문제처럼 두 집단이 직선 하나로 나뉘지 않는 경우, 퍼셉트론은 어떤 조합의 가중치와 바이어스로도 올바른 출력을 만들지 못한다는 점이 흥미로웠다. 딥러닝을 막연히 공부했을 때는 '왜 층을 더 쌓아야 하는가?'에 대한 의문을 가지지 못했는데 MPL의 원리를 이해하면서 대답까지 이끌어낼 수 있었다.

여기서도 마찬가지로, 결국 중요한 건 모델보다는 문제에 맞는 구조를 설계하는 능력이라고 생각된다. 이 글을 통해 단일 뉴런 구조에서부터 계층적 구조로 넘어가는 배경을 명확히 이해할 수 있었다.