Spark

1.spark intro

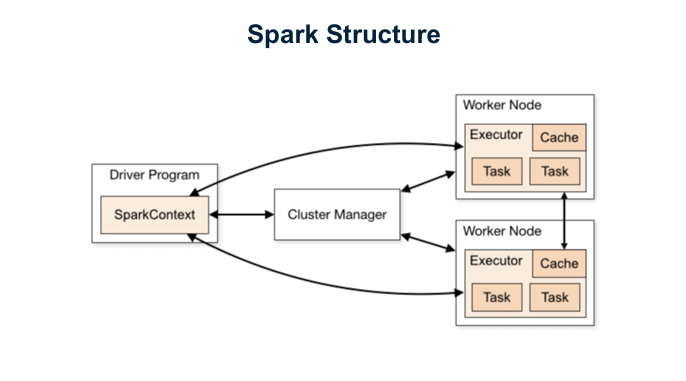

컴퓨터 클러스터는 여러 컴퓨터의 자원을 모아 하나의 컴퓨터처럼 사용할 수 있다. 스파크는 컴퓨터 클러스터에서 작업을 조율할 수 있는 데이터 처리 프레임 워크이다. 스파크 어플리케이션은 Cluster Manager과 Driver Process 그리고 다수의 execu

2025년 1월 21일

2.spark cluster

Spark mode local mode 로컬머신 한대로 spark application을 개발하고, 데이터를 처리할 수 있다. local모드에서 spark optimization을 하고자 한다면 아래의 두가지를 고려하여 application을 작성할 수 있게 된다.

2025년 1월 21일

3.web Site - trouble Shoting

원하는 웹서버를 구현하기 위해 데이터를 배치단위로 수집하고, 수집한 데이터를 저장하기 위한 ETL 프로세스를 구축하면서 필요한 컨테이너들을 여러개 띄우기로 했다.하지만 특정 컨테이너가 계속해서 내려가는 상황 혹은 터미널이 아예 동작하지 않는 문제가 발생했다.이유는 로컬

2025년 4월 10일